Heim >Technologie-Peripheriegeräte >KI >Spiel vorbei? Der Kampf zwischen starker KI und schwacher KI

Spiel vorbei? Der Kampf zwischen starker KI und schwacher KI

- 王林nach vorne

- 2023-04-11 20:07:171480Durchsuche

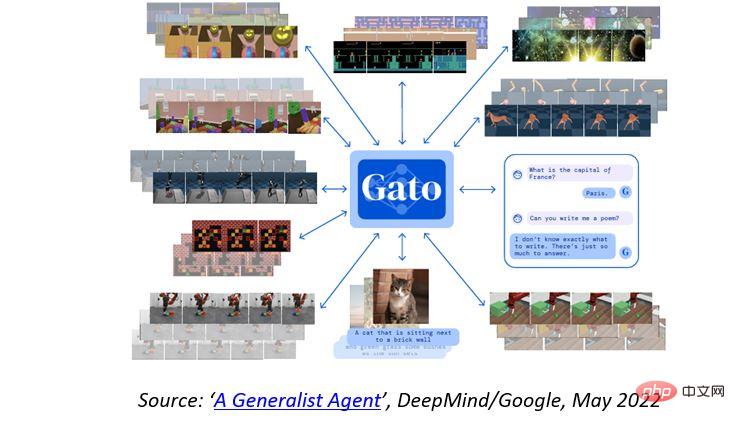

Da Googles Tochtergesellschaft für künstliche Intelligenz (KI), DeepMind, vor einigen Wochen einen Artikel veröffentlicht hat, in dem sie einen „generalistischen“ Agenten namens Gato beschreibt (der verwendet werden kann) Das gleiche trainierte Modell führt verschiedene Aufgaben aus) und behauptet, dass künstliche allgemeine Intelligenz (AGI) durch bloße Größenordnung erreicht werden kann, was eine hitzige Debatte innerhalb der KI-Branche auslöst. Auch wenn es etwas akademisch erscheinen mag, ist die Realität so, dass unsere Gesellschaft – einschließlich unserer Gesetze, Vorschriften und Wirtschaftsmodelle – noch nicht bereit sein wird, wenn die allgemeine künstliche Intelligenz vor der Tür steht.

Tatsächlich ist der Generalagent Gato dank des gleichen trainierten Modells in der Lage, Atari zu spielen, Bildunterschriften hinzuzufügen, zu chatten oder Blöcke mit einem echten Roboterarm zu stapeln. Es kann auch basierend auf dem Kontext entscheiden, ob Text, Verbindungsdrehmoment, Tastendrücke oder andere Markierungen ausgegeben werden sollen. Es scheint sich also um ein allgemeineres KI-Modell zu handeln als das beliebte GPT-3, DALL-E 2, PaLM oder Flamingo, das sich sehr gut für sehr eng begrenzte spezifische Aufgaben wie das Schreiben in natürlicher Sprache, das Verstehen von Sprachen oder das Erstellen eines Bildes eignet auf der Beschreibung.

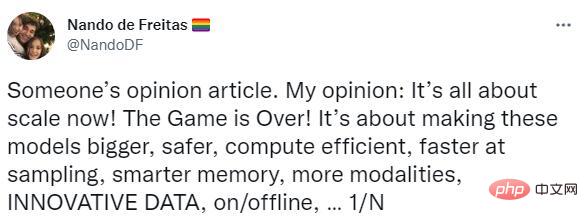

Das bringt den DeepMind-Wissenschaftler und Universitätsprofessor Nando de Freitas dazu, zu behaupten, dass es jetzt nur noch um die Größe geht! Allgemeine Intelligenz (AGI) kann durch den vollständigen Maßstab (d. h. größere Modelle, größere Trainingsdatensätze und stärkere Rechenleistung) erreicht werden. Doch „was ist das Spiel“, wovon de Freitas spricht? Worum geht es in dieser Debatte wirklich?

Debatte über künstliche Intelligenz: Starke KI vs. schwache KI

diskutiert die Details dieser Debatte und ihre Auswirkungen, bevor wir uns damit befassen Angesichts der Auswirkungen auf die Gesellschaft insgesamt lohnt es sich, einen Schritt zurückzutreten und den Kontext zu verstehen.

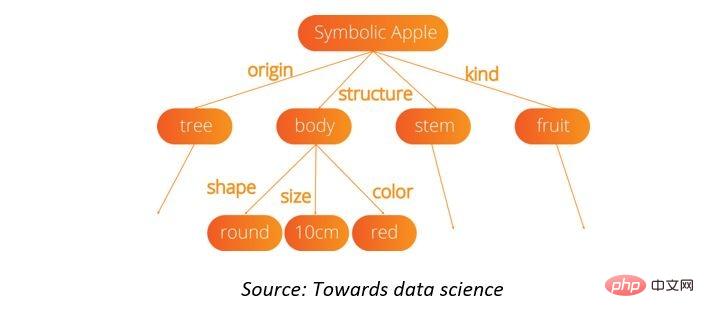

Die Bedeutung des Begriffs „Künstliche Intelligenz“ hat sich im Laufe der Jahre geändert, aber aus einer übergeordneten und allgemeinen Perspektive kann sie als intelligenter Agent A definiert werden Fachgebiet, das sich auf jedes System bezieht, das seine Umgebung wahrnimmt und Maßnahmen ergreift, um seine Chancen auf das Erreichen seiner Ziele zu maximieren. Diese Definition lässt bewusst die Frage außer Acht, ob Agenten oder Maschinen tatsächlich „denken“ können, eine Frage, die seit langem Gegenstand heftiger Debatten ist. 1950 argumentierte der britische Mathematiker Alan Turing in seinem berühmten Aufsatz „The Imitation Game“, dass es besser sei, sich darauf zu konzentrieren, „ob eine Maschine wahrscheinlich intelligentes Verhalten an den Tag legt“, anstatt zu überlegen, ob eine Maschine denken kann. Diese Unterscheidung führt konzeptionell zu zwei Hauptzweigen der künstlichen Intelligenz: starke künstliche Intelligenz und schwache künstliche Intelligenz. Starke KI, auch künstliche allgemeine Intelligenz (AGI) genannt, ist eine theoretische Form der künstlichen Intelligenz, bei der Maschinen die gleiche Intelligenz wie Menschen benötigen. Daher wird es selbstbewusst sein und die Fähigkeit haben, Probleme zu lösen, zu lernen und für die Zukunft zu planen. Dies ist die ehrgeizigste Definition von künstlicher Intelligenz, der „heilige Gral der künstlichen Intelligenz“ – aber vorerst bleibt sie reine Theorie. Ansätze zur Erzielung einer starken KI drehen sich häufig um symbolische KI, bei der Maschinen interne symbolische Darstellungen der physischen und abstrakten „Welt“ bilden, sodass Regeln oder Überlegungen angewendet werden können, um weiter zu lernen und Entscheidungen zu treffen.

Während die Forschung in diesem Bereich weitergeht, war sie bisher nur begrenzt erfolgreich bei der Lösung realer Probleme, da interne oder symbolische Darstellungen des Weltmaßstabs mit zunehmendem Maßstab schnell unüberschaubar werden.

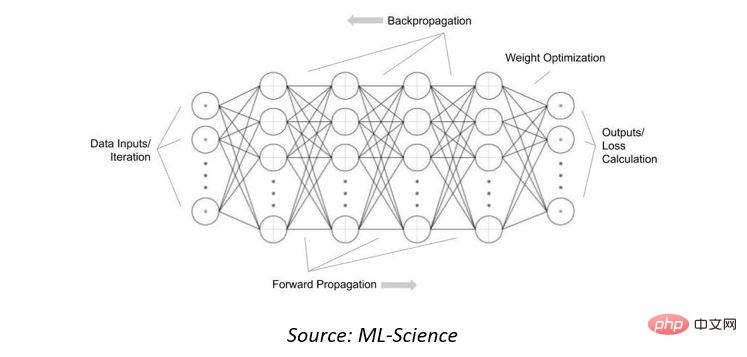

Methoden zur Erreichung einer schwachen künstlichen Intelligenz basieren häufig auf der Verwendung künstlicher neuronaler Netze, Systemen, die von den biologischen neuronalen Netzen inspiriert sind, aus denen tierische Gehirne bestehen. Dabei handelt es sich um Ansammlungen miteinander verbundener Knoten oder Neuronen, kombiniert mit einer Aktivierungsfunktion, die die Ausgabe basierend auf den in einer „Eingabeschicht“ präsentierten Daten und den Gewichtungen in den Verbindungen bestimmt. Um die Gewichte in den Verbindungen so anzupassen, dass die „Ausgabe“ nützlich oder korrekt ist, kann das Netzwerk „trainiert“ werden, indem es vielen Datenbeispielen ausgesetzt wird und der Ausgabeverlust „zurückpropagiert“ wird.

Man kann sagen, dass es einen dritten Zweig namens „neurosymbolische künstliche Intelligenz“ gibt, der neuronale Netze und regelbasierte künstliche Intelligenz kombiniert. Obwohl es konzeptionell vielversprechend und fundiert ist, da es der Funktionsweise unseres biologischen Gehirns näher zu sein scheint, befindet es sich noch in einem sehr frühen Stadium.

Ist das wirklich eine Frage der Größe?

Der Schlüssel zur aktuellen Debatte ist, ob mit KI und Modellen für maschinelles Lernen in ausreichendem Umfang künstliche allgemeine Intelligenz (AGI) wirklich erreicht werden kann und somit die symbolische künstliche Intelligenz vollständig abgeschafft werden kann. Ist es jetzt nur eine Frage der Hardware-Skalierung und -Optimierung, oder müssen wir mehr in den KI-Algorithmen und -Modellen entdecken und entwickeln?

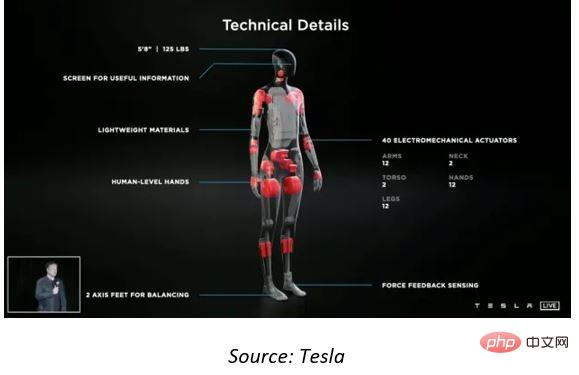

Tesla scheint auch den Standpunkt von Google/DeepMind zu akzeptieren. Auf der Veranstaltung zum Tag der künstlichen Intelligenz (KI) 2021 kündigte Tesla die Einführung des Tesla Bot an, auch bekannt als Optimus, eines universellen humanoiden Roboters, der von Tesla entwickelt wird Autos. Interessanterweise hat der CEO des Unternehmens, Elon Musk, erklärt, dass er hofft, den Roboter bis 2023 in Produktion zu haben, und behauptet, dass Optimus Prime irgendwann in der Lage sein wird, „alles zu tun, was ein Mensch nicht tun möchte“, was bedeutet, dass er davon ausgeht, dass AGI dies dann tun wird möglich.

Andere KI-Forschungsgruppen – vor allem Yann LeCun, Chef-KI-Wissenschaftler bei Meta und Professor an der New York University, die den weniger ehrgeizigen Begriff „Human-like Artificial Intelligence“ (HLAI) bevorzugen – argumentieren jedoch, dass es noch viele Fragen und Probleme gibt Probleme, die gelöst werden müssen und die nicht allein durch Rechenleistung gelöst werden können, erfordern möglicherweise neue Modelle oder sogar Software-Paradigmen.

Bei diesen Problemen hat die Maschine die Fähigkeit, durch babyähnliche Beobachtung zu verstehen, wie die Welt funktioniert, vorherzusagen, wie sie durch ihre Handlungen die Welt beeinflussen wird, mit der inhärenten Unvorhersehbarkeit der Welt umzugehen und die Auswirkungen vorherzusagen eine Reihe von Aktionen, die das Denken und Planen sowie die Darstellung und Vorhersage im abstrakten Raum ermöglichen. Letztlich geht es um die Frage, ob dies durch Gradientenlernen allein mit unseren bestehenden künstlichen neuronalen Netzen erreicht werden kann oder ob weitere Durchbrüche erforderlich sind.

Obwohl Deep-Learning-Modelle in der Tat in der Lage sind, „Schlüsselmerkmale“ aus Daten zu erzeugen, ohne dass ein menschliches Eingreifen erforderlich ist, ist es leicht zu glauben, dass sie in der Lage sein werden, mehr Daten und Rechenleistung zu nutzen, um die verbleibenden Daten zu ermitteln und zu lösen Frage, aber es könnte zu schön sein, um wahr zu sein. Um eine einfache Analogie zu verwenden: Das Entwerfen und Bauen schnellerer und leistungsstärkerer Autos wird sie nicht zum Fliegen bringen, da wir die Aerodynamik vollständig verstehen müssen, um das Flugproblem überhaupt zu lösen.

Die Fortschritte, die mit Deep-Learning-KI-Modellen erzielt werden, sind beeindruckend, aber es lohnt sich darüber nachzudenken, ob die optimistischen Ansichten schwacher KI-Praktiker einfach nur ein Fall von Maslows Hammer oder dem „Gesetz der Werkzeuge“ sind, d. h. „Wenn Sie das einzige Werkzeug sind, das Sie haben.“ „Haben“ ist ein Hammer und man neigt dazu, jedes Problem als Nagel zu betrachten.“

Spiel vorbei oder zusammenarbeiten?

Grundlagenforschung wie Google/DeepMind, Meta oder Tesla bereitet der Privatwirtschaft oft Unbehagen, denn trotz ihrer großen Budgets sind diese Organisationen oft stärker auf Wettbewerb und schnelle Markteinführung ausgerichtet als auf akademische Zusammenarbeit und langfristiges Denken.

Die Lösung allgemeiner künstlicher Intelligenz erfordert möglicherweise zwei Ansätze und keinen Wettbewerb zwischen starken und schwachen KI-Befürwortern. Es ist nicht weit hergeholt, eine Analogie zum menschlichen Gehirn zu ziehen, das sowohl über bewusste als auch unbewusste Lernfähigkeiten verfügt. Unser Kleinhirn macht etwa 10 % des Gehirnvolumens aus, enthält aber über 50 % der Gesamtzahl der Neuronen und ist für die Koordination und Bewegung im Zusammenhang mit motorischen Fähigkeiten, insbesondere den Händen und Füßen, sowie für die Aufrechterhaltung der Körperhaltung und des Gleichgewichts verantwortlich. Dies geschieht schnell und unbewusst, und wir können nicht wirklich erklären, wie wir es tun. Unser bewusstes Gehirn ist zwar viel langsamer, aber in der Lage, abstrakte Konzepte, Planungen und Vorhersagen zu verarbeiten. Darüber hinaus ist es möglich, sich bewusst Wissen anzueignen und durch Training und Wiederholung eine Automatisierung zu erreichen – etwas, was Profisportlern besonders gut gelingt.

Man kommt nicht umhin zu fragen, warum das durchschnittliche künstliche Intelligenzsystem auf einem einzigen Modell oder Algorithmus basiert, wenn die Natur das menschliche Gehirn über Hunderttausende von Jahren auf solch hybride Weise entwickelt hat.

Auswirkungen auf Gesellschaft und Investoren

Unabhängig von der spezifischen zugrunde liegenden KI-Technologie, die letztendlich zur künstlichen allgemeinen Intelligenz führen wird, wird dieses Ereignis enorme Auswirkungen auf unsere Gesellschaft haben – genau wie das Rad, die Dampfmaschine, die Elektrizität oder der Computer. Wenn Unternehmen Menschen vollständig durch Roboter ersetzen können, muss sich unser kapitalistisches Wirtschaftsmodell wohl ändern, andernfalls wird es irgendwann zu sozialen Unruhen kommen.

Trotzdem ist es wahrscheinlich, dass die laufende Debatte ein bisschen wie Unternehmens-PR ist, und die Realität ist, dass die allgemeine künstliche Intelligenz weiter entfernt ist, als wir derzeit denken, sodass wir Zeit haben, uns mit ihren möglichen Auswirkungen zu befassen. Kurzfristig ist jedoch klar, dass das Streben nach allgemeiner künstlicher Intelligenz weiterhin Investitionen in bestimmte Technologiebereiche wie Software und Halbleiter vorantreiben wird.

Der Erfolg spezifischer Anwendungsfälle unter dem schwachen KI-Framework hat zu einem zunehmenden Druck auf unsere vorhandenen Hardwarefunktionen geführt. Beispielsweise verfügt das im Jahr 2020 eingeführte beliebte Generative Pre-Trained Transformer 3 (GPT-3)-Modell OpenAI, das bereits rohe Prosa mit menschenähnlicher Geläufigkeit schreiben kann, über 175 Milliarden Parameter und das Training dauert mehrere Monate.

Man kann sagen, dass einige der heute existierenden Halbleiterprodukte – darunter CPUs, GPUs und FPGAs – in der Lage sind, Deep-Learning-Algorithmen mehr oder weniger effizient zu berechnen. Mit zunehmender Modellgröße wird ihre Leistung jedoch unbefriedigend und es besteht Bedarf an maßgeschneiderten Designs, die für KI-Workloads optimiert sind. Führende Cloud-Anbieter wie Amazon, Alibaba, Baidu und Google sowie Tesla und verschiedene Halbleiter-Startups wie Cambrian, Cerebras, Esperanto, Graphcore, Groq, Mythic und Sambanova haben diesen Weg eingeschlagen.

Das obige ist der detaillierte Inhalt vonSpiel vorbei? Der Kampf zwischen starker KI und schwacher KI. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr