Heim >Technologie-Peripheriegeräte >KI >Wie können Daten für kausale Schlussfolgerungen besser genutzt werden?

Wie können Daten für kausale Schlussfolgerungen besser genutzt werden?

- PHPznach vorne

- 2023-04-11 19:43:021646Durchsuche

Einleitung: Der Titel dieser Weitergabe lautet „Wie können Daten bei kausalen Schlussfolgerungen besser genutzt werden?“ ", in dem hauptsächlich die jüngsten Arbeiten des Teams im Zusammenhang mit veröffentlichten Arbeiten zu Ursache und Wirkung vorgestellt werden. In diesem Bericht wird vorgestellt, wie wir mehr Daten verwenden können, um kausale Schlussfolgerungen aus zwei Aspekten zu ziehen: Zum einen können wir historische Kontrolldaten verwenden, um Verwirrungsverzerrungen explizit zu mildern, und zum anderen können wir kausale Schlussfolgerungen durch die Fusion von Daten aus mehreren Quellen ziehen.

Volltext-Inhaltsverzeichnis:

- Hintergrund der Kausalinferenz

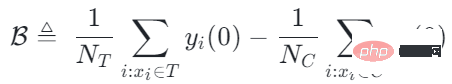

- Korrigierter Kausalbaum GBCT

- Kausale Datenfusion

- Geschäftsanwendung in Ant ?? Bildklassifizierung usw. Frage. Bei der Frage nach der Kausalität geht es um den Mechanismus hinter den Daten. Häufige Fragen wie „Verursacht Rauchen Lungenkrebs?“ Ähnliche Fragen sind Kausalitätsfragen.

Beim Problem der Kausalwirkungsschätzung gibt es zwei sehr wichtige Datentypen: Ein Typ sind Beobachtungsdaten und der andere Typ sind experimentelle Daten, die durch randomisierte kontrollierte Experimente generiert werden.

Beobachtungsdaten sind die Daten, die in unserem tatsächlichen Leben oder in unseren Produkten gesammelt werden. Die Raucherdaten zeigen beispielsweise, dass manche Menschen gerne rauchen, während die Beobachtungsdaten sich auf Raucher beziehen. Am Ende erkranken einige der Raucher an Krebs. Das Problem der Vorhersage des maschinellen Lernens besteht darin, die bedingte Wahrscheinlichkeit P (Lungenkrebs bekommen | Rauchen) abzuschätzen, dh unter Berücksichtigung der Bedingungen des Rauchens die Wahrscheinlichkeit, dass ein Raucher an Lungenkrebs erkrankt. In den oben genannten Beobachtungsdaten ist die Verteilung des Rauchens tatsächlich nicht zufällig: Jeder Mensch hat eine andere Vorliebe für das Rauchen und wird auch von der Umgebung beeinflusst.

Der beste Weg, kausale Fragen zu beantworten, ist die Durchführung eines randomisierten kontrollierten Experiments. Experimentelle Daten werden durch randomisierte kontrollierte Experimente gewonnen. In einer randomisierten kontrollierten Studie erfolgt die Zuordnung zur Behandlung zufällig. Angenommen, Sie müssen ein Experiment durchführen, um die Schlussfolgerung zu erhalten, „ob Rauchen Lungenkrebs verursacht“. Zuerst müssen Sie genügend Menschen finden, die Hälfte von ihnen zum Rauchen zwingen und die andere Hälfte dazu zwingen, nicht zu rauchen, und die Wahrscheinlichkeit einer Lungenkrebserkrankung beobachten Krebs in beiden Gruppen. Obwohl randomisierte kontrollierte Studien in einigen Szenarien aufgrund von Faktoren wie Ethik und Richtlinien nicht möglich sind, können randomisierte kontrollierte Studien in einigen Bereichen dennoch durchgeführt werden, beispielsweise bei A/B-Tests in der Suchmaschinenwerbung.

- Der Hauptunterschied zwischen dem Kausalschätzproblem E(Y|do(X)) und dem traditionellen Vorhersage- oder Klassifizierungsproblem E(Y|X) besteht darin, dass: gegebene Bedingungen entstehen. Die von vorgeschlagene Intervention Judy Pearl repräsentiert das Symbol Do. Greifen Sie ein, um die X-Variable auf einen bestimmten Wert zu zwingen. Die Schätzung der kausalen Wirkungen in diesem Bericht bezieht sich hauptsächlich auf die Schätzung der kausalen Wirkungen anhand von Beobachtungsdaten.

Wie können Daten besser für kausale Schlussfolgerungen genutzt werden? In diesem Bericht wird ein solches Thema anhand aktueller, von zwei Teams veröffentlichter Arbeiten als Beispiele vorgestellt.

Wie können Daten besser für kausale Schlussfolgerungen genutzt werden? In diesem Bericht wird ein solches Thema anhand aktueller, von zwei Teams veröffentlichter Arbeiten als Beispiele vorgestellt.

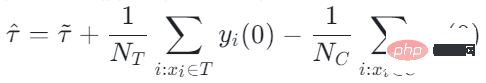

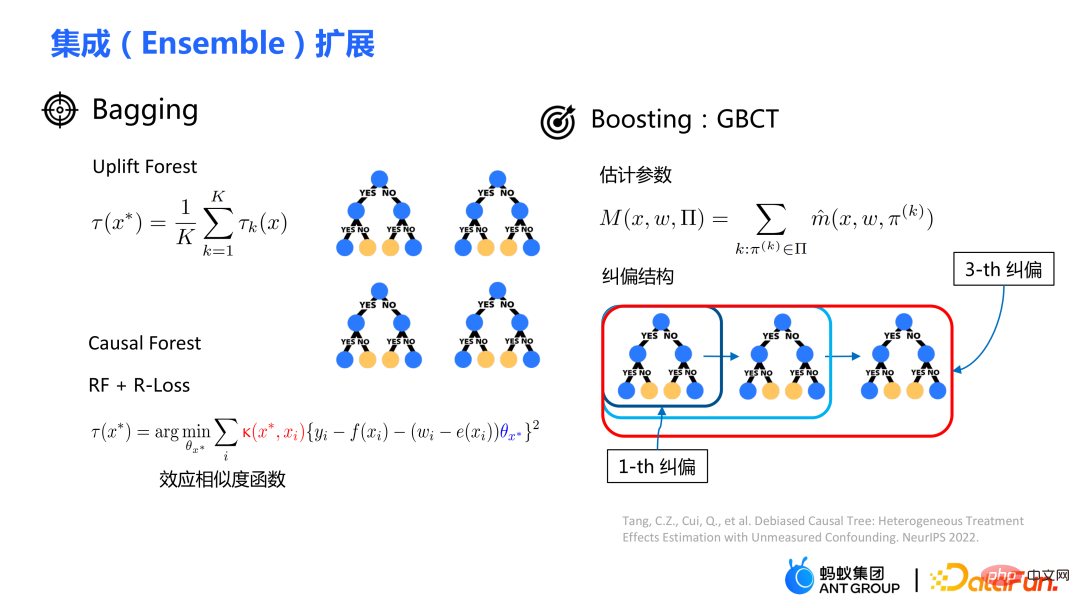

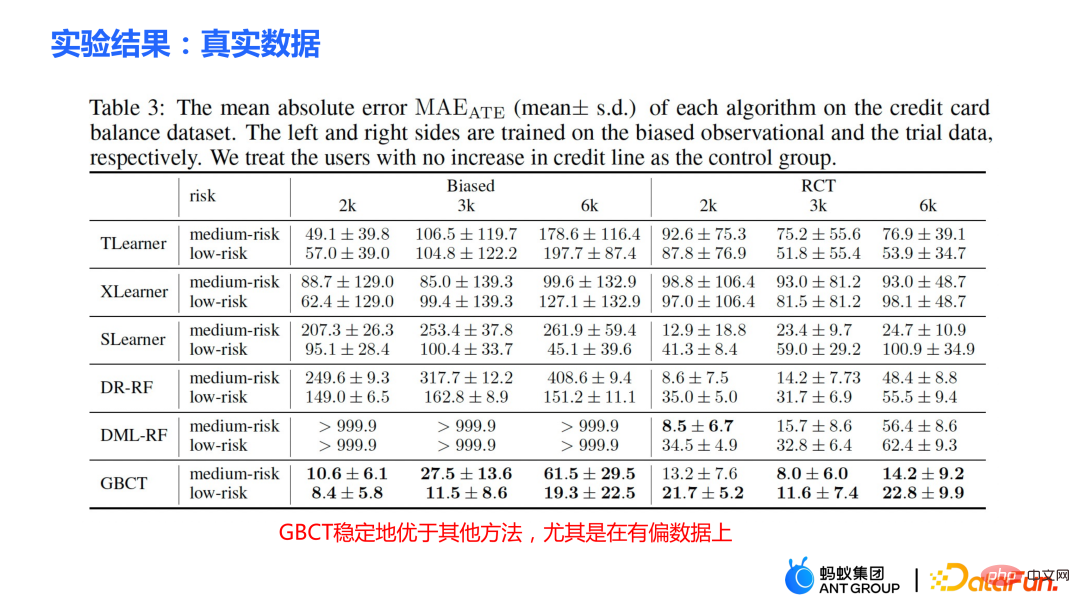

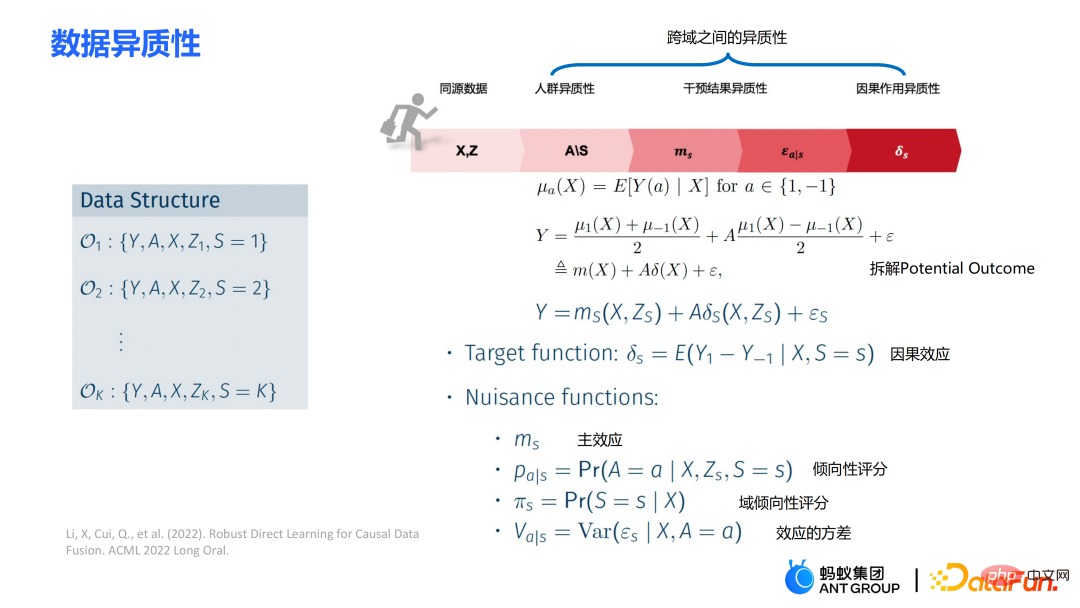

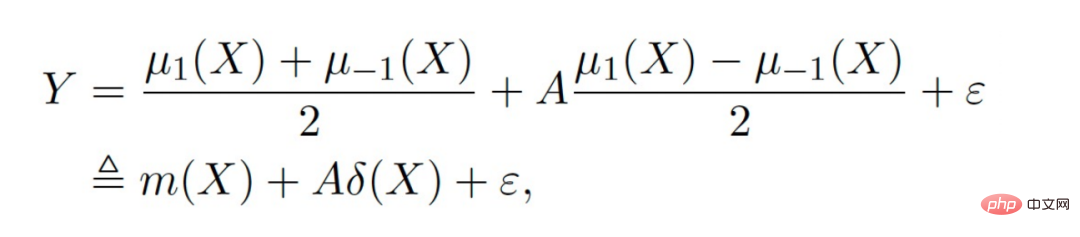

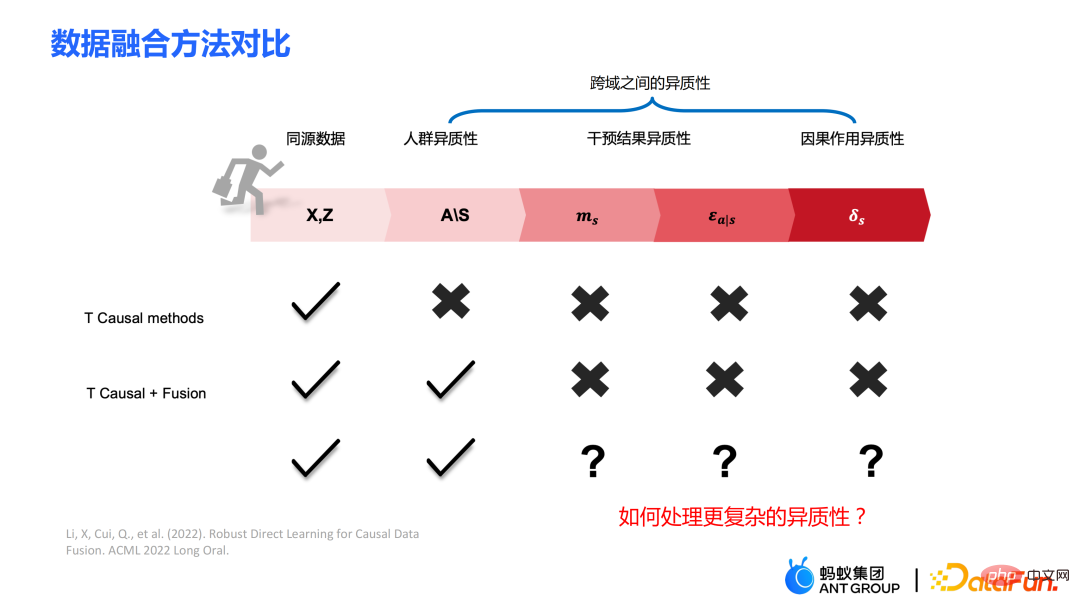

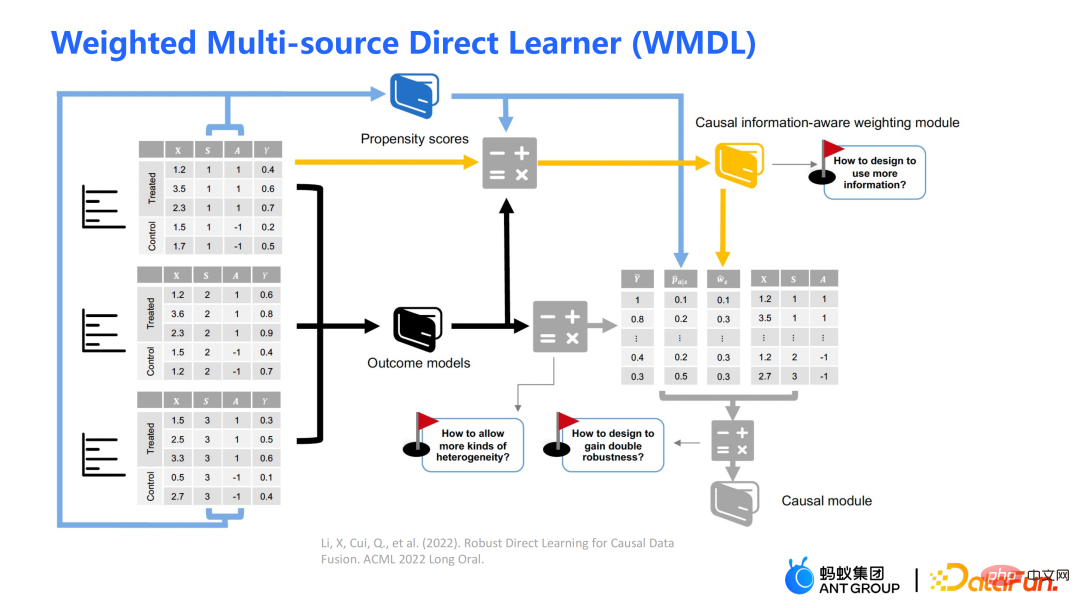

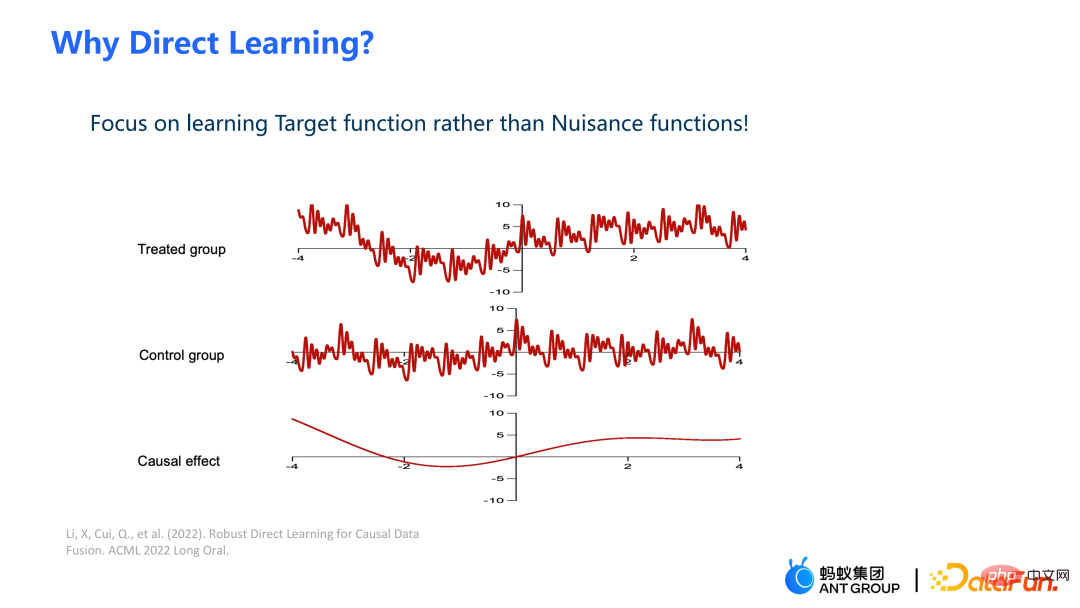

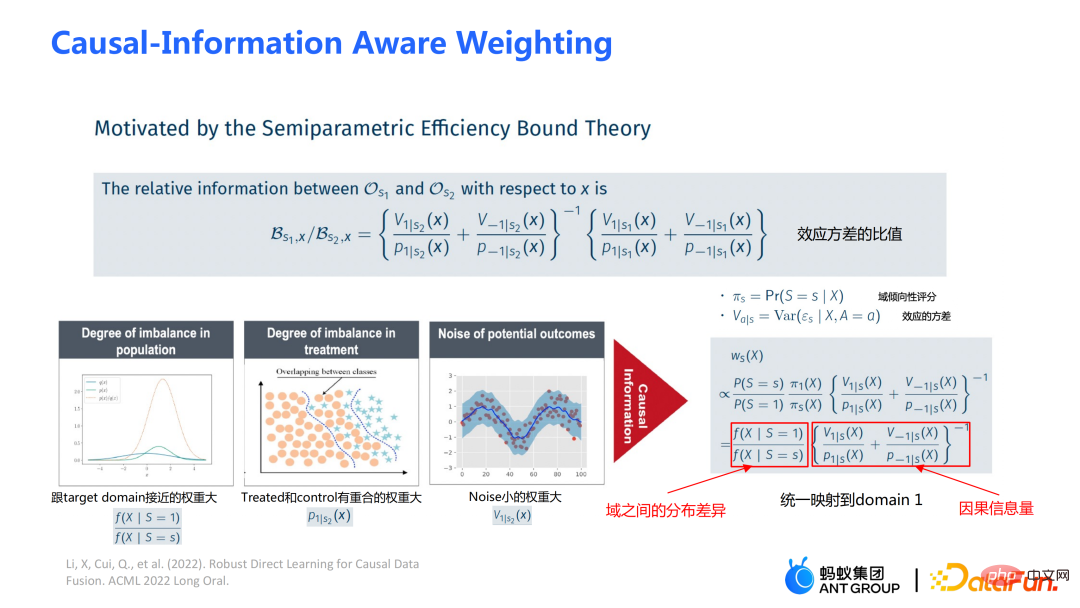

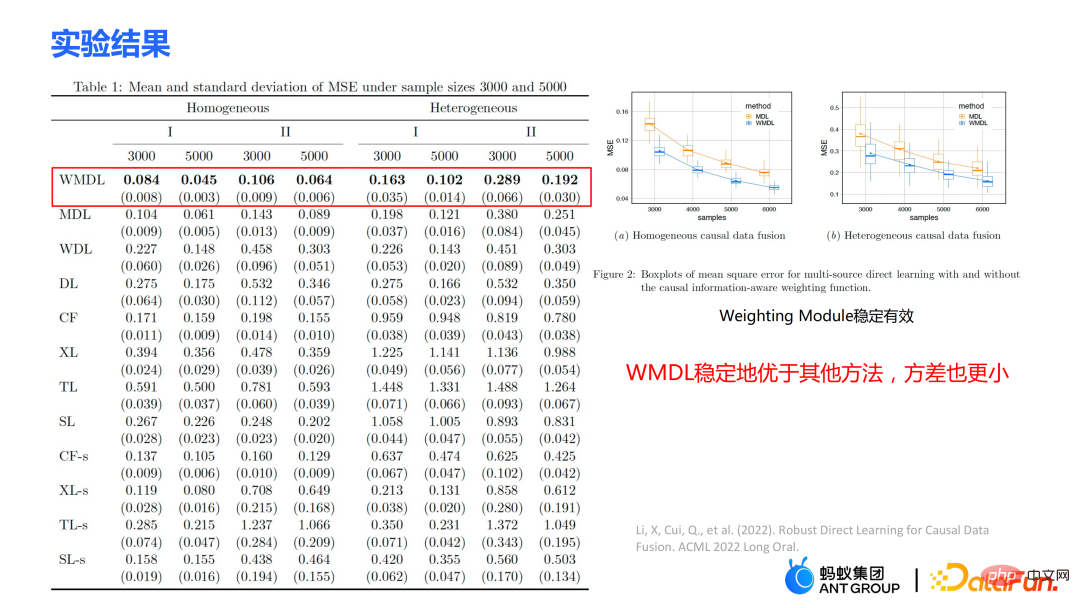

Der Baumalgorithmus besteht hauptsächlich aus zwei Modulen: Die übliche Methode zur Parameterschätzung besteht darin, das durchschnittliche Ergebnis der Kontrollgruppe direkt vom durchschnittlichen Ergebnis der Versuchsgruppe auf dem Split-Blatt-Knoten zu subtrahieren. als Schätzungen kausaler Wirkungen. Wenn es sich um ein randomisiertes kontrolliertes Experiment handelt, ist der Zuordnungsmechanismus für die Behandlung zufällig und die daraus berechnete durchschnittliche Differenz ist der kausale Effekt. Der Zufallszuteilungsmechanismus stellt sicher, dass die Datenverteilung der Versuchsgruppe und der Kontrollgruppe gleich ist, was als Homogenität bezeichnet wird. Weitere traditionelle kausale Effekte können Split geschätzt werden in zwei Teile: Selektionsbias/Confoundingbias kann definiert werden als: Die intuitive Bedeutung ist der geschätzte Wert, wenn Behandlung = 0 in der Versuchsgruppe, abzüglich des geschätzten Werts, wenn Behandlung = 0 in der Kontrollgruppe . In traditionellen Kausalbäumen ist die obige Verzerrung nicht charakterisiert, und die Auswahlverzerrung kann unsere Schätzungen beeinflussen und dazu führen, dass die endgültige Schätzung verzerrt ist. Die Integration traditioneller Baummodelle umfasst Methoden wie Bagging und Boosting. Die von Uplift Forest oder Causal Forest verwendete Integrationsmethode ist die Bagging-Methode. Die Integration von Uplift Forest ist eine direkte Summierung, während die Integration von Causal Forest die Lösung einer Verlustfunktion erfordert. Aufgrund des in GBCT entwickelten expliziten Korrekturmoduls unterstützt GBCT die Integration mithilfe der Boosting-Methode. Die Grundidee ähnelt dem Boosten: Nachdem der erste Baum korrigiert wurde, wird der zweite Baum korrigiert und der dritte Baum wird korrigiert ... Es wurden zwei Teile des Experiments durchgeführt: ① Simulationsexperiment. Testen Sie anhand von Simulationsexperimenten mit Ground Truth, ob die GBCT-Methode die erwarteten Ergebnisse erzielen kann. Die Datengenerierung für das Simulationsexperiment ist in zwei Teile unterteilt (die erste Spalte Φ in der Tabelle stellt die Auswahlverzerrung dar. Je größer der Φ-Wert, desto stärker die entsprechende Auswahlverzerrung; der Wert in der Tabelle ist MAE. Je kleiner der MAE-Wert , desto besser die Methode) : ② Echte Daten zur Erhöhung des Kreditkartenlimits. Es wurde ein randomisiertes, kontrolliertes Experiment durchgeführt und auf der Grundlage des randomisierten, kontrollierten Experiments wurden voreingenommene Daten erstellt. In verschiedenen Umgebungen übertrifft die GBCT-Methode durchweg herkömmliche Methoden, insbesondere bei verzerrten Daten, und schneidet deutlich besser ab als herkömmliche Methoden. Die zweite Aufgabe ist die kausale Datenfusion, das heißt, wenn mehrere Datenquellen vorhanden sind Situation, wie man kausale Auswirkungen besser abschätzen kann. Die Hauptsymbole: sind mehrere Datenquellen, Y ist das Ergebnis, A ist die Behandlung, X ist die interessierende Kovariate, Z sind die anderen Kovariaten jeder Datenquelle (Domäne) außer Zerlegen Sie das Ergebnis in den folgenden Ausdruck: Zielfunktion δ wird als Schätzung verwendet die kausale Wirkung auf jede Domäne. Darüber hinaus umfassen Störfunktionen Haupteffekte, Neigungswerte, Domänenneigungswerte, Varianzen von Effekten usw. Einige traditionelle Methoden, wie Meta-Learner usw., gehen alle davon aus Die Daten sind homolog, d. h. die Verteilung ist konsistent. Einige herkömmliche Datenfusionsmethoden können die Heterogenität von Populationen über Domänen hinweg bewältigen, können jedoch die Heterogenität von Interventionsergebnissen und kausalen Effekten über Domänen hinweg nicht explizit erfassen. Unsere Arbeit konzentriert sich auf den Umgang mit komplexerer domänenübergreifender Heterogenität, einschließlich domänenübergreifender Heterogenität bei Interventionsergebnissen und domänenübergreifender Heterogenität bei kausalen Effekten. Das Rahmendiagramm des WMDL-Algorithmus ist in der Abbildung oben dargestellt. Die Hauptmodule sind: Die drei Module werden kombiniert, um den endgültigen Kostenvoranschlag zu erhalten. Die drei Highlights des WMDL-Algorithmus sind: Die Formel wird auf der Grundlage der Zerlegungsformel abgeleitet. Ergebnis Y minus Haupteffekt dividiert durch Behandlung wird auf I(X) geschätzt, und die erhaltene optimale Lösung ist δ(X). Der Zähler in Diese Arbeit hat drei Vorteile: ① Durch unterschiedliche Designs kann sie nicht nur mit der Heterogenität der Interventionsergebnisse umgehen, sondern auch mit der Heterogenität der kausalen Wirkungen; von doppelter Robustheit. In der Arbeit wird der Beweis erbracht, dass die endgültige Schätzung unverzerrt sein wird, solange die Schätzung entweder des Propensity-Score-Modells der Domäne oder des Haupteffektmodells unvoreingenommen ist (die tatsächliche Situation ist etwas komplizierter, Einzelheiten finden Sie in der Arbeit). ; ③ Diese Arbeit entwirft hauptsächlich das semiparametrische Modellgerüst. Jedes Modul des Modells kann ein beliebiges Modell für maschinelles Lernen verwenden, und das gesamte Modell kann sogar in ein neuronales Netzwerk integriert werden, um ein durchgängiges Lernen zu erreichen. Das Modul der Gewichtung ist aus der Effizienzschrankentheorie der Statistik abgeleitet. Es enthält hauptsächlich zwei Informationsaspekte: ist ein Modul zur ausgewogenen Umrechnung von Verteilungsunterschieden zwischen Domänen; Durch die geschickte Kombination der oben genannten drei Teile können die Verteilungsunterschiede zwischen verschiedenen Domänen und die Leistung verschiedener Kausalinformationen in einer einheitlichen Domäne abgebildet werden. Unabhängig von homogenen Kausaleffekten oder heterogenen Kausaleffekten erzielt die WMDL-Methode (Weighted Multi-domain Direct Learning) bessere Ergebnisse. Das Bild rechts zeigt ein Ablationsexperiment am Gewichtungsmodul. Das Experiment zeigt die Wirksamkeit des Gewichtungsmoduls. Zusammenfassend lässt sich sagen, dass die WMDL-Methode durchweg eine bessere Leistung als andere Methoden erbringt und die geschätzte Varianz relativ gering ist. 4. Geschäftsanwendungen in Ant In Szenarien zur finanziellen Kreditrisikokontrolle wird erwartet, dass Interventionsmethoden wie Quotenerhöhungen und Preissenkungen erwartete Effekte wie Salden- oder Risikoänderungen erzielen. In einigen tatsächlichen Szenarien wird die GBCT-Korrekturarbeit die historische Leistung in der Zeit vor der Stirnstraffung nutzen (der Status der Versuchsgruppe und der Kontrollgruppe ohne Stirnstraffung kann ermittelt werden) und eine explizite Korrektur anhand historischer Informationen durchführen dass der Eingriff spätere Schätzungen genauer sein werden. Wenn GBCT in einen untergeordneten Knoten aufgeteilt wird, sodass die Verhaltensweisen vor dem Eingriff angeglichen werden, lässt sich der kausale Effekt nach dem Eingriff leichter abschätzen. (Erhalten nach der Korrektur) In der Abbildung ist die rote Farbe die Gruppe, die die Stirn hebt, die blaue Farbe ist die Gruppe, in der die Stirn nicht gehoben wird, und der graue Bereich in der Mitte ist der geschätzte kausale Effekt. GBCT hilft uns, bessere, intelligente Entscheidungen zu treffen und das Gleichgewicht und die Risiken von Kreditprodukten zu kontrollieren. A1: Die Hauptidee der GBCT-Korrektur besteht darin, historische Kontrollinformationen zu verwenden, um den Auswahlfehler explizit zu reduzieren. Die GBCT-Methode und die DID-Doppeldifferenzmethode weisen Ähnlichkeiten und Unterschiede auf: A2: Wenn alle Störvariablen beobachtet wurden und die Annahme der Ignorierbarkeit erfüllen, ist es bis zu einem gewissen Grad möglich, dass die Versuchsgruppe und die Kontrollgruppe durch herkömmliche Methoden getrennt werden, auch wenn der Selektionsbias nicht explizit reduziert wird Um eine Ausrichtung zu erreichen, zeigen Experimente, dass GBCT eine etwas bessere Leistung erbringt und die Ergebnisse durch explizite Korrektur stabiler sind. Gehen Sie davon aus, dass es in der Praxis einige unbeobachtete Störvariablen gibt, wie z. B. die Familiensituation und das Einkommen, bevor die Quote erhöht wird nicht beobachtet werden, aber das Finanzverhalten der Nutzer spiegelt sich in historischen Daten wider. Wir hoffen, die Auswahlverzerrung durch Methoden wie Verwirrungsentropie anhand historischer Leistungsinformationen explizit zu reduzieren, sodass beim Teilen des Baums die Heterogenität zwischen verwirrenden Variablen in den geteilten untergeordneten Knoten charakterisiert werden kann. Unter den untergeordneten Knoten liegen die unbeobachteten Störvariablen relativ nahe beieinander, sodass sie eine größere Wahrscheinlichkeit haben, sodass die geschätzten kausalen Effekte relativ genauer sind. A3: Ich habe einen Vergleich gemacht. Double Machine Learning ist eine semiparametrische Methode. Unsere Arbeit in diesem Artikel konzentriert sich mehr auf baumbasierte Methoden, sodass die ausgewählten Basislerner baum- oder waldbezogene Methoden sind. DML-RF in der Tabelle ist die Double Machine Learning-Version von Random Forest. Im Vergleich zu DML berücksichtigt GBCT hauptsächlich die Verwendung historischer Vergleichsdaten. Bei der Vergleichsmethode wird das historische Ergebnis direkt als Kovariate verarbeitet, diese Verarbeitungsmethode nutzt die Informationen jedoch offensichtlich nicht optimal aus. A4: Dieses Problem ist ein sehr wesentliches Problem in der Finanzszene. Bei der Suchmaschinenwerbung kann der Unterschied zwischen Offline und Online teilweise durch Online-Lernen oder A/B-Tests überwunden werden. In Finanzszenarien ist es aufgrund des politischen Einflusses nicht einfach, Experimente online durchzuführen. Außerdem dauert die Beobachtung der Leistung von Kreditprodukten mindestens einen Monat. Daher ist es tatsächlich sehr schwierig, dieses Problem perfekt zu lösen. Wir verwenden im Allgemeinen die folgende Methode: Verwenden Sie Testdaten verschiedener Zeiträume (OOT) zur Überprüfung während der Offline-Bewertung und beobachten Sie die Robustheit ihrer Leistung. Wenn die Testleistung relativ stabil ist, gibt es relativ mehr Grund zu der Annahme, dass die Online-Leistung auch gut ist.

2. Korrigierender Ursache-Wirkungs-Baum GBCT

1. Traditionell Der Kausalbaum

Die intuitive Bedeutung ist: im Experimentellen Verwenden Sie in der Kontrollgruppe das Modell der Kontrollgruppe zur Schätzung; in der Kontrollgruppe verwenden Sie das Modell der experimentellen Gruppe zur Schätzung, sodass die Verteilungen der experimentellen Gruppe möglichst nahe beieinander liegen Gruppe und Kontrollgruppe sind möglichst konsistent. Die Nutzung der Verwirrungsentropie ist einer der Hauptbeiträge unserer Arbeit.

② Parameterschätzung

3. Kausale Datenfusion

Der linke Teil geht davon aus, dass die kausalen Effekte zwischen mehreren Domänen gleich sind , aber seine Ergebnisse können heterogen sein; der rechte Teil geht davon aus, dass die kausalen Wirkungen zwischen den einzelnen Domänen unterschiedlich sind, das heißt, zwischen verschiedenen Domänen sind auch ihre kausalen Wirkungen unterschiedlich, selbst wenn ihre Kovariaten gleich sind.

ist das kausale informationsbewusste Gewichtungsmodul, das später erwähnt wird. Es stellt einen wesentlichen Beitrag unserer Arbeit dar. Der Nenner ähnelt dem Neigungswert in der doppelt robusten Methode, wird aber auch in diesem Arbeitsbereich berücksichtigt Information. Wenn die kausalen Effekte zwischen verschiedenen Domänen unterschiedlich sind, werden auch die Indikatorinformationen der Domäne berücksichtigt.

ist das kausale informationsbewusste Gewichtungsmodul, das später erwähnt wird. Es stellt einen wesentlichen Beitrag unserer Arbeit dar. Der Nenner ähnelt dem Neigungswert in der doppelt robusten Methode, wird aber auch in diesem Arbeitsbereich berücksichtigt Information. Wenn die kausalen Effekte zwischen verschiedenen Domänen unterschiedlich sind, werden auch die Indikatorinformationen der Domäne berücksichtigt.  ①

①  ist ein kausales Informationsmodul. Die drei Bilder auf der linken Seite können zum Verständnis dienen: Wenn der Verteilungsunterschied zwischen der Quelldomäne und der Zieldomäne groß ist, werden Proben bevorzugt, die näher an der Zieldomäne liegen ② Durch das Design der Neigungsbewertungsfunktion auf dem Nenner wird den überlappenden Stichproben in der Versuchsgruppe und der Kontrollgruppe ein größeres Gewicht gegeben.

ist ein kausales Informationsmodul. Die drei Bilder auf der linken Seite können zum Verständnis dienen: Wenn der Verteilungsunterschied zwischen der Quelldomäne und der Zieldomäne groß ist, werden Proben bevorzugt, die näher an der Zieldomäne liegen ② Durch das Design der Neigungsbewertungsfunktion auf dem Nenner wird den überlappenden Stichproben in der Versuchsgruppe und der Kontrollgruppe ein größeres Gewicht gegeben.  ③ Durch V wird das Rauschen in den Daten charakterisiert. Da das Rauschen im Nenner liegt, erhalten Proben mit weniger Rauschen größere Gewichte.

③ Durch V wird das Rauschen in den Daten charakterisiert. Da das Rauschen im Nenner liegt, erhalten Proben mit weniger Rauschen größere Gewichte.

5. Frage- und Antwortsitzung

F1: Was sind die Gemeinsamkeiten und Unterschiede zwischen der GBCT-Korrektur und der Doppeldifferenzmethode (DID)?

F2: GBCT schneidet bei unbeobachteten Störvariablen besser ab. Gibt es eine intuitivere Erklärung?

F3: Haben Sie GBCT mit Double Machine Learning (DML) verglichen?

F4: Ein ähnliches Problem, das im Geschäftsleben auftreten kann, besteht darin, dass es offline zu Auswahlverzerrungen kommen kann. Allerdings kann sich die Online-Voreingenommenheit etwas von der Offline-Voreingenommenheit unterscheiden. Wenn die Effektbewertung offline durchgeführt wird, gibt es derzeit möglicherweise keine Möglichkeit, den Offline-Effekt sehr genau abzuschätzen.

Das obige ist der detaillierte Inhalt vonWie können Daten für kausale Schlussfolgerungen besser genutzt werden?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr