Heim >Technologie-Peripheriegeräte >KI >Verwenden Sie 2D-Bilder, um einen 3D-menschlichen Körper zu erstellen. Sie können jede Kleidung tragen und Ihre Bewegungen ändern.

Verwenden Sie 2D-Bilder, um einen 3D-menschlichen Körper zu erstellen. Sie können jede Kleidung tragen und Ihre Bewegungen ändern.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-11 14:31:041488Durchsuche

Dank des differenzierbaren Renderings von NeRF haben aktuelle generative 3D-Modelle beeindruckende Ergebnisse auf stationären Objekten erzielt. Allerdings stellt die 3D-Generierung in einer komplexeren und verformbareren Kategorie wie dem menschlichen Körper immer noch große Herausforderungen dar. In diesem Artikel wird eine effiziente kombinierte NeRF-Darstellung des menschlichen Körpers vorgeschlagen, die eine hochauflösende (512 x 256) 3D-Generierung des menschlichen Körpers ohne den Einsatz hochauflösender Modelle ermöglicht. EVA3D hat bestehende Lösungen bei vier umfangreichen Datensätzen zum menschlichen Körper deutlich übertroffen, und der Code ist Open Source.

- Papiername: EVA3D: Compositional 3D Human Generation from 2D image Collections

- Papieradresse: https://arxiv.org/abs/2210.04888

- Projekt Homepage: https: //hongfz16.github.io/projects/EVA3D.html

- Code Open Source: https://github.com/hongfz16/EVA3D

- Colab-Demo: https://colab.research.google.com / github/hongfz16/EVA3D/blob/main/notebook/EVA3D_Demo.ipynb

- Hugging Face Demo: https://huggingface.co/spaces/hongfz16/EVA3D

Hintergrund

Mit dem von NeRF bereitgestellten differenzierbaren Rendering-Algorithmus haben dreidimensionale Generierungsalgorithmen wie EG3D und StyleSDF sehr gute Ergebnisse bei der Generierung statischer Objektkategorien erzielt. Im Vergleich zu Kategorien wie Gesichtern oder CAD-Modellen ist der menschliche Körper jedoch in Aussehen und Geometrie komplexer und verformbar. Daher ist es immer noch eine sehr schwierige Aufgabe, zu lernen, 3D-Menschenkörper aus 2D-Bildern zu generieren. Forscher haben einige Versuche zu dieser Aufgabe unternommen, beispielsweise ENARF-GAN und GNARF, aber aufgrund der ineffizienten menschlichen Ausdrucksweise können sie keine hochauflösende Erzeugung erreichen, sodass auch die Erzeugungsqualität sehr niedrig ist.

Um dieses Problem zu lösen, schlägt dieses Papier eine effiziente kombinierte 3D-NeRF-Darstellung des menschlichen Körpers vor, um ein hochauflösendes (512x256) 3D-GAN-Training und -Generierung des menschlichen Körpers zu erreichen. Die in diesem Artikel vorgeschlagene menschliche NeRF-Darstellung und das dreidimensionale menschliche GAN-Trainingsgerüst werden im Folgenden vorgestellt.

Effiziente NeRF-Darstellung des menschlichen Körpers

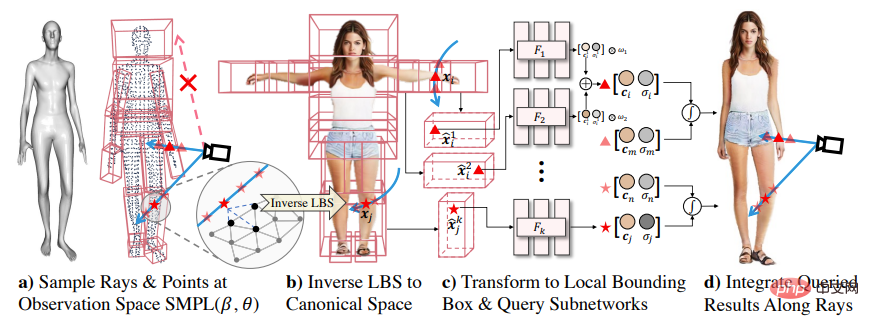

Das in diesem Artikel vorgeschlagene NeRF des menschlichen Körpers basiert auf dem parametrischen Modell des menschlichen Körpers SMPL, das eine bequeme Steuerung der Haltung und Form des menschlichen Körpers ermöglicht. Bei der NeRF-Modellierung wird in diesem Artikel der menschliche Körper in 16 Teile unterteilt, wie in der folgenden Abbildung dargestellt. Jeder Teil entspricht einem kleinen NeRF-Netzwerk zur lokalen Modellierung. Beim Rendern jedes Teils muss in diesem Artikel nur über den lokalen NeRF nachgedacht werden. Mit dieser Sparse-Rendering-Methode kann auch ein natives hochauflösendes Rendering mit geringeren Rechenressourcen erreicht werden.

Beim Rendern eines menschlichen Körpers, dessen Körperform und Aktionsparameter jeweils sind, wird das Licht zunächst gemäß den Kameraparametern abgetastet und einem inversen linearen Misch-Skinning-Vorgang (invers linear) unterzogen Blend Skinning) basiert auf der relativen Beziehung zum SMPL-Modell und stellt die Abtastpunkte im Raum in den kanonischen Raum um. Anschließend wird berechnet, dass die Abtastpunkte im kanonischen Raum zum Begrenzungsrahmen eines oder mehrerer lokaler NeRFs gehören, und dann wird das NeRF-Modell abgeleitet, um die jedem Abtastpunkt entsprechende Farbe und Dichte zu erhalten Mehrere lokale NeRFs werden im überlappenden Bereich abgeleitet, mehrere Ergebnisse werden mithilfe der Fensterfunktion interpoliert und schließlich werden diese Informationen für die Lichtintegration verwendet, um das endgültige Rendering zu erhalten.

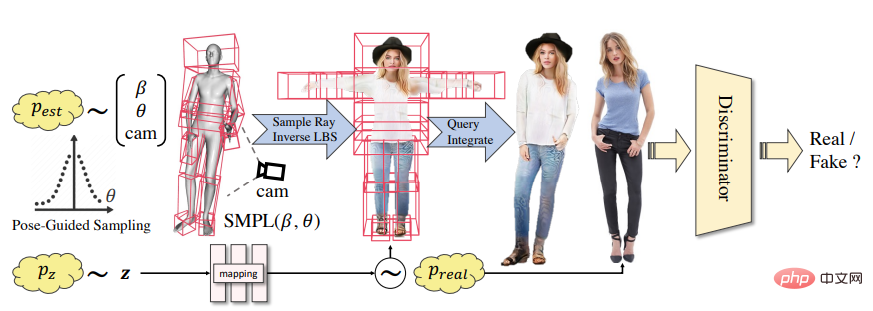

Dreidimensionales menschliches GAN-Framework

Basierend auf der vorgeschlagenen effizienten menschlichen NeRF-Expression implementiert dieser Artikel ein dreidimensionales menschliches GAN-Trainingsframework. In jeder Trainingsiteration werden in diesem Artikel zunächst ein SMPL-Parameter und Kameraparameter aus dem Datensatz abgetastet und zufällig ein Gaußsches Rauschen z generiert. Unter Verwendung des in diesem Artikel vorgeschlagenen NeRF des menschlichen Körpers kann dieser Artikel die abgetasteten Parameter in ein zweidimensionales Bild des menschlichen Körpers als gefälschte Probe umwandeln. In diesem Artikel wird unter Verwendung realer Stichproben im Datensatz ein gegnerisches Training von GAN durchgeführt.

Extrem unausgeglichener Datensatz

2D Mensch Körperdatensätze wie DeepFashion werden normalerweise für 2D-Sehaufgaben erstellt, sodass die Posenvielfalt des menschlichen Körpers sehr begrenzt ist. Um den Grad des Ungleichgewichts zu quantifizieren, zählt dieser Artikel die Häufigkeit der Gesichtsausrichtungen von Models in DeepFashion. Wie in der folgenden Abbildung dargestellt, stellt die orangefarbene Linie die Verteilung der Gesichtsausrichtungen in DeepFashion dar. Es ist ersichtlich, dass sie äußerst unausgewogen ist, was das Erlernen der dreidimensionalen Darstellung des menschlichen Körpers erschwert. Um dieses Problem zu lindern, schlagen wir eine Stichprobenmethode vor, die sich an der menschlichen Körperhaltung orientiert, um die Verteilungskurve abzuflachen, wie durch die anderen farbigen Linien in der Abbildung unten dargestellt. Dadurch kann das Modell während des Trainings vielfältigere und größere Winkelbilder des menschlichen Körpers sehen und so beim Erlernen der dreidimensionalen menschlichen Geometrie helfen. Wir haben eine experimentelle Analyse der Sampling-Parameter durchgeführt. Wie aus der folgenden Tabelle hervorgeht, wird die erlernte dreidimensionale Geometrie (Tiefe) nach dem Hinzufügen der Sampling-Methode zur Führung der menschlichen Körperhaltung zwar leicht reduziert deutlich verbessert.

Hochwertige Generierungsergebnisse

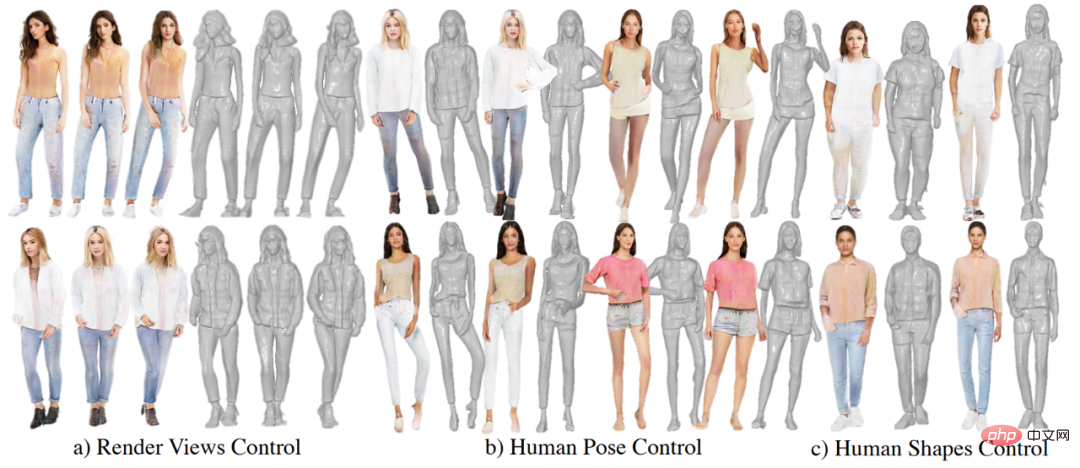

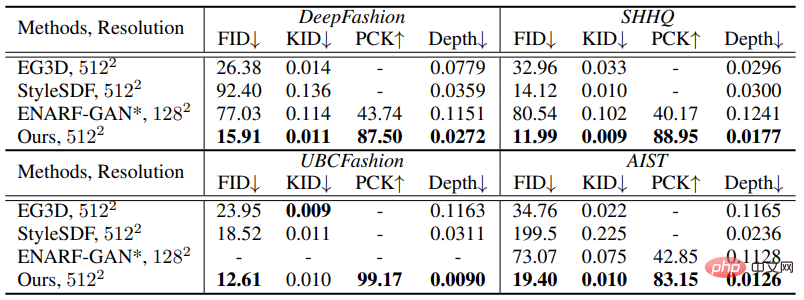

Die folgende Abbildung zeigt einige Ergebnisse der EVA3D-Generierung, die das Erscheinungsbild des menschlichen Körpers zufällig erfassen und steuern können. Rendern Sie Kameraparameter, menschliche Pose und Körperform. In diesem Artikel werden Experimente mit vier großen menschlichen Datensätzen durchgeführt: DeepFashion, SHHQ, UBCFashion und AIST. Diese Studie vergleicht den hochmodernen statischen 3D-Objektgenerierungsalgorithmus EG3D mit StyleSDF. Gleichzeitig verglichen die Forscher auch den Algorithmus ENARF-GAN speziell für die menschliche 3D-Generierung. Bei der Auswahl der Indikatoren berücksichtigt dieser Artikel die Bewertung der Rendering-Qualität (FID/KID), der Genauigkeit der menschlichen Körperkontrolle (PCK) und der Qualität der Geometriegenerierung (Depth). Wie in der folgenden Abbildung dargestellt, übertrifft dieser Artikel bisherige Lösungen in allen Datensätzen und allen Indikatoren deutlich.

Anwendungspotenzial

Endlich dieser Artikel Außerdem werden einige Anwendungspotenziale von EVA3D aufgezeigt. Zunächst testete die Studie die Differenzierung im latenten Raum. Wie in der folgenden Abbildung gezeigt, ist dieser Artikel in der Lage, reibungslose Änderungen zwischen zwei dreidimensionalen Personen vorzunehmen, und die Zwischenergebnisse behalten eine hohe Qualität bei. Darüber hinaus führte dieser Artikel auch Experimente zur GAN-Inversion durch. Die Forscher verwendeten Pivotal Tuning Inversion, einen Algorithmus, der häufig bei der zweidimensionalen GAN-Inversion verwendet wird. Wie in der rechten Abbildung unten gezeigt, kann mit dieser Methode das Erscheinungsbild des rekonstruierten Ziels besser wiederhergestellt werden, im geometrischen Teil gehen jedoch viele Details verloren. Es ist ersichtlich, dass die Umkehrung des dreidimensionalen GAN immer noch eine sehr anspruchsvolle Aufgabe ist.

Fazit

Dieser Artikel schlägt den ersten vor Der hochauflösende dreidimensionale NeRF-Generierungsalgorithmus EVA3D für den menschlichen Körper kann nur mit zweidimensionalen Bilddaten des menschlichen Körpers trainiert werden. EVA3D erreicht Spitzenleistungen bei mehreren großen menschlichen Datensätzen und zeigt Potenzial für die Anwendung bei nachgelagerten Aufgaben. Die Trainings- und Testcodes von EVA3D sind Open Source und jeder ist herzlich willkommen, es auszuprobieren!Das obige ist der detaillierte Inhalt vonVerwenden Sie 2D-Bilder, um einen 3D-menschlichen Körper zu erstellen. Sie können jede Kleidung tragen und Ihre Bewegungen ändern.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr