Heim >Technologie-Peripheriegeräte >KI >Die leistungsstarke Kombination aus Diffusions- und Superauflösungsmodellen, der Technologie hinter Googles Bildgenerator Imagen

Die leistungsstarke Kombination aus Diffusions- und Superauflösungsmodellen, der Technologie hinter Googles Bildgenerator Imagen

- 王林nach vorne

- 2023-04-10 10:21:081663Durchsuche

In den letzten Jahren hat multimodales Lernen Beachtung gefunden, insbesondere in den beiden Richtungen der Text-Bild-Synthese und des kontrastiven Bild-Text-Lernens. Einige KI-Modelle haben aufgrund ihrer Anwendung bei der kreativen Bilderzeugung und -bearbeitung große öffentliche Aufmerksamkeit erregt, wie beispielsweise die von OpenAI eingeführten Textbildmodelle DALL・E und DALL-E 2 sowie GauGAN und GauGAN2 von NVIDIA.

Um nicht zu übertreffen, hat Google Ende Mai sein eigenes Text-zu-Bild-Modell Imagen veröffentlicht, das die Grenzen der untertitelbedingten Bildgenerierung offenbar noch weiter erweitert.

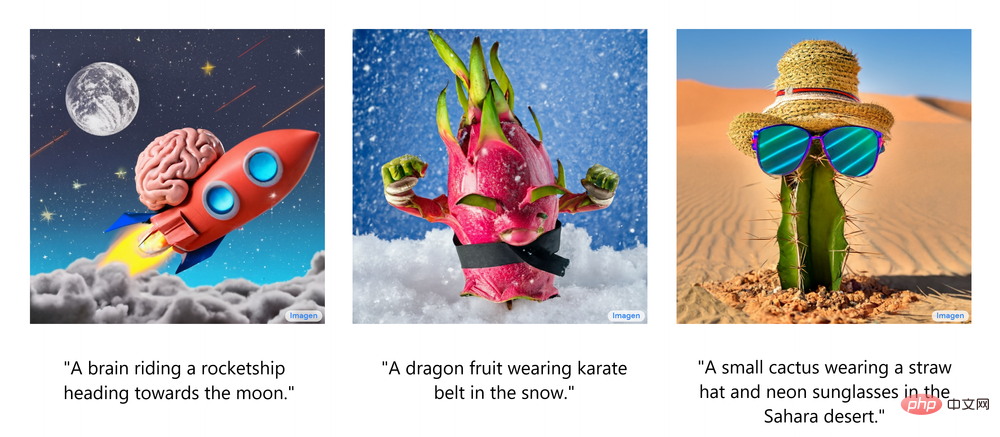

Mit nur einer Beschreibung einer Szene generiert Imagen qualitativ hochwertige Bilder mit hoher Auflösung, unabhängig davon, ob die Szene in der realen Welt Sinn ergibt. Die folgende Abbildung zeigt mehrere Beispiele von Imagen-textgenerierten Bildern mit entsprechenden Untertiteln, die unter dem Bild angezeigt werden.

Diese beeindruckenden generierten Bilder machen Lust auf mehr: Wie funktioniert Imagen?

Kürzlich hat der Entwicklerlehrer Ryan O'Connor im AssemblyAI-Blog einen langen Artikel mit dem Titel „Wie Imagen tatsächlich funktioniert“ geschrieben, in dem er das Funktionsprinzip von Imagen ausführlich erläutert, einen Überblick über Imagen gibt und seine erweiterten Komponenten und ihre Verbindung analysiert und versteht zwischen.

Überblick über das Arbeitsprinzip von Imagen

In diesem Teil zeigt der Autor die Gesamtarchitektur von Imagen, gibt eine allgemeine Erklärung anderer Arbeitsprinzipien und analysiert dann nacheinander jede Komponente von Imagen gründlicher. Die folgende Animation zeigt den Workflow von Imagen.

Zuerst geben Sie die Untertitel in den Text-Encoder ein. Dieser Encoder wandelt Textuntertitel in numerische Darstellungen um, die semantische Informationen im Text einkapseln. Der Text-Encoder in Imagen ist ein Transformer-Encoder, der mithilfe von Selbstaufmerksamkeitsmethoden sicherstellt, dass die Textkodierung versteht, wie die Wörter in den Untertiteln zueinander in Beziehung stehen.

Wenn sich Imagen nur auf einzelne Wörter und nicht auf die Assoziationen zwischen ihnen konzentriert, können zwar qualitativ hochwertige Bilder erhalten werden, die einzelne Elemente von Untertiteln erfassen können, die Beschreibung dieser Bilder kann jedoch die Semantik der Untertitel nicht angemessen widerspiegeln. Wie im Beispiel unten gezeigt, tritt ein völlig anderer Generierungseffekt auf, wenn die Assoziation zwischen Wörtern nicht berücksichtigt wird.

Während der Textencoder eine nützliche Darstellung für die Untertiteleingabe von Imagen generiert, muss noch eine Methode entwickelt werden, um Bilder mithilfe dieser Darstellung zu generieren, nämlich einen Bildgenerator. Zu diesem Zweck verwendet Imagen das Diffusionsmodell, ein generatives Modell, das in den letzten Jahren dank seiner SOTA-Leistung bei mehreren Aufgaben an Popularität gewonnen hat.

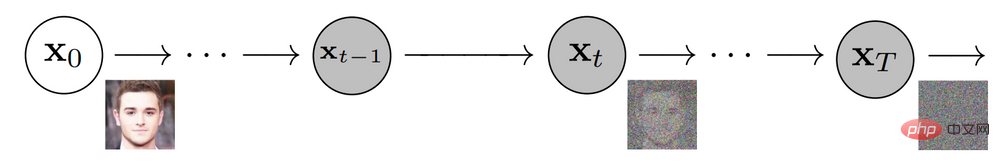

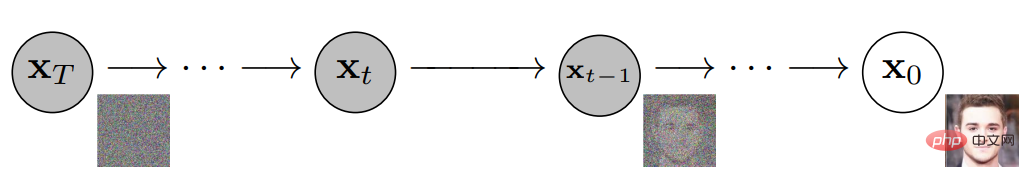

Das Diffusionsmodell zerstört die Trainingsdaten, indem es Rauschen hinzufügt, um das Training zu erreichen, und lernt dann, die Daten wiederherzustellen, indem es diesen Rauschprozess umkehrt. Bei einem gegebenen Eingabebild verfälscht das Diffusionsmodell das Bild über eine Reihe von Zeitschritten iterativ durch Gaußsches Rauschen, sodass schließlich Gaußsches Rauschen oder TV-Rauschen zurückbleibt. Die folgende Abbildung zeigt den iterativen Rauschprozess des Diffusionsmodells:

Anschließend arbeitet das Diffusionsmodell rückwärts und lernt, wie Rauschen bei jedem Zeitschritt isoliert und eliminiert wird, um dem gerade aufgetretenen Zerstörungsprozess entgegenzuwirken. Nach Abschluss des Trainings kann das Modell in zwei Teile geteilt werden. Dies ermöglicht es Ihnen, mit zufällig abgetastetem Gaußschen Rauschen zu beginnen und mithilfe eines Diffusionsmodells schrittweise das Rauschen zu entrauschen, um ein Bild zu erzeugen, wie unten gezeigt:

Zusammenfassend lässt sich sagen, dass das trainierte Diffusionsmodell mit Gaußschem Rauschen beginnt und dann iterativ Bilder generiert, die den Trainingsbildern ähneln. Es ist offensichtlich, dass es keine Möglichkeit gibt, die tatsächliche Ausgabe des Bildes zu steuern. Geben Sie einfach Gaußsches Rauschen in das Modell ein und es wird ein zufälliges Bild ausgegeben, das aussieht, als ob es in den Trainingsdatensatz gehört.

Das Ziel besteht jedoch darin, Bilder zu erstellen, die die semantischen Informationen der in Imagen eingegebenen Untertitel kapseln können. Daher ist eine Möglichkeit erforderlich, die Untertitel in den Verbreitungsprozess einzubeziehen . Wie geht das?

Wie oben erwähnt, erzeugt der Textencoder eine repräsentative Untertitelkodierung, bei der es sich eigentlich um eine Folge von Vektoren handelt. Um diese codierten Informationen in das Diffusionsmodell einzuspeisen, werden diese Vektoren aggregiert und das Diffusionsmodell auf ihrer Grundlage angepasst. Durch Anpassen dieses Vektors lernt das Diffusionsmodell, wie es seinen Entrauschungsprozess anpassen kann, um Bilder zu erzeugen, die gut zu den Untertiteln passen. Das Prozessvisualisierungsdiagramm sieht wie folgt aus:

Da der Bildgenerator oder das Basismodell ein kleines 64x64-Bild ausgibt, um dieses Modell auf das Endergebnis hochzurechnen Die 1024x1024-Version

Da der Bildgenerator oder das Basismodell ein kleines 64x64-Bild ausgibt, um dieses Modell auf das Endergebnis hochzurechnen Die 1024x1024-Version

. Für das Superauflösungsmodell verwendete Imagen erneut das Diffusionsmodell. Der Gesamtprozess ist im Grunde derselbe wie beim Basismodell, mit der Ausnahme, dass er ausschließlich auf Basis der Untertitelkodierung angepasst wird, aber auch kleinere Bilder hochgesampelt werden. Die Visualisierung des gesamten Prozesses ist wie folgt:

. Um dieses Bild auf die endgültige Auflösung von 1024 x 1024 hochzuskalieren, wird ein anderes Superauflösungsmodell verwendet. Die beiden Super-Resolution-Architekturen sind in etwa gleich und werden daher nicht noch einmal beschrieben. Die Ausgabe des zweiten Superauflösungsmodells ist die endgültige Ausgabe von Imagen. Warum ist Imagen besser als DALL-E 2?

Genau zu beantworten, warum der Imagen besser ist als der DALL-E 2, ist schwierig. Ein erheblicher Teil des Leistungsunterschieds ist jedoch auf Unterschiede bei Untertiteln und Hinweisen zurückzuführen. DALL-E 2 verwendet kontrastierende Ziele, um zu bestimmen, wie eng Textkodierungen mit Bildern zusammenhängen (im Wesentlichen CLIP). Die Text- und Bildkodierer passen ihre Parameter so an, dass die Kosinusähnlichkeit ähnlicher Untertitel-Bild-Paare maximiert wird, während die Kosinus-Ähnlichkeit unterschiedlicher Untertitel-Bild-Paare minimiert wird.

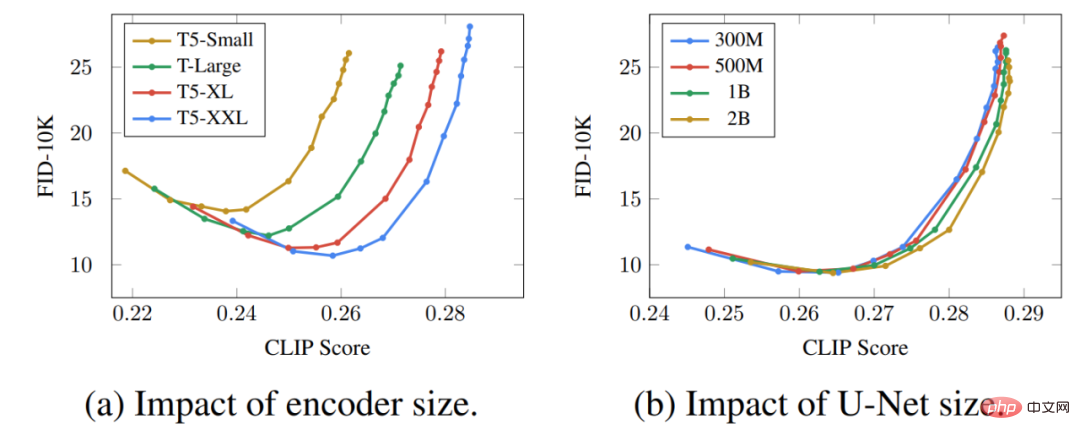

Ein erheblicher Teil der Leistungslücke ist auf die Tatsache zurückzuführen, dass der Text-Encoder von Imagen viel größer ist als der Text-Encoder von DALL-E 2 und auf mehr Daten trainiert wurde. Als Beweis für diese Hypothese können wir die Leistung von Imagen bei der Skalierung des Text-Encoders untersuchen. Das Folgende ist die Pareto-Kurve der Imagen-Leistung:

Der Effekt der Verstärkung des Text-Encoders ist überraschend hoch, während der Effekt der Verstärkung von U-Net überraschend hoch ist extrem niedrig, erstaunlich. Dieses Ergebnis zeigt, dass relativ einfache Diffusionsmodelle qualitativ hochwertige Ergebnisse liefern können, solange sie von einer starken Kodierung abhängig sind.

Der Effekt der Verstärkung des Text-Encoders ist überraschend hoch, während der Effekt der Verstärkung von U-Net überraschend hoch ist extrem niedrig, erstaunlich. Dieses Ergebnis zeigt, dass relativ einfache Diffusionsmodelle qualitativ hochwertige Ergebnisse liefern können, solange sie von einer starken Kodierung abhängig sind.

Angesichts der Tatsache, dass der T5-Text-Encoder viel größer ist als der CLIP-Text-Encoder, gepaart mit der Tatsache, dass Trainingsdaten in natürlicher Sprache zwangsläufig umfangreicher sind als Bild-Untertitel-Paare, ist ein Großteil der Leistungslücke wahrscheinlich darauf zurückzuführen so ein Unterschied.

Darüber hinaus listete der Autor auch einige wichtige Punkte von Imagen auf, darunter die folgenden:

- Das Erweitern des Text-Encoders ist sehr effektiv;

- Das Erweitern des Text-Encoders ist wichtiger als das Erweitern der U-Net-Größe; entscheidend Wichtig;

- Die Verbesserung des Rauschzustands ist in hochauflösenden Modellen von entscheidender Bedeutung U-Net ist entscheidend.

- Diese Erkenntnisse liefern wertvolle Hinweise für Forscher, die an Diffusionsmodellen arbeiten, die nicht nur im Text-zu-Bild-Teilbereich nützlich sind.

Das obige ist der detaillierte Inhalt vonDie leistungsstarke Kombination aus Diffusions- und Superauflösungsmodellen, der Technologie hinter Googles Bildgenerator Imagen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr