Heim >Technologie-Peripheriegeräte >KI >Das IDEA Fengshen List-Team hat das unmögliche Dreieck durchbrochen und mit 540 Milliarden Modellen konkurriert und nur mit 200 Millionen Modellen Zero-Sample-Learning-SOTA erreicht

Das IDEA Fengshen List-Team hat das unmögliche Dreieck durchbrochen und mit 540 Milliarden Modellen konkurriert und nur mit 200 Millionen Modellen Zero-Sample-Learning-SOTA erreicht

- 王林nach vorne

- 2023-04-09 13:31:061160Durchsuche

Seit der Einführung von GPT-3, das die Leistungsfähigkeit von Hunderten Milliarden Modellen demonstrierte, stehen NLP-Aufgaben vor dem unmöglichen Dreieck aus Maßstab, Beispielen und Feinabstimmungsleistung. Wie kann ein Sprachmodell mit weniger als 1 Milliarde Parametern die Few-Shot- (oder sogar Zero-Shot-) und Fine-Tuning-Leistung von SOTA erreichen? Müssen wir Hunderte Milliarden Parameter haben und instabile Eingabeaufforderungen ertragen, um das Zero-Shot-Szenario zu lösen? In diesem Artikel stellt das Team des IDEA Research Institute Fengshenbang einen neuen „phänomenologischen“ UniMC vor, der mit nur 200 Millionen Parametern Zero-Shot-SOTA erreichen kann. Verwandte Arbeiten wurden von EMNLP 2022 angenommen.

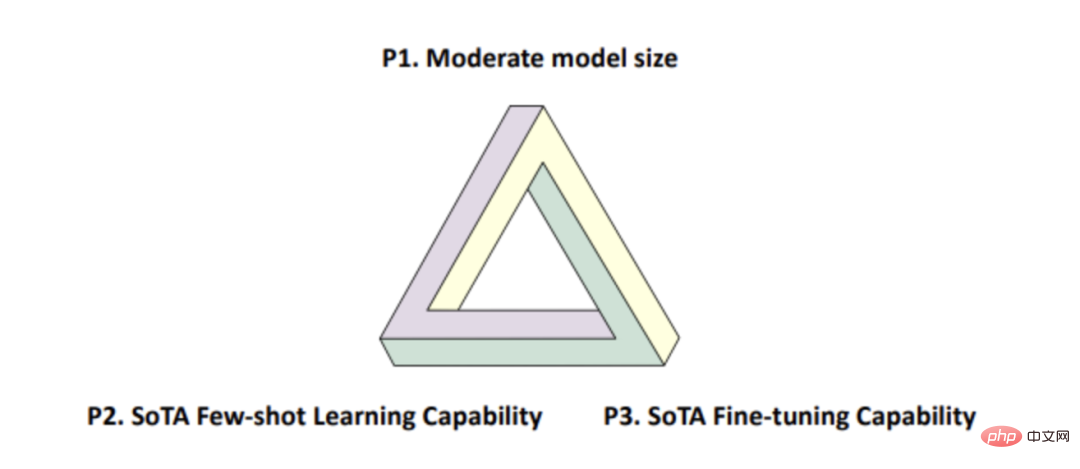

hat dieses Jahr in einem Artikel [1] darauf hingewiesen, dass es seit dem Vorschlag der Pre-Training-Technologie ein unmögliches Dreieck in der NLP-Welt gibt (wie in Abbildung 1 unten dargestellt), das heißt, ein Modell kann nicht gleichzeitig Folgendes erfüllen:

- Mittlere Modellgröße (weniger als 1 Milliarde);

- SOTAs Few-Shot-Leistung (oder sogar Zero-Shot-Leistung);

- SOTAs Fine-Tuning-Leistung.

Abbildung 1

Der Grund, warum das unmögliche Dreieck existiert, liegt darin, dass die Anzahl der Parameter des aktuellen vorab trainierten Modells nur eine bestimmte Größenordnung erreicht und das Lernen mithilfe von Hinweisen widerspiegeln kann die kraftvolle Wenig/Null-Schuss-Leistung.

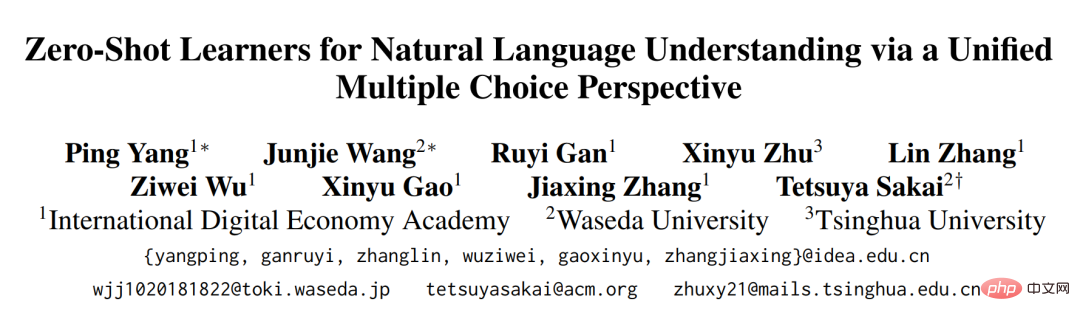

Das kürzlich von unserem Fengshenbang-Team veröffentlichte und in EMNLP 2022 aufgenommene Papier: „Zero-Shot Learners for Natural Language Understanding via a Unified Multiple Choice Perspective“ bricht diesen „Fluch“ und bietet eine flexible und effiziente Lösung. Der in unserem -Artikel vorgeschlagene UniMC verfügt über eine sehr geringe Anzahl von Modellparametern (nur 100 Millionen Stufen) und die Feinabstimmungsfähigkeiten von SOTA. Er verfügt auch über die Few/Zero-Leistung von SOTA (vergleichbar mit der 540-Milliarden-PaLM-Leistung). .

- Papieradresse: https://arxiv.org/abs/2210.08590

- Modell-Open-Source-Adresse: https://github.com/IDEA-CCNL/Fengshenbang - LM/tree/main/fengshen/examples/unimc/ Technischer Hintergrund

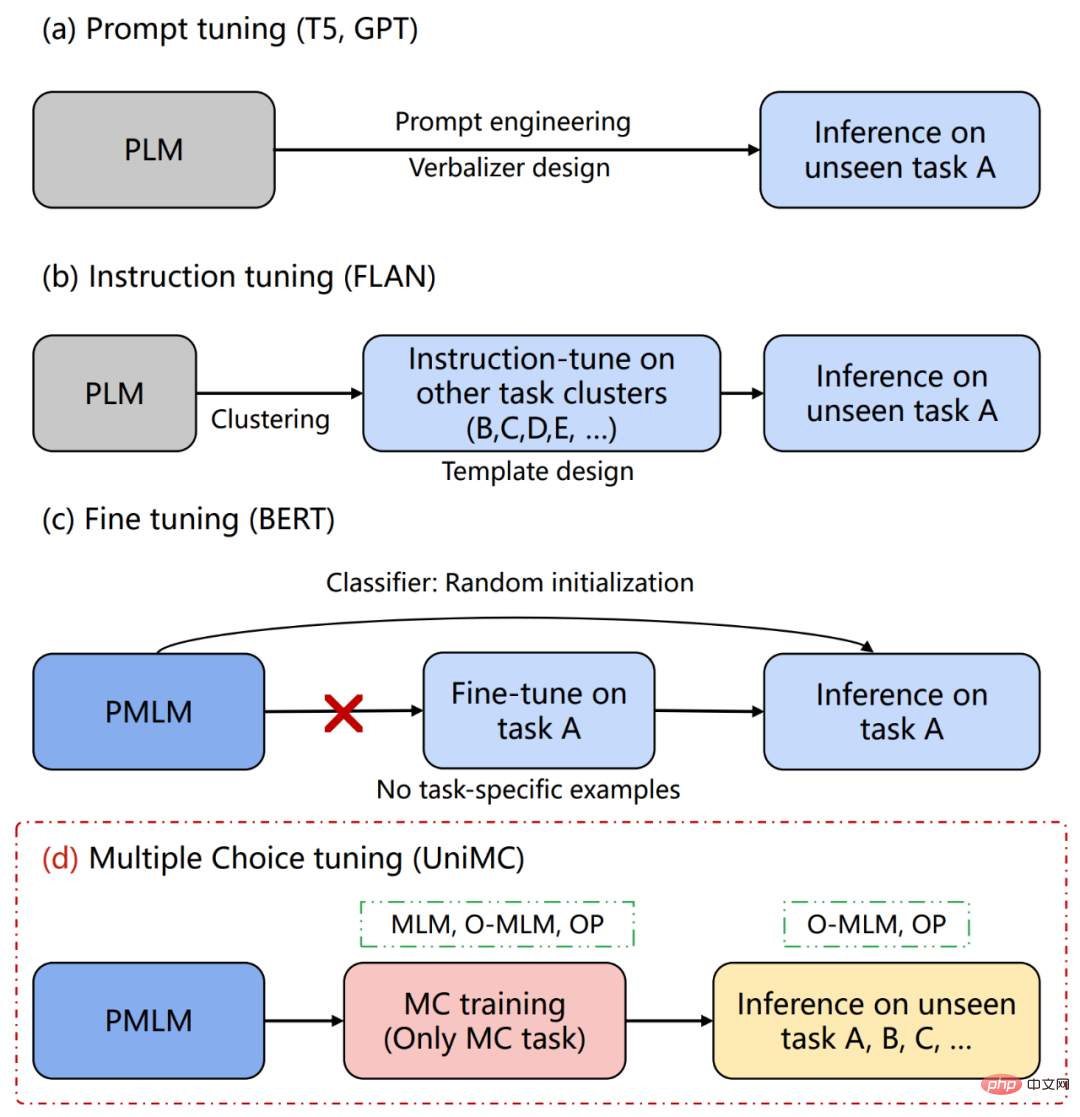

Der Grund dafür ist, dass wir bei der Verwendung von PMLM für bestimmte Aufgaben eine MLP-Schicht darüber hinzufügen müssen, wie in Abbildung 2(c) dargestellt. Darüber hinaus fügt diese MLP-Schicht zusätzliche Parameter hinzu, was dazu führt, dass diese Methode bei Zero-Shot-Szenarien nur eine zufällige Initialisierung wählt und es keine Möglichkeit gibt, eine vernünftige Ausgabe zu erhalten. Darüber hinaus macht das Hinzufügen einer MLP-Schicht im Feinabstimmungsszenario auch die Übertragung zwischen verschiedenen Aufgaben unmöglich (z. B. ist die Übertragung zwischen 2-Klassifizierungs- und 3-Klassifizierungsaufgaben unmöglich).

Für Zero-Shot-Szenarien besteht der gängige Ansatz in den letzten Jahren darin, Dutzende oder sogar Hunderte Milliarden vorab trainierter Sprachmodelle (PLM) zu verwenden, um NLU-Aufgaben einheitlich in Textgenerierungsaufgaben umzuwandeln. Auf diese Weise können Eingabeaufforderungen erstellt werden manuell oder manuell erstellt werden. Der Verbalisierer ist so konzipiert, dass große Modelle auf Zero-Shot-Aufgaben angewendet werden können, wie in Abbildung 2(a) dargestellt. Darüber hinaus wird im FLAN-Papier eine große Anzahl künstlich konstruierter Vorlagen verwendet, um verschiedene Aufgaben zu vereinheitlichen, sodass das Wissen anderer Aufgaben auf bestimmte Aufgaben übertragen werden kann, wie in Abbildung 2 (b) dargestellt. Ein solches generatives Modell hat jedoch folgende Nachteile:

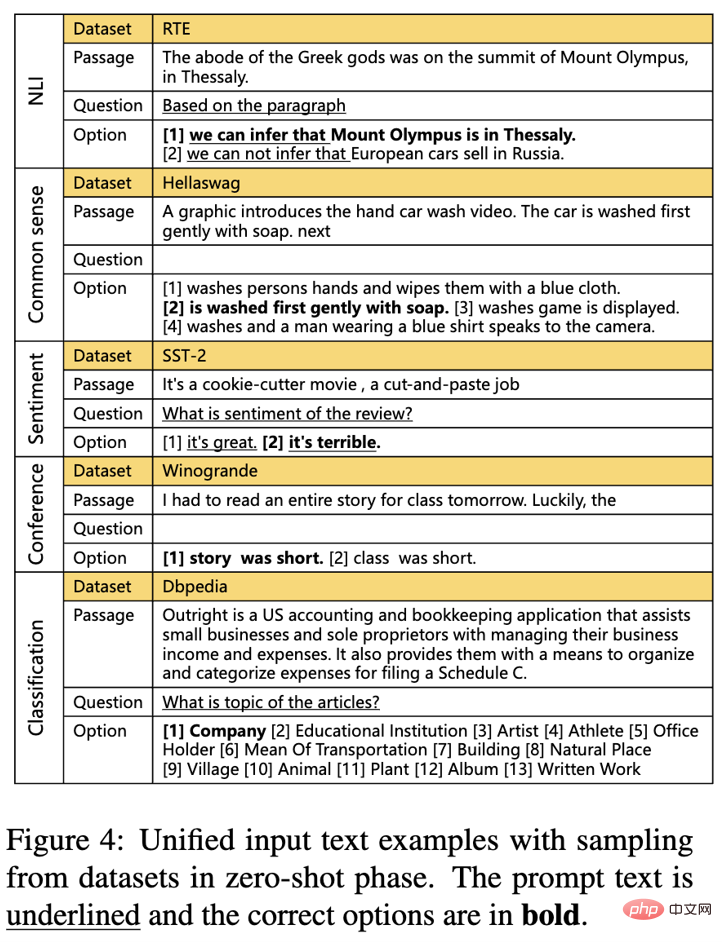

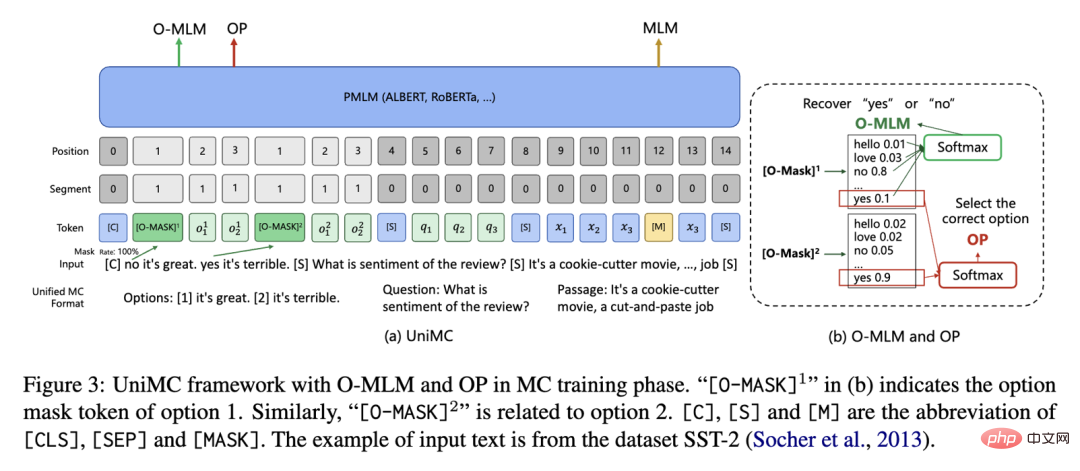

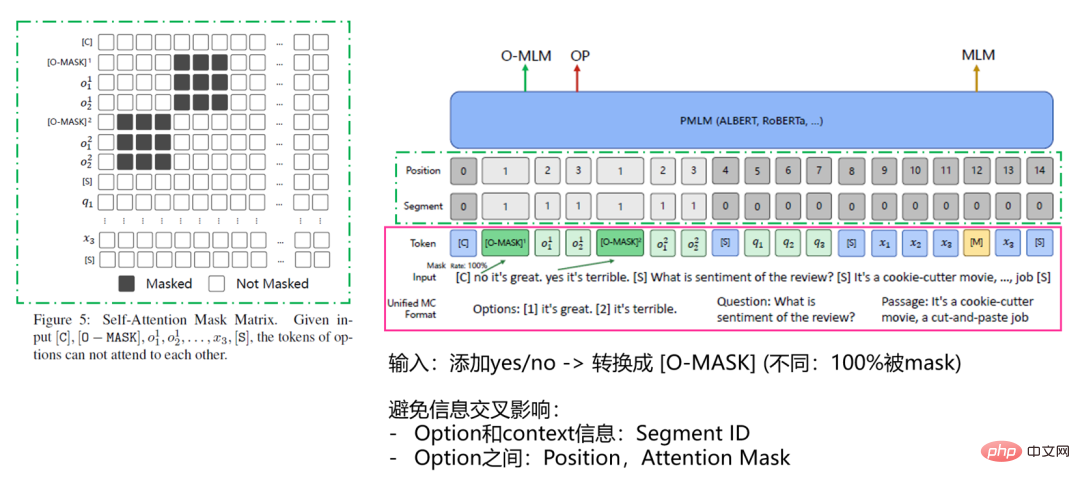

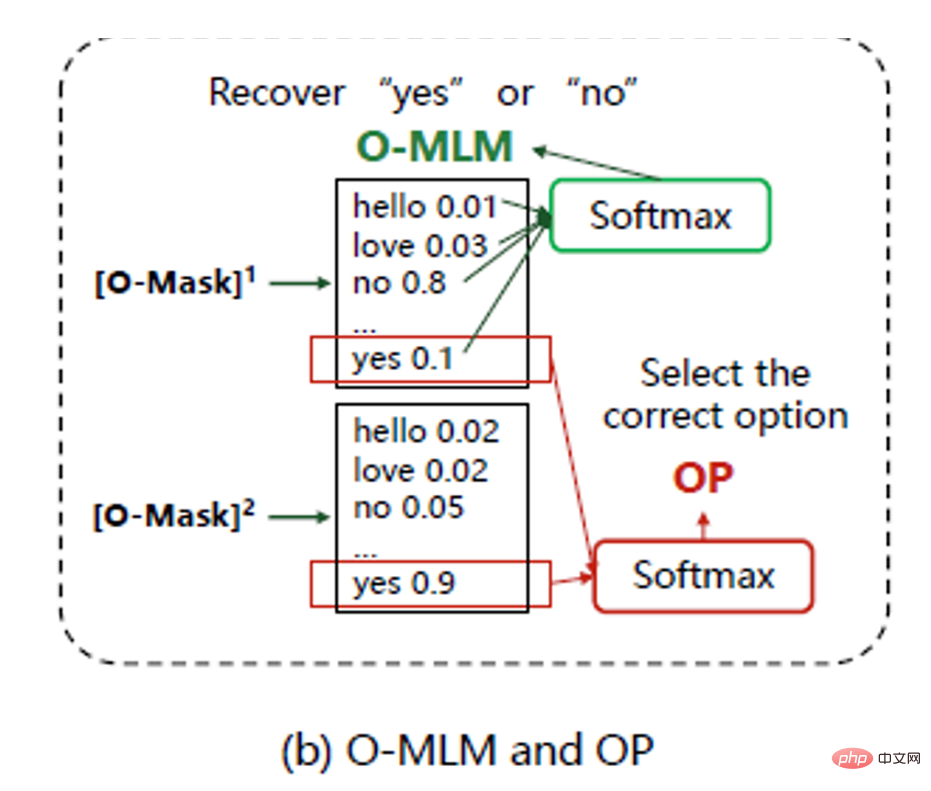

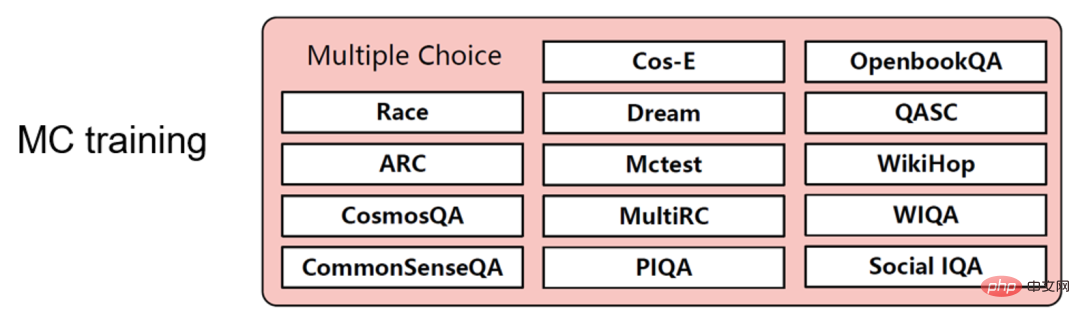

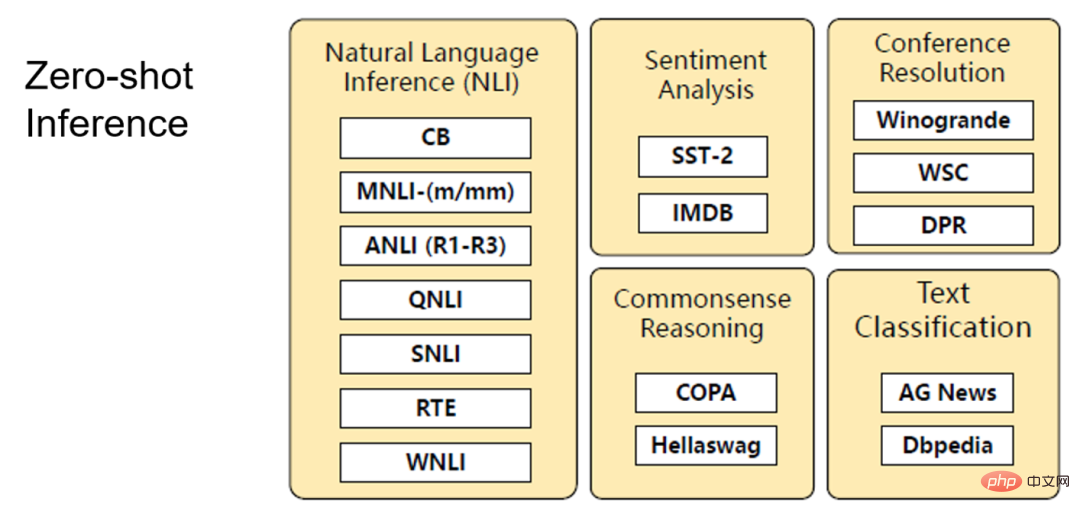

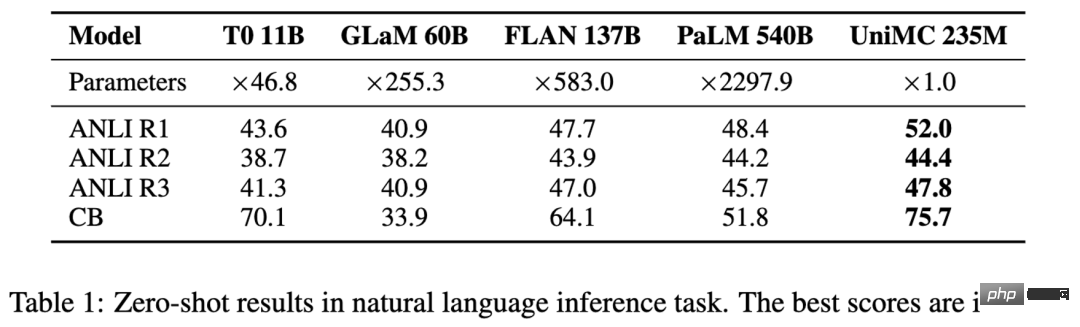

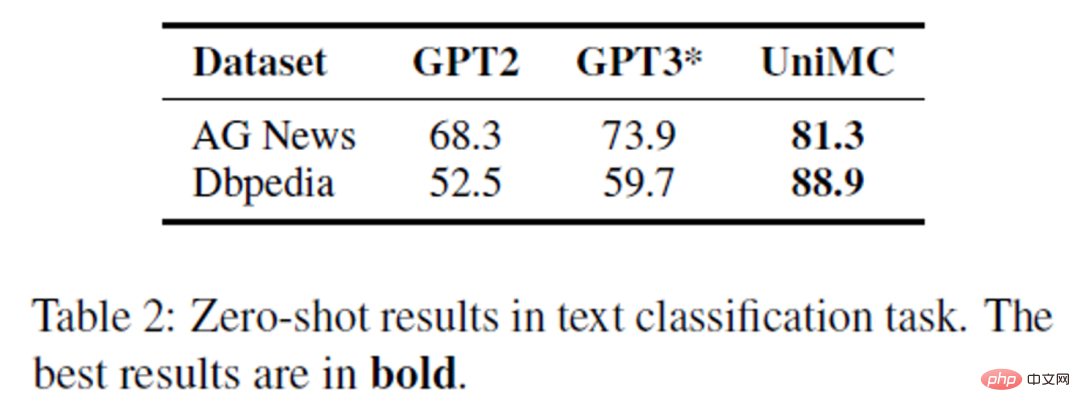

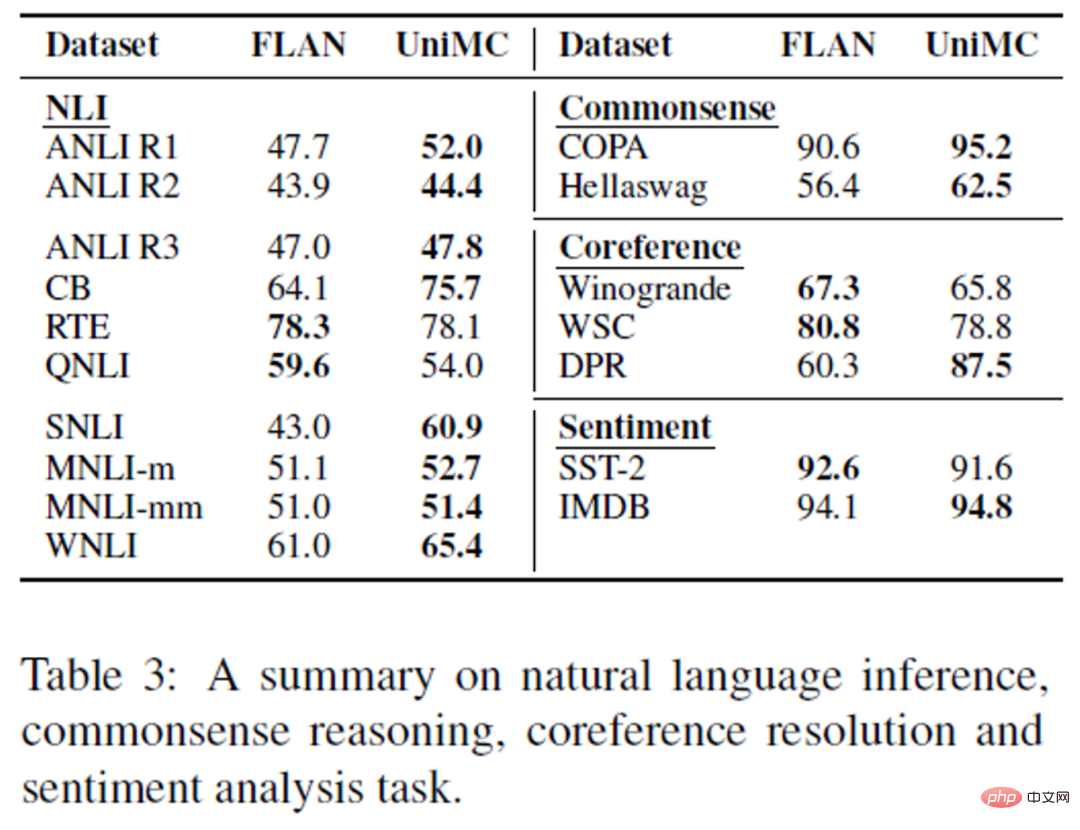

Und wir haben in Abbildung 2(d) die UniMC-Methode vorgeschlagen, die die oben genannten Probleme vermeidet und bei mehreren chinesischen und englischen Aufgaben SOTA oder eine ähnliche Leistung wie die fortschrittlichsten Modelle erreicht. Abbildung 2 Modellidee Die meisten NLU-Aufgaben basieren zweifellos auf Etiketten erhöhen die Schwierigkeit der Aufgabe und die Lernkosten des Modells. Bei vielen etikettenbasierten Aufgaben ist es in der Regel nur erforderlich, den Eingabetext und die Wahrscheinlichkeit anzugeben, dass der Ausgabetext zu jedem Etikett gehört. Basierend auf dieser Idee transformieren wir die NLU-Aufgabe in eine Multiple-Choice-Aufgabe (Multiple-Choice). Das heißt, bei gegebenem Text, Fragen und Optionen wird die Wahrscheinlichkeit jeder Option ausgegeben, ohne die Optionen zu generieren. Auf dieser Grundlage schlagen wir ein neues Konzept vor: Phänomen des Modells. Vorhandene Modellausdrücke fügen später immer eine bestimmte Ebene hinzu, beispielsweise eine Klassifizierungsebene. Alternativ besteht der Phänotyp des generierten Modell-GPT darin, das Wissen des Modells über Prompt zu ermitteln. Die von uns vorgeschlagene UniMC-Lösung erfordert keine Einführung zusätzlicher Schichten in PMLM und nutzt einen anderen Phänotyp von PMLM. In diesem Artikel wählen wir ALBERT als unser Backbone-PMLM-Netzwerk. Einheitliches Multiple-Choice-Format Wie in Abbildung 3 gezeigt, hoffen wir, alle labelbasierten NLU-Aufgaben in ein einheitliches MC-Format (Multiple-Choice) umzuwandeln. Unsere Philosophie besteht darin, so wenig menschliche Informationen wie möglich hinzuzufügen. Abbildung 3 Im Einzelnen haben wir die folgenden zwei Schritte durchgeführt: Vorteile: Es ist nur eine Optionsaufforderung und eine oder keine Frageaufforderung entworfen. Modellstruktur Die Struktur von UniMC ist in Abbildung 4 unten dargestellt, die eine automatische Kodierungsstruktur ähnlich BERT verwendet. Der Hauptprozess besteht darin, dass wir zunächst die Eingaben verschiedener Aufgaben vereinheitlichen und den Fluss der Eingabeinformationen begrenzen. Nach PMLM verwenden wir O-MLM, OP und MLM für das MC-Training und schließlich O-MLM und OP für die Null-Schuss-Vorhersage . Als nächstes werde ich unsere Lösung Schritt für Schritt aufschlüsseln. Bild 4 #🎜 🎜# Geben Sie Eingabe ein, wie in Abbildung 5 gezeigt, der Inhalt des roten durchgezogenen Feldbereichs. Vor der Eingabe in UniMC muss es verarbeitet und in das einzigartige Token-Format von UniMC umgewandelt werden. Um die Berechnungseffizienz zu verbessern, verbinden wir alle Optionen direkt mit Fragen und Text, also [Optionen, Frage, Passage]. Und wir fügen vor jeder Option ein spezielles Token ein, [O-MASK], um Ja oder Nein anzuzeigen (diese Option auswählen oder nicht). (Beachten Sie, dass wir zur Verbesserung der Wiederverwendbarkeit das [MASK]-Token wiederverwendet haben. Wie in Abbildung 5 gezeigt, der Inhalt des grün gepunkteten Kästchenbereichs. Wir brauchen Um die Eingabeinformationsquelle zu berücksichtigen, gibt es Optionsinformationen, Frageninformationen und Textsegmentinformationen. Die Informationen zwischen ihnen wirken sich gegenseitig aus. Daher möchten wir unterschiedliche Informationen isolieren. Wenn wir bei der Eingabe andere Optionen sehen können, dann diese Frage Der Schwierigkeitsgrad wird sinken und das Modell wird träge sein. Verwenden Sie die Segment-ID, um dem Modell mitzuteilen, dass die Option und die Kontextinformationen (Frage, Passage) unterschiedlich sind verschiedene Optionen gleichermaßen Positionsinformationen; Ändern Sie die Aufmerksamkeitsmaskenmatrix, um zu verhindern, dass das Modell die Informationen verschiedener Optionen sieht, was dazu führt, dass das Modell träge wird # Wie in Abbildung 7 gezeigt, hoffen wir, mehrere MC-Datensätze in einem Batch zusammenzufassen kann die Fähigkeiten des Modells verbessern und es einheitlicher machen. Als wir den Stapel erstellten, stellten wir ein Problem fest: Was passiert, wenn ein Stapel Proben mit unterschiedlichen Optionen enthält? Also haben wir vor der Ausgabe eine Logit-Maskenmethode entworfen. Indem wir irrelevanten Token direkt einen negativen, unendlich vorhergesagten Wert zuweisen und diese addieren, können wir den Einfluss anderer Token auf O-MASK bei der Berechnung von Softmax eliminieren. Darüber hinaus können unterschiedlich viele Multiple-Choice-Fragen einheitlich in einem Stapel bearbeitet werden. Bild 7 #🎜 🎜 #Modelltraining und Vorhersage MC-Training Im Gegensatz zum Instruction Tuning von FLAN trainieren wir hauptsächlich anhand des MC-Datensatzes. Dies dient hauptsächlich dazu, dem Modell das Erlernen von Multiple-Choice-Fragen zu ermöglichen, und der MC-Datensatz weist beispielsweise ein gewisses Maß an Vielseitigkeit auf Datensätze können durch die Anzahl der ungleichen Etiketten bestimmt werden. Abbildung 8 Zero-Shot-Inferenz Interessanterweise können wir feststellen, dass diese beiden Aufgaben in zwei Phasen ausgeführt werden können: Training und Zero-Shot-Inferenz haben Konsistenz. Dies liegt daran, dass wir zwei Aufgaben, O-MLM und OP, verwenden, damit das Modell Multiple-Choice-Fragen beantworten kann. Und da wir die Klassifizierungsebene aufgegeben haben, können alle Parameter wiederverwendet werden, wodurch die Zero-Shot-Fähigkeit von PMLM aktiviert wird. Abbildung 9 Englisches Szenario Wir haben 14 Multiple-Choice-Aufgaben für das Vortraining gesammelt und dann andere NLU-Aufgaben für Zero-Shot durchgeführt Leistungstests. In 4 NLI-Aufgaben erreicht UniMC SOTA und übertrifft das PaLM-Modell mit 540 Milliarden Parametern. Abbildung 10 Und wir schlagen das Netzwerk mit GPT-2 und GPT-3 als Rückgrat bei der Klassifizierungsaufgabe. Für die sehr schwierige Dbpedia-Aufgabe, bis zu 13 Kategorien, kann sogar eine ultrahohe Genauigkeit von 88,9 % erreicht werden. Abbildung 11 Um die Verallgemeinerung von UNIMC zu untersuchen, haben wir es mit FLAN verglichen. Wie man sieht, kann unser UniMC FLAN in fast allen Aufgaben übertreffen oder ihm nahekommen. Abbildung 12 Abbildung 12 Chinesische Szene -Trainieren und testen Sie dann 9 Aufgaben von FewCLUE und ZeroCLUE. Zum 30. August 2022 hat

Abbildung 13 Abbildung 14 Außerdem führen wir kaum künstliche Informationen ein. Und es überwindet das Problem der Inkonsistenz zwischen Vortraining und Feinabstimmung von BERT-Modellen, und unser Training und unsere Vorhersage sind konsistent. Wir können sogar ein Training und mehrere Zero-Shot-Vorhersagen durchführen, was die Kosten für Rechenleistung erheblich spart. Derzeit hat das IDEA Fengshenban-Team mehr als 70 vorab trainierte große Modelle auf den Markt gebracht. Zitat [1]Unmögliches Dreieck: Was kommt als nächstes für vorab trainierte Sprachmodelle?https: / /readpaper.com/paper/4612531641570566145

UniMC (ein neuer Modellphänotyp)

#🎜🎜 #

UniMC-Leistung

(Erlangshen im Bild – UnifiedMC ist UniMC).

(Erlangshen im Bild – UnifiedMC ist UniMC).  Fazit: Wir haben einen Roman vorgeschlagen. Zero-Shot Lösungen für NLU-Aufgaben in Szenarien, nur mit Hunderten von Millionen von Parametern kann ein komplexes großes Modell mit der tausendfachen Anzahl von Parametern zunichte machen.

Fazit: Wir haben einen Roman vorgeschlagen. Zero-Shot Lösungen für NLU-Aufgaben in Szenarien, nur mit Hunderten von Millionen von Parametern kann ein komplexes großes Modell mit der tausendfachen Anzahl von Parametern zunichte machen.

Das obige ist der detaillierte Inhalt vonDas IDEA Fengshen List-Team hat das unmögliche Dreieck durchbrochen und mit 540 Milliarden Modellen konkurriert und nur mit 200 Millionen Modellen Zero-Sample-Learning-SOTA erreicht. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr