Heim >Technologie-Peripheriegeräte >KI >Basierend auf der modalübergreifenden Elementübertragung erfordert die Referenzvideoobjekt-Segmentierungsmethode der Meitu & Dalian University of Technology nur eine einzige Stufe

Basierend auf der modalübergreifenden Elementübertragung erfordert die Referenzvideoobjekt-Segmentierungsmethode der Meitu & Dalian University of Technology nur eine einzige Stufe

- 王林nach vorne

- 2023-04-08 21:21:071080Durchsuche

Einführung

Referring VOS (RVOS) ist eine neu entstehende Aufgabe, die darauf abzielt, die Objekte, auf die sich der Text bezieht, aus einer Videosequenz basierend auf dem Referenztext zu segmentieren. Im Vergleich zur halbüberwachten Videoobjektsegmentierung stützt sich RVOS nur auf abstrakte Sprachbeschreibungen statt auf Referenzmasken auf Pixelebene, was eine bequemere Option für die Mensch-Computer-Interaktion darstellt und daher große Aufmerksamkeit gefunden hat.

Link zum Papier: https://www.aaai.org/AAAI22Papers/AAAI-1100.LiD.pdf

Der Hauptzweck dieser Forschung besteht darin, die Probleme bestehender RVOS zu lösen Aufgaben Zwei große Herausforderungen:

- Wie man Textinformationen und Bildinformationen modalitätsübergreifend zusammenführt, um die Skalenkonsistenz zwischen den beiden Modalitäten aufrechtzuerhalten und die vom Text bereitgestellten nützlichen Funktionsreferenzen vollständig in die Bildfunktionen zu integrieren

- Wie man die zweistufige Strategie bestehender Methoden aufgibt (d. h. zunächst Bild für Bild ein grobes Ergebnis auf Bildebene erhalten, dann das Ergebnis als Referenz verwenden und die endgültige Vorhersage durch Strukturverfeinerung mit erweiterten Zeitinformationen erhalten). ) , wodurch die gesamte RVOS-Aufgabe in einem einstufigen Framework vereint wird.

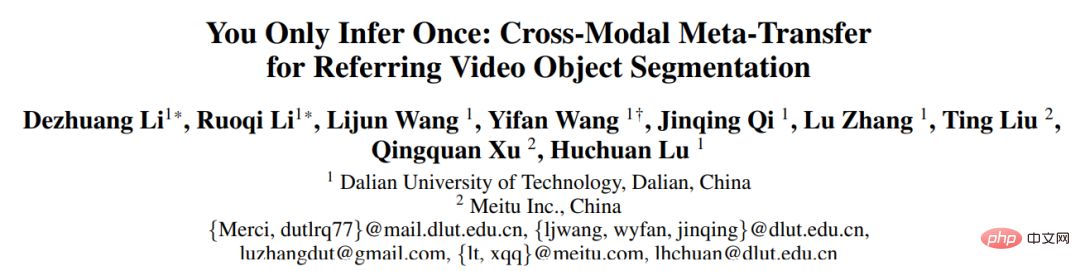

In diesem Zusammenhang schlägt diese Forschung ein End-to-End-RVOS-Framework für die modalübergreifende Elementmigration vor – YOFO Seine wichtigsten Beiträge und Innovationen sind:

- nur Es erfordert Einstufige Argumentation zum direkten Erhalten der Segmentierungsergebnisse von Videozielen mithilfe von Referenztextinformationen. Die anhand von zwei gängigen Datensätzen – Ref-DAVIS2017 und Ref-Youtube-VOS – erzielten Ergebnisse übertreffen alle aktuellen zweistufigen Methoden Meta-Transfer-Modul zur Verbesserung der zeitlichen Informationen, wodurch ein zielgerichteteres Feature-Lernen erreicht wird;

- Schlägt ein Multi-Scale Cross-Modal Feature Mining-Modul vor, das nützliche Features vollständig integrieren kann in Sprache und Bildern.

- Implementierungsstrategie

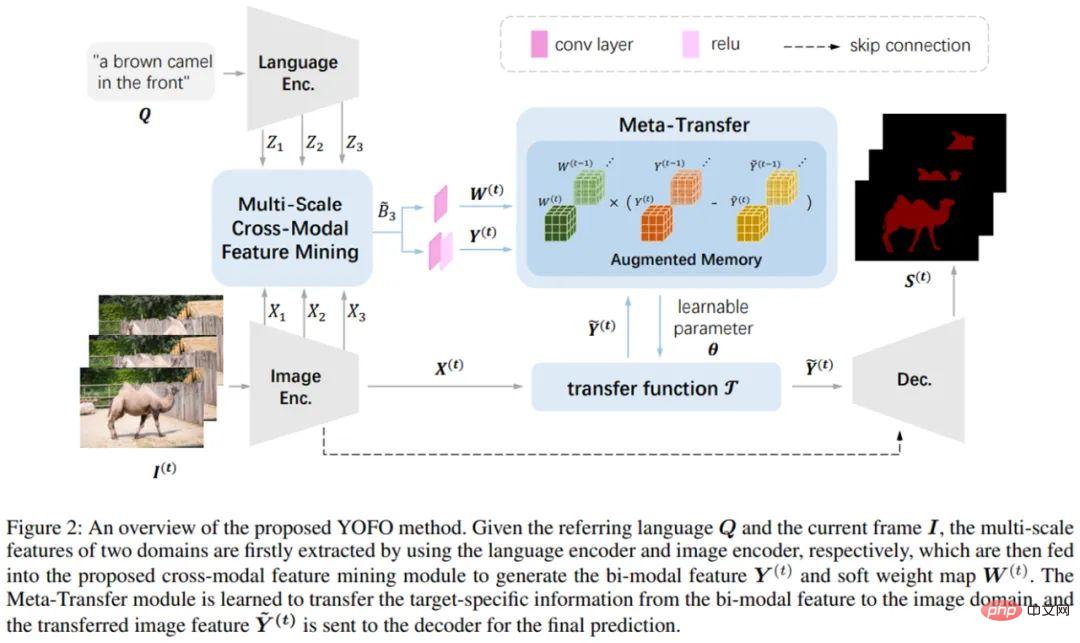

Mehrskalenübergreifendes Feature-Mining-Modul

: Dieses Modul kann die Beziehung zwischen den durch Bildmerkmale übermittelten Skaleninformationen und den Sprachmerkmalen aufrechterhalten, indem zwei modale Merkmale unterschiedlicher Maßstäbe schrittweise zusammengeführt werden. Konsistenz und, was noch wichtiger ist, stellt sicher, dass Sprachinformationen während des Fusionsprozesses nicht durch mehrskalige Bildinformationen verwässert und überlagert werden.

Meta-Migrationsmodul

: Es wird eine Learning-to-Learn-Strategie übernommen, und der Prozess kann einfach als die folgende Mapping-Funktion beschrieben werden. Unter diesen ist die Migrationsfunktion eine Faltung, dann ist  ihr Faltungskernparameter:

ihr Faltungskernparameter:

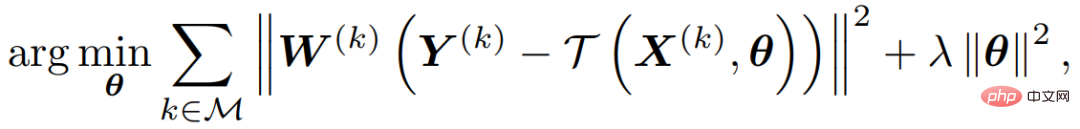

Der Optimierungsprozess kann als folgende Zielfunktion ausgedrückt werden:

Unter diesen stellt M die Speicherbank dar, die historische Informationen speichern kann, und W stellt das Gewicht verschiedener Positionen dar, die angegeben werden können Der Aufmerksamkeitsgrad Y stellt die bimodalen Merkmale jedes in der Speicherbank gespeicherten Videobilds dar. Dieser Optimierungsprozess maximiert die Fähigkeit der Metatransferfunktion, bimodale Merkmale zu rekonstruieren, und ermöglicht außerdem ein durchgängiges Training des gesamten Frameworks.

Training und Tests: Die im Training verwendete Verlustfunktion ist Lovasz-Verlust, und der Trainingssatz besteht aus zwei Videodatensätzen Ref-DAVIS2017 und Ref-Youtube-VOS und wird über den statischen Datensatz Ref durchgeführt -COCO Zufällige affine Transformation simuliert Videodaten als Hilfstraining. Der Metamigrationsprozess wird während des Trainings und der Vorhersage durchgeführt und das gesamte Netzwerk läuft mit einer Geschwindigkeit von 10 FPS auf 1080ti.

Experimentelle Ergebnisse

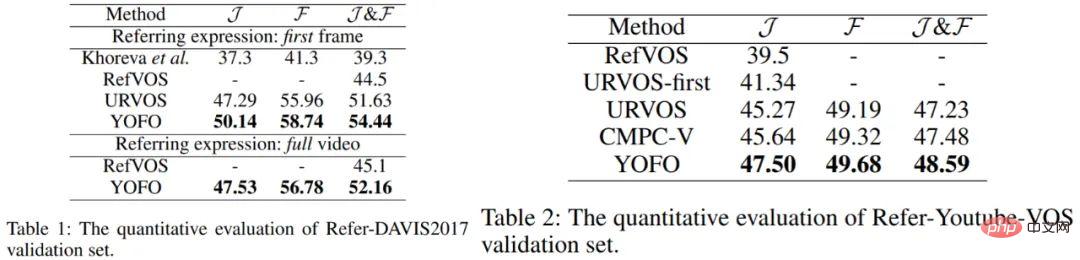

Die in der Forschung verwendete Methode hat bei zwei gängigen RVOS-Datensätzen (Ref-DAVIS2017 und Ref-Youtube-VOS) hervorragende Ergebnisse erzielt:

Abbildung 3: Quantitative Indikatoren für zwei Mainstream-Datensätze.

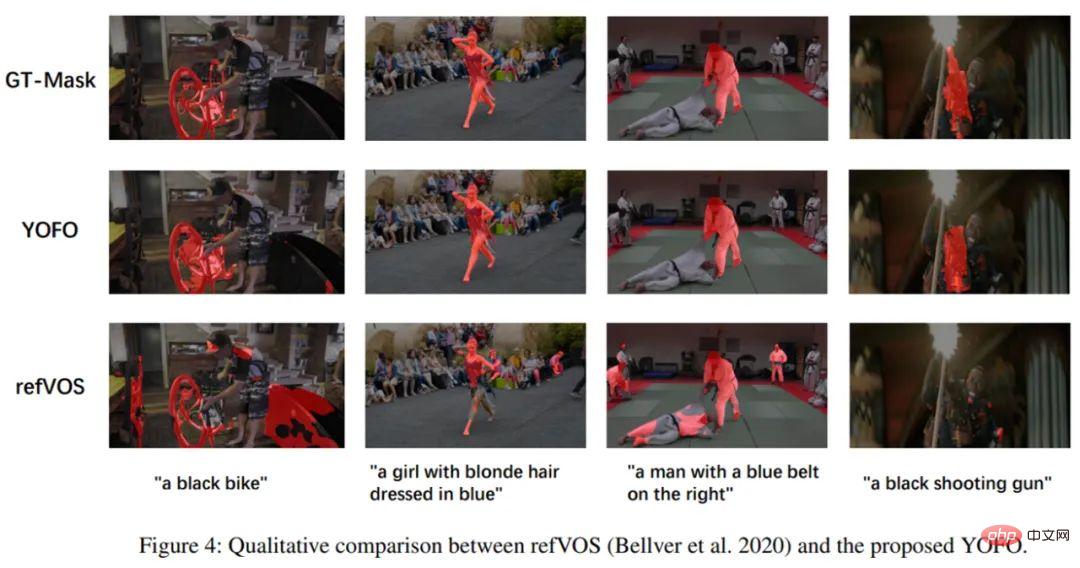

Abbildung 4: Visualisierung auf dem VOS-Datensatz.

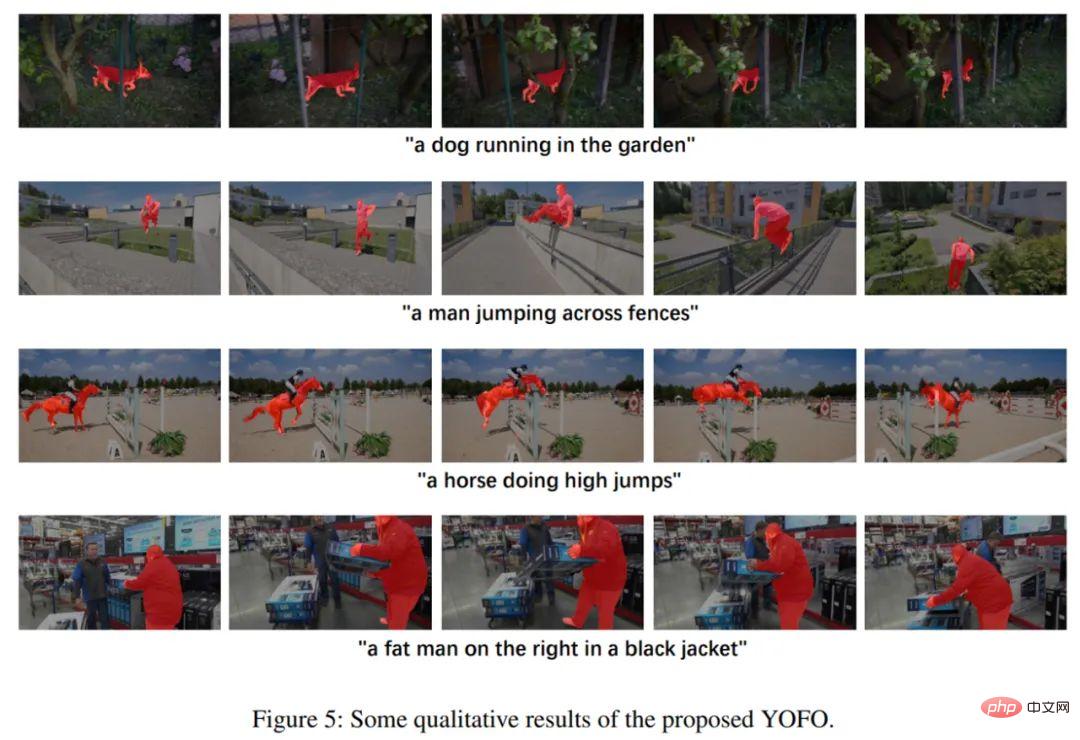

Abbildung 5: Weitere Visualisierungseffekte von YOFO.

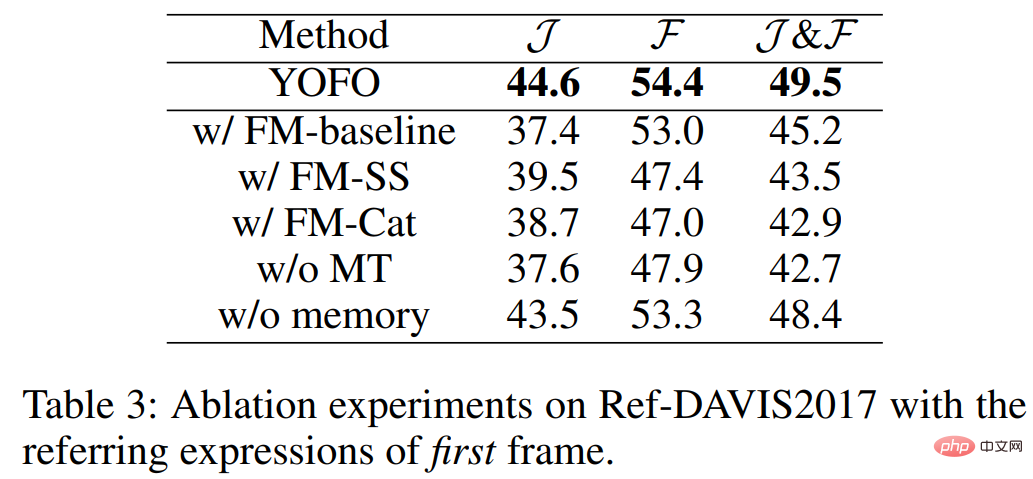

Die Studie führte außerdem eine Reihe von Ablationsexperimenten durch, um die Wirksamkeit des Feature-Mining-Moduls (FM) und des Meta-Transfer-Moduls (MT) zu veranschaulichen.

Abbildung 6: Wirksamkeit des Feature-Mining-Moduls (FM) und des Meta-Transfer-Moduls (MT).

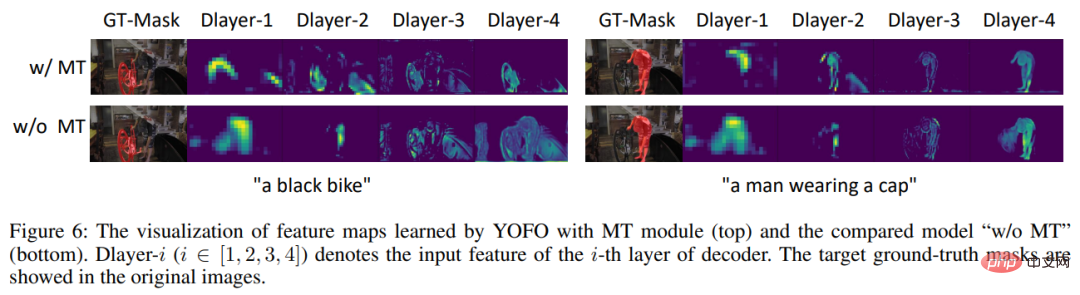

Darüber hinaus wurden in der Studie die Ausgabeeigenschaften des Decoders mithilfe des MT-Moduls und ohne Verwendung des MT-Moduls visualisiert. Es ist deutlich zu erkennen, dass das MT-Modul den durch die Sprache beschriebenen Inhalt korrekt erfassen und Störgeräusche erzeugen kann . filtern.

Abbildung 7: Vergleich der Decoder-Ausgabefunktionen vor und nach Verwendung des MT-Moduls. Über das Forschungsteam

Dieses Papier wurde gemeinsam von Forschern des Meitu Imaging Research Institute (MT Lab) und dem Lu Huchuan-Team der Dalian University of Technology vorgeschlagen. Das Meitu Imaging Research Institute (MT Lab) ist Meitus Team, das sich der Algorithmenforschung, technischen Entwicklung und Produktisierung in den Bereichen Computer Vision, maschinelles Lernen, Augmented Reality, Cloud Computing und anderen Bereichen widmet. Es bildet die Grundlage für Meitus bestehende und zukünftige Produkte. Es bietet Unterstützung für Kernalgorithmen und fördert die Entwicklung von Meitu-Produkten durch Spitzentechnologie. Es hat an führenden internationalen Computer-Vision-Konferenzen wie CVPR, ICCV und ECCV teilgenommen und weitere gewonnen als zehn Meisterschaften und Vizemeisterschaften.

Das obige ist der detaillierte Inhalt vonBasierend auf der modalübergreifenden Elementübertragung erfordert die Referenzvideoobjekt-Segmentierungsmethode der Meitu & Dalian University of Technology nur eine einzige Stufe. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr