Heim >Technologie-Peripheriegeräte >KI >CV eröffnet die Ära der großen Modelle! Google veröffentlicht den größten ViT der Geschichte: 22 Milliarden Parameter, die visuelle Wahrnehmung kommt der des Menschen nahe

CV eröffnet die Ära der großen Modelle! Google veröffentlicht den größten ViT der Geschichte: 22 Milliarden Parameter, die visuelle Wahrnehmung kommt der des Menschen nahe

- 王林nach vorne

- 2023-04-07 15:09:081451Durchsuche

Transformer trägt zweifellos am meisten zum Wohlstand im Bereich der Verarbeitung natürlicher Sprache bei und ist auch die Infrastruktur für groß angelegte Sprachmodelle wie GPT-4.

Im Vergleich zu den zig Milliarden Parametern von Sprachmodellen profitiert der Bereich Computer Vision jedoch nicht so sehr von den Vorteilen von Transformer. Derzeit verfügt das größte visuelle Transformer-Modell ViT-e nur über 4 Milliarden Parameter.

Kürzlich hat Google ein Papier veröffentlicht, in dem Forscher eine Methode vorgeschlagen haben, mit der groß angelegte Vision Transformers (ViT)-Modelle effizient und stabil trainiert werden können, wodurch die Anzahl der ViT-Parameter erfolgreich auf 22 Milliarden erhöht werden kann.

Link zum Papier: https://arxiv.org/abs/2302.05442

Um eine Modellerweiterung zu erreichen, kombiniert ViT-22B die Funktionen anderer Sprachmodelle (z. B (das PaLM-Modell) Die Idee besteht darin, die QK-Normalisierung zu verwenden, um die Trainingsstabilität zu verbessern und eine neue Methode für „asynchrone parallele lineare Operationen“ vorzuschlagen, um die Trainingseffizienz zu verbessern und auf Cloud TPU mit höherer Hardwareeffizienz trainieren zu können.

Bei der Durchführung von Experimenten mit dem ViT-22B-Modell zur Bewertung der Leistung nachgelagerter Aufgaben zeigte ViT-22B auch ähnliche Fähigkeiten wie große Sprachmodelle, d. h. mit zunehmender Modellskala verbessert sich die Leistung weiter.ViT-22B kann auch in PaLM-e verwendet werden. Das große Modell kann in Kombination mit dem Sprachmodell das technische Niveau von Roboteraufgaben erheblich verbessern.

Die Forscher beobachteten darüber hinaus weitere durch die Skalierung bedingte Vorteile, darunter ein besseres Gleichgewicht zwischen Fairness und Leistung, Übereinstimmung mit der „menschlichen visuellen Wahrnehmung“ in Bezug auf Form-/Texturverzerrung und eine bessere Robustheit.

Modellarchitektur

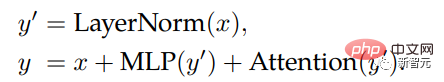

ViT-22B ist ein Modell, das auf der Transformer-Architektur basiert. Im Vergleich zur ursprünglichen ViT-Architektur haben die Forscher hauptsächlich drei Modifikationen vorgenommen, um die Trainingseffizienz und Trainingsstabilität zu verbessern.Parallele Schichten

ViT-22B führt den Aufmerksamkeitsblock und den MLP-Block parallel aus, während sie im ursprünglichen Transformer nacheinander ausgeführt werden.

PaLM-Modelltraining verwendet ebenfalls diese Methode, wodurch die Trainingsgeschwindigkeit großer Modelle ohne Leistungseinbußen um 15 % erhöht werden kann.

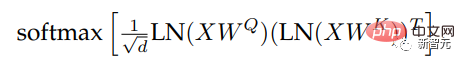

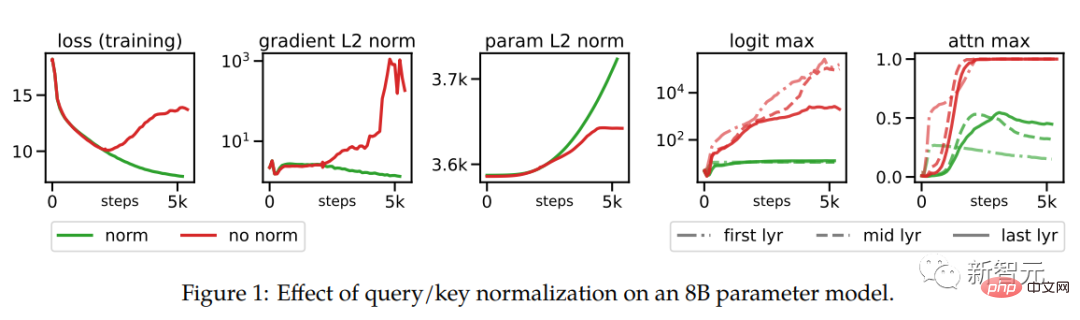

Query/Key (QK)-Normalisierung

Während der Erweiterung von ViT beobachteten Forscher in einem Modell mit 8 Milliarden Parametern, dass der Trainingsverlust hauptsächlich nach einigen tausend Trainingsschritten zu divergieren begann aufgrund der Instabilität, die durch übermäßig große Werte von Aufmerksamkeitsprotokollen verursacht wird, was zu Aufmerksamkeitsgewichten von Null Entropie führt (fast One-Hot).

Um dieses Problem zu lösen, verwendeten die Forscher LayerNorm für Abfrage und Schlüssel vor der Berechnung der Aufmerksamkeit des Punktprodukts

Die experimentellen Ergebnisse des 8-Milliarden-Parameter-Modells sind in der folgenden Abbildung dargestellt. Eine Normalisierung kann Abhilfe schaffen Divergenzproblem.

... um 3 % ohne Qualitätsverlust.

Im Gegensatz zu PaLM verwendet ViT-22B jedoch einen Bias-Term für (interne und externe) dicht verbundene MLP-Schichten, und es kann beobachtet werden, dass die Qualität verbessert und die Geschwindigkeit nicht verringert wird.

Im Encoder-Modul von ViT-22B ist die Einbettungsschicht, einschließlich Extraktionspatches, linearer Projektionen und zusätzlicher Positionseinbettungen, dieselben wie im ursprünglichen ViT, und Multi-Head-Aufmerksamkeitspooling wird zur Aggregation pro Token verwendet Darstellungen in jedem Kopf.

Die Patchgröße von ViT-22B beträgt 14×14 und die Auflösung des Bildes beträgt 224×224 (vorverarbeitet durch Anfangszuschnitt und zufälliges horizontales Spiegeln).

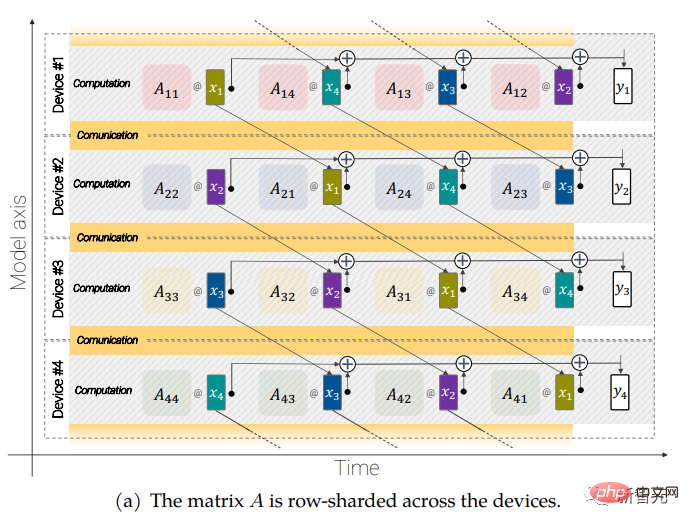

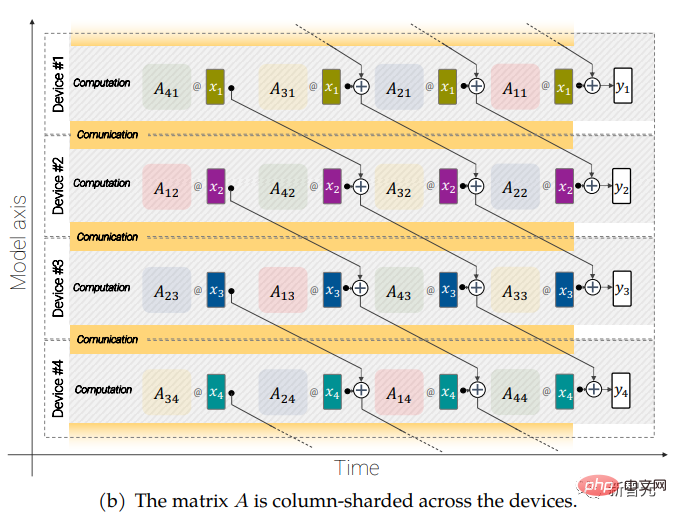

asynchrone parallele lineare Operationen

Großmaßstäbliche Modelle erfordern auch Sharding, das heißt, die Modellparameter werden auf verschiedene Computergeräte verteilt. Darüber hinaus sind die Aktivierungen (Zwischendarstellungen der Eingabe) für Forscher ebenfalls erforderlich in Scheiben geschnitten.

Da sowohl die Eingabe als auch die Matrix selbst auf verschiedene Geräte verteilt sind, erfordern selbst einfache Operationen wie die Matrixmultiplikation besondere Sorgfalt.

Forscher haben eine Methode namens asynchrone parallele lineare Operationen entwickelt, die gleichzeitig Aktivierungen und Gewichtungen zwischen Geräten steuern kann, während in der Matrixmultiplikationseinheit (der Einheit, die den größten Teil der Rechenleistung im zu kommunizierenden TPU ausmacht) gerechnet wird .

Asynchrone Methoden minimieren die Wartezeit auf eingehende Kommunikation und erhöhen so die Geräteeffizienz.

Das Ziel asynchroner paralleler linearer Operationen besteht darin, die Matrixmultiplikation y = Ax zu berechnen, aber sowohl die Matrix A als auch die Aktivierung x sind auf verschiedene Geräte verteilt, was eine überlappende Kommunikation und Berechnungen zwischen den Geräten erfordert, um dies zu erreichen. Die Matrix A ist geräteübergreifend in Spalten unterteilt. Jede Matrix enthält einen zusammenhängenden Abschnitt, wobei jeder Block als Aij dargestellt wird. Weitere Informationen finden Sie im Originalpapier.

Experimentelle Ergebnisse

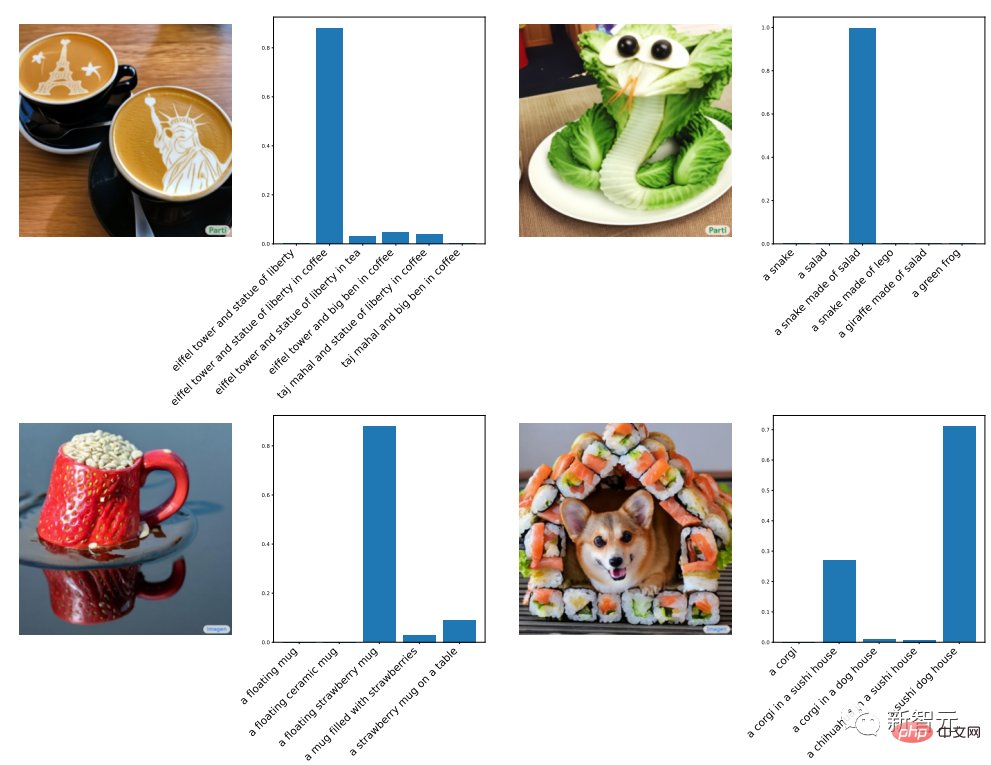

Um zu veranschaulichen, dass die von ViT-22B gelernten Darstellungen sehr umfangreich sind, verwendeten die Forscher LiT-Tuning, um ein Textmodell zu trainieren, um einige Darstellungen zum Ausrichten von Text und Bildern zu generieren.

Das Folgende sind experimentelle Ergebnisse, die mit von Parti und Imagen generierten Out-of-Distribution-Bildern erzielt wurden. Es ist ersichtlich, dass die Fähigkeit zur Generalisierung von Zero-Shot-Bildern sehr stark ist. Es wird nur aus dem Internet gecrawlt . Unsichtbare Objekte und Szenen können anhand natürlicher Bilder erkannt werden.

Der Artikel diskutiert auch die Wirkung von ViT-22B auf Videoklassifizierung, Tiefenschätzung und semantische Segmentierungsaufgaben.

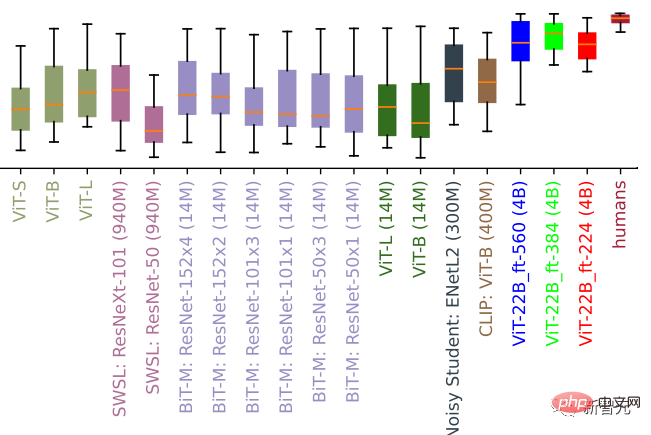

Abgestimmt auf die Erkennung menschlicher Objekte

Um die Konsistenz von ViT-22B-Klassifizierungsentscheidungen mit menschlichen Klassifizierungsentscheidungen zu überprüfen, haben die Forscher ViT-22B auf verschiedene Auflösungen des Out-of-Distribution (OOD)-Datensatzes Fine abgestimmt -Tuning, bei dem menschliche Vergleichsdaten über die Modell-gegen-Mensch-Toolbox verfügbar sind.

Diese Toolbox misst hauptsächlich drei Schlüsselindikatoren: Wie geht das Modell mit Verzerrungen um (Genauigkeit)? Was ist der Unterschied zwischen menschlicher und modellhafter Genauigkeit (Unterschied in der Genauigkeit)? Wie ähnlich sind die Fehlermuster (Fehlerkonsistenz) von Personen und Modellen?

Formabweichungsbewertung (größere Werte bedeuten mehr Formabweichungen). Viele Sehmodelle weisen einen geringen Form-/hohen Textur-Bias auf, und ViT-22B, fein abgestimmt auf ImageNet, weist den höchsten bisher unter den ML-Modellen aufgezeichneten Form-Bias auf, näher am menschlichen Shape-Bias

Experimentelle Ergebnisse zeigen, dass dies jedoch nicht der Fall ist Alle fein abgestimmten Lösungen zeigten eine gute Leistung, aber die ViT-22B-Variante erreichte in allen drei Kennzahlen neue Höchstwerte.

Darüber hinaus weist das Modell ViT-22B auch den höchsten Formabweichungsrekord unter den visuellen Modellen auf. Dies bedeutet, dass sie zur Klassifizierungsentscheidung hauptsächlich die Form des Objekts und nicht die Textur des Objekts verwenden und die Strategieergebnisse der menschlichen Wahrnehmung ähneln (die Formverzerrung beträgt 96 %).

Standardmodelle (z. B. ResNet-50 weist eine Formabweichung von 20–30 % auf) klassifizieren häufig anhand der Textur, während Modelle mit hoher Formabweichung dazu neigen, sich auf die Form zu konzentrieren (im Bild unten als Katze identifiziert), obwohl es sich um Menschen handelt und Modelle Es gibt immer noch viele Unterschiede in der Wahrnehmung, aber ViT-22B weist mehr Ähnlichkeiten mit der menschlichen visuellen Objekterkennung auf.

Katze oder Elefant? Auto oder Uhr? Vogel oder Fahrrad? Bilder mit der Form eines Objekts und der Textur eines anderen Objekts können zur Messung von Form-/Texturabweichungen verwendet werden.

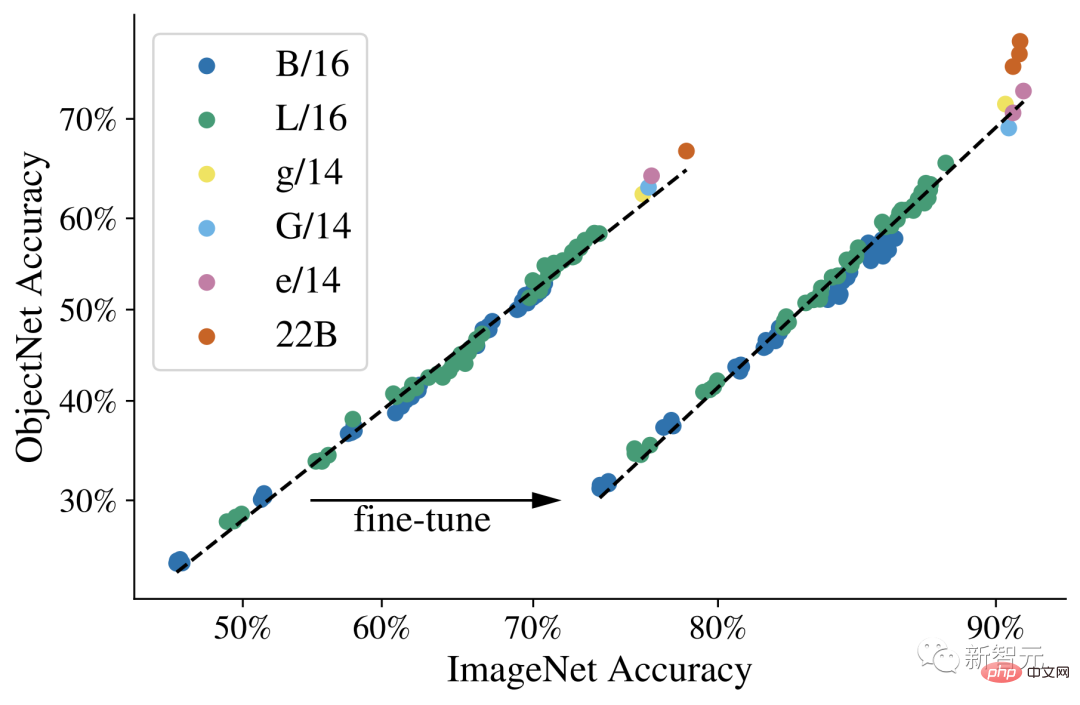

In diesem Experiment erstellten die Forscher Etikettenzuordnungen von JFT zu ImageNet und von ImageNet zu verschiedenen Datensätzen außerhalb der Verteilung wie ObjectNet.

Die Ergebnisse nach dem Vortraining dieser Daten werden unten angezeigt. Anschließend wird das Modell auf ImageNet vollständig verfeinert.

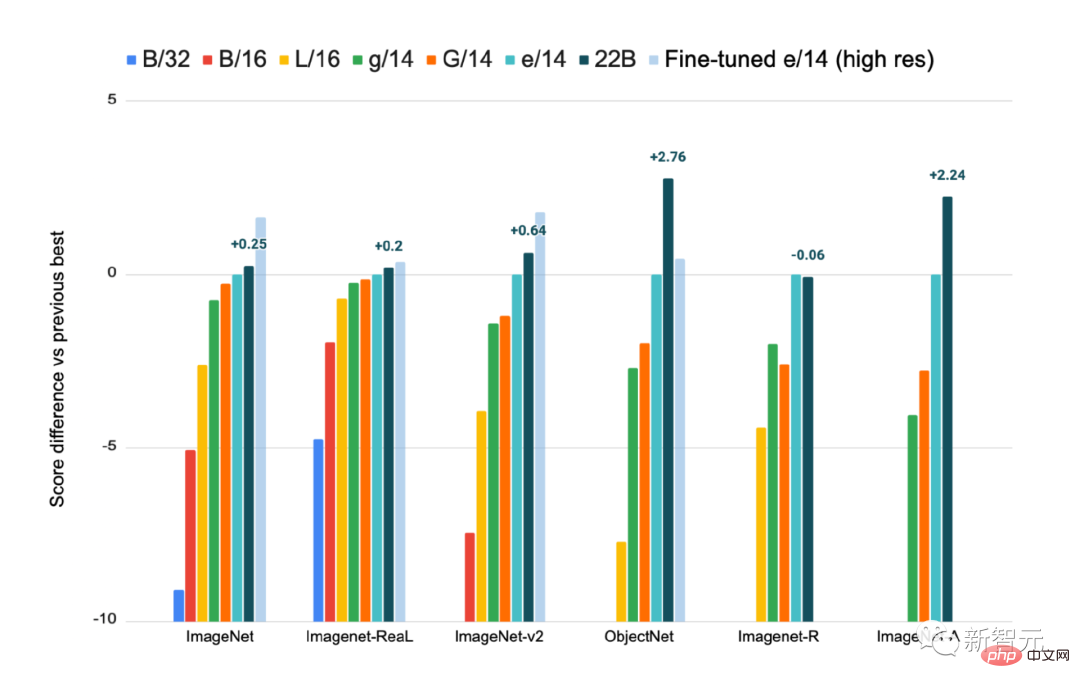

Es ist zu beobachten, dass die Skalierung von Vision Transformers die OOD-Leistung verbessern kann: Selbst wenn die Genauigkeit von ImageNet die Sättigung erreicht, ist ersichtlich, dass der Wechsel vom ViT-e- zum ViT-22B-Modell auf ObjectNet die Leistung erheblich verbessern kann Leistung.

Linear Probe

Linear Probe ist eine Technik, die eine einzelne lineare Ebene auf ein eingefrorenes Modell legt, wodurch das Training kostengünstiger und die Einrichtung einfacher ist als bei einer vollständigen Feinabstimmung.

Auf ImageNet trainierte lineare Erkennungsergebnisse, ausgewertet auf ImageNet-Real-, ImageNet-v2-, ObjectNet-, ImageNet-R- und ImageNet-A-Datensätzen und liefern hochauflösendes, fein abgestimmtes ViT-e/14 als Referenz

Aus den Ergebnissen lässt sich erkennen, dass die lineare Erkennungsleistung von ViT-22B nahe am Stand der Technik liegt, kleinere Modelle mithilfe hochauflösender Bilder vollständig zu verfeinern und mit höheren Auflösungen zu trainieren ist in der Regel deutlich teurer, kann aber bei vielen Aufgaben bessere Ergebnisse erzielen. Destillation

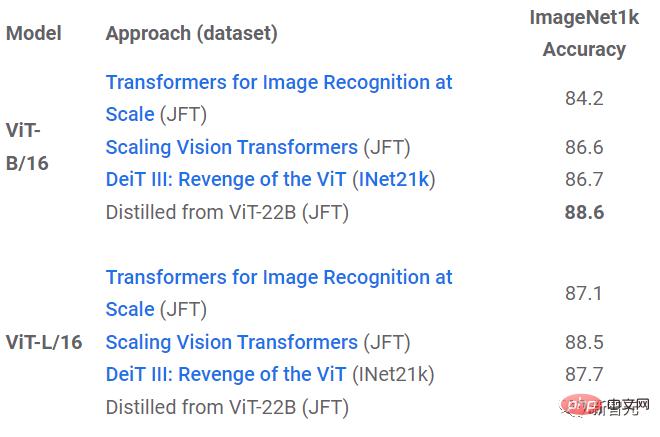

Mit der Destillationsmethode kann das Wissen eines größeren Modells in das Wissen eines kleineren Modells umgewandelt werden, wodurch die Betriebseffizienz großer Modelle verbessert werden kann, die teurer sind und langsamer laufen.

Aus den experimentellen Ergebnissen geht hervor, dass das Wissen von ViT-22B auf kleinere Modelle wie ViT-B/16 und ViT-L/16 übertragen und gleichzeitig auf ImageNet aufgefrischt werden kann Leistungsrekorde in Modellgröße.

Fairness und Bias

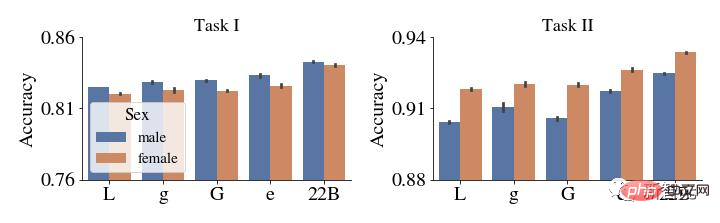

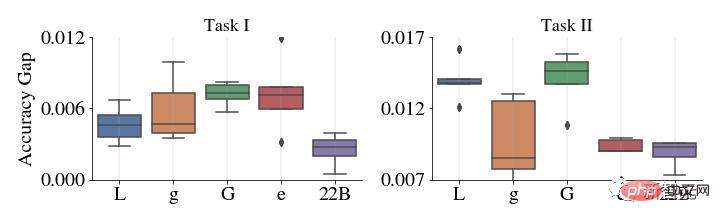

Modelle des maschinellen Lernens sind anfällig für unbeabsichtigte unfaire Bias, wie z. B. das Finden falscher Korrelationen oder Leistungsunterschiede zwischen Untergruppen, und Forscher haben herausgefunden, dass die Skalierung von Modellen dazu beitragen kann, diese Probleme zu lindern.

Zuallererst ist die Skalierung ein vielversprechender Kompromiss. Selbst wenn das Modell trainiert und dann nachbearbeitet wird, um sein Niveau der demografischen Parität unter einem vorgeschriebenen und tolerierbaren Niveau zu halten, wird sich die Leistung mit der Zeit verbessern die Vergrößerung des Maßstabs.

Oben: Genauigkeit jeder Untergruppe in CelebA vor der Debiasierung. Unten: Die Y-Achse zeigt den absoluten Leistungsunterschied für die beiden in diesem Beispiel hervorgehobenen spezifischen Untergruppen (Frauen und Männer). Im Vergleich zum kleineren ViT-Modell ist der Leistungsunterschied beim ViT-22B sehr gering.

Noch wichtiger ist, dass dies nicht nur gilt, wenn die Leistung anhand der Genauigkeit gemessen wird, sondern auch für andere Maßnahmen wie die Kalibrierung, d. h. ein statistisches Maß für die Wahrhaftigkeit der geschätzten Wahrscheinlichkeiten des Modells, wobei alle Untergruppen als It klassifiziert werden tendiert dazu, sich mit zunehmender Skalierung zu verbessern, und ViT-22B verringert die Leistungslücke zwischen Untergruppen. Fazit

Die Forscher schlugen eines der derzeit größten visuellen Transformer-Modelle vor, ViT-22B, das 22 Milliarden Parameter enthält.

Durch kleine, aber wichtige Änderungen an der ursprünglichen Modellarchitektur werden eine höhere Hardwareauslastung und Trainingsstabilität erreicht, was zu einem Modell führt, das die Obergrenzenleistung bei mehreren Benchmarks verbessert.

Durch die Verwendung eingefrorener Modelle zum Generieren von Einbettungen, bei denen nur ein paar Schichten darüber trainiert werden müssen, kann eine sehr gute Leistung erzielt werden. Die Bewertungsergebnisse zeigen außerdem, dass ViT-22B im Vergleich zu vorhandenen Modellen eine erhebliche Form- und Texturverzerrung aufweist. Größere Ähnlichkeit zur menschlichen visuellen Wahrnehmung und bietet Vorteile in Bezug auf Fairness und Robustheit.

Das obige ist der detaillierte Inhalt vonCV eröffnet die Ära der großen Modelle! Google veröffentlicht den größten ViT der Geschichte: 22 Milliarden Parameter, die visuelle Wahrnehmung kommt der des Menschen nahe. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr