Heim >Technologie-Peripheriegeräte >KI >Es dauert nur wenige Sekunden, ein Ausweisfoto in ein digitales Personenbild umzuwandeln. Microsoft hat den ersten hochwertigen Generierungseffekt eines 3D-Diffusionsmodells erreicht, und Sie können Ihr Erscheinungsbild und Ihr Erscheinungsbild in einem Satz ändern.

Es dauert nur wenige Sekunden, ein Ausweisfoto in ein digitales Personenbild umzuwandeln. Microsoft hat den ersten hochwertigen Generierungseffekt eines 3D-Diffusionsmodells erreicht, und Sie können Ihr Erscheinungsbild und Ihr Erscheinungsbild in einem Satz ändern.

- 青灯夜游nach vorne

- 2023-03-31 22:40:411343Durchsuche

Der Name dieses 3D-generierten Diffusionsmodells „Rodin“ ist vom französischen Bildhauer Auguste Rodin inspiriert.

Mit einem 2D-Ausweisfoto können Sie in nur wenigen Sekunden einen 3D-Spiel-Avatar entwerfen!

Dies ist die neueste Errungenschaft des Diffusionsmodells im 3D-Bereich. Zum Beispiel kann nur ein altes Foto des französischen Bildhauers Rodin ihn in wenigen Minuten in das Spiel „verwandeln“:

△RODIN-Modell ist ein 3D-Bild, das auf der Grundlage von Rodins altem Foto generiert wurde

Dafür ist sogar nur ein Satz Sie erforderlich kann Ihr Aussehen und Image verändern. Sagen Sie dem KI-generierten Rodin, er solle „einen roten Pullover und eine Brille tragen“:

Gefällt Ihnen der große Slickback nicht? Dann wechseln Sie zum „Flecht-Look“:

Versuchen Sie noch einmal, Ihre Haarfarbe zu ändern? Dies ist eine „modische, trendige Person mit braunen Haaren“, sogar die Bartfarbe ist festgelegt:

(„modische, trendige Person“ ist in den Augen der KI tatsächlich etwas zu trendy)

Das neueste 3D-generierte Diffusionsmodell oben „Rodin“ RODIN (Roll-out Diffusion Network), von Microsoft Research Asia.

RODIN ist auch das erste Modell, das das generative Diffusionsmodell verwendet, um automatisch 3D-Digital-Avatare (Avatar) auf 3D-Trainingsdaten zu generieren. Das Papier wurde von CVPR 2023 angenommen.

Lass uns einen Blick darauf werfen.

Trainieren Sie das Diffusionsmodell direkt mit 3D-Daten

Der Name dieses 3D-generierten Diffusionsmodells „Rodin“ ist vom französischen Bildhauer Auguste Rodin inspiriert.

Früher wurden 2D-generierte 3D-Bildmodelle normalerweise durch Training generativer gegnerischer Netzwerke (GAN) oder Variationaler Autoencoder (VAE) mit 2D-Daten erhalten, aber die Ergebnisse waren oft unbefriedigend.

Forscher haben analysiert, dass der Grund für dieses Phänomen darin liegt, dass diese Methoden ein grundlegendes, unterbestimmtes (schlecht gestelltes) Problem haben. Das heißt, aufgrund der geometrischen Mehrdeutigkeit von Einzelansichtsbildern ist es schwierig, die angemessene Verteilung hochwertiger 3D-Avatare nur anhand einer großen Menge an 2D-Daten zu erlernen, was zu schlechten Generierungsergebnissen führt.

Deshalb versuchten sie dieses Mal, 3D-Daten direkt zum Trainieren des Diffusionsmodells zu verwenden, was hauptsächlich drei Probleme löste:

Erstens, wie man das Diffusionsmodell verwendet, um Mehransichtsbilder des 3D-Modells zu erzeugen. Bisher gab es keine praktischen Methoden und Präzedenzfälle für Diffusionsmodelle auf 3D-Daten.- Zweitens ist es schwierig, qualitativ hochwertige und große 3D-Bilddatensätze zu erhalten, und es bestehen Datenschutz- und Urheberrechtsrisiken, aber die Konsistenz mehrerer Ansichten für im Internet veröffentlichte 3D-Bilder kann nicht garantiert werden.

- Abschließend wird das 2D-Diffusionsmodell direkt auf die 3D-Generierung erweitert, was einen enormen Speicher-, Speicher- und Rechenaufwand erfordert.

- Um diese drei Probleme zu lösen, schlugen die Forscher das RODIN-Diffusionsmodell „AI Sculptor“ vor, das das SOTA-Niveau bestehender Modelle übertrifft.

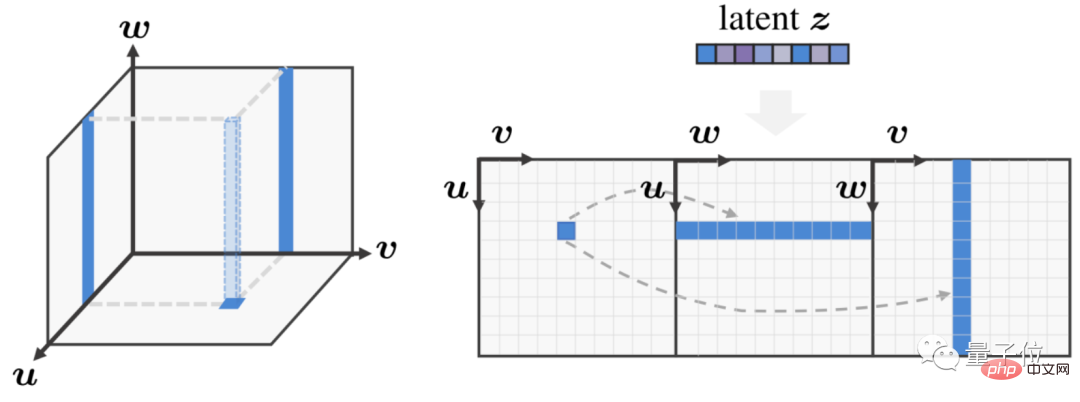

Das RODIN-Modell verwendet die Neural Radiation Field (NeRF)-Methode und stützt sich auf die EG3D-Arbeit von NVIDIA, um den 3D-Raum kompakt in drei zueinander senkrechten Merkmalsebenen (Triplanes) im Raum auszudrücken und diese Karten zu einer einzigen 2D-Merkmalsebene zu erweitern. Führen Sie dann eine 3D-Sensordiffusion durch.

Konkret geht es darum, den 3D-Raum mit zweidimensionalen Merkmalen auf drei orthogonalen Ebenenansichten der horizontalen, vertikalen und vertikalen Ebenen zu erweitern. Dadurch kann das RODIN-Modell nicht nur eine effiziente 2D-Architektur für die 3D-Wahrnehmungsdiffusion verwenden, sondern auch reduzieren Das 3D-Bild reduziert auch den Rechenaufwand und die Kosten erheblich.

△3D-Wahrnehmungsfaltung verarbeitet 3D-Merkmale effizient

△3D-Wahrnehmungsfaltung verarbeitet 3D-Merkmale effizient

Auf der linken Seite der obigen Abbildung wird eine Dreiebene verwendet, um den 3D-Raum auszudrücken. Zu diesem Zeitpunkt entsprechen die Merkmalspunkte der unteren Merkmalsebene den beiden Linien der anderen beiden Merkmalsebenen; Auf der rechten Seite der Abbildung oben wird die 3D-Wahrnehmungsfaltung eingeführt, um die erweiterte 2D-Merkmalsebene zu verarbeiten und dabei die dreidimensionale inhärente Entsprechung der drei Ebenen zu berücksichtigen.

Konkret sind drei Schlüsselelemente erforderlich, um die Generierung von 3D-Bildern zu erreichen:

Erstens stellt die 3D-bewusste Faltung die intrinsische Korrelation der drei Ebenen nach der Dimensionsreduktion sicher.Das in der herkömmlichen 2D-Diffusion verwendete 2D-Faltungs-Neuronale Netzwerk (CNN) verarbeitet Triplane-Feature-Maps nicht gut.

3D-fähige Faltung generiert nicht einfach drei 2D-Merkmalsebenen, sondern berücksichtigt bei der Verarbeitung solcher 3D-Ausdrücke ihre inhärenten dreidimensionalen Eigenschaften, das heißt, die 2D-Merkmale einer der drei Ansichtsebenen sind im Wesentlichen 3D-Raum Die Projektion einer Geraden Die Linie in der Ebene steht daher in Beziehung zu den entsprechenden geraden Projektionsmerkmalen in den anderen beiden Ebenen.

Um eine ebenenübergreifende Kommunikation zu erreichen, berücksichtigen Forscher solche 3D-Korrelationen in der Faltung und synthetisieren so 3D-Details effizient in 2D.

Zweitens Generation des dreidimensionalen 3D-Ausdrucks des Hidden-Space-Konzerts.

Forscher koordinieren die Merkmalsgenerierung durch latente Vektoren, um sie im gesamten dreidimensionalen Raum global konsistent zu machen, was zu qualitativ hochwertigeren Avataren und semantischer Bearbeitung führt.

Gleichzeitig wird auch ein zusätzlicher Bildencoder trainiert, indem die Bilder im Trainingsdatensatz verwendet werden, der semantische latente Vektoren als bedingte Eingaben für das Diffusionsmodell extrahieren kann.

Auf diese Weise kann das gesamte generative Netzwerk als Autoencoder betrachtet werden, der das Diffusionsmodell als dekodierenden latenten Raumvektor verwendet. Zur semantischen Bearbeitbarkeit verwendeten die Forscher einen eingefrorenen CLIP-Bild-Encoder, der den latenten Raum mit Textaufforderungen teilt.

Drittens erzeugt die hierarchische Synthese dreidimensionale Details mit hoher Wiedergabetreue.

Die Forscher verwendeten das Diffusionsmodell, um zunächst eine Drei-Ansichtsebene mit niedriger Auflösung (64×64) zu erzeugen, und erzeugten dann durch Diffusions-Upsampling eine hochauflösende Drei-Ansichtsebene (256×256).

Auf diese Weise konzentriert sich das grundlegende Diffusionsmodell auf die Generierung der gesamten 3D-Struktur, während sich das nachfolgende Upsampling-Modell auf die Detailgenerierung konzentriert.

Generieren Sie eine große Menge zufälliger Daten basierend auf Blender

Auf dem Trainingsdatensatz nutzten die Forscher die Open-Source-3D-Rendering-Software Blender, um von Künstlern manuell erstellte virtuelle 3D-Charakterbilder sowie eine große Anzahl von Haaren zufällig zu kombinieren. Kleidung, Gesichtsausdrücke und Accessoires und erstellte dann 100.000 synthetische Individuen, während für jedes Individuum 300 Mehrfachansichtsbilder mit einer Auflösung von 256*256 gerendert wurden.

Bei der Generierung von Text für 3D-Avatare verwendeten die Forscher die Porträt-Teilmenge des LAION-400M-Datensatzes, um die Zuordnung von der Eingabemodalität zum latenten Raum des 3D-Diffusionsmodells zu trainieren, und erlaubten schließlich die Verwendung des RODIN-Modells Mit nur einem 2D-Bild oder mit nur einer Textbeschreibung können Sie einen realistischen 3D-Avatar erstellen.

△Wenn Sie ein Foto erhalten, um einen Avatar zu generieren

, können Sie das Bild nicht nur in einem Satz ändern, z. B. „Ein Mann mit lockigem Haar und Bart, der eine schwarze Lederjacke trägt“:

Sie können sogar das Geschlecht nach Belieben ändern, „Frauen mit roter Kleidung und afrikanischen Frisuren“: (Manueller Hundekopf)

Die Forscher führten auch eine Anwendungsdemo vor, die nur ein paar Tasten erfordert:

△ Verwenden Sie Text, um eine 3D-Porträtbearbeitung zu erstellen

Für weitere Effekte können Sie auf die Projektadresse klicken, um sie anzuzeigen~

△Weitere zufällig generierte virtuelle Bilder

Nach der Erstellung von RODIN: Was kommt als nächstes für das Team? planen?

Laut den Autoren von Microsoft Research Asia konzentrieren sich RODINs aktuelle Arbeiten hauptsächlich auf 3D-Halbporträts, was auch damit zusammenhängt, dass für das Training hauptsächlich Gesichtsdaten verwendet werden, die Nachfrage nach 3D-Bilderzeugung jedoch nicht besteht auf menschliche Gesichter beschränkt.

Im nächsten Schritt wird das Team darüber nachdenken, RODIN-Modelle zu verwenden, um mehr 3D-Szenen zu erstellen, darunter Blumen, Bäume, Gebäude, Autos und Häuser usw., um das ultimative Ziel zu erreichen, „alles in 3D mit einem Modell zu generieren“. .

Papieradresse:

https://arxiv.org/abs/2212.06135

Projektseite:

https://3d-avatar-diffusion.microsoft.com

Das obige ist der detaillierte Inhalt vonEs dauert nur wenige Sekunden, ein Ausweisfoto in ein digitales Personenbild umzuwandeln. Microsoft hat den ersten hochwertigen Generierungseffekt eines 3D-Diffusionsmodells erreicht, und Sie können Ihr Erscheinungsbild und Ihr Erscheinungsbild in einem Satz ändern.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr