Heim >Java >javaLernprogramm >Zusammenfassung der Java-Wissenspunkte: Virtueller JDK19-Thread

Zusammenfassung der Java-Wissenspunkte: Virtueller JDK19-Thread

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2022-10-09 14:46:162709Durchsuche

Dieser Artikel vermittelt Ihnen relevantes Wissen über Java, das hauptsächlich den relevanten Inhalt über virtuelle Threads in jdk19 vorstellt. Virtuelle Threads haben eine ähnliche Implementierung wie die Goroutinen der Go-Sprache und den Prozess der Erlang-Sprache Werfen wir einen Blick darauf. Ich hoffe, es wird für alle hilfreich sein.

Empfohlenes Lernen: „Java-Video-Tutorial“

Einführung

Virtuelle Threads haben eine ähnliche Implementierung wie die Goroutinen der Go-Sprache und die Prozesse der Erlang-Sprache. Sie sind benutzerorientiert. Modus (Benutzermodus) eine Form von Thread.

In der Vergangenheit verwendete Java häufig Thread-Pools, um Plattform-Threads gemeinsam zu nutzen und so die Auslastung der Computer-Hardware zu verbessern. Bei diesem asynchronen Stil kann jedoch jede Phase der Anforderung auf einem anderen Thread ausgeführt werden, und jeder Thread beginnt mit der zugehörigen laufenden Phase Die verschachtelte Bearbeitung verschiedener Anfragen steht im Widerspruch zum Design der Java-Plattform, was zu Folgendem führt:

Der Stack-Trace stellt keinen nutzbaren Kontext bereit

Der Debugger kann die Anforderungsverarbeitungslogik nicht in einem Schritt durchlaufen

-

Analyzer Die Kosten einer Operation können nicht ihrem Anrufer zugeordnet werden.

Und virtuelle Threads bleiben mit dem Design der Plattform kompatibel und nutzen die Hardware optimal aus, ohne die Skalierbarkeit zu beeinträchtigen. Virtuelle Threads sind einfache Implementierungen von Threads, die vom JDK und nicht vom Betriebssystem bereitgestellt werden:

Virtuelle Threads sind Threads, die nicht an einen bestimmten Betriebssystem-Thread gebunden sind.

Plattform-Threads sind Threads, die auf herkömmliche Weise implementiert werden, als einfacher Wrapper um Betriebssystem-Threads.

Zusammenfassung

Einführung virtueller Threads in die Java-Plattform. Virtuelle Threads sind leichtgewichtige Threads, die den Aufwand für das Schreiben, Verwalten und Beobachten gleichzeitiger Anwendungen mit hohem Durchsatz erheblich reduzieren.

Ziel

ermöglicht die Skalierung von Serveranwendungen, die einfach mit einem Thread pro Anfrage geschrieben wurden, bei nahezu optimaler Hardwareauslastung.

Ermöglicht vorhandenen Code mithilfe von java.lang.ThreadAPI, virtuelle Threads mit minimalen Änderungen zu übernehmen.

Nutzen Sie vorhandene JDK-Tools, um virtuelle Threads einfach zu beheben, zu debuggen und zu analysieren.

Kein Ziel

Es ist kein Ziel, ältere Implementierungen von Threads zu entfernen oder bestehende Anwendungen zu migrieren, um virtuelle Threads zu verwenden.

Ändern Sie das grundlegende Parallelitätsmodell von Java.

Unser Ziel ist es nicht, neue datenparallele Strukturen in der Java-Sprache oder Java-Bibliotheken bereitzustellen. StreamAPI bleibt die bevorzugte Methode für die parallele Verarbeitung großer Datenmengen.

Motivation

Seit fast 30 Jahren verlassen sich Java-Entwickler auf Threads als Bausteine gleichzeitiger Serveranwendungen. Jede Anweisung in jeder Methode wird in einem Thread ausgeführt, und da Java Multithreading ist, werden mehrere Ausführungsthreads gleichzeitig ausgeführt.

Ein Thread ist die Parallelitätseinheit von Java: ein Stück sequentiellen Codes, der gleichzeitig mit und weitgehend unabhängig von anderen solchen Einheiten läuft.

Jeder Thread stellt einen Stapel bereit, um lokale Variablen zu speichern und Methodenaufrufe sowie den Kontext zu koordinieren, wenn ein Fehler auftritt: Ausnahmen werden von Methoden im selben Thread ausgelöst und abgefangen, sodass Entwickler den Stack-Trace des Threads verwenden können, um herauszufinden, was passiert passiert Was.

Threads sind ebenfalls ein Kernkonzept des Tools: Der Debugger geht die Anweisungen in Thread-Methoden durch und der Profiler visualisiert das Verhalten mehrerer Threads, um deren Leistung zu verstehen.

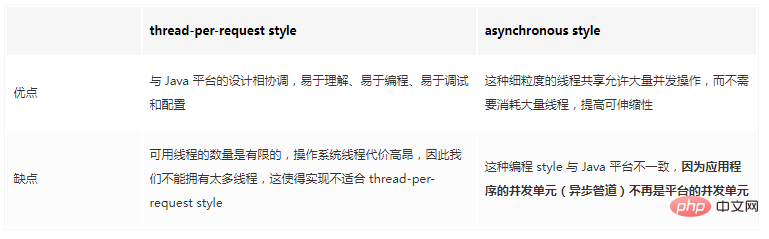

Zwei Parallelitätsstile

Thread-pro-Anfrage-Stil

Serveranwendungen verarbeiten normalerweise gleichzeitige Benutzeranfragen unabhängig voneinander, sodass die Anwendung die Anfrage verarbeitet, indem sie der Anfrage für die gesamte Dauer einen Thread zuweist Anfrage ist sinnvoll. Dieser Thread-on-Request-Stil ist leicht zu verstehen, leicht zu programmieren, leicht zu debuggen und einfach zu konfigurieren, da er die Parallelitätseinheiten der Plattform verwendet, um die Parallelitätseinheiten der Anwendung darzustellen.

Die Skalierbarkeit einer Serveranwendung wird durch das Little-Gesetz geregelt, das Latenz, Parallelität und Durchsatz in Beziehung setzt: Für eine bestimmte Dauer der Anforderungsverarbeitung (Latenz) muss die Anzahl der gleichzeitig verarbeiteten Anforderungen (Parallelität) der Anwendung proportional wachsen die Ankunftsrate (Durchsatz).

Angenommen, eine Anwendung mit einer durchschnittlichen Latenz von 50 ms erreicht einen Durchsatz von 200 Anfragen pro Sekunde, indem sie 10 Anfragen gleichzeitig verarbeitet. Damit die Anwendung einen Durchsatz von 2000 Anfragen pro Sekunde erreichen kann, müsste sie 100 Anfragen gleichzeitig verarbeiten. Wenn jede Anfrage für die Dauer der Anfrage in einem Thread verarbeitet wird, muss die Anzahl der Threads mit zunehmendem Durchsatz wachsen, damit die Anwendung mithalten kann.

Leider ist die Anzahl der verfügbaren Threads begrenzt, da das JDK Threads als Wrapper für Betriebssystem-Threads implementiert. Betriebssystem-Threads sind teuer, daher können wir nicht zu viele Threads haben, was die Implementierung für den Stil „Ein Thread pro Anfrage“ ungeeignet macht.

Wenn jede Anfrage für ihre Dauer einen Thread und damit einen Betriebssystem-Thread verbraucht, wird die Anzahl der Threads normalerweise zum limitierenden Faktor, lange bevor andere Ressourcen (wie CPU oder Netzwerkverbindungen) erschöpft sind. Die aktuelle Threading-Implementierung des JDK begrenzt den Anwendungsdurchsatz auf ein Niveau, das weit unter dem liegt, was die Hardware unterstützen kann. Dies geschieht sogar in Thread-Pools, da Pools dazu beitragen, die hohen Kosten für das Starten neuer Threads zu vermeiden, die Gesamtzahl der Threads jedoch nicht erhöhen.

asynchroner Stil

Einige Entwickler, die ihre Hardware voll ausnutzen möchten, haben den Thread-pro-Anfrage-Stil zugunsten eines Thread-Sharing-Stils aufgegeben.

Anstatt die Anforderung von Anfang bis Ende in einem Thread zu verarbeiten, gibt der Anforderungsverarbeitungscode seinen Thread an einen Pool zurück, während er auf den Abschluss des E/A-Vorgangs wartet, damit der Thread andere Anforderungen verarbeiten kann. Diese feinkörnige Thread-Freigabe (wobei der Code einen Thread nur während der Durchführung von Berechnungen reserviert, anstatt während des Wartens auf E/A) ermöglicht eine große Anzahl gleichzeitiger Vorgänge, ohne eine große Anzahl von Threads zu verbrauchen.

Obwohl dadurch die durch die Knappheit von Betriebssystem-Threads auferlegte Durchsatzbeschränkung aufgehoben wird, ist dies mit hohen Kosten verbunden: Es erfordert einen sogenannten asynchronen Programmierstil, der eine Reihe unabhängiger E/A-Methoden verwendet, die nicht auf E/A warten. O Der Vorgang wird abgeschlossen, sein Abschlusssignal wird jedoch zu einem späteren Zeitpunkt an den Rückruf gesendet. Ohne dedizierte Threads müssen Entwickler die Anforderungsverarbeitungslogik in kleine Phasen zerlegen, die normalerweise in Form von Lambda-Ausdrücken geschrieben sind, und diese dann in einer sequentiellen Pipeline mit einer API kombinieren (siehe beispielsweise CompletableFuture oder das sogenannte „ „Reagieren“-Framework „Sexualität“. Daher verzichten sie auf die grundlegenden sequentiellen Kompositionsoperatoren der Sprache, wie Schleifen und Try/Catch-Blöcke.

Im asynchronen Stil kann jede Phase einer Anfrage in einem anderen Thread ausgeführt werden, wobei jeder Thread Phasen verschachtelt ausführt, die zu verschiedenen Anfragen gehören. Dies hat tiefgreifende Auswirkungen auf das Verständnis des Programmverhaltens:

Der Stack-Trace stellt keinen verwendbaren Kontext bereit.

Der Debugger kann nicht in die Anforderungsverarbeitungslogik eingreifen.

Der Profiler kann die Kosten des Vorgangs nicht mit seinem Aufrufer korrelieren.

Das Kombinieren von Lambda-Ausdrücken ist überschaubar, wenn die Streaming-API von Java zum Verarbeiten von Daten in kurzen Pipelines verwendet wird, wird jedoch problematisch, wenn der gesamte Anforderungsverarbeitungscode in einer Anwendung auf diese Weise geschrieben werden muss. Dieser Programmierstil ist nicht mit der Java-Plattform vereinbar, da die Parallelitätseinheit der Anwendung (die asynchrone Pipe) nicht mehr die Parallelitätseinheit der Plattform ist.

Vergleich

Verwendung virtueller Threads, um den Thread-pro-Anfrage-Stil beizubehalten

Damit die Anwendung skaliert und gleichzeitig die Harmonie mit der Plattform gewahrt bleibt, sollten wir mehr tun Effizient Threads werden implementiert, um zu versuchen, den Ein-Thread-pro-Anfrage-Stil beizubehalten, damit sie umfangreicher sind.

Das Betriebssystem kann Betriebssystem-Threads nicht effizienter implementieren, da verschiedene Sprachen und Laufzeiten Thread-Stacks auf unterschiedliche Weise verwenden. Allerdings kann die Art und Weise, wie die Java-Laufzeit Java-Threads implementiert, die Eins-zu-eins-Entsprechung zwischen ihnen und Betriebssystem-Threads beeinträchtigen. So wie das Betriebssystem die Illusion ausreichenden Speichers vermittelt, indem es eine große Menge an virtuellem Adressraum einer begrenzten Menge an physischem RAM zuordnet, kann die Java-Laufzeitumgebung auch die Illusion ausreichender Threads erwecken, indem sie eine große Anzahl virtueller Threads einer kleinen Menge zuordnet Anzahl der Betriebssystem-Threads.

Ein virtueller Thread ist ein Thread, der nicht an einen bestimmten Betriebssystem-Thread gebunden ist.

Plattform-Threads sind Threads, die auf herkömmliche Weise implementiert werden, als einfacher Wrapper um Betriebssystem-Threads.

Anwendungscode im Thread-pro-Anfrage-Stil kann für die gesamte Anforderung in einem virtuellen Thread ausgeführt werden, ein virtueller Thread verwendet jedoch nur Betriebssystem-Threads, wenn er Berechnungen auf der CPU durchführt. Das Ergebnis ist die gleiche Skalierbarkeit wie der asynchrone Stil, außer dass er transparent implementiert wird:

Wenn Code, der in einem virtuellen Thread ausgeführt wird, eine blockierende E/A-Operation in der Java.*-API aufruft, führt die Laufzeit ein nicht blockierendes Betriebssystem aus Aufruf und unterbricht den virtuellen Thread automatisch, bis er später wieder aufgenommen werden kann.

Für Java-Entwickler sind virtuelle Threads Threads, die kostengünstig zu erstellen sind und eine nahezu unendliche Anzahl haben. Die Hardwareauslastung ist nahezu optimal und ermöglicht ein hohes Maß an Parallelität, wodurch der Durchsatz erhöht wird, während die Anwendungen im Einklang mit dem Multithread-Design der Java-Plattform und ihrer Tools bleiben.

Bedeutung virtueller Threads

Virtuelle Threads sind billig und reichlich vorhanden und sollten daher niemals geteilt werden (d. h. unter Verwendung eines Thread-Pools): Für jede Anwendungsaufgabe sollte ein neuer virtueller Thread erstellt werden.

Daher sind die meisten virtuellen Threads kurzlebig und verfügen über flache Aufrufstapel, die nur einen einzigen HTTP-Client-Aufruf oder eine einzelne JDBC-Abfrage ausführen. Im Gegensatz dazu sind Plattform-Threads schwergewichtig und teuer und müssen daher häufig gemeinsam genutzt werden. Sie sind in der Regel langlebig, verfügen über große Aufrufstapel und werden von vielen Aufgaben gemeinsam genutzt.

Kurz gesagt behalten virtuelle Threads einen zuverlässigen Thread-pro-Anfrage-Stil bei, der mit dem Design der Java-Plattform übereinstimmt und gleichzeitig die Hardware optimal nutzt. Die Verwendung virtueller Threads erfordert nicht das Erlernen neuer Konzepte, erfordert jedoch möglicherweise das Verlernen von Gewohnheiten, die als Reaktion auf die hohen Kosten heutiger Threads entwickelt wurden. Virtuelle Threads helfen nicht nur Anwendungsentwicklern, sondern auch Framework-Designern, benutzerfreundliche APIs bereitzustellen, die mit dem Design der Plattform kompatibel sind, ohne die Skalierbarkeit zu beeinträchtigen.

Beschreibung

Heute jede Instanz von java.lang. Ein Thread im JDK ist ein Plattform-Thread. Plattform-Threads führen Java-Code auf zugrunde liegenden Betriebssystem-Threads aus und erfassen Betriebssystem-Threads während der gesamten Lebensdauer des Codes. Die Anzahl der Plattform-Threads ist auf die Anzahl der Betriebssystem-Threads begrenzt.

Virtual Thread ist eine Instanz von java.lang. Ein Thread, der Java-Code auf dem zugrunde liegenden Betriebssystem-Thread ausführt, diesen Betriebssystem-Thread jedoch während der gesamten Lebensdauer des Codes nicht erfasst. Dies bedeutet, dass viele virtuelle Threads ihren Java-Code auf demselben Betriebssystem-Thread ausführen und ihn somit effektiv gemeinsam nutzen können. Der Plattform-Thread monopolisiert einen wertvollen Betriebssystem-Thread, der virtuelle Thread jedoch nicht. Die Anzahl der virtuellen Threads kann viel größer sein als die Anzahl der Betriebssystem-Threads.

Virtuelle Threads sind einfache Implementierungen von Threads, die vom JDK und nicht vom Betriebssystem bereitgestellt werden. Sie sind eine Form von Benutzermodus-Threads, die in anderen Multithread-Sprachen erfolgreich waren (z. B. Goroutinen in Go und Prozesse in Erlang). Benutzermodus-Threads verfügten in frühen Java-Versionen sogar über sogenannte „grüne Threads“, bevor Betriebssystem-Threads ausgereift und beliebt waren. Die grünen Threads von Java teilen sich jedoch alle einen Betriebssystem-Thread (M:1-Planung) und werden schließlich von Plattform-Threads überholt und als Wrapper für Betriebssystem-Threads implementiert (1:1-Planung). Virtuelle Threads verwenden die M:N-Planung, bei der eine große Anzahl (M) virtueller Threads für die Ausführung auf weniger (N) Betriebssystem-Threads geplant ist.

Virtuelle Threads VS. Plattform-Threads

Einfaches Beispiel

Entwickler können wählen, ob sie virtuelle Threads oder Plattform-Threads verwenden möchten. Nachfolgend finden Sie ein Beispielprogramm, das eine große Anzahl virtueller Threads erstellt. Das Programm erhält zunächst einen ExecutorService, der für jede übermittelte Aufgabe einen neuen virtuellen Thread erstellt. Anschließend übermittelt es 10.000 Aufgaben und wartet darauf, dass sie alle abgeschlossen sind:

try (var executor = Executors.newVirtualThreadPerTaskExecutor()) {

IntStream.range(0, 10000).forEach(i -> {

executor.submit(() -> {

Thread.sleep(Duration.ofSeconds(1));

return i;

});

});

} // executor.close() is called implicitly, and waitsDie Aufgaben in diesem Beispiel sind einfacher Code (eine Sekunde lang im Ruhezustand), den moderne Hardware problemlos unterstützen kann, wenn 10.000 virtuelle Threads gleichzeitig ausgeführt werden. Hinter den Kulissen führt das JDK Code auf einer Handvoll Betriebssystem-Threads aus, möglicherweise nur auf einem.

Wenn dieses Programm ExecutorService verwendet, um für jede Aufgabe einen neuen Plattformthread zu erstellen, z. B. Executors.newCachedThreadPool(), dann wird die Situation ganz anders sein. Der ExecutorService versucht, 10.000 Plattform-Threads und somit 10.000 Betriebssystem-Threads zu erstellen, und das Programm kann je nach Computer und Betriebssystem abstürzen.

Im Gegenteil, wenn das Programm einen ExecutorService verwendet, der den Plattform-Thread aus dem Pool abruft (z. B. Executors.newFixedThreadPool (200)), wird die Situation nicht viel besser sein. Der ExecutorService erstellt 200 Plattformthreads, die von allen 10.000 Aufgaben gemeinsam genutzt werden, sodass viele Aufgaben nacheinander und nicht gleichzeitig ausgeführt werden und die Ausführung des Programms lange dauern wird. Für dieses Programm erreichte ein Pool von 200 Plattform-Threads nur einen Durchsatz von 200 Aufgaben pro Sekunde, während die virtuellen Threads einen Durchsatz von 10.000 Aufgaben pro Sekunde erreichten (nach ausreichender Aufwärmphase). Wenn außerdem die 10.000 im Beispielprogramm in 1.000.000 geändert würde, würde das Programm 1.000.000 Aufgaben übermitteln, 1.000.000 gleichzeitig laufende virtuelle Threads erstellen und (nach ausreichender Aufwärmphase) einen Durchsatz von etwa 1.000.000 Aufgaben/Sekunde erreichen.

Wenn die Aufgaben in diesem Programm eine einsekündige Berechnung durchführen (z. B. ein riesiges Array sortieren), anstatt nur zu schlafen, hilft es nicht, die Anzahl der Threads über die Anzahl der Prozessorkerne hinaus zu erhöhen, unabhängig davon, ob es sich um virtuelle Threads oder Plattform-Threads handelt .

虚拟线程并不是更快的线程ーー它们运行代码的速度并不比平台线程快。它们的存在是为了提供规模(更高的吞吐量) ,而不是速度(更低的延迟) 。它们的数量可能比平台线程多得多,因此根据 Little’s Law,它们能够实现更高吞吐量所需的更高并发性。

换句话说,虚拟线程可以显著提高应用程序的吞吐量,在如下情况时:

并发任务的数量很多(超过几千个)

工作负载不受 CPU 限制,因为在这种情况下,比处理器核心拥有更多的线程并不能提高吞吐量

虚拟线程有助于提高典型服务器应用程序的吞吐量,因为这类应用程序由大量并发任务组成,这些任务花费了大量时间等待。

虚拟线程可以运行平台线程可以运行的任何代码。特别是,虚拟线程支持线程本地变量和线程中断,就像平台线程一样。这意味着处理请求的现有 Java 代码很容易在虚拟线程中运行。许多服务器框架将选择自动执行此操作,为每个传入请求启动一个新的虚拟线程,并在其中运行应用程序的业务逻辑。

下面是一个服务器应用程序示例,它聚合了另外两个服务的结果。假设的服务器框架(未显示)为每个请求创建一个新的虚拟线程,并在该虚拟线程中运行应用程序的句柄代码。然后,应用程序代码创建两个新的虚拟线程,通过与第一个示例相同的 ExecutorService 并发地获取资源:

void handle(Request request, Response response) {

var url1 = ...

var url2 = ...

try (var executor = Executors.newVirtualThreadPerTaskExecutor()) {

var future1 = executor.submit(() -> fetchURL(url1));

var future2 = executor.submit(() -> fetchURL(url2));

response.send(future1.get() + future2.get());

} catch (ExecutionException | InterruptedException e) {

response.fail(e);

}

}

String fetchURL(URL url) throws IOException {

try (var in = url.openStream()) {

return new String(in.readAllBytes(), StandardCharsets.UTF_8);

}

}这样的服务器应用程序使用简单的阻塞代码,可以很好地扩展,因为它可以使用大量虚拟线程。

NewVirtualThreadPerTaskExector ()并不是创建虚拟线程的唯一方法。新的 java.lang.Thread.Builder。可以创建和启动虚拟线程。此外,结构化并发提供了一个更强大的 API 来创建和管理虚拟线程,特别是在类似于这个服务器示例的代码中,通过这个 API,平台及其工具可以了解线程之间的关系。

虚拟线程是一个预览 API,默认情况下是禁用的

上面的程序使用 Executors.newVirtualThreadPerTaskExector ()方法,因此要在 JDK 19上运行它们,必须启用以下预览 API:

使用javac --release 19 --enable-preview Main.java编译该程序,并使用 java --enable-preview Main 运行该程序;或者:

在使用源代码启动程序时,使用 java --source 19 --enable-preview Main.java 运行程序; 或者:

在使用 jshell 时,使用 jshell --enable-preview 启动它。

不要共享(pool)虚拟线程

开发人员通常会将应用程序代码从传统的基于线程池的 ExecutorService 迁移到每个任务一个虚拟线程的 ExecutorService。与所有资源池一样,线程池旨在共享昂贵的资源,但虚拟线程并不昂贵,而且从不需要共享它们。

开发人员有时使用线程池来限制对有限资源的并发访问。例如,如果一个服务不能处理超过20个并发请求,那么通过提交给大小为 20 的池的任务将确保执行对该服务的所有访问。因为平台线程的高成本使得线程池无处不在,所以这个习惯用法也变得无处不在,但是开发人员不应该为了限制并发性而将虚拟线程集中起来。应该使用专门为此目的设计的构造(如信号量semaphores)来保护对有限资源的访问。这比线程池更有效、更方便,也更安全,因为不存在线程本地数据从一个任务意外泄漏到另一个任务的风险。

观测

编写清晰的代码并不是故事的全部。对于故障排除、维护和优化来说,清晰地表示正在运行的程序的状态也是必不可少的,JDK 长期以来一直提供调试、概要分析和监视线程的机制。这样的工具对虚拟线程也应该这样做ーー也许要适应它们的大量数据ーー因为它们毕竟是 java.lang.Thread 的实例。

Java 调试器可以单步执行虚拟线程、显示调用堆栈和检查堆栈帧中的变量。JDK Flight Recorder (JFR) 是 JDK 的低开销分析和监视机制,可以将来自应用程序代码的事件(比如对象分配和 I/O 操作)与正确的虚拟线程关联起来。

这些工具不能为以异步样式编写的应用程序做这些事情。在这种风格中,任务与线程无关,因此调试器不能显示或操作任务的状态,分析器也不能告诉任务等待 I/O 所花费的时间。

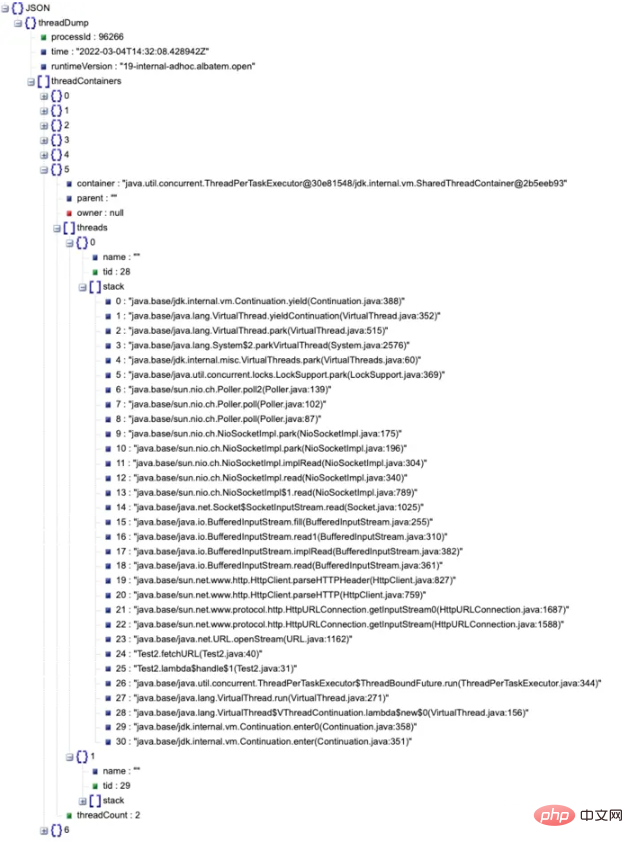

线程转储( thread dump) 是另一种流行的工具,用于以每个请求一个线程的样式编写的应用程序的故障排除。遗憾的是,通过 jstack 或 jcmd 获得的 JDK 传统线程转储提供了一个扁平的线程列表。这适用于数十或数百个平台线程,但不适用于数千或数百万个虚拟线程。因此,我们将不会扩展传统的线程转储以包含虚拟线程,而是在 jcmd 中引入一种新的线程转储,以显示平台线程旁边的虚拟线程,所有这些线程都以一种有意义的方式进行分组。当程序使用结构化并发时,可以显示线程之间更丰富的关系。

因为可视化和分析大量的线程可以从工具中受益,所以 jcmd 除了纯文本之外,还可以发布 JSON 格式的新线程转储:

$ jcmd <pid> Thread.dump_to_file -format=json <file>

新的线程转储格式列出了在网络 I/O 操作中被阻塞的虚拟线程,以及由上面所示的 new-thread-per-task ExecutorService 创建的虚拟线程。它不包括对象地址、锁、 JNI 统计信息、堆统计信息以及传统线程转储中出现的其他信息。此外,由于可能需要列出大量线程,因此生成新的线程转储并不会暂停应用程序。

下面是这样一个线程转储的示例,它取自类似于上面第二个示例的应用程序,在 JSON 查看器中呈现 :

由于虚拟线程是在 JDK 中实现的,并且不绑定到任何特定的操作系统线程,因此它们对操作系统是不可见的,操作系统不知道它们的存在。操作系统级别的监视将观察到,JDK 进程使用的操作系统线程比虚拟线程少。

调度

为了完成有用的工作,需要调度一个线程,也就是分配给处理器核心执行。对于作为 OS 线程实现的平台线程,JDK 依赖于 OS 中的调度程序。相比之下,对于虚拟线程,JDK 有自己的调度程序。JDK 的调度程序不直接将虚拟线程分配给处理器,而是将虚拟线程分配给平台线程(这是前面提到的虚拟线程的 M: N 调度)。然后,操作系统像往常一样调度平台线程。

JDK 的虚拟线程调度程序是一个在 FIFO 模式下运行的工作窃取(work-stealing) 的 ForkJoinPool。调度程序的并行性是可用于调度虚拟线程的平台线程的数量。默认情况下,它等于可用处理器的数量,但是可以使用系统属性 jdk.viralThreadScheduler.allelism 对其进行调优。注意,这个 ForkJoinPool 不同于公共池,例如,公共池用于并行流的实现,公共池以 LIFO 模式运行。

虚拟线程无法获得载体(即负责调度虚拟线程的平台线程)的标识。由 Thread.currentThread ()返回的值始终是虚拟线程本身。

载体和虚拟线程的堆栈跟踪是分离的。在虚拟线程中抛出的异常将不包括载体的堆栈帧。线程转储不会显示虚拟线程堆栈中其载体的堆栈帧,反之亦然。

虚拟线程不能使用载体的线程本地变量,反之亦然。

此外,从 Java 代码的角度来看,虚拟线程及其载体平台线程临时共享操作系统线程的事实是不存在的。相比之下,从本机代码的角度来看,虚拟线程及其载体都在同一个本机线程上运行。因此,在同一虚拟线程上多次调用的本机代码可能会在每次调用时观察到不同的 OS 线程标识符。

调度程序当前没有实现虚拟线程的时间共享。分时是对消耗了分配的 CPU 时间的线程的强制抢占。虽然在平台线程数量相对较少且 CPU 利用率为100% 的情况下,分时可以有效地减少某些任务的延迟,但是对于一百万个虚拟线程来说,分时是否有效尚不清楚。

执行

要利用虚拟线程,不必重写程序。虚拟线程不需要或期望应用程序代码显式地将控制权交还给调度程序; 换句话说,虚拟线程不是可协作的。用户代码不能假设如何或何时将虚拟线程分配给平台线程,就像它不能假设如何或何时将平台线程分配给处理器核心一样。

为了在虚拟线程中运行代码,JDK 的虚拟线程调度程序通过将虚拟线程挂载到平台线程上来分配要在平台线程上执行的虚拟线程。这使得平台线程成为虚拟线程的载体。稍后,在运行一些代码之后,虚拟线程可以从其载体卸载。此时平台线程是空闲的,因此调度程序可以在其上挂载不同的虚拟线程,从而使其再次成为载体。

通常,当虚拟线程阻塞 I/O 或 JDK 中的其他阻塞操作(如 BlockingQueue.take ())时,它将卸载。当阻塞操作准备完成时(例如,在套接字上已经接收到字节) ,它将虚拟线程提交回调度程序,调度程序将在运营商上挂载虚拟线程以恢复执行。

虚拟线程的挂载和卸载频繁且透明,并且不会阻塞任何 OS 线程。例如,前面显示的服务器应用程序包含以下代码行,其中包含对阻塞操作的调用:

response.send(future1.get() + future2.get());

这些操作将导致虚拟线程多次挂载和卸载,通常每个 get ()调用一次,在 send (...)中执行 I/O 过程中可能多次挂载和卸载。

JDK 中的绝大多数阻塞操作将卸载虚拟线程,从而释放其载体和底层操作系统线程,使其承担新的工作。但是,JDK 中的一些阻塞操作不会卸载虚拟线程,因此阻塞了其载体和底层 OS 线程。这是由于操作系统级别(例如,许多文件系统操作)或 JDK 级别(例如,Object.wait ())的限制造成的。这些阻塞操作的实现将通过暂时扩展调度程序的并行性来补偿对 OS 线程的捕获。因此,调度程序的 ForkJoinPool 中的平台线程的数量可能会暂时超过可用处理器的数量。可以使用系统属性 jdk.viralThreadScheduler.maxPoolSize 调优调度程序可用的最大平台线程数。

有两种情况下,在阻塞操作期间无法卸载虚拟线程,因为它被固定在其载体上:

当它在同步块或方法内执行代码时,或

当它执行本机方法或外部函数时。

固定并不会导致应用程序不正确,但它可能会妨碍应用程序的可伸缩性。如果虚拟线程在固定时执行阻塞操作(如 I/O 或 BlockingQueue.take () ) ,那么它的载体和底层操作系统线程将在操作期间被阻塞。长时间的频繁固定会通过捕获运营商而损害应用程序的可伸缩性。

调度程序不会通过扩展其并行性来补偿固定。相反,可以通过修改频繁运行的同步块或方法来避免频繁和长时间的固定,并保护潜在的长 I/O 操作来使用 java.util.concurrent.locks.ReentrantLock。不需要替换不常使用的同步块和方法(例如,只在启动时执行)或保护内存操作的同步块和方法。一如既往,努力保持锁定策略的简单明了。

新的诊断有助于将代码迁移到虚拟线程,以及评估是否应该使用 java.util.concurrent lock 替换同步的特定用法:

当线程在固定时阻塞时,会发出 JDK JFR事件。

当线程在固定时阻塞时,系统属性 jdk.tracePinnedThreads 触发堆栈跟踪。使用-Djdk.tracePinnedThreads = full 运行会在线程被固定时打印一个完整的堆栈跟踪,并突出显示保存监视器的本机框架和框架。使用-Djdk.tracePinnedThreads = short 将输出限制为有问题的帧。

内存使用和垃圾回收

虚拟线程的堆栈作为堆栈块对象存储在 Java 的垃圾回收堆中。堆栈随着应用程序的运行而增长和缩小,这既是为了提高内存效率,也是为了容纳任意深度的堆栈(直到 JVM 配置的平台线程堆栈大小)。这种效率支持大量的虚拟线程,因此服务器应用程序中每个请求一个线程的风格可以继续存在。

在上面的第二个例子中,回想一下,一个假设的框架通过创建一个新的虚拟线程并调用 handle 方法来处理每个请求; 即使它在深度调用堆栈的末尾调用 handle (在身份验证、事务处理等之后) ,handle 本身也会产生多个虚拟线程,这些虚拟线程只执行短暂的任务。因此,对于每个具有深层调用堆栈的虚拟线程,都会有多个具有浅层调用堆栈的虚拟线程,这些虚拟线程消耗的内存很少。

通常,虚拟线程所需的堆空间和垃圾收集器活动的数量很难与异步代码的数量相比较。一百万个虚拟线程至少需要一百万个对象,但是共享一个平台线程池的一百万个任务也需要一百万个对象。此外,处理请求的应用程序代码通常跨 I/O 操作维护数据。每个请求一个线程的代码可以将这些数据保存在本地变量中:

这些本地变量存储在堆中的虚拟线程堆栈中

异步代码必须将这些数据保存在从管道的一个阶段传递到下一个阶段的堆对象中

一方面,虚拟线程需要的堆栈帧布局比紧凑对象更浪费; 另一方面,虚拟线程可以在许多情况下变异和重用它们的堆栈(取决于低级 GC 交互) ,而异步管道总是需要分配新对象,因此虚拟线程可能需要更少的分配。

总的来说,每个请求线程与异步代码的堆消耗和垃圾收集器活动应该大致相似。随着时间的推移,我们希望使虚拟线程堆栈的内部表示更加紧凑。

与平台线程堆栈不同,虚拟线程堆栈不是 GC 根,所以它们中包含的引用不会被执行并发堆扫描的垃圾收集器(比如 G1)在 stop-the-world 暂停中遍历。这也意味着,如果一个虚拟线程被阻塞,例如 BlockingQueue.take () ,并且没有其他线程可以获得对虚拟线程或队列的引用,那么线程就可以被垃圾收集ーー这很好,因为虚拟线程永远不会被中断或解除阻塞。当然,如果虚拟线程正在运行,或者它被阻塞并且可能被解除阻塞,那么它将不会被垃圾收集。

当前虚拟线程的一个限制是 G1 GC 不支持大型堆栈块对象。如果虚拟线程的堆栈达到区域大小的一半(可能小到512KB) ,那么可能会抛出 StackOverfloError。

具体变化

java.lang.Thread

Thread.Builder, Thread.ofVirtual(), 和 Thread.ofPlatform() 是创建虚拟线程和平台线程的新 API,例如:

Thread thread = Thread.ofVirtual().name("duke").unstarted(runnable);创建一个新的未启动的虚拟线程“ duke”。

Thread.startVirtualThread(Runnable) 是创建然后启动虚拟线程的一种方便的方法。

Thread.Builder 可以创建线程或 ThreadFactory, 后者可以创建具有相同属性的多个线程。

Thread.isVirtual() 测试是否一个线程是一个虚拟的线程。

Thread.join 和 Thread.sleep 的新重载接受等待和睡眠时间作为java.time.Duration的实例。

新的 final 方法 Thread.threadId() 返回线程的标识符。现在不推荐使用现有的非 final 方法 Thread.getId() 。

Thread.getAllStackTraces() 现在返回所有平台线程的映射,而不是所有线程的映射。

java.lang.Thread API其他方面没有改变。构造器也无新变化。

虚拟线程和平台线程之间的主要 API 差异是:

公共线程构造函数不能创建虚拟线程。

虚拟线程始终是守护进程线程,Thread.setDaemon (boolean)方法不能将虚拟线程更改为非守护进程线程。

虚拟线程有一个固定的 Thread.NORM_PRIORITY 优先级。Thread.setPriority(int)方法对虚拟线程没有影响。在将来的版本中可能会重新讨论这个限制。

虚拟线程不是线程组的活动成员。在虚拟线程上调用时,Thread.getThreadGroup() 返回一个名为“ VirtualThreads”的占位符线程组。The Thread.Builder API 不定义设置虚拟线程的线程组的方法。

使用 SecurityManager 集运行时,虚拟线程没有权限。

虚拟线程不支持 stop(), suspend(), 或 resume()方法。这些方法在虚拟线程上调用时引发异常。

Thread-local variables

虚拟线程支持线程局部变量(ThreadLocal)和可继承的线程局部变量(InheritableThreadLocal) ,就像平台线程一样,因此它们可以运行使用线程局部变量的现有代码。但是,由于虚拟线程可能非常多,所以应该在仔细考虑之后使用线程局部变量。

特别是,不要使用线程局部变量在线程池中共享同一线程的多个任务之间共享昂贵的资源。虚拟线程永远不应该被共享,因为每个线程在其生存期内只能运行一个任务。我们已经从 java.base 模块中移除了许多线程局部变量的使用,以便为虚拟线程做准备,从而减少在使用数百万个线程运行时的内存占用。

此外:

The Thread.Builder API 定义了一个在创建线程时选择不使用线程局部变量的方法(a method to opt-out of thread locals when creating a thread)。它还定义了一个方法来选择不继承可继承线程局部变量的初始值( a method to opt-out of inheriting the initial value of inheritable thread-locals)。当从不支持线程局部变量的线程调用时, ThreadLocal.get()返回初始值,ThreadLocal.set(T) 抛出异常。

遗留上下文类加载器( context class loader)现在被指定为像可继承的线程本地一样工作。如果在不支持线程局部变量的线程上调用 Thread.setContextClassLoader(ClassLoader),那么它将引发异常。

Networking

Die Netzwerk-API-Implementierung in den Paketen java.net und java.nio.channels funktioniert jetzt mit virtuellen Threads: Eine Operation, die den virtuellen Thread blockiert, z. B. das Herstellen einer Netzwerkverbindung oder das Lesen von einem Socket, gibt den zugrunde liegenden Plattform-Thread frei Machen Sie andere Arbeiten.

Um Unterbrechung und Abbruch zu ermöglichen, werden die durch java.net.Socket, ServerSocket und DatagramSocket definierten blockierenden E/A-Methoden jetzt als unterbrechbar gekennzeichnet, wenn sie in einem virtuellen Thread aufgerufen werden: Ein virtueller Thread, der an einem Interrupt-Socket blockiert ist, gibt den Thread frei und Schließen Sie die Steckdose.

Blockierende E/A-Vorgänge auf diesen Socket-Typen sind immer unterbrechbar, wenn sie von InterruptibleChannel abgerufen werden. Diese Änderung bringt das Verhalten dieser APIs bei der Erstellung daher in Einklang mit dem Verhalten des Konstruktors, wenn sie vom Kanal abgerufen werden.

java.io

Das Paket java.io stellt APIs für Byte- und Zeichenströme bereit. Die Implementierung dieser APIs ist hochgradig synchron und muss geändert werden, um zu vermeiden, dass sie für die Verwendung in virtuellen Threads fixiert werden.

Unter der Haube sind Byte-orientierte Ein-/Ausgabeströme nicht als Thread-sicher spezifiziert, und auch nicht das erwartete Verhalten beim Aufruf von close() beim Blockieren eines Threads in einer Lese- oder Schreibmethode. In den meisten Fällen macht es keinen Sinn, einen bestimmten Eingabe- oder Ausgabestream von mehreren gleichzeitigen Threads zu verwenden. Auch zeichenorientierte Lese-/Schreibprogramme sind nicht als Thread-sicher spezifiziert, sie stellen jedoch ein Sperrobjekt für Unterklassen bereit. Zusätzlich zur Behebung gibt es Probleme und Inkonsistenzen bei der Synchronisierung in diesen Klassen. Beispielsweise synchronisieren sich die von InputStreamReader und OutputStreamWriter verwendeten Stream-Decoder und -Encoder auf Stream-Objekte und nicht auf Sperrobjekte.

Um das Anheften zu verhindern, lautet die Implementierung jetzt wie folgt:

BufferedInputStream, BufferedOutputStream, BufferedReader, BufferedWriter, PrintStream und PrintWriter verwenden bei direkter Verwendung jetzt explizite Sperren anstelle von Monitoren. Wenn diese Klassen in Unterklassen unterteilt werden, werden sie wie zuvor synchronisiert.

Stream-Decoder und -Encoder, die von InputStreamReader und OutputStreamWriter verwendet werden, verwenden jetzt dieselben Sperren wie der umschließende InputStreamReader oder OutputStreamWriter.

Einen Schritt weiter zu gehen und all diese oft unnötigen Lock-ins zu beseitigen, würde den Rahmen dieses Artikels sprengen.

Darüber hinaus ist die anfängliche Größe der Puffer, die von den Stream-Encodern von BufferedOutputStream, BufferedWriter und OutputStreamWriter verwendet werden, jetzt kleiner, um die Speichernutzung zu reduzieren, wenn sich viele Streams oder Writer im Heap befinden – wenn es eine Million virtuelle Threads gibt, die jeder Thread hat ein Pufferstrom auf der Socket-Verbindung, daher kann diese Situation auftreten

Empfohlenes Lernen: „Java-Video-Tutorial“

Das obige ist der detaillierte Inhalt vonZusammenfassung der Java-Wissenspunkte: Virtueller JDK19-Thread. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!