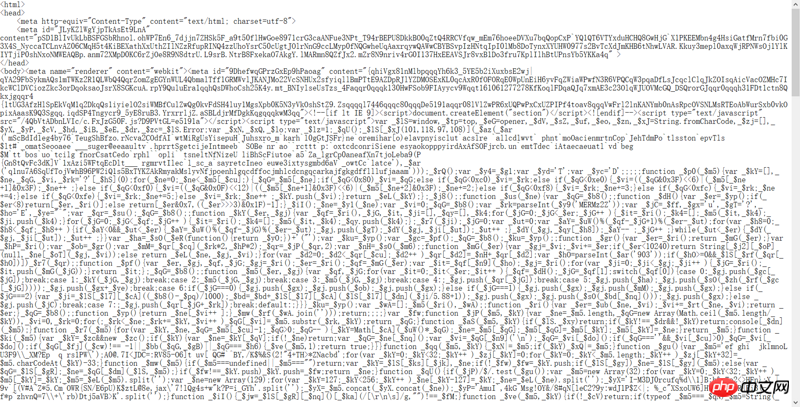

**之前有在裁判文书上爬取数据,这段时间重新运行爬虫后发现无法获取网页数据,

找了一下发现requests网页源码返回的是乱码**

(如下截取一部分返回的数据:<meta http-equiv="Content-Type" content="text/html; charset=utf-8">

<meta id="JLyKZlWgYjpTkAsEt9LnA" )

不知道是不是网站对网页内容进行了加密,请问如何解决这个问题?谢谢!

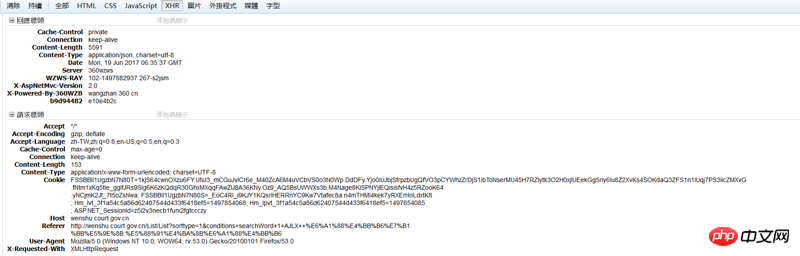

截取部分程序源码:

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/59.0.3071.104 Safari/537.36',

'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8',

'Accept-Language': 'zh-TW,zh;q=0.8,en-US;q=0.6,en;q=0.4',

'Accept-Encoding': 'gzip, deflate',

'Connection': 'keep-alive',

'Content-Type': 'text/html; charset=utf-8'}

html = requests.post('http://wenshu.court.gov.cn/List/ListContent', data=data, headers=headers)

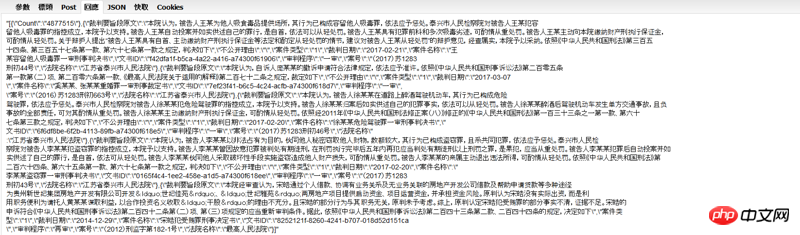

print(html.text)但是在审查元素里返回应该返回的数据,请问这哪里出现了问题?

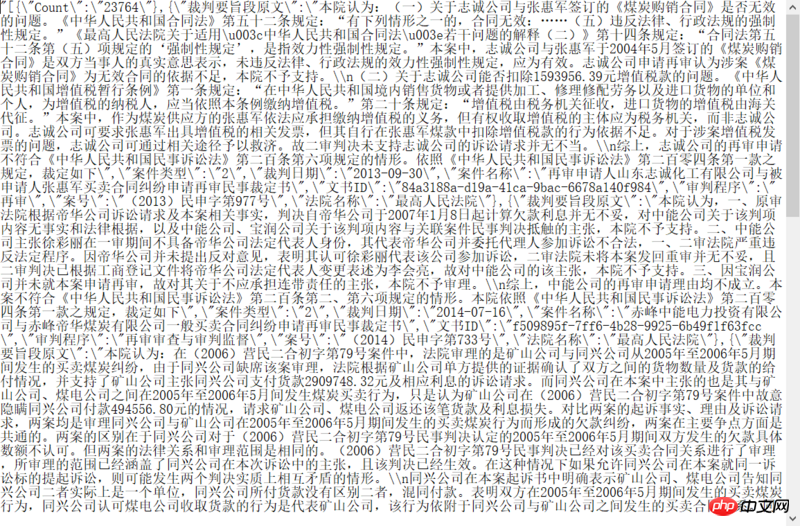

之前程序正常运行时返回的数据是这样的:

高洛峰2017-06-22 11:53:56

你的 html 对象使用的编码不对,

加入一行 html.encoding = html.apparent_encoding

根据实际获取的 text 推测编码,重新解码。