全面突围,谷歌昨晚更新了一大波大模型产品

- 王林转载

- 2024-04-10 14:34:091537浏览

这周二,谷歌在Google的Cloud Next 2024上发布了一系列AI相关的模型更新和产品,其中包括Gemini 1.5 Pro首次提供了本地语音(语音)理解功能、代码生成新模型CodeGemma、首款自研Arm处理器Axion等等。

Gemini 1.5 Pro

Gemini 1.5 Pro是Google功能最强大的生成式AI模型,现已在Google以企业为中心的AI开发平台Vertex AI上提供公共预览版。这是谷歌面向企业的AI开发平台。它能处理的上下文从12.8万个token增加到100万个token。100万个token大约相当于70万个单词,或者大约3万行代码。这大致是Anthropic的旗舰模型Claude 3能作为输入处理的数据量的四倍,也大约是OpenAI的GPT-4 Turbo最大上下文量的八倍。

官方原文链接:https://developers.googleblog.com/2024/04/gemini-15-pro-in-public-preview-with-new-features.html

该版本首次提供了本地音频(语音)理解功能和全新的文件 API,使文件处理变得更加简单。Gemini 1.5 Pro 的输入模式正在拓展,包括在 Gemini API 和 Google AI Studio 中增加对音频(语音)的理解。此外,Gemini 1.5 Pro 现在能够对在 Google AI Studio 中上传的视频的图像(帧)和音频(语音)进行推理。

可以通过上传一个讲座的录音,比如这个由Jeff Dean进行的超过117000个token的讲座,Gemini 1.5 Pro可以将其转换成一个带有答案的测试。(演示已加速)

谷歌在 Gemini API 方面也进行了改进,主要有以下三个内容:

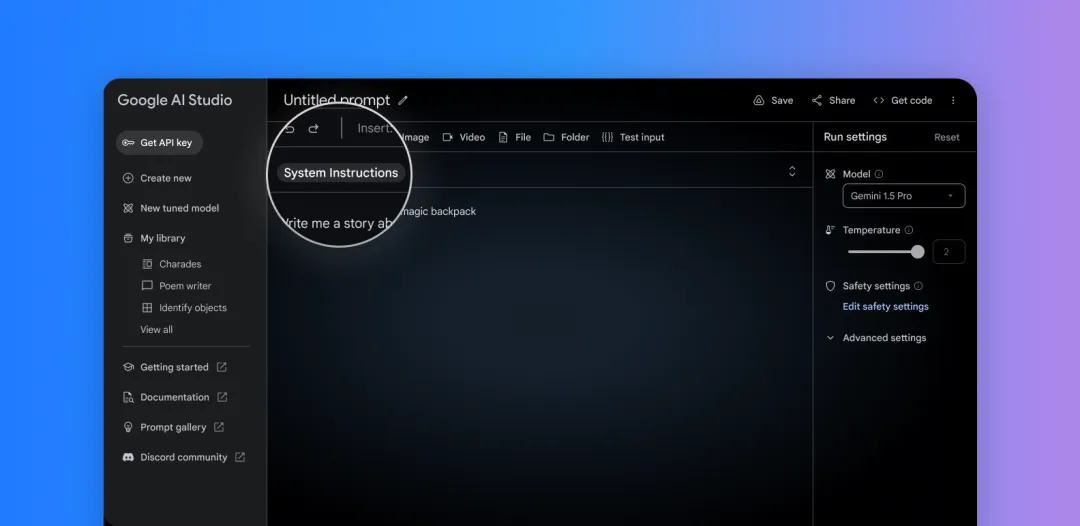

当前可以在Google AI Studio和Gemini API中使用系统指令来指导模型的响应。定义角色、格式、目标和规则,以针对您的特定用例指导模型的行为。

在 Google AI Studio 中轻松设置系统指令

2.JSON 模式:指示模型仅输出 JSON 对象。这种模式使从文本或图像中提取结构化数据成为可能。现在可以使用 cURL,Python SDK 支持即将推出。

3. 对函数调用的改进:现在可以选择模式来限制模型的输出,提高可靠性。选择文本、函数调用或仅函数本身。

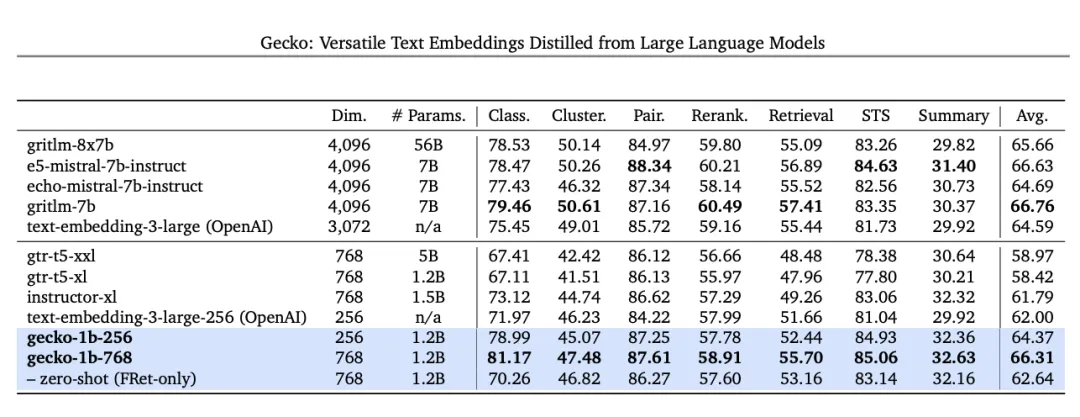

此外,谷歌将发布下一代文本嵌入模型,其性能优于同类模型。从今天开始,开发者将能够通过 Gemini API 访问下一代文本嵌入模型。这个新模型,text-embedding-004(在 Vertex AI 中为 text-embedding-preview-0409),在 MTEB 基准测试中实现了更强的检索性能,并且超越了具有可比维度的现有模型。

在 MTEB 基准测试中,使用 256 dims 输出的 Text-embedding-004(又名 Gecko)优于所有较大的 768 dims 输出模型

不过,需要注意的是,Gemini 1.5 Pro 对于没有访问 Vertex AI 和 AI Studio 权限的人来说是不可用的。目前,大多数人通过 Gemini 聊天机器人来接触 Gemini 语言模型。Gemini Ultra 驱动了 Gemini Advanced 聊天机器人,虽然它功能强大,也能理解长命令,但它的速度不如 Gemini 1.5 Pro。

三大开源工具

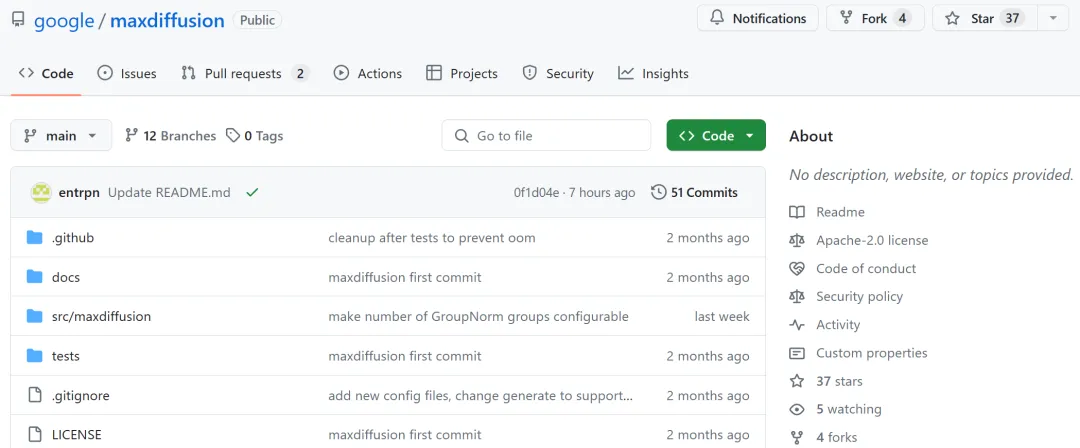

在 2024 年的 Google Cloud Next 大会上,该公司推出多个开源工具,主要用于支持生成式 AI 项目和基础设施。其一是 Max Diffusion,它是各种扩散模型参考实现的集合,可在 XLA(加速线性代数)设备上运行。

GitHub 地址:https://github.com/google/maxdiffusion

其二是 Jetstream,一个运行生成式 AI 模型的新引擎。目前,JetStream 只支持 TPU,未来可能会兼容 GPU。谷歌声称,JetStream 可为谷歌自己的 Gemma 7B 和 Meta 的 Llama 2 等模型提供高达 3 倍的性价比。

GitHub 地址:https://github.com/google/JetStream

第三个是 MaxTest,这是一个针对云中的 TPUs 和 Nvidia GPUs 的文本生成 AI 模型的集合。MaxText 现在包括 Gemma 7B、OpenAI 的 GPT-3、Llama 2 和来自 AI 初创公司 Mistral 的模型,谷歌表示所有这些模型都可以根据开发人员的需求进行定制和微调。

GitHub 地址:https://github.com/google/maxtext

首款自研 Arm 处理器 Axion

谷歌云宣布推出其首款自主研发的 Arm 处理器,名为 Axion。其基于 Arm 的 Neoverse 2,专为数据中心设计。谷歌表示其 Axion 实例的性能比其他竞争对手如 AWS 和微软的基于 Arm 的实例高出 30%,与相应的基于 X86 的实例相比,性能提高了最多 50%,能效提高了 60%。

谷歌在周二的发布会上强调,由于 Axion 建立在一个开放的基础上,谷歌云的客户将能够将他们现有的 Arm 工作负载带到谷歌云,而无需任何修改。

不过,目前谷歌还没有发布对此进行详细介绍的内容。

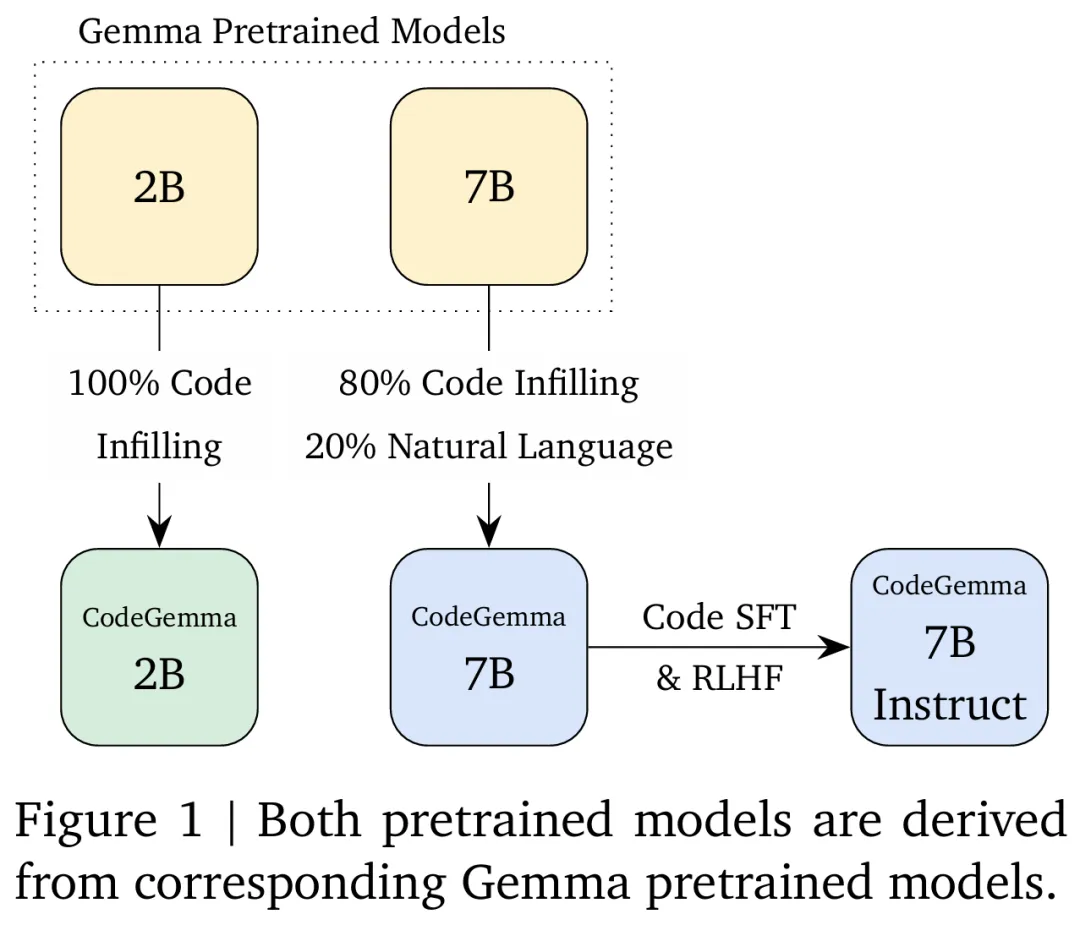

代码补全、生成利器 ——CodeGemma

CodeGemma 以 Gemma 模型为基础,为社区带来了强大而轻量级的编码功能。该模型可分为专门处理代码补全和代码生成任务的 7B 预训练变体、用于代码聊天和指令跟随的 7B 指令调优变体、以及在本地计算机上运行快速代码补全的 2B 预训练变体。

CodeGemma 具有以下几大优势:

- 智能代码补全和生成:补全行、函数,甚至生成整个代码块,无论你是在本地还是云上工作;

- 更高准确性:CodeGemma 主要使用来自网络文档、数学和代码的 5000 亿 token 的英语语言数据进行训练,生成的代码不仅语法更正确,语义也更有意义,有助于减少错误和 debug 时间;

- 多语言能力:支持 Python、JavaScript、Java 和其他流行编程语言;

- 简化工作流程:将 CodeGemma 集成到你的开发环境中,以减少编写的样板代码,并更快地编写重要、有趣且差异化的代码。

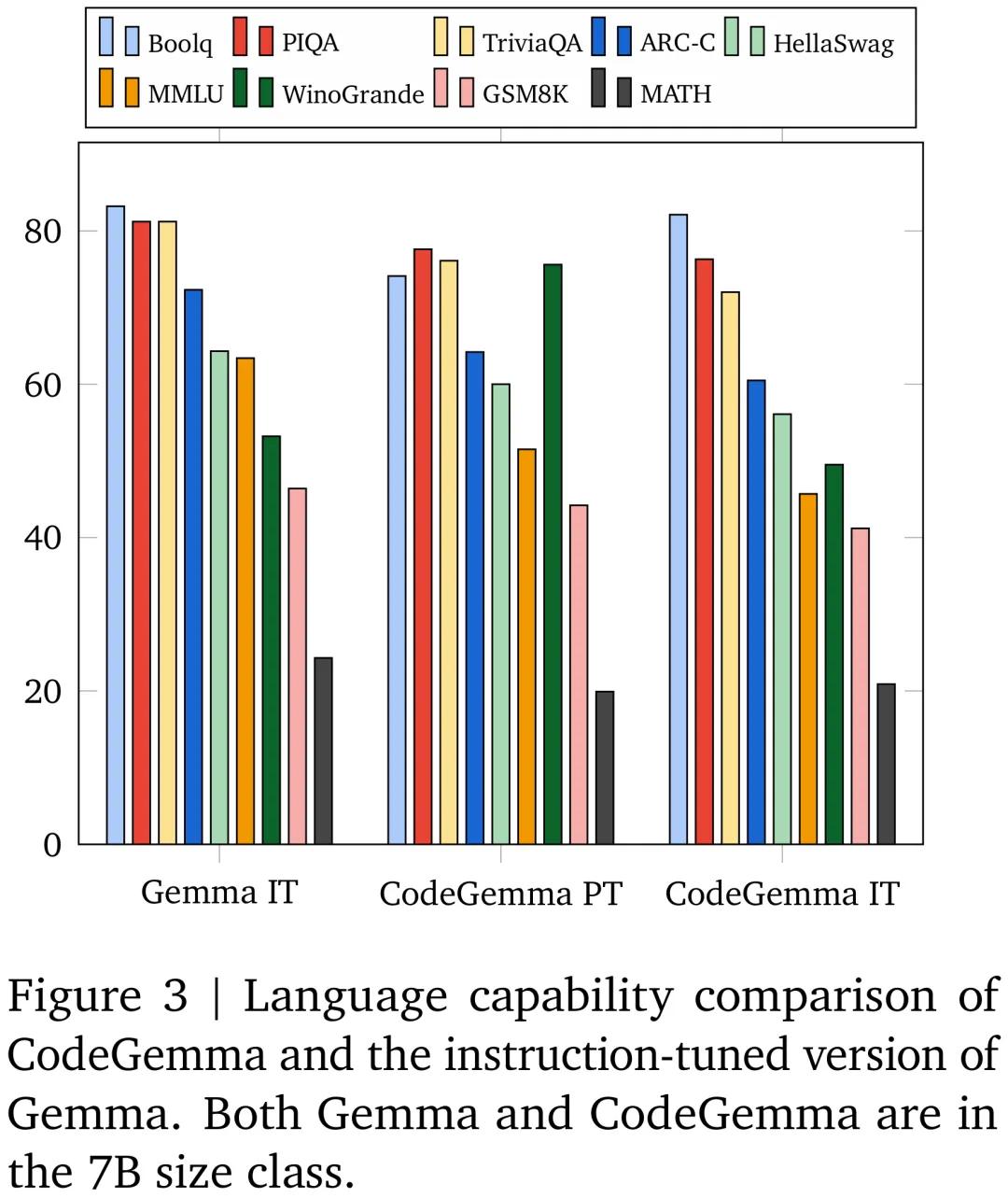

CodeGemma 与其他主流代码大模型的一些比较结果如下图所示:

CodeGemma 7B 模型与 Gemma 7B 模型在 GSM8K、MATH 等数据集上的比较结果。

更多技术细节和实验结果请参阅谷歌同步放出的论文。

论文地址:https://storage.googleapis.com/deepmind-media/gemma/codegemma_report.pdf

开放语言模型 ——RecurrentGemma

Google DeepMind 还发布了一系列开放权重语言模型 ——RecurrentGemma。RecurrentGemma 基于 Griffin 架构,通过将全局注意力替换为局部注意力和线性循环(linear recurrences)的混合,在生成长序列时实现快速推理。

技术报告:https://storage.googleapis.com/deepmind-media/gemma/recurrentgemma-report.pdf

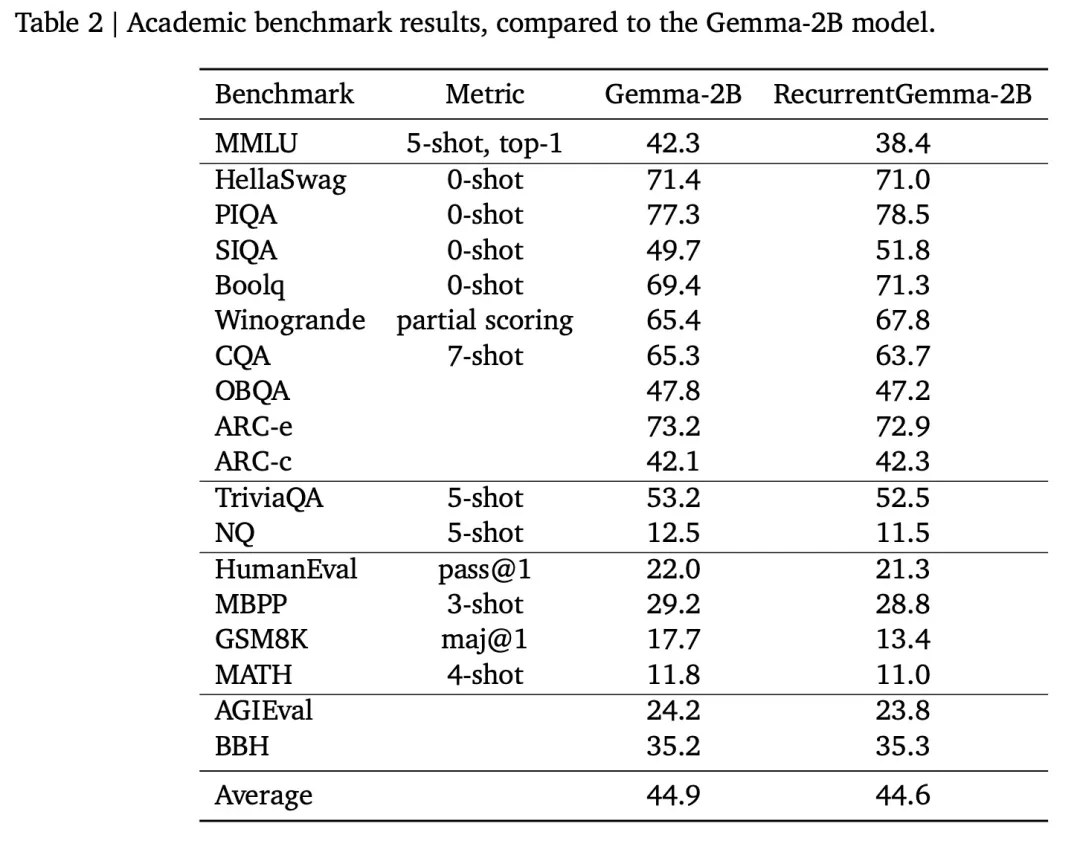

RecurrentGemma-2B 在下游任务上实现了卓越的性能,可与 Gemma-2B(transformer 架构)媲美。

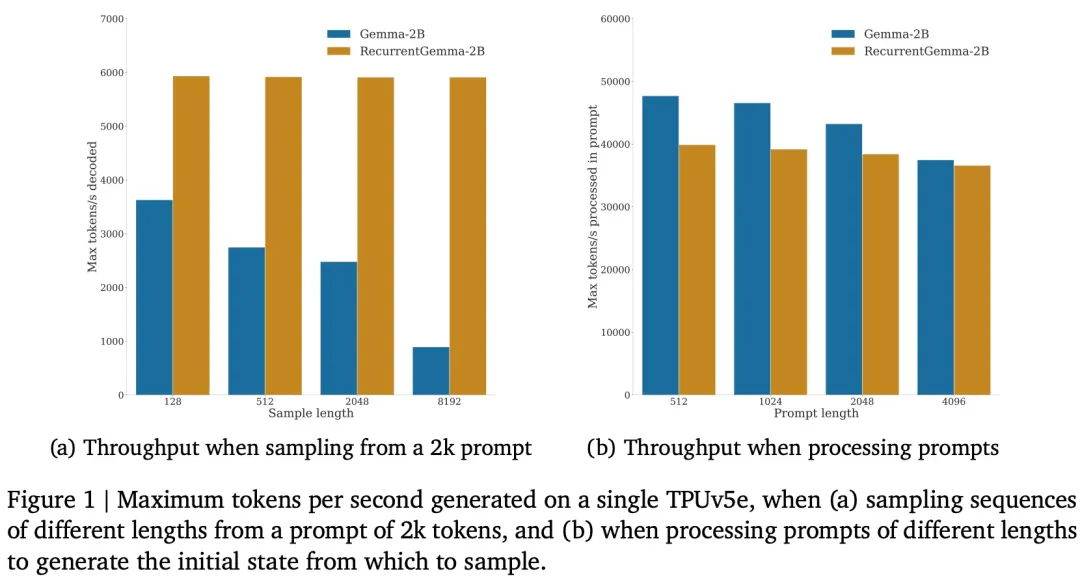

同时,RecurrentGemma-2B 在推理过程中实现了更高的吞吐量,尤其是在长序列上。

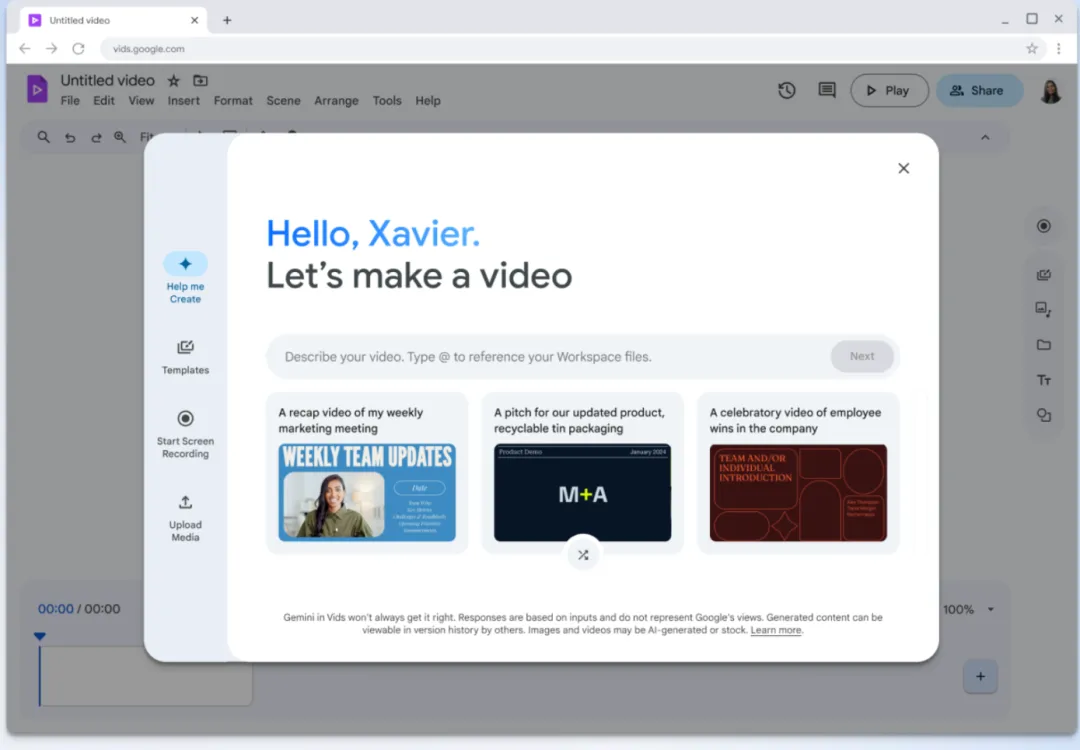

视频编辑工具 ——Google Vids

Google Vids 是一款 AI 视频创建工具,是 Google Workspace 中添加的新功能。

谷歌表示,借助 Google Vids,用户可以与文档和表格等其他 Workspace 工具一起制作视频,并且可与同事实时协作。

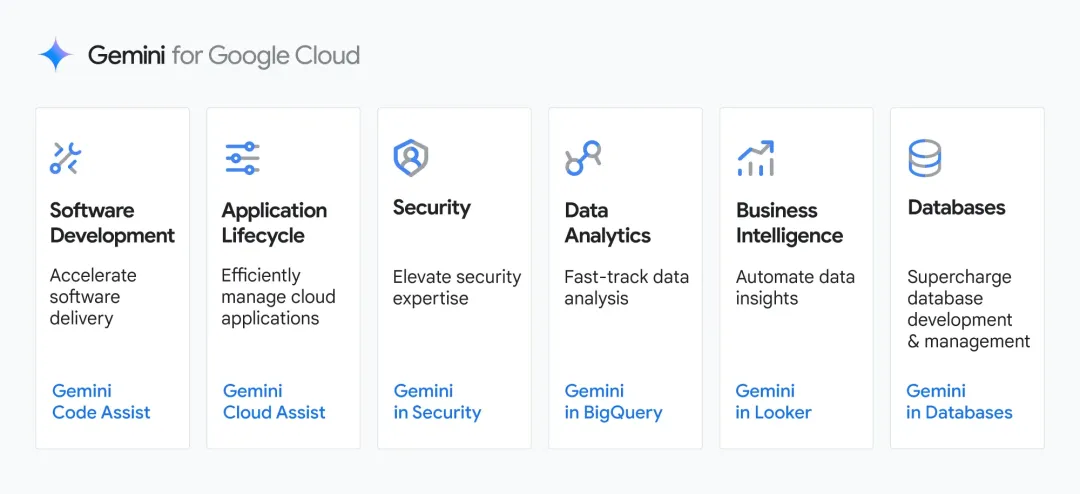

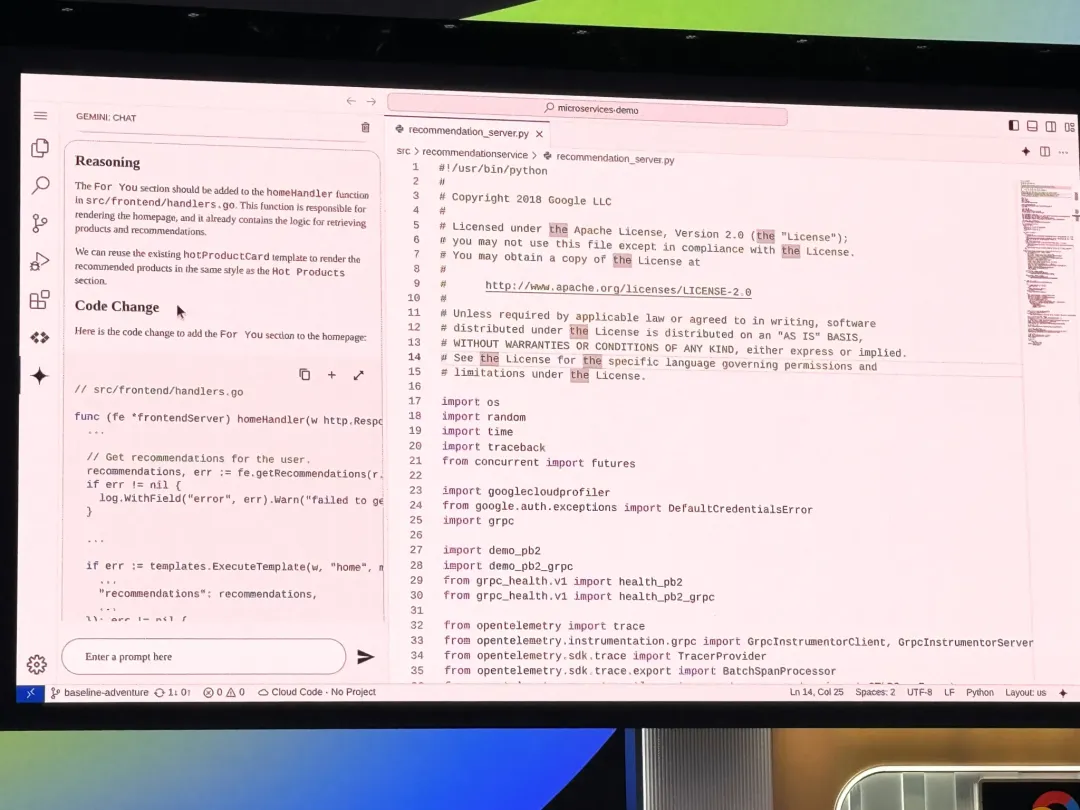

企业专用代码助手 ——Gemini Code Assist

Gemini Code Assist 是一款面向企业的 AI 代码完成和辅助工具, 对标 GitHub Copilot Enterprise。Code Assist 将通过 VS Code 和 JetBrains 等流行编辑器以插件的形式提供。

图源:https://techcrunch.com/2024/04/09/google-launches-code-assist-its-latest-challenger-to-githubs-copilot/

Code Assist 由 Gemini 1.5 Pro 提供支持。Gemini 1.5 Pro 拥有百万 token 的上下文窗口,这使得谷歌的工具能够比竞争对手引入更多的上下文。谷歌表示,这意味着 Code Assist 能够提供更准确的代码建议,并具备推理和更改大段代码的能力。

谷歌表示:「Code Assist 使客户能够对整个代码库进行大规模更改,从而实现以前不可能实现的人工智能辅助代码转换。」

智能体构建器 ——Vertex AI

AI 智能体是今年一个热门的行业发展方向。谷歌现在宣布推出一款帮助企业构建 AI 智能体的新工具 ——Vertex AI Agent Builder。

谷歌云首席执行官 Thomas Kurian 表示:「Vertex AI Agent Builder 使人们能够非常轻松、快速地构建和部署可用于生产的、由人工智能驱动的生成式对话智能体,并且能够以指导人类的方式指导智能体,以提高模型生成结果的质量和正确性。」

以上是全面突围,谷歌昨晚更新了一大波大模型产品的详细内容。更多信息请关注PHP中文网其他相关文章!