写在前面&笔者的个人理解

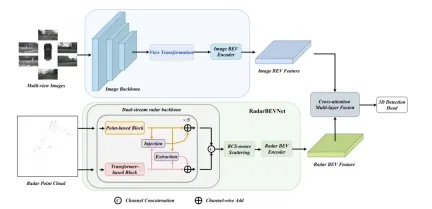

这篇讨论文关注的主要问题是3D目标检测技术在自动驾驶进程中的应用。尽管环境视觉相机技术的发展为3D目标检测提供了高分辨率的语义信息,这种方法因无法精确捕获深度信息和在恶劣天气或低光照条件下的表现不佳等问题而受限。针对这一问题,讨论提出了一种结合环视相机和经济型毫米波雷达传感器的多模式3D目标检测新方法——RCBEVDet。该方法通过综合使用多传感器的信息,提供了更丰富的语义信息以及在恶劣天气或低光照条件下的表现不佳等问题的解决方案。针对这一问题,讨论提出了一种结合环视相机和经济型毫米波雷达传感器的多模式3D目标检测新方法——RCBEVDet。通过综合使用多模传感器的信息,RCBEVDet能够提供高分辨率的语义信息,并在恶劣天气或低光照条件下表现出良好的性能。该方法的提出对于改善自动

RCBEVDet的核心在于两个关键设计:RadarBEVNet和Cross-Attention Multi-layer Fusion Module(CAMF)。RadarBEVNet旨在有效提取雷达特征,它包括双流雷达主干网络RCS(雷达截面积)感知的BEV(鸟瞰图)编码器。这样的设计利用了点云基和变换器基编码器处理雷达点,通过交互更新雷达点特征,同时将雷达特定的RCS特性作为目标大小的先验信息来优化BEV空间的点特征分布。 CAMF模块通过多模态交叉注意力机制解决了雷达点的方位误差问题,实现了雷达和相机的BEV特征图的动态对齐以及通过通道和空间融合的多模态特征自适应融合。 在实现中,通过交互更新雷达点特征,同时将雷达特定的RCS特性作为目标大小的先验信息来优化BEV空间的点特征分布。CAMF模块通过多模态交叉注意力机制解决了雷达点的方位误差问题,实现了雷达和相机的BEV特征图的动态对齐以及通过通道和空间融合的多模态特征自适应融合。

论文提出的新方法通过以下几点实现对现有问题的解决:

- 高效的雷达特征提取器:通过双流雷达主干和RCS感知的BEV编码器设计,专门针对雷达数据的特性进行优化,解决了使用为激光雷达设计的编码器处理雷达数据的不足。

- 强大的雷达-相机特征融合模块:采用变形的交叉注意力机制,有效处理环视图像和雷达输入之间的空间不对齐问题,提高融合效果。

论文的主要贡献如下:

- 提出了一种新颖的雷达-相机多模态3D目标检测器RCBEVDet,实现了高精度、高效率和强鲁棒性的3D目标检测。

- 设计了针对雷达数据的高效特征提取器RadarBEVNet,通过双流雷达主干和RCS感知BEV编码器,提高了特征提取的效率和准确性。

- 引入了Cross-Attention Multi-layer Fusion模块,通过变形交叉注意力机制实现了雷达和相机特征的精确对齐和高效融合。

- 在nuScenes和VoD数据集上达到了雷达-相机多模态3D目标检测的新的最佳性能,同时在精度和速度之间实现了最佳平衡,并展示了在传感器失效情况下的良好鲁棒性。

详解RCBEVDet

RadarBEVNet

RadarBEVNet是本论文提出的用于有效雷辆BEV(鸟现图)特征提取的网络架构,主要包括两个核心组成部分:双流雷达主干网络和RCS(雷达截面积)感知的BEV编码器。 双流雷达主干网络用于从多通道雷达数据中提取丰富的特征表示。它基于深度卷积神经网络(CNN)构建,在嵌套的卷积和池化层之间交替进行特征提取和降维操作,以逐渐获得抽

Dual-stream radar backbone

双流雷达主干网络由点基主干干和变换器基主干组成。点基主干网络通过多层感知机(MLP)和最大池化操作学习部雷达特征,其过程可以简化为以下公式:

在这里的表示雷达点特征,通过MLP增加特征维度后,再通过最大池化操作提取全局信息并与高维特征连接。

变换器基于干扰量块,引入了距离调制的注意力机制(DMSA),通过考虑雷达点之间的距离信息,优化模型聚集邻近信息的能力,促进模型的收敛。DMSA机制的自注意力可以表示为:

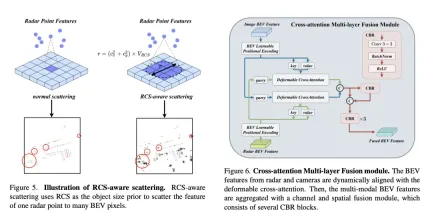

RCS-aware BEV encoder

为了解决传统雷达BEV编码器产生的BEV特征稀疏性问题,提出了RCS感知的BEV编码器。它利用RCS作为目标大小的先验信息,将雷达点特征散布到BEV空间中的多个像素上,而不是单一像素,以增加BEV特征的密度。该过程通过以下公式实现:

其中,为基于RCS的高斯式BEV权重图,通过最大化所有雷达点的权重图来优化。最终,将RCS散布得到的特征与连接并通过MLP处理,得到最终的RCS感知BEV特征。

整体而言,RadarBEVNet通过结合双流雷达主干网络和RCS感知的BEV编码器,高效地提取雷达数据的特征,并通过RCS作为目标大小的先验,优化了BEV空间的特征分布,为之后的多模态融合提供了强大的基础。

Cross-Attention Multi-layer Fusion Module

Cross-Attention Multi-layer Fusion Module (CAMF)是一种用于动态对齐和融合多模态特征的高级网络结构,特别针对雷达和相机生成的鸟瞰图(BEV)特征的动态对齐和融合设计。这一模块主要解决了由于雷达点云的方位误差导致的特征不对齐问题,通过变形的交叉注意力机制(Deformable Cross-Attention),有效地捕获雷达点的微小偏差,并减少了标准交叉注意力的计算复杂度。

CAMF利用变形交叉注意力机制来对齐相机和雷达的BEV特征。给定相机和雷达的BEV特征和,首先给和添加可学习的位置嵌入,然后将转换为查询和参考点,作为键和值。多头变形交叉注意力的计算可以表示为:

其中表示注意力头的索引,表示采样键的索引,是总的采样键数。表示采样偏移,是由和计算得到的注意力权重。

在通过交叉注意力对齐相机和雷达的BEV特征之后,CAMF使用通道和空间融合层来聚合多模态BEV特征。具体地,首先将两个BEV特征串联为,然后将送入CBR(卷积-批归一化-激活函数)块并通过残差连接获得融合特征。CBR块依次由一个的卷积层、一个批归一化层和一个ReLU激活函数组成。之后,连续应用三个CBR块以进一步融合多模态特征。

通过上述过程,CAMF有效地实现了雷达和相机BEV特征的精确对齐和高效融合,为3D目标检测提供了丰富而准确的特征信息,从而提高了检测性能。

相关实验

在VoD验证集上的3D目标检测结果比较中,RadarBEVNet通过融合相机和雷达数据,在整个标注区域内和兴趣区域内的平均精度(mAP)表现上均展现了优秀的性能。具体来说,对于整个标注区域,RadarBEVNet在汽车、行人和骑行者的检测上分别达到了40.63%、38.86%和70.48%的AP值,将综合mAP提升到了49.99%。而在兴趣区域,即靠近本车的驾驶通道内,RadarBEVNet的表现更为突出,分别在汽车、行人和骑行者的检测上达到了72.48%、49.89%和87.01%的AP值,综合mAP达到了69.80%。

这些结果揭示了几个关键点。首先,RadarBEVNet通过有效融合相机和雷达输入,能够充分利用两种传感器的互补优势,提升了整体的检测性能。相较于仅使用雷达的方法如PointPillar和RadarPillarNet,RadarBEVNet在综合mAP上有明显的提升,这表明多模态融合对于提高检测精度尤为重要。其次,RadarBEVNet在兴趣区域内的表现特别优秀,这对于自动驾驶应用来说尤为关键,因为兴趣区域内的目标通常对即时驾驶决策影响最大。最后,虽然在汽车和行人的检测上,RadarBEVNet的AP值略低于某些单一模态或其他多模态方法,但在骑行者检测和综合mAP表现上,RadarBEVNet展现了其综合性能的优势。RadarBEVNet通过融合相机和雷达的多模态数据,实现了在VoD验证集上的优异表现,特别是在对自动驾驶至关重要的兴趣区域内展现了强大的检测能力,证明了其作为一种有效的3D目标检测方法的潜力。

这个消融实验展示了RadarBEVNet在逐步添加主要组件时,对3D目标检测性能的持续改进。从基准模型BEVDepth开始,每一步增加的组件都显着提高了NDS(核心度量标准,反映了检测精度和完整性)和mAP(平均精确度,反映了模型对目标的检测能力)。

- 添加时间信息:通过引入时间信息,NDS和mAP分别提升了4.4和5.4个百分点。这表明时间信息对于提高3D目标检测的准确性和鲁棒性非常有效,可能是因为时间维度提供了额外的动态信息,有助于模型更好地理解场景和目标的动态特性。

- 加入PointPillar BEVFusion(基于雷达和相机的融合):这一步进一步提升了NDS和mAP,分别增加了1.7和1.8个百分点。这说明通过融合雷达和相机数据,模型能够获取更全面的场景理解,弥补了单一模态数据的局限。

- 引入RadarBEVNet:NDS和mAP分别再次提升2.1和3.0个百分点。 RadarBEVNet作为一个高效的雷达特征提取器,优化了雷达数据的处理,提高了特征的质量和有效性,这对于整体检测性能的提升至关重要。

- 添加CAMF(交叉注意力多层融合模块):通过精细的特征对齐和融合,NDS增加了0.7个百分点,mAP稍微提升到45.6,显示出在特征融合方面的有效性。这一步骤的改进虽然不如前几步显着,但依然证明了在多模态融合过程中,精确的特征对齐对于提高检测性能的重要性。

- 加入时间监督:最后,引入时间监督后,NDS微增0.4个百分点至56.8,而mAP略有下降0.3个百分点至45.3。这表明时间监督能进一步提升模型在时间维度的性能,尽管对mAP的贡献可能受到特定实验设置或数据分布的影响而略显限制。

总的来说,这一系列的消融实验清晰地展示了RadarBEVNet中每个主要组件对于提高3D目标检测性能的贡献,从时间信息的引入到复杂的多模态融合策略,每一步都为模型带来了性能上的提升。特别是,对雷达和相机数据的精细处理和融合策略,证明了在复杂的自动驾驶环境中,多模态数据处理的重要性。

讨论

论文提出的RadarBEVNet方法通过融合相机和雷达的多模态数据,有效地提升了3D目标检测的准确性和鲁棒性,尤其在复杂的自动驾驶场景中表现出色。通过引入RadarBEVNet和Cross-Attention Multi-layer Fusion Module(CAMF),RadarBEVNet不仅优化了雷达数据的特征提取过程,还实现了雷达和相机数据之间精准的特征对齐和融合,从而克服了单一传感器数据使用中的局限性,如雷达的方位误差和相机在低光照或恶劣天气条件下的性能下降。

优点方面,RadarBEVNet的主要贡献在于其能够有效处理并利用多模态数据之间的互补信息,提高了检测的准确度和系统的鲁棒性。 RadarBEVNet的引入使得雷达数据的处理更为高效,而CAMF模块确保了不同传感器数据之间的有效融合,弥补了各自的不足。此外,RadarBEVNet在实验中展现了在多个数据集上的优异性能,尤其是在自动驾驶中至关重要的兴趣区域内,显示了其在实际应用场景中的潜力。

缺点方面,尽管RadarBEVNet在多模态3D目标检测领域取得了显著成果,但其实现的复杂性也相应增加,可能需要更多的计算资源和处理时间,这在一定程度上限制了其在实时应用场景中的部署。此外,虽然RadarBEVNet在骑行者检测和综合性能上表现优秀,但在特定类别上(如汽车和行人)的性能仍有提升空间,这可能需要进一步的算法优化或更高效的特征融合策略来解决。

总之,RadarBEVNet通过其创新的多模态融合策略,在3D目标检测领域展现了显着的性能优势。尽管存在一些局限性,如计算复杂度较高和在特定检测类别上的性能提升空间,但其在提高自动驾驶系统准确性和鲁棒性方面的潜力不容忽视。未来的工作可以聚焦于优化算法的计算效率和进一步提高其在各类目标检测上的表现,以推动RadarBEVNet在实际自动驾驶应用中的广泛部署。

结论

论文通过融合相机和雷达数据,引入了RadarBEVNet和Cross-Attention Multi-layer Fusion Module(CAMF),在3D目标检测领域展现出显着的性能提升,特别是在自动驾驶的关键场景中表现优异。它有效地利用了多模态数据之间的互补信息,提高了检测准确性和系统的鲁棒性。尽管存在计算复杂度高和在某些类别上性能提升空间的挑战,\ours在推动自动驾驶技术发展,尤其是在提升自动驾驶系统的感知能力方面,展现了巨大的潜力和价值。未来工作可以关注于优化算法效率和进一步提升检测性能,以便更好地适应实时自动驾驶应用的需求。

以上是RV融合性能拉爆!RCBEVDet:Radar也有春天,最新SOTA!的详细内容。更多信息请关注PHP中文网其他相关文章!

AI技能差距正在减慢供应链Apr 26, 2025 am 11:13 AM

AI技能差距正在减慢供应链Apr 26, 2025 am 11:13 AM经常使用“ AI-Ready劳动力”一词,但是在供应链行业中确实意味着什么? 供应链管理协会(ASCM)首席执行官安倍·埃什肯纳齐(Abe Eshkenazi)表示,它表示能够评论家的专业人员

一家公司如何悄悄地努力改变AIApr 26, 2025 am 11:12 AM

一家公司如何悄悄地努力改变AIApr 26, 2025 am 11:12 AM分散的AI革命正在悄悄地获得动力。 本周五在德克萨斯州奥斯汀,Bittensor最终游戏峰会标志着一个关键的时刻,将分散的AI(DEAI)从理论转变为实际应用。 与闪闪发光的广告不同

NVIDIA释放NEMO微服务以简化AI代理开发Apr 26, 2025 am 11:11 AM

NVIDIA释放NEMO微服务以简化AI代理开发Apr 26, 2025 am 11:11 AM企业AI面临数据集成挑战 企业AI的应用面临一项重大挑战:构建能够通过持续学习业务数据来保持准确性和实用性的系统。NeMo微服务通过创建Nvidia所描述的“数据飞轮”来解决这个问题,允许AI系统通过持续接触企业信息和用户互动来保持相关性。 这个新推出的工具包包含五个关键微服务: NeMo Customizer 处理大型语言模型的微调,具有更高的训练吞吐量。 NeMo Evaluator 提供针对自定义基准的AI模型简化评估。 NeMo Guardrails 实施安全控制,以保持合规性和适当的

AI为艺术与设计的未来描绘了一幅新图片Apr 26, 2025 am 11:10 AM

AI为艺术与设计的未来描绘了一幅新图片Apr 26, 2025 am 11:10 AMAI:艺术与设计的未来画卷 人工智能(AI)正以前所未有的方式改变艺术与设计领域,其影响已不仅限于业余爱好者,更深刻地波及专业人士。AI生成的艺术作品和设计方案正在迅速取代传统的素材图片和许多交易性设计活动中的设计师,例如广告、社交媒体图片生成和网页设计。 然而,专业艺术家和设计师也发现AI的实用价值。他们将AI作为辅助工具,探索新的美学可能性,融合不同的风格,创造新颖的视觉效果。AI帮助艺术家和设计师自动化重复性任务,提出不同的设计元素并提供创意输入。 AI支持风格迁移,即将一种图像的风格应用

Zoom如何彻底改变与Agent AI的合作:从会议到里程碑Apr 26, 2025 am 11:09 AM

Zoom如何彻底改变与Agent AI的合作:从会议到里程碑Apr 26, 2025 am 11:09 AMZoom最初以其视频会议平台而闻名,它通过创新使用Agentic AI来引领工作场所革命。 最近与Zoom的CTO XD黄的对话揭示了该公司雄心勃勃的愿景。 定义代理AI 黄d

对大学的存在威胁Apr 26, 2025 am 11:08 AM

对大学的存在威胁Apr 26, 2025 am 11:08 AMAI会彻底改变教育吗? 这个问题是促使教育者和利益相关者的认真反思。 AI融入教育既提出了机遇和挑战。 正如科技Edvocate的马修·林奇(Matthew Lynch)所指出的那样

原型:美国科学家正在国外寻找工作Apr 26, 2025 am 11:07 AM

原型:美国科学家正在国外寻找工作Apr 26, 2025 am 11:07 AM美国科学研究和技术发展或将面临挑战,这或许是由于预算削减导致的。据《自然》杂志报道,2025年1月至3月期间,美国科学家申请海外工作的数量比2024年同期增加了32%。此前一项民意调查显示,75%的受访研究人员正在考虑前往欧洲和加拿大寻找工作。 过去几个月,数百项NIH和NSF的拨款被终止,NIH今年的新拨款减少了约23亿美元,下降幅度接近三分之一。泄露的预算提案显示,特朗普政府正在考虑大幅削减科学机构的预算,削减幅度可能高达50%。 基础研究领域的动荡也影响了美国的一大优势:吸引海外人才。35

所有有关打开AI最新的GPT 4.1家庭的信息 - 分析VidhyaApr 26, 2025 am 10:19 AM

所有有关打开AI最新的GPT 4.1家庭的信息 - 分析VidhyaApr 26, 2025 am 10:19 AMOpenai推出了强大的GPT-4.1系列:一个专为现实世界应用设计的三种高级语言模型家族。 这种巨大的飞跃提供了更快的响应时间,增强的理解和大幅降低了成本

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

EditPlus 中文破解版

体积小,语法高亮,不支持代码提示功能

螳螂BT

Mantis是一个易于部署的基于Web的缺陷跟踪工具,用于帮助产品缺陷跟踪。它需要PHP、MySQL和一个Web服务器。请查看我们的演示和托管服务。

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。

mPDF

mPDF是一个PHP库,可以从UTF-8编码的HTML生成PDF文件。原作者Ian Back编写mPDF以从他的网站上“即时”输出PDF文件,并处理不同的语言。与原始脚本如HTML2FPDF相比,它的速度较慢,并且在使用Unicode字体时生成的文件较大,但支持CSS样式等,并进行了大量增强。支持几乎所有语言,包括RTL(阿拉伯语和希伯来语)和CJK(中日韩)。支持嵌套的块级元素(如P、DIV),

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。