还记得之前的AI读心术吗?最近,「心想事成」的能力再次进化,

——人类可以通过自己的想法直接控制机器人了!

麻省理工研究人员发布了Ddog项目。他们自主研发了一种脑机接口(BCI)设备,用于控制波士顿动力的机器狗Spot。

狗狗可以按照人类的想法,移动到特定区域、帮人拿东西、或者拍照等。

相较于之前需要使用许多传感器的头套来“读心”,这次的脑机接口设备以无线眼镜(AttentivU)的形式呈现。

视频中展示的行为虽然简单,但这个系统的目的是将Spot改造为基本沟通工具,以帮助患有ALS、脑瘫或脊髓损伤等疾病的人士。

只需两部iPhone和一副眼镜,即可给绝望的人带来实际帮助和关怀。

并且,我们将在相关的论文中看到,这个系统实际上建立在非常复杂的工程之上。

论文地址:https://doi.org/10.3390/s24010080

Ddog系统使用AttentivU作为脑机接口系统,传感器嵌入到镜框中,用来测量一个人的脑电图 (EEG) 或大脑活动,以及眼电图或眼球运动。

这项研究的基础是MIT的Brain Switch,一种实时的闭环BCI,允许用户与看护人进行非语言和实时的交流。

Ddog系统成功率为83.4%,并且,这是在个人助理用例中首次将无线、非视觉BCI系统与Spot集成。

视频中我们可以看到脑际接口设备的进化之路,以及开发者的一些思考。

在此之前,研究团队就已经完成了脑机接口与智能家居的交互,而现在完成了控制能够移动和操作的机器人。

这些研究给了特殊人群一丝光明,让他们有活下去的希望,甚至未来可以生活得更好。

相比于章鱼一样的传感器头套,下面这个眼镜确实酷多了。

根据美国国家罕见疾病组织的数据,目前美国有30000名ALS患者,且估计每年诊断出5000例新病例。此外,根据《脑瘫指南》,大约有100万美国人患有脑瘫。

这些人中的许多人已经或最终将失去走路、穿衣、说话、写作甚至呼吸的能力。

虽然确实存在通信辅助工具,但大多数是允许用户使用计算机进行通信的眼睛凝视设备。允许用户与周围世界互动的系统并不多。

这种BCI四足机器人系统作为一个早期的原型,为现代个人助理机器人的未来发展铺平了道路。

希望在未来的迭代中,我们能看到更加惊人的能力。

脑控四足机器人

在这项工作中,研究人员探索了无线和可穿戴BCI设备如何控制四足机器人——波士顿动力公司的Spot。

研究人员开发的设备通过嵌入眼镜架中的电极测量用户的脑电图(EEG)和眼电图(EOG)活动。

用户在心中回答一系列问题(「是」或「否」),每个问答都对应一组预置的Spot操作。

比如提示Spot穿过一个房间,拿起一个对象(如一瓶水),然后为用户取回它。

机器人与BCI

时至今日,脑电图仍然是最实用和最适用的非侵入性脑机接口方法之一。

BCI系统可以使用内源性(自发)或外源性(诱发)信号进行控制。

在外源性脑机接口中,当一个人注意外部刺激(如视觉或听觉线索)时,就会出现诱发信号。

这种方法的优点包括极简的训练以及高达60位/分钟的高比特率,但这需要用户始终关注刺激,从而限制了其在现实生活中的适用性。而且,用户在使用外源性BCI时会很快感到疲倦。

在内源性脑机接口中,控制信号独立于任何外部刺激产生,可以由用户按需完全执行。对于那些有感觉障碍的用户来说,这提供了一种更自然和直观的交互方式,用户可以自发地向系统发出命令。

不过这种方法通常需要更长的训练时间,并且比特率较低。

使用脑机接口的机器人应用通常适用于需要帮助的人群,它们通常包括轮椅和外骨骼。

下图展示了截至2023年脑机接口和机器人技术的最新进展。

四足机器人通常用于在复杂的工作环境或国防应用中为用户提供支持。

最著名的四足机器人之一是波士顿动力公司的Spot,它可以携带高达15公斤的有效载荷,并迭代绘制隧道等维护站点的地图。房地产和采矿业也在采用Spot等四足机器人,帮助监控具有复杂物流的工作现场。

本文使用移动BCI解决方案控制的Spot机器人,并基于心算任务,总体架构命名为Ddog。

Ddog架构

下图展示了Ddog的总体结构:

Ddog是一个自主应用程序,用户能够通过BCI的输入控制Spot机器人,而应用程序使用语音向用户及其护理人员提供反馈。

该系统设计为完全离线或完全在线工作。在线版本具有一组更高级的机器学习模型,以及更好的微调模型,对于本地设备也更省电。

整个系统为真实场景而设计,并允许对大多数零件进行快速迭代。

在客户端,用户通过移动应用程序与脑机接口设备(AttentivU)进行交互,该应用程序使用低功耗蓝牙(BLE)协议与设备进行通信。

用户的移动设备与另一部控制Spot机器人的手机进行通信,以实现代理、操纵、导航,最终为用户提供帮助。

手机之间的通信可以通过Wi-Fi或移动网络。负责控制的手机建立一个Wi-Fi热点,Ddog和用户的手机都连接到这个热点。使用在线模式时,还可以连接到云上运行的模型。

服务端

服务器端使用Kubernetes(K8S)集群,每个集群都部署在自己的Virtual Private Cloud(VPC)中。

云在专用VPC内工作,通常部署在更靠近最终用户的同一可用区中,使每个服务的响应延迟最小化。

集群中的每个容器都设计为单一用途(微服务架构),每个服务都是一个正在运行的AI模型,它们的任务包括:导航、映射、计算机视觉、操纵、定位和代理。

映射:从不同来源收集有关机器人周围环境信息的服务。它映射静态的不可移动数据(一棵树、一栋建筑物、一堵墙),但也收集随时间变化的动态数据(一辆车、一个人)。

导航:基于在先前服务中收集和扩充的地图数据,导航服务负责在空间和时间上构建A点和B点之间的路径。它还负责构建替代路线,以及估计所需的时间。

计算机视觉:从机器人摄像头收集视觉数据,并利用手机的数据增强,生成空间和时间表示。此服务还尝试分割每个视觉点并识别对象。

云负责训练与BCI相关的模型,包括脑电图(EEG)、眼电图(EOG)和惯性测量单元(IMU)。

部署在手机上的离线模型运行数据收集和聚合,同时也使用TensorFlow的移动端模型(针对更小的RAM和基于ARM的CPU进行了优化)进行实时推理。

视觉和操作

用于部署分割模型的原始版本是利用LIDAR数据的单个TensorFlow 3D模型。之后,作者将其扩展到少样本模型,并通过运行神经辐射场(NeRF)和RGBD数据的补充模型进行增强。

Ddog收集的原始数据是从五个摄像头汇总而来的。每个摄像头都可以提供灰度、鱼眼、深度和红外数据。手臂的夹持器内部还有第六个摄像头,具有4K分辨率和LED功能,配合预训练的TensorFlow模型检测对象。

点云由激光雷达数据以及由Ddog和手机的RGBD数据生成。数据采集完成后,通过单一坐标系进行归一化处理,并与汇集了所有成像和3D定位数据的全局状态相匹配。

操作完全取决于安装在 Ddog 上的机械臂夹持器的质量,下图的夹具由波士顿动力公司制造。

实验中将用例限制在与预定义位置中的对象进行基本交互。

作者绘制了一个大的实验室空间,将其设置为一个「公寓」,其中包含「厨房」区域(有一个装有不同杯子和瓶子的托盘)、「客厅」区域(带枕头的小沙发和小咖啡桌), 和「窗口休息室」区域。

用例的数量在不断增长,因此覆盖大多数用例的唯一方法是部署一个系统以连续运行一段时间,并使用数据来优化此类序列和体验。

AttentivU

脑电图数据是从AttentivU设备收集的。AttentivU眼镜的电极由天然银制成,根据国际10-20电极放置系统,位于TP9和TP10位置。该眼镜还包括位于鼻托的两个EOG电极和一个位于Fpz位置的EEG参比电极。

这些传感器可以提供所需的信息,并在需要时支持实时、闭环的干预。

设备具有EEG和EOG两种模式,可用于实时捕捉注意力、参与度、疲劳和认知负荷的信号。EEG已被用作清醒和睡眠之间过渡的神经生理学指标,

而EOG基于测量眼球运动过程中由于角膜-视网膜偶极子特性而诱导的生物电信号。研究表明,眼球运动与执行某些任务所需的记忆访问类型相关,并且是视觉参与、注意力和嗜睡的良好衡量标准。

实验

首先将脑电图数据分成几个窗口。将每个窗口定义为1秒长的EEG数据持续时间,与前一个窗口有75%的重叠。

然后是数据预处理和清理。使用50 Hz陷波滤波器和通带为0.5 Hz至40 Hz的带通滤波器的组合对数据进行滤波,以确保消除电力线噪声和不需要的高频。

接下来,作者创建了伪影拒绝算法。如果两个连续epoch之间的绝对功率差大于预定义的阈值,则拒绝某个epoch。

在分类的最后一步,作者混合使用不同的光谱波段功率比来跟踪每个受试者基于任务的心理活动。对于 MA,该比率为(alpha/delta)。对于WA,该比值为(delta/low beta),对于ME,该比值为(delta/alpha)。

然后,使用变化点检测算法来跟踪这些比率的变化。这些比率的突然增加或减少表明用户精神状态发生了变化。

对于患有ALS的受试者,本文的模型在MA任务中达到了73%的准确率,在WA任务中达到了74%的准确率,在ME任务中达到了60%的准确率。

以上是AI读心术再升级!一副眼镜直接控制波士顿机器狗,脑控机器人成真的详细内容。更多信息请关注PHP中文网其他相关文章!

ai合并图层的快捷键是什么Jan 07, 2021 am 10:59 AM

ai合并图层的快捷键是什么Jan 07, 2021 am 10:59 AMai合并图层的快捷键是“Ctrl+Shift+E”,它的作用是把目前所有处在显示状态的图层合并,在隐藏状态的图层则不作变动。也可以选中要合并的图层,在菜单栏中依次点击“窗口”-“路径查找器”,点击“合并”按钮。

ai橡皮擦擦不掉东西怎么办Jan 13, 2021 am 10:23 AM

ai橡皮擦擦不掉东西怎么办Jan 13, 2021 am 10:23 AMai橡皮擦擦不掉东西是因为AI是矢量图软件,用橡皮擦不能擦位图的,其解决办法就是用蒙板工具以及钢笔勾好路径再建立蒙板即可实现擦掉东西。

谷歌超强AI超算碾压英伟达A100!TPU v4性能提升10倍,细节首次公开Apr 07, 2023 pm 02:54 PM

谷歌超强AI超算碾压英伟达A100!TPU v4性能提升10倍,细节首次公开Apr 07, 2023 pm 02:54 PM虽然谷歌早在2020年,就在自家的数据中心上部署了当时最强的AI芯片——TPU v4。但直到今年的4月4日,谷歌才首次公布了这台AI超算的技术细节。论文地址:https://arxiv.org/abs/2304.01433相比于TPU v3,TPU v4的性能要高出2.1倍,而在整合4096个芯片之后,超算的性能更是提升了10倍。另外,谷歌还声称,自家芯片要比英伟达A100更快、更节能。与A100对打,速度快1.7倍论文中,谷歌表示,对于规模相当的系统,TPU v4可以提供比英伟达A100强1.

ai可以转成psd格式吗Feb 22, 2023 pm 05:56 PM

ai可以转成psd格式吗Feb 22, 2023 pm 05:56 PMai可以转成psd格式。转换方法:1、打开Adobe Illustrator软件,依次点击顶部菜单栏的“文件”-“打开”,选择所需的ai文件;2、点击右侧功能面板中的“图层”,点击三杠图标,在弹出的选项中选择“释放到图层(顺序)”;3、依次点击顶部菜单栏的“文件”-“导出”-“导出为”;4、在弹出的“导出”对话框中,将“保存类型”设置为“PSD格式”,点击“导出”即可;

ai顶部属性栏不见了怎么办Feb 22, 2023 pm 05:27 PM

ai顶部属性栏不见了怎么办Feb 22, 2023 pm 05:27 PMai顶部属性栏不见了的解决办法:1、开启Ai新建画布,进入绘图页面;2、在Ai顶部菜单栏中点击“窗口”;3、在系统弹出的窗口菜单页面中点击“控制”,然后开启“控制”窗口即可显示出属性栏。

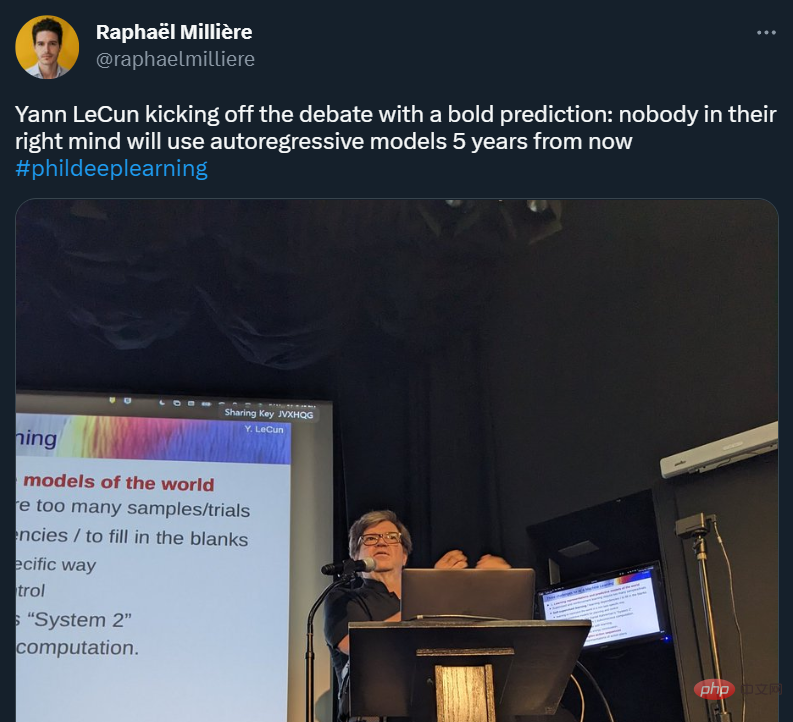

GPT-4的研究路径没有前途?Yann LeCun给自回归判了死刑Apr 04, 2023 am 11:55 AM

GPT-4的研究路径没有前途?Yann LeCun给自回归判了死刑Apr 04, 2023 am 11:55 AMYann LeCun 这个观点的确有些大胆。 「从现在起 5 年内,没有哪个头脑正常的人会使用自回归模型。」最近,图灵奖得主 Yann LeCun 给一场辩论做了个特别的开场。而他口中的自回归,正是当前爆红的 GPT 家族模型所依赖的学习范式。当然,被 Yann LeCun 指出问题的不只是自回归模型。在他看来,当前整个的机器学习领域都面临巨大挑战。这场辩论的主题为「Do large language models need sensory grounding for meaning and u

ai移动不了东西了怎么办Mar 07, 2023 am 10:03 AM

ai移动不了东西了怎么办Mar 07, 2023 am 10:03 AMai移动不了东西的解决办法:1、打开ai软件,打开空白文档;2、选择矩形工具,在文档中绘制矩形;3、点击选择工具,移动文档中的矩形;4、点击图层按钮,弹出图层面板对话框,解锁图层;5、点击选择工具,移动矩形即可。

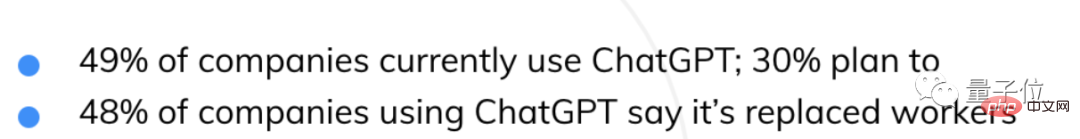

AI抢饭碗成真!近500家美国企业用ChatGPT取代员工,有公司省下超10万美元Apr 07, 2023 pm 02:57 PM

AI抢饭碗成真!近500家美国企业用ChatGPT取代员工,有公司省下超10万美元Apr 07, 2023 pm 02:57 PM自从ChatGPT掀起浪潮,不少人都在担心AI快要抢人类饭碗了。然鹅,现实可能更残酷QAQ......据就业服务平台Resume Builder调查统计,在1000多家受访美国企业中,用ChatGPT取代部分员工的,比例已达到惊人的48%。在这些企业中,有49%已经启用ChatGPT,还有30%正在赶来的路上。就连央视财经也为此专门发过一个报道:相关话题还曾一度冲上了知乎热榜,众网友表示,不得不承认,现在ChatGPT等AIGC工具已势不可挡——浪潮既来,不进则退。有程序员还指出:用过Copil

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

安全考试浏览器

Safe Exam Browser是一个安全的浏览器环境,用于安全地进行在线考试。该软件将任何计算机变成一个安全的工作站。它控制对任何实用工具的访问,并防止学生使用未经授权的资源。

ZendStudio 13.5.1 Mac

功能强大的PHP集成开发环境

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。

SublimeText3汉化版

中文版,非常好用

EditPlus 中文破解版

体积小,语法高亮,不支持代码提示功能