将不同的基模型象征为不同品种的狗,其中相同的「狗形指纹」表明它们源自同一个基模型。

大模型的预训练需要耗费大量的计算资源和数据,因此预训练模型的参数成为各大机构重点保护的核心竞争力和资产。然而,与传统软件知识产权保护不同,对预训练模型参数盗用的判断存在以下两个新问题:

1) 预训练模型的参数,尤其是千亿级别模型的参数,通常不会开源。

预训练模型的输出和参数会受到后续处理步骤(如SFT、RLHF、continue pretraining等)的影响,这使得判断一个模型是否基于另一个现有模型微调得来变得困难。无论是基于模型输出还是模型参数的判断都存在一定的挑战。

因此,对大模型参数的保护是一个尚缺乏有效解决方案的全新问题。

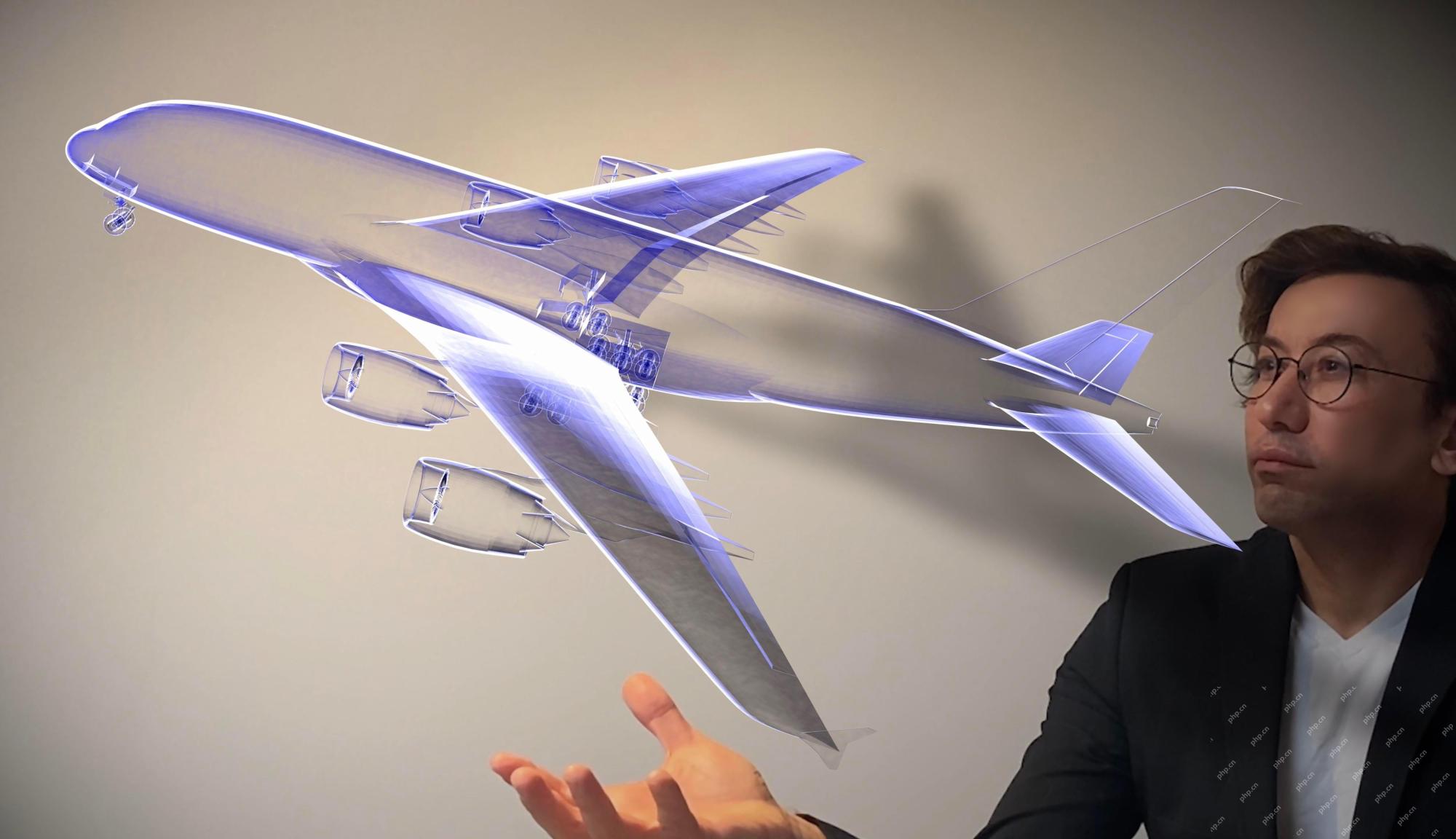

上海交通大学林洲汉老师的 Lumia 研究团队开发了一项创新技术,能够识别大模型之间的血统关系。这种方法采用了一种人类可读的大模型指纹,而无需公开模型参数。这一技术的研发对于大模型的发展和应用具有重要意义。

该方法提供两种判别方式:一种是定量的判别方式,通过比较被测大模型与一系列基模型的相似度来判断是否盗用了预训练基模型;另一种是定性的判别方式,通过生成人类可读的「狗图」来快速发现模型之间的继承关系。

6 个不同基础模型(第一行)及其相应后代模型(下面两行)的指纹。

对 24 个不同的大模型所制作的人类可读大模型指纹。

动机和总体方法

大型模型的快速发展带来了广泛的应用前景,但同时也引发了一系列新的挑战。其中突出的两个问题包括:

模型盗用问题:一个聪明的「小偷」,他们仅对原有的大型模型进行微小调整,随后便声称创建了一个全新的模型,夸大自己的贡献。我们如何识别出它是盗版模型?

模型滥用问题:当一个不法分子恶意修改 LLaMA 模型并用它来产生有害信息时,尽管 Meta 的政策明确禁止这种行为,我们如何证明它所使用的正是 LLaMA 模型呢?

在此之前,解决这类问题的常规方法包括在模型训练和推理过程中加入水印,或对由大型模型生成的文本进行分类。然而,这些方法要么会削弱大型模型的性能,要么容易被简单的微调或 further pretrain 规避。

这引发了一个关键问题:是否存在一种方法,既不干扰大型模型的输出分布,又能对微调和 further pretrain 鲁棒,同时还能够准确追踪大模型的基模型,从而有效保护模型版权的目的。

上海交通大学的团队从人类指纹的独一无二特性中汲取灵感,研究开发了一种为大模型制作「人类可读指纹」的方法。他们将不同的基模型象征为不同品种的狗,其中相同的「狗形指纹」表明它们源自同一个基模型。

这种直观的方法使公众能够轻松辨识不同大模型之间的联系,并通过这些指纹追踪到模型的基模型,有效预防模型的盗版和滥用。值得注意的是,大模型的制造商无需公布其参数,仅需公开不变项用于生成指纹。

Alpaca 和 LLaMA 的「指纹」极其相似,这是因为 Alpaca 模型是通过对 LLaMA 进行微调得到的;而其他几种模型的指纹则显示了明显的差异,反映了它们源自不同的基模型。

论文《HUREF: HUMAN-READABLE FINGERPRINT FOR LARGE LANGUAGE MODELS》:

论文下载地址:https://arxiv.org/pdf/2312.04828.pdf

从实验观察到不变项

交大团队发现,在对大模型进行微调或 further pretrain 时,这些模型的参数向量方向变化非常微小。相反,对于从新开始训练的大模型,其参数方向将与其他基模型完全不同。

他们在 LLaMA 的一系列衍生模型上进行了验证,包括通过对 LLaMA 进行微调得到的 Alpaca 和 Vicuna,以及由 LLaMA further pretrain 得到的 Chinese LLaMA 和 Chinese Alpaca。此外,他们还测试了如百川和书生等独立训练的基模型。

表格中用蓝色标记的 LLaMA 衍生模型与 LLaMA-7B 基模型在参数向量上展现出了极高的余弦相似度,意味着这些衍生模型在参数向量方向上与基模型极为接近。相比之下,用红色标记的独立训练的基模型则呈现出截然不同的情况,它们的参数向量方向完全无关。

基于这些观察,他们考虑是否可以依据这种经验规律来创建模型的指纹。然而,存在一个关键问题:这种方法对于恶意攻击是否足够鲁棒?

为了验证这一点,研究团队在对 LLaMA 进行微调时,加入了模型间参数的相似度作为惩罚损失,以使模型在微调的同时,参数方向尽量偏离基模型,测试模型能否在保持性能的同时偏离原参数方向:

他们在 BoolQ 和 MMLU 等 8 个 benchmark 上测试了原模型和加入惩罚损失微调得到的模型。从下图表中可见,模型的性能随着余弦相似度的下降迅速恶化。这说明,想要在不损害基模型能力的情况下偏离原参数方向是相当困难的!

目前来看,大模型的参数向量方向成为识别其基模型的一个极为有效且鲁棒的指标。但是,直接利用参数向量方向作为识别工具似乎还存在一些问题。首先,这种方法需要揭示模型的参数,这对于许多大型模型可能是不可接受的。其次,攻击者有可以通过简单地置换隐藏单元,从而在不牺牲模型性能的情况下对参数向量方向发起攻击。

以 Transformer 中的前馈神经网络(FFN)为例,仅对隐藏单元进行简单的置换,并相应地调整其权重,就可以在不改变网络输出的情况下实现对权重方向的修改。

此外,该团队还深入分析了线性映射攻击以及对大模型 word embedding 的置换攻击。这些发现引发了一个问题:在面对如此多样化的攻击手段时,我们应该如何有效地应对和解决这些问题?

他们通过参数矩阵间的乘法消除攻击矩阵,从而推导出了三组对这些攻击鲁棒的不变项。

从不变项到人类可读的指纹

虽然上述推导出的不变项已足以作为大型型的身份标识,但它们通常以庞大的矩阵形式出现,不仅不够直观,而且还需要进行额外的相似度计算来判定不同大模型之间的关系。是否存在一种更加直观且易于理解的方法来展示这些信息?

为了解决这一问题,上海交大团队研发了一套由模型参数生成人类可读指纹的方法 —HUREF。

他们首先从大模型的部分参数中提取出不变项,然后利用 CNN Encoder 在保持局部性(locality)的前提下,将不变项矩阵编码成服从高斯分布的特征向量,最后使用使用平滑的 GAN 或 VAE 作为图片生成器,将这些特征向量解码成可视化图像(即狗的图片)。这些图片不仅人类可读,而且直观地展示了不同模型之间的相似性,有效地作为大型模型的「视觉指纹」。以下是详细的训练和推理过程。

在该框架中,CNN Encoder 是唯一需要训练的部分。他们采用对比学习确保 Encoder 的局部保持性,同时通过生成对抗学习确保特征向量服从高斯分布,以此与 GAN 或 VAE 生成器的输入空间保持一致。

重要的是,在训练过程中,他们无需使用任何真实的模型参数,所有数据都是通过正态分布采样获得。在实际应用中,直接采用经过训练的 CNN Encoder 和现成的在 AFHQ 犬类数据集上训练得到的 StyleGAN2 生成器来进行推理。

为不同大模型生成指纹

为了验证这一方法的有效性,团队在多种广泛使用的大模型上进行了实验。他们选取了若干知名的开源大模型,如 Falcon、MPT、LLaMA2、Qwen、Baichuan 和 InternLM,以及它们的衍生模型,计算了这些模型的不变项,并据此生成了如下图所示的指纹图片。

衍生模型的指纹与其原始模型极为相似,我们可以直观地从图像中辨认出它们是基于哪个原型模型构建的。此外,这些衍生模型与原模型在不变项上也保持了很高的余弦相似性。

随后,他们对 LLaMA 家族模型进行了广泛的测试,包括通过 SFT 得到的 Alpaca 和 Vicuna,扩展了中文词汇表的模型,通过 further pretrain 得到的 Chinese LLaMA 和 BiLLa,通过 RLHF 得到的 Beaver 以及多模态模型 Minigpt4 等。

表中展示了 LLaMA 家族模型之间不变项的余弦相似度,同时,图中是为这 14 个模型生成的指纹图片,它们的相似度依然很高。我们能够根据指纹图片判断出它们来自相同的模型,值得注意的是,这些模型涵盖了 SFT,further pretrain,RLHF 和多模态等多种不同的训练方法,这进一步验证了团队所提出的方法对大模型后续不同训练范式的鲁棒性。

此外,下图是他们在 24 个独立训练的开源基模型上进行的实验结果。通过他们的方法,各个独立的基模型被赋予了独特的指纹图像,这些图像生动地展现了不同大模型间指纹的多样性和差异性。表中,这些模型间的相似度计算结果与其指纹图像所呈现的差异性保持了一致。

最后,该团队进一步验证了小规模独立训练的语言模型参数方向的唯一性和稳定性。他们利用 Pile 数据集的十分之一从零开始预训练了四个 GPT-NeoX-350M 模型。

这些模型在设置上完全相同,唯一的区别在于使用了不同的随机数种子。从下图表中可以明显看出,仅随机数种子的差异就导致了模型参数方向和指纹的显著不同,这充分说明了独立训练的语言模型参数方向的唯一性。

最后,通过比较相邻 checkpoints 的相似度,他们发现,在预训练过程中,模型的参数逐渐趋向稳定。他们认为这种趋势在更长的训练步骤和更大规模的模型中将更为明显,这也在一定程度上解释了他们方法的有效性。

以上是大模型也有小偷?为保护你的参数,上交大给大模型制作「人类可读指纹」的详细内容。更多信息请关注PHP中文网其他相关文章!

AI内部部署的隐藏危险:治理差距和灾难性风险Apr 28, 2025 am 11:12 AM

AI内部部署的隐藏危险:治理差距和灾难性风险Apr 28, 2025 am 11:12 AMApollo Research的一份新报告显示,先进的AI系统的不受检查的内部部署构成了重大风险。 在大型人工智能公司中缺乏监督,普遍存在,允许潜在的灾难性结果

构建AI测谎仪Apr 28, 2025 am 11:11 AM

构建AI测谎仪Apr 28, 2025 am 11:11 AM传统测谎仪已经过时了。依靠腕带连接的指针,打印出受试者生命体征和身体反应的测谎仪,在识破谎言方面并不精确。这就是为什么测谎结果通常不被法庭采纳的原因,尽管它曾导致许多无辜者入狱。 相比之下,人工智能是一个强大的数据引擎,其工作原理是全方位观察。这意味着科学家可以通过多种途径将人工智能应用于寻求真相的应用中。 一种方法是像测谎仪一样分析被审问者的生命体征反应,但采用更详细、更精确的比较分析。 另一种方法是利用语言标记来分析人们实际所说的话,并运用逻辑和推理。 俗话说,一个谎言会滋生另一个谎言,最终

AI是否已清除航空航天行业的起飞?Apr 28, 2025 am 11:10 AM

AI是否已清除航空航天行业的起飞?Apr 28, 2025 am 11:10 AM航空航天业是创新的先驱,它利用AI应对其最复杂的挑战。 现代航空的越来越复杂性需要AI的自动化和实时智能功能,以提高安全性,降低操作

观看北京的春季机器人比赛Apr 28, 2025 am 11:09 AM

观看北京的春季机器人比赛Apr 28, 2025 am 11:09 AM机器人技术的飞速发展为我们带来了一个引人入胜的案例研究。 来自Noetix的N2机器人重达40多磅,身高3英尺,据说可以后空翻。Unitree公司推出的G1机器人重量约为N2的两倍,身高约4英尺。比赛中还有许多体型更小的类人机器人参赛,甚至还有一款由风扇驱动前进的机器人。 数据解读 这场半程马拉松吸引了超过12,000名观众,但只有21台类人机器人参赛。尽管政府指出参赛机器人赛前进行了“强化训练”,但并非所有机器人均完成了全程比赛。 冠军——由北京类人机器人创新中心研发的Tiangong Ult

镜子陷阱:人工智能伦理和人类想象力的崩溃Apr 28, 2025 am 11:08 AM

镜子陷阱:人工智能伦理和人类想象力的崩溃Apr 28, 2025 am 11:08 AM人工智能以目前的形式并不是真正智能的。它擅长模仿和完善现有数据。 我们不是在创造人工智能,而是人工推断 - 处理信息的机器,而人类则

新的Google泄漏揭示了方便的Google照片功能更新Apr 28, 2025 am 11:07 AM

新的Google泄漏揭示了方便的Google照片功能更新Apr 28, 2025 am 11:07 AM一份报告发现,在谷歌相册Android版7.26版本的代码中隐藏了一个更新的界面,每次查看照片时,都会在屏幕底部显示一行新检测到的面孔缩略图。 新的面部缩略图缺少姓名标签,所以我怀疑您需要单独点击它们才能查看有关每个检测到的人员的更多信息。就目前而言,此功能除了谷歌相册已在您的图像中找到这些人之外,不提供任何其他信息。 此功能尚未上线,因此我们不知道谷歌将如何准确地使用它。谷歌可以使用缩略图来加快查找所选人员的更多照片的速度,或者可能用于其他目的,例如选择要编辑的个人。我们拭目以待。 就目前而言

加固芬特的指南 - 分析VidhyaApr 28, 2025 am 09:30 AM

加固芬特的指南 - 分析VidhyaApr 28, 2025 am 09:30 AM增强者通过教授模型根据人类反馈进行调整来震撼AI的开发。它将监督的学习基金会与基于奖励的更新融合在一起,使其更安全,更准确,真正地帮助

让我们跳舞:结构化运动以微调我们的人类神经网Apr 27, 2025 am 11:09 AM

让我们跳舞:结构化运动以微调我们的人类神经网Apr 27, 2025 am 11:09 AM科学家已经广泛研究了人类和更简单的神经网络(如秀丽隐杆线虫中的神经网络),以了解其功能。 但是,出现了一个关键问题:我们如何使自己的神经网络与新颖的AI一起有效地工作

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

ZendStudio 13.5.1 Mac

功能强大的PHP集成开发环境

SublimeText3汉化版

中文版,非常好用

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

SublimeText3 Linux新版

SublimeText3 Linux最新版