蒙特卡罗马尔可夫链EM算法,简称MCMC-EM算法,是一种用于无监督学习中参数估计的统计学算法。它的核心思想是将马尔可夫链蒙特卡罗方法与期望最大化算法相结合,用于对存在隐变量的概率模型进行参数估计。通过迭代的方式,MCMC-EM算法能够逐步逼近参数的极大似然估计。它具有高效、灵活的特点,在许多领域中得到了广泛应用。

MCMC-EM算法的基本思想是利用MCMC方法获取隐变量的样本,并利用这些样本计算期望值,再通过EM算法来最大化对数似然函数。该算法的迭代过程包括两个步骤:MCMC抽样和EM更新。在MCMC抽样步骤中,我们使用MCMC方法来估计隐变量的后验分布;而在EM更新步骤中,我们使用EM算法来估计模型参数。通过交替进行这两个步骤,我们可以不断优化模型的参数估计。总之,MCMC-EM算法是一种结合了MCMC和EM的迭代算法,用于估计模型参数和隐变量的后验分布。

1.MCMC抽样

在MCMC抽样步骤中,首先需要选择一个初始状态,并通过马尔可夫链的转移概率生成一个样本序列。马尔可夫链是一个状态序列,每个状态只与前一个状态相关,因此随着序列的增长,当前状态的概率分布趋向于稳定分布。为了使生成的样本序列趋向于稳定分布,在MCMC抽样中需要使用适当的转移概率。常见的MCMC方法包括Metropolis-Hastings算法和Gibbs采样算法等。这些方法通过不同的转移概率来实现样本的生成和分布的逼近,从而得到对目标分布的抽样。Metropolis-Hastings算法通过接受-拒绝机制来决定是否接受转移,而Gibbs采样算法则通过条件分布进行转移。这些方法在统计学和机器学习中得到广泛应用,能够解决复杂的抽样问题和推断问题。

2.EM更新

在EM更新步骤中,需要使用MCMC抽样得到的样本来估计隐变量的期望值,并使用这些期望值来最大化对数似然函数。EM算法是一种迭代算法,每次迭代包括两个步骤:E步和M步。在E步中,需要计算隐变量的后验分布,并计算隐变量的期望值。在M步中,需要使用E步计算得到的隐变量期望值来最大化对数似然函数,从而求解参数的最大似然估计值。

MCMC-EM算法的优点在于它可以更好地处理复杂的概率模型,并且可以通过采样方法来生成更多的样本,以更好地估计模型参数。此外,MCMC-EM算法还可以通过调整MCMC方法的参数来平衡抽样效率和抽样精度,从而提高算法的性能。

然而,MCMC-EM算法也存在着一些问题和挑战。首先,MCMC-EM算法需要大量的计算资源和时间,特别是在处理大规模数据时。其次,MCMC-EM算法的收敛速度往往较慢,并且需要进行很多次迭代才能达到收敛。最后,MCMC-EM算法的结果可能会受到MCMC方法选择和参数设置的影响,因此需要进行适当的调试和优化。

总的来说,MCMC-EM算法是一种重要的无监督学习算法,在概率模型的参数估计和密度估计等领域有广泛的应用。虽然MCMC-EM算法存在一些问题和挑战,但随着计算资源和算法优化的不断提高,MCMC-EM算法将会变得更加实用和有效。

以上是蒙特卡罗马尔可夫链EM算法的详细内容。更多信息请关注PHP中文网其他相关文章!

解读CRISP-ML(Q):机器学习生命周期流程Apr 08, 2023 pm 01:21 PM

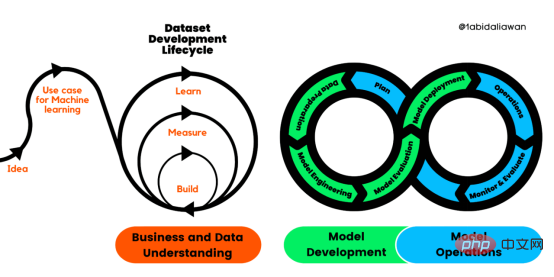

解读CRISP-ML(Q):机器学习生命周期流程Apr 08, 2023 pm 01:21 PM译者 | 布加迪审校 | 孙淑娟目前,没有用于构建和管理机器学习(ML)应用程序的标准实践。机器学习项目组织得不好,缺乏可重复性,而且从长远来看容易彻底失败。因此,我们需要一套流程来帮助自己在整个机器学习生命周期中保持质量、可持续性、稳健性和成本管理。图1. 机器学习开发生命周期流程使用质量保证方法开发机器学习应用程序的跨行业标准流程(CRISP-ML(Q))是CRISP-DM的升级版,以确保机器学习产品的质量。CRISP-ML(Q)有六个单独的阶段:1. 业务和数据理解2. 数据准备3. 模型

2023年机器学习的十大概念和技术Apr 04, 2023 pm 12:30 PM

2023年机器学习的十大概念和技术Apr 04, 2023 pm 12:30 PM机器学习是一个不断发展的学科,一直在创造新的想法和技术。本文罗列了2023年机器学习的十大概念和技术。 本文罗列了2023年机器学习的十大概念和技术。2023年机器学习的十大概念和技术是一个教计算机从数据中学习的过程,无需明确的编程。机器学习是一个不断发展的学科,一直在创造新的想法和技术。为了保持领先,数据科学家应该关注其中一些网站,以跟上最新的发展。这将有助于了解机器学习中的技术如何在实践中使用,并为自己的业务或工作领域中的可能应用提供想法。2023年机器学习的十大概念和技术:1. 深度神经网

基于因果森林算法的决策定位应用Apr 08, 2023 am 11:21 AM

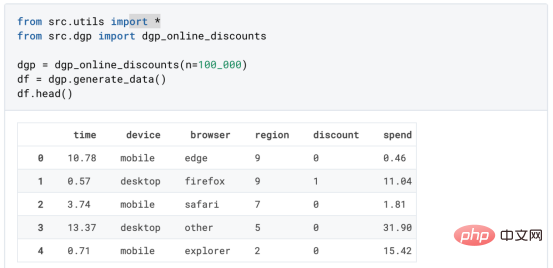

基于因果森林算法的决策定位应用Apr 08, 2023 am 11:21 AM译者 | 朱先忠审校 | 孙淑娟在我之前的博客中,我们已经了解了如何使用因果树来评估政策的异质处理效应。如果你还没有阅读过,我建议你在阅读本文前先读一遍,因为我们在本文中认为你已经了解了此文中的部分与本文相关的内容。为什么是异质处理效应(HTE:heterogenous treatment effects)呢?首先,对异质处理效应的估计允许我们根据它们的预期结果(疾病、公司收入、客户满意度等)选择提供处理(药物、广告、产品等)的用户(患者、用户、客户等)。换句话说,估计HTE有助于我

使用PyTorch进行小样本学习的图像分类Apr 09, 2023 am 10:51 AM

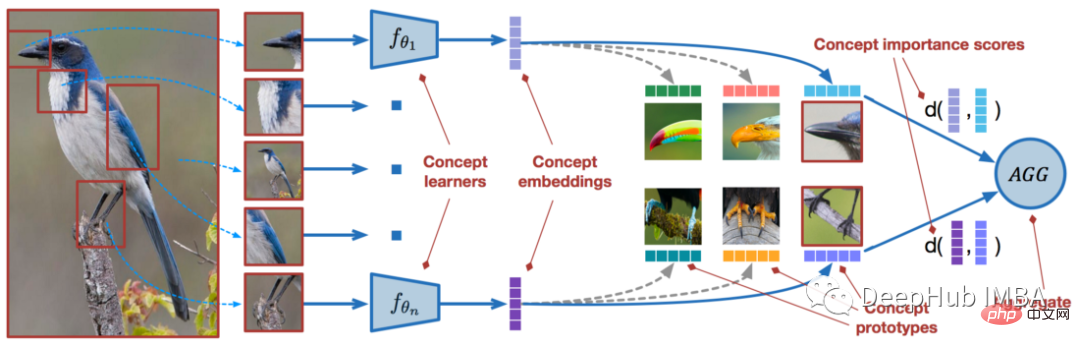

使用PyTorch进行小样本学习的图像分类Apr 09, 2023 am 10:51 AM近年来,基于深度学习的模型在目标检测和图像识别等任务中表现出色。像ImageNet这样具有挑战性的图像分类数据集,包含1000种不同的对象分类,现在一些模型已经超过了人类水平上。但是这些模型依赖于监督训练流程,标记训练数据的可用性对它们有重大影响,并且模型能够检测到的类别也仅限于它们接受训练的类。由于在训练过程中没有足够的标记图像用于所有类,这些模型在现实环境中可能不太有用。并且我们希望的模型能够识别它在训练期间没有见到过的类,因为几乎不可能在所有潜在对象的图像上进行训练。我们将从几个样本中学习

LazyPredict:为你选择最佳ML模型!Apr 06, 2023 pm 08:45 PM

LazyPredict:为你选择最佳ML模型!Apr 06, 2023 pm 08:45 PM本文讨论使用LazyPredict来创建简单的ML模型。LazyPredict创建机器学习模型的特点是不需要大量的代码,同时在不修改参数的情况下进行多模型拟合,从而在众多模型中选出性能最佳的一个。 摘要本文讨论使用LazyPredict来创建简单的ML模型。LazyPredict创建机器学习模型的特点是不需要大量的代码,同时在不修改参数的情况下进行多模型拟合,从而在众多模型中选出性能最佳的一个。本文包括的内容如下:简介LazyPredict模块的安装在分类模型中实施LazyPredict

Mango:基于Python环境的贝叶斯优化新方法Apr 08, 2023 pm 12:44 PM

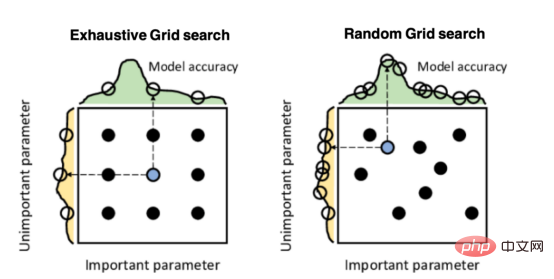

Mango:基于Python环境的贝叶斯优化新方法Apr 08, 2023 pm 12:44 PM译者 | 朱先忠审校 | 孙淑娟引言模型超参数(或模型设置)的优化可能是训练机器学习算法中最重要的一步,因为它可以找到最小化模型损失函数的最佳参数。这一步对于构建不易过拟合的泛化模型也是必不可少的。优化模型超参数的最著名技术是穷举网格搜索和随机网格搜索。在第一种方法中,搜索空间被定义为跨越每个模型超参数的域的网格。通过在网格的每个点上训练模型来获得最优超参数。尽管网格搜索非常容易实现,但它在计算上变得昂贵,尤其是当要优化的变量数量很大时。另一方面,随机网格搜索是一种更快的优化方法,可以提供更好的

人工智能自动获取知识和技能,实现自我完善的过程是什么Aug 24, 2022 am 11:57 AM

人工智能自动获取知识和技能,实现自我完善的过程是什么Aug 24, 2022 am 11:57 AM实现自我完善的过程是“机器学习”。机器学习是人工智能核心,是使计算机具有智能的根本途径;它使计算机能模拟人的学习行为,自动地通过学习来获取知识和技能,不断改善性能,实现自我完善。机器学习主要研究三方面问题:1、学习机理,人类获取知识、技能和抽象概念的天赋能力;2、学习方法,对生物学习机理进行简化的基础上,用计算的方法进行再现;3、学习系统,能够在一定程度上实现机器学习的系统。

超参数优化比较之网格搜索、随机搜索和贝叶斯优化Apr 04, 2023 pm 12:05 PM

超参数优化比较之网格搜索、随机搜索和贝叶斯优化Apr 04, 2023 pm 12:05 PM本文将详细介绍用来提高机器学习效果的最常见的超参数优化方法。 译者 | 朱先忠审校 | 孙淑娟简介通常,在尝试改进机器学习模型时,人们首先想到的解决方案是添加更多的训练数据。额外的数据通常是有帮助(在某些情况下除外)的,但生成高质量的数据可能非常昂贵。通过使用现有数据获得最佳模型性能,超参数优化可以节省我们的时间和资源。顾名思义,超参数优化是为机器学习模型确定最佳超参数组合以满足优化函数(即,给定研究中的数据集,最大化模型的性能)的过程。换句话说,每个模型都会提供多个有关选项的调整“按钮

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

WebStorm Mac版

好用的JavaScript开发工具

mPDF

mPDF是一个PHP库,可以从UTF-8编码的HTML生成PDF文件。原作者Ian Back编写mPDF以从他的网站上“即时”输出PDF文件,并处理不同的语言。与原始脚本如HTML2FPDF相比,它的速度较慢,并且在使用Unicode字体时生成的文件较大,但支持CSS样式等,并进行了大量增强。支持几乎所有语言,包括RTL(阿拉伯语和希伯来语)和CJK(中日韩)。支持嵌套的块级元素(如P、DIV),

Dreamweaver CS6

视觉化网页开发工具

PhpStorm Mac 版本

最新(2018.2.1 )专业的PHP集成开发工具

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。