HuggingFace开源大模型排行榜,又被屠榜了。

前排被清一色的SOLAR 10.7B微调版本占据,把几周之前的各种Mixtral 8x7B微调版本挤了下去。

SOLAR大模型什么来头?

相关论文刚刚上传到ArXiv,来自韩国公司Upstage AI,使用了新的大模型扩展方法depth up-scaling(DUS)。

简单来说就是两只7B羊驼掐头去尾,一只砍掉前8层,一只砍掉后8层。

剩下两个24层缝合在一起,第一个模型的第24层与第二个模型的第9层拼接,最后变成新的48层10.7B大模型。

论文声称新方法超过传统扩展方法如MoE,而且可以与沿用基础大模型完全相同的基础设施。

不需要门控网络等附加模块,针对MoE优化训练框架了,也不需要自定义CUDA内核来快速推理,可以无缝集成到现有方法中,同时保持高效。

团队选择7B规模最强的单体大模型Mistral 7B作为底材,用新方法拼接起来,再超越原版以及MoE版。

同时,经过对齐的Instruct版本也超越对应的MoE Instruct版本。

将缝合进行到底

为什么是这种拼接方式,论文中介绍来自一种直觉。

从最简单的扩展方式开始,也就是把32层的基础大模型重复两次,变成64层。

这样做的好处是不存在异质性,所有层都来自基础大模型,但第32层和第33层(与第1层相同)的接缝处有较大的“层距离”(layer distance)。

之前有研究表明,Transformer不同层做不同的事,如越深的层擅长处理越抽象的概念。

团队认为层距离过大可能妨碍模型有效利用预训练权重的能力。

一个潜在的解决方案是牺牲中间层,从而减少接缝处的差异,DUS方法就从这里诞生。

根据性能与模型尺寸的权衡,团队选择从每个模型中删除8层,接缝处从32层连第1层,变成了24层连第9层。

简单拼接后的模型,性能一开始还是会低于原版基础模型,但经过继续预训练可以迅速恢复。

在指令微调阶段,除了使用开源数据集,还制作了数学强化数据集,对齐阶段使用DPO。

最后一步,把使用不同数据集训练的模型版本加权平均,也是把缝合进行到底了。

有网友质疑测试数据泄露的可能性。

团队也考虑到这一点,在论文附录中专门报告了数据污染测试结果,显示出低水平。

最后,SOLAR 10.7B基础模型和微调模型都以Apache 2.0协议开源。

试用过的网友反馈,从JSON格式数据中提取数据表现不错。

论文地址:https://arxiv.org/abs/2312.15166

以上是HuggingFace屠榜:将两只羊驼去掉头尾后拼接在一起的详细内容。更多信息请关注PHP中文网其他相关文章!

个人黑客将是一只非常凶猛的熊May 11, 2025 am 11:09 AM

个人黑客将是一只非常凶猛的熊May 11, 2025 am 11:09 AM网络攻击正在发展。 通用网络钓鱼电子邮件的日子已经一去不复返了。 网络犯罪的未来是超个性化的,利用了容易获得的在线数据和AI来制作高度针对性的攻击。 想象一个知道您的工作的骗子

教皇狮子座XIV揭示了AI如何影响他的名字选择May 11, 2025 am 11:07 AM

教皇狮子座XIV揭示了AI如何影响他的名字选择May 11, 2025 am 11:07 AM新当选的教皇狮子座(Leo Xiv)在对红衣主教学院的就职演讲中,讨论了他的同名人物教皇里奥XIII的影响,他的教皇(1878-1903)与汽车和汽车和汽车公司的黎明相吻合

Fastapi -MCP初学者和专家教程-Analytics VidhyaMay 11, 2025 am 10:56 AM

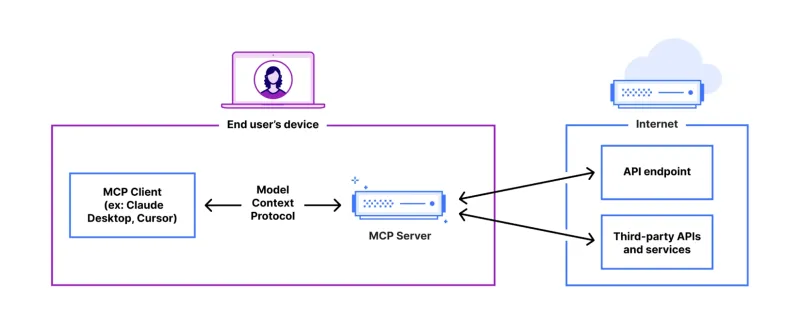

Fastapi -MCP初学者和专家教程-Analytics VidhyaMay 11, 2025 am 10:56 AM本教程演示了如何使用模型上下文协议(MCP)和FastAPI将大型语言模型(LLM)与外部工具集成在一起。 我们将使用FastAPI构建一个简单的Web应用程序,并将其转换为MCP服务器,使您的L

dia-1.6b tts:最佳文本到二元格生成模型 - 分析vidhyaMay 11, 2025 am 10:27 AM

dia-1.6b tts:最佳文本到二元格生成模型 - 分析vidhyaMay 11, 2025 am 10:27 AM探索DIA-1.6B:由两个本科生开发的开创性的文本对语音模型,零资金! 这个16亿个参数模型产生了非常现实的语音,包括诸如笑声和打喷嚏之类的非语言提示。本文指南

AI可以使指导比以往任何时候都更有意义May 10, 2025 am 11:17 AM

AI可以使指导比以往任何时候都更有意义May 10, 2025 am 11:17 AM我完全同意。 我的成功与导师的指导密不可分。 他们的见解,尤其是关于业务管理,构成了我的信念和实践的基石。 这种经验强调了我对导师的承诺

AI发掘了采矿业的新潜力May 10, 2025 am 11:16 AM

AI发掘了采矿业的新潜力May 10, 2025 am 11:16 AMAI 增强型矿业设备 矿业作业环境恶劣且危险重重。人工智能系统通过将人类从最危险的环境中移除并增强人类能力,帮助提高整体效率和安全性。人工智能越来越多地用于为矿业作业中使用的自动驾驶卡车、钻机和装载机提供动力。 这些 AI 驱动的车辆能够在危险环境中精确作业,从而提高安全性和生产力。一些公司已经开发出用于大型矿业作业的自动驾驶采矿车辆。 在挑战性环境中运行的设备需要持续维护。然而,维护会使关键设备离线并消耗资源。更精确的维护意味着昂贵且必要的设备的正常运行时间增加以及显着的成本节约。 AI 驱动

为什么AI代理会触发25年来最大的工作场所革命May 10, 2025 am 11:15 AM

为什么AI代理会触发25年来最大的工作场所革命May 10, 2025 am 11:15 AMSalesforce首席执行官Marc Benioff预测了由AI代理商驱动的巨大的工作场所革命,这是Salesforce及其客户群中已经进行的转型。 他设想从传统市场转变为一个较大的市场,重点是

随着AI采用的飙升,人力资源将摇滚我们的世界May 10, 2025 am 11:14 AM

随着AI采用的飙升,人力资源将摇滚我们的世界May 10, 2025 am 11:14 AM人力资源中AI的崛起:与机器人同事一起导航劳动力 将人工智能集成到人力资源(HR)不再是未来派的概念。它正在迅速成为新现实。 这种转变影响了人力资源专业人员和员工,DEM

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

SublimeText3 Linux新版

SublimeText3 Linux最新版

禅工作室 13.0.1

功能强大的PHP集成开发环境

WebStorm Mac版

好用的JavaScript开发工具

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。

Dreamweaver CS6

视觉化网页开发工具