大模型涌向移动端的浪潮愈演愈烈,终于有人把多模态大模型也搬到了移动端上。近日,美团、浙大等推出了能够在移动端部署的多模态大模型,包含了 LLM 基座训练、SFT、VLM 全流程。也许不久的将来,每个人都能方便、快捷、低成本的拥有属于自己的大模型。

论文地址:https://arxiv.org/pdf/2312.16886.pdf Code 地址:https://github.com/Meituan-AutoML/MobileVLM

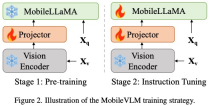

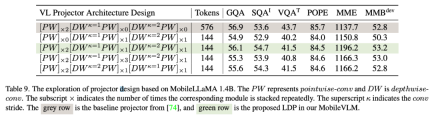

本文提出了 MobileVLM,它是专为移动场景定制的多模态视觉语言模型的全栈级改造。据作者表示,这是首个从零开始提供详细、可复现和强大性能的视觉语言模型。通过受控和开源数据集,研究者建立了一套高性能的基础语言模型和多模态模型。 本文对视觉编码器的设计进行了广泛的消融实验,并系统地评估了 VLM 对各种训练范式、输入分辨率和模型大小的性能敏感性。 本文在视觉特征和文本特征之间设计了一种高效的映射网络,能更好地对齐多模态特征,同时减少推理消耗。 本文设计的模型可以在低功耗的移动设备上高效运行,在高通的移动 CPU 和 65.5 英寸处理器上的测量速度为 21.5 tokens/s。 MobileVLM 和大量 多模态大模型在 benchmark 的表现不相上下,证明了其在众多实际任务中的应用潜力。虽然本文主要关注的是边缘场景,但 MobileVLM 优于许多最新的 VLM,而这些 VLM 只能由云端强大的 GPU 支持。

为输入,视觉编码器 F_enc 从中提取视觉嵌入

为输入,视觉编码器 F_enc 从中提取视觉嵌入  用于图像感知,其中 N_v = HW/P^2 表示图像块数,D_v 表示视觉嵌入的隐层大小。为了缓解因处理图像 tokens 效率问题,研究者设计了一种轻量级映射网络 P,用于视觉特征压缩和视觉 - 文本模态的对齐。它将 f 转换到词嵌入空间中,并为后续的语言模型提供合适的输入维度,如下所示:

用于图像感知,其中 N_v = HW/P^2 表示图像块数,D_v 表示视觉嵌入的隐层大小。为了缓解因处理图像 tokens 效率问题,研究者设计了一种轻量级映射网络 P,用于视觉特征压缩和视觉 - 文本模态的对齐。它将 f 转换到词嵌入空间中,并为后续的语言模型提供合适的输入维度,如下所示:

和文本的 tokens

和文本的 tokens ,其中 N_t 表示文本 tokens 的数量,D_t 表示单词嵌入空间的大小。在目前的 MLLM 设计范式中,LLM 的计算量和内存消耗量最大,有鉴于此,本文为移动应用量身定制了一系列推理友好型 LLM,在速度上具有相当的优势,能够以自回归方式对多模态输入进行预测

,其中 N_t 表示文本 tokens 的数量,D_t 表示单词嵌入空间的大小。在目前的 MLLM 设计范式中,LLM 的计算量和内存消耗量最大,有鉴于此,本文为移动应用量身定制了一系列推理友好型 LLM,在速度上具有相当的优势,能够以自回归方式对多模态输入进行预测 ,其中 L 表示输出的 tokens 长度。这一过程可表述为

,其中 L 表示输出的 tokens 长度。这一过程可表述为 。

。应用 RoPE 注入位置信息。 应用预归一化来稳定训练。具体来说,本文使用 RMSNorm 代替层归一化, MLP 膨胀比使用 8/3 而不是 4。 使用 SwiGLU 激活函数代替 GELU 。

作为输入,并输出有效提取和对齐的视觉标记

作为输入,并输出有效提取和对齐的视觉标记  。

。

以上是美团、浙大等合作,打造全流程移动端多模态大模型MobileVLM,能够实时运行,并且采用骁龙888处理器的详细内容。更多信息请关注PHP中文网其他相关文章!

Gemma范围:Google'用于凝视AI的显微镜Apr 17, 2025 am 11:55 AM

Gemma范围:Google'用于凝视AI的显微镜Apr 17, 2025 am 11:55 AM使用Gemma范围探索语言模型的内部工作 了解AI语言模型的复杂性是一个重大挑战。 Google发布的Gemma Scope是一种综合工具包,为研究人员提供了一种强大的探索方式

谁是商业智能分析师以及如何成为一位?Apr 17, 2025 am 11:44 AM

谁是商业智能分析师以及如何成为一位?Apr 17, 2025 am 11:44 AM解锁业务成功:成为商业智能分析师的指南 想象一下,将原始数据转换为驱动组织增长的可行见解。 这是商业智能(BI)分析师的力量 - 在GU中的关键作用

如何在SQL中添加列? - 分析VidhyaApr 17, 2025 am 11:43 AM

如何在SQL中添加列? - 分析VidhyaApr 17, 2025 am 11:43 AMSQL的Alter表语句:动态地将列添加到数据库 在数据管理中,SQL的适应性至关重要。 需要即时调整数据库结构吗? Alter表语句是您的解决方案。本指南的详细信息添加了Colu

业务分析师与数据分析师Apr 17, 2025 am 11:38 AM

业务分析师与数据分析师Apr 17, 2025 am 11:38 AM介绍 想象一个繁华的办公室,两名专业人员在一个关键项目中合作。 业务分析师专注于公司的目标,确定改进领域,并确保与市场趋势保持战略一致。 simu

什么是Excel中的Count和Counta? - 分析VidhyaApr 17, 2025 am 11:34 AM

什么是Excel中的Count和Counta? - 分析VidhyaApr 17, 2025 am 11:34 AMExcel 数据计数与分析:COUNT 和 COUNTA 函数详解 精确的数据计数和分析在 Excel 中至关重要,尤其是在处理大型数据集时。Excel 提供了多种函数来实现此目的,其中 COUNT 和 COUNTA 函数是用于在不同条件下统计单元格数量的关键工具。虽然这两个函数都用于计数单元格,但它们的设计目标却针对不同的数据类型。让我们深入了解 COUNT 和 COUNTA 函数的具体细节,突出它们独特的特性和区别,并学习如何在数据分析中应用它们。 要点概述 理解 COUNT 和 COU

Chrome在这里与AI:每天都有新事物!Apr 17, 2025 am 11:29 AM

Chrome在这里与AI:每天都有新事物!Apr 17, 2025 am 11:29 AMGoogle Chrome的AI Revolution:个性化和高效的浏览体验 人工智能(AI)正在迅速改变我们的日常生活,而Google Chrome正在领导网络浏览领域的负责人。 本文探讨了兴奋

AI的人类方面:福祉和四人底线Apr 17, 2025 am 11:28 AM

AI的人类方面:福祉和四人底线Apr 17, 2025 am 11:28 AM重新构想影响:四倍的底线 长期以来,对话一直以狭义的AI影响来控制,主要集中在利润的最低点上。但是,更全面的方法认识到BU的相互联系

您应该知道的5个改变游戏规则的量子计算用例Apr 17, 2025 am 11:24 AM

您应该知道的5个改变游戏规则的量子计算用例Apr 17, 2025 am 11:24 AM事情正稳步发展。投资投入量子服务提供商和初创企业表明,行业了解其意义。而且,越来越多的现实用例正在出现以证明其价值超出

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

WebStorm Mac版

好用的JavaScript开发工具

SublimeText3 Linux新版

SublimeText3 Linux最新版

Atom编辑器mac版下载

最流行的的开源编辑器

SublimeText3 英文版

推荐:为Win版本,支持代码提示!

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。