写在前面 & 个人理解

时序融合是提升自动驾驶3D目标检测感知能力的有效途径,但目前的方法在实际自动驾驶场景中应用存在成本开销等问题。最新研究文章《基于查询的显式运动时序融合用于3D目标检测》在NeurIPS 2023中提出了一种新的时序融合方法,将稀疏查询作为时序融合的对象,并利用显式运动信息来生成时序注意力矩阵,以适应大规模点云的特性。该方法由华中科技大学和百度的研究者提出,被称为QTNet:基于查询和显式运动的3D目标检测时序融合方法。实验证明,QTNet能够在几乎没有成本开销的情况下为点云、图像和多模态检测器带来一致的性能提升

- 论文链接:https://openreview.net/pdf?id=gySmwdmVDF

- 代码链接:https://github.com/AlmoonYsl/QTNet

问题背景

得益于现实世界的时间连续性,时间维度上的信息可以使得感知信息更加完备,进而提高目标检测的精度和鲁棒性,例如时序信息可以帮助解决目标检测中的遮挡问题、提供目标的运动状态和速度信息、提供目标的持续性和一致性信息。因此如何高效地利用时序信息是自动驾驶感知的一个重要问题。现有的时序融合方法主要分为两类。一类是基于稠密的BEV特征进行时序融合(点云/图像时序融合都适用),另一类则是基于3D Proposal特征进行时序融合 (主要针对点云时序融合方法)。对于基于BEV特征的时序融合,由于BEV上超过90%的点都是背景,而该类方法没有更多地关注前景对象,这导致了大量没有必要的计算开销和次优的性能。对于基于3D Proposal的时序融合算法,其通过耗时的3D RoI Pooling来生成3D Proposal特征,尤其是在目标物较多,点云数量较多的情况下,3D RoI Pooling所带来的开销在实际应用中往往是难以接受的。此外,3D Proposal 特征严重依赖于Proposal的质量,这在复杂场景中往往是受限的。因此,目前的方法都难以以极低开销的方式高效地引入时序融合来增强3D目标检测的性能。

如何实现高效的时序融合?

DETR是一种十分优秀的目标检测范式,其提出的Query设计和Set Prediction思想有效地实现了无需任何后处理的优雅检测范式。在DETR中,每个Query代表一个物体,并且Query相对于稠密的特征来说十分稀疏(一般Query的数目会被设置为一个相对较少的固定数目)。如果以Quey作为时序融合的对象,那计算开销的问题自然下降一个层次。因此DETR的Query范式是一种天然适合于时序融合的范式。时序融合需要构建多帧之间的物体关联,以此实现时序上下文信息的综合。那么主要问题在于如何构建基于Query的时序融合pipeline和两帧间的Query建立关联。

- 由于在实际场景中自车往往存在的运动,因此两帧的点云/图像往往是坐标系不对齐的,并且实际应用中不可能在当前帧对所有历史帧重新forward一次网络来提取对齐后点云/图像的特征。因此本文采用Memory Bank的方式来只存储历史帧得到的Query特征及其对应的检测结果,以此来避免重复计算。

- 由于点云和图像在描述目标特征上存在很大差异,通过特征层面来构建统一时序融合方法是不太可行的。然而,在三维空间下,无论点云还是图像模态都能通过目标的几何位置/运动信息关系来刻画相邻帧之间的关联关系。因此,本文采用物体的几何位置和对应的运动信息来引导两帧间物体的注意力矩阵。

方法介绍

QTNet的核心思想是利用Memory Bank存储在历史帧中获得的Query特征及其对应的检测结果,以避免重复计算历史帧的开销。在两帧Query之间,使用运动引导的注意力矩阵进行关系建模

总体框架

如框架图所示,QTNet包含3D DETR结构的3D目标检测器(LiDAR、Camera和多模态均可),Memory Bank和用于时序融合的Motion-guided Temporal Modeling Module (MTM)。QTNet通过DETR结构的3D目标检测器获取对应帧的Query特征及其检测结果,并将得到的Query特征及其检测结果以先进先出队列(FIFO)的方式送入Memory Bank中。Memory Bank的数目设置为时序融合所需的帧数。对于时序融合,QTNet从Memory Bank中从最远时刻开始读取数据,通过MTM模块以迭代的方式从 帧到 帧融合MemoryBank中的所有特征以用来增强当前帧的Query特征,并根据增强后的Query特征来Refine对应的当前帧的检测结果。

具体而言,QTNet在 帧融合 和 帧的Query特征 和 ,并得到增强后的 帧的Query特征 。接着,QTNet再将 与 帧的Query特征进行融合。以此通过迭代的方式不断融合至 帧。注意,这里从 帧到 帧所使用的MTM全部是共享参数的。

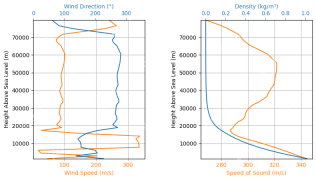

运动引导注意力模块

MTM使用物体的中心点位置来显式生成 帧Query和 帧Query的注意力矩阵。给定ego pose矩阵 和 、物体中心点、速度。首先,MTM使用ego pose和物体预测的速度信息将上一帧的物体移动到下一帧并对齐两帧的坐标系:

接着通过 帧物体中心点和 帧经过矫正的中心点构建欧式代价矩阵 。此外,为了避免可能发生的错误匹配,本文使用类别 和距离阈值 构造注意力掩码 :

将代价矩阵转换成注意力矩阵是最终目标

将注意力矩阵 作用在 帧的增强后的Query特征 来聚合时序特征以增强 帧的Query特征:

最终增强后的 帧的Query特征 经过简单的FFN来Refine对应的检测结果,以实现增强检测性能的作用。

解耦时序融合结构

观察到时序融合的分类和回归学习存在不平衡问题,一种解决办法是分别为分类和回归设计时序融合分支。然而,这种解耦方式会增加更多的计算成本和延迟,对于大多数方法而言不可接受。相比之下,QTNet利用高效的时序融合设计,其计算成本和延迟可以忽略不计,与整个3D检测网络相比表现更优。因此,本文采取了分类和回归分支在时序融合上的解耦方式,以在可忽略不计的成本情况下取得更好的检测性能,如图所示

实验效果

QTNet在点云/图像/多模态上实现一致涨点

在nuScenes数据集上进行验证后发现,QTNet在不使用未来信息、TTA和模型集成的情况下,取得了68.4的mAP和72.2的NDS,达到了SOTA性能。与使用了未来信息的MGTANet相比,在3帧时序融合的情况下,QTNet的性能优于MGTANet,分别提高了3.0的mAP和1.0的NDS

此外,本文也在多模态和基于环视图的方法上进行了验证,在nuScenes验证集上的实验结果证明了QTNet在不同模态上的有效性。

对于实际应用来说,时序融合的成本开销非常重要。本文对QTNet在计算量、时延和参数量三个方面进行了分析实验。结果表明,与整个网络相比,QTNet对于不同基准线所带来的计算开销、时间延迟和参数量都可以忽略不计,尤其是计算量仅仅使用了0.1G FLOPs(LiDAR基准线)

不同时序融合范式比较

为了验证基于Query的时序融合范式的优越性,我们选择了具有代表性的不同前沿时序融合方法进行比较。通过实验结果发现,基于Query范式的时序融合算法相较于基于BEV和基于Proposal范式更加高效。在仅使用0.1G FLOPs和4.5ms的开销下,QTNet表现出更加优秀的性能,同时整体参数量仅为0.3M

消融实验

本研究在nuScenes验证集上进行了基于LiDAR baseline的消融实验,通过3帧时序融合的方式。实验结果表明,简单地使用Cross Attention来建模时序关系并没有明显的效果。然而,当使用MTM后,检测性能显著提升,这说明在大规模点云下显式运动引导的重要性。此外,通过消融实验还发现,QTNet的整体设计非常轻量且高效。在使用4帧数据进行时序融合时,QTNet的计算量仅为0.24G FLOPs,延迟也只有6.5毫秒

MTM的可视化

为了探究MTM优于Cross Attention的原因,本文将两帧间物体的注意力矩阵进行可视化,其中相同的ID代表两帧间同一个物体。可以发现由MTM生成的注意力矩阵(b)比Cross Attention生成的注意力矩阵(a)更加具有区分度,尤其是小物体之间的注意力矩阵。这表明由显式运动引导的注意力矩阵通过物理建模的方式使得模型更加容易地建立起两帧间物体的关联。本文仅仅只是初步探索了在时序融合中以物理方式建立时序关联问题,对于如何更好构建时序关联仍然是值得探索的。

检测结果的可视化

本文以场景序列为对象进行了检测结果的可视化分析。可以发现左下角的小物体从 帧开始快速远离自车,这导致baseline在 帧漏检了该物体,然而QTNet在 帧仍然可以检测到该物体,这证明了QTNet在时序融合上的有效性。

本文总结

本文针对目前3D目标检测任务提出了更加高效的基于Query的时序融合方法QTNet。其主要核心有两点:一是使用稀疏Query作为时序融合的对象并通过Memory Bank存储历史信息以避免重复的计算,二是使用显式的运动建模来引导时序Query间的注意力矩阵的生成,以此实现时序关系建模。通过这两个关键思路,QTNet能够高效地实现可应用于LiDAR、Camera、多模态的时序融合,并以可忽略不计的成本开销一致性地增强3D目标检测的性能。

需要重新改写的内容是:原文链接:https://mp.weixin.qq.com/s/s9tkF_rAP2yUEkn6tp9eUQ

以上是QTNet:全新时序融合方案解决方案,适用于点云、图像和多模态检测器(NeurIPS 2023)的详细内容。更多信息请关注PHP中文网其他相关文章!

如何使用LM Studio在本地运行LLM? - 分析VidhyaApr 19, 2025 am 11:38 AM

如何使用LM Studio在本地运行LLM? - 分析VidhyaApr 19, 2025 am 11:38 AM轻松在家运行大型语言模型:LM Studio 使用指南 近年来,软件和硬件的进步使得在个人电脑上运行大型语言模型 (LLM) 成为可能。LM Studio 就是一个让这一过程变得轻松便捷的优秀工具。本文将深入探讨如何使用 LM Studio 在本地运行 LLM,涵盖关键步骤、潜在挑战以及在本地拥有 LLM 的优势。无论您是技术爱好者还是对最新 AI 技术感到好奇,本指南都将提供宝贵的见解和实用技巧。让我们开始吧! 概述 了解在本地运行 LLM 的基本要求。 在您的电脑上设置 LM Studi

盖伊·佩里(Guy Peri)通过数据转换帮助麦考密克的未来Apr 19, 2025 am 11:35 AM

盖伊·佩里(Guy Peri)通过数据转换帮助麦考密克的未来Apr 19, 2025 am 11:35 AM盖伊·佩里(Guy Peri)是麦考密克(McCormick)的首席信息和数字官。尽管他的角色仅七个月,但Peri正在迅速促进公司数字能力的全面转变。他的职业生涯专注于数据和分析信息

迅速工程中的情感链是什么? - 分析VidhyaApr 19, 2025 am 11:33 AM

迅速工程中的情感链是什么? - 分析VidhyaApr 19, 2025 am 11:33 AM介绍 人工智能(AI)不仅要理解单词,而且要理解情感,从而以人的触感做出反应。 这种复杂的互动对于AI和自然语言处理的快速前进的领域至关重要。 Th

12个最佳数据科学工作流程的AI工具-Analytics VidhyaApr 19, 2025 am 11:31 AM

12个最佳数据科学工作流程的AI工具-Analytics VidhyaApr 19, 2025 am 11:31 AM介绍 在当今以数据为中心的世界中,利用先进的AI技术对于寻求竞争优势和提高效率的企业至关重要。 一系列强大的工具使数据科学家,分析师和开发人员都能构建,Depl

AV字节:OpenAI的GPT-4O Mini和其他AI创新Apr 19, 2025 am 11:30 AM

AV字节:OpenAI的GPT-4O Mini和其他AI创新Apr 19, 2025 am 11:30 AM本周的AI景观爆炸了,来自Openai,Mistral AI,Nvidia,Deepseek和Hugging Face等行业巨头的开创性发行。 这些新型号有望提高功率,负担能力和可访问性,这在TR的进步中推动了

报告发现,困惑的Android应用程序有安全缺陷。Apr 19, 2025 am 11:24 AM

报告发现,困惑的Android应用程序有安全缺陷。Apr 19, 2025 am 11:24 AM但是,该公司的Android应用不仅提供搜索功能,而且还充当AI助手,并充满了许多安全问题,可以将其用户暴露于数据盗用,帐户收购和恶意攻击中

每个人都擅长使用AI:关于氛围编码的想法Apr 19, 2025 am 11:17 AM

每个人都擅长使用AI:关于氛围编码的想法Apr 19, 2025 am 11:17 AM您可以查看会议和贸易展览中正在发生的事情。您可以询问工程师在做什么,或咨询首席执行官。 您看的任何地方,事情都以惊人的速度发生变化。 工程师和非工程师 有什么区别

火箭发射模拟和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM

火箭发射模拟和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM模拟火箭发射的火箭发射:综合指南 本文指导您使用强大的Python库Rocketpy模拟高功率火箭发射。 我们将介绍从定义火箭组件到分析模拟的所有内容

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

SublimeText3汉化版

中文版,非常好用

Dreamweaver Mac版

视觉化网页开发工具

Atom编辑器mac版下载

最流行的的开源编辑器

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。