2023 年即将过去。一年以来,各式各样的大模型争相发布。当 OpenAI 和谷歌等科技巨头正在角逐时,另一方「势力」悄然崛起 —— 开源。

开源模型受到的质疑一向不少。它们是否能像专有模型一样优秀?是否能够媲美专有模型的性能?迄今为止,我们一直还只能说是某些方面接近。即便如此,开源模型总会给我们带来经验的表现,让我们刮目相看。

开源模型的兴起正在改变游戏规则。如 Meta 的 LLaMA 系列以其快速迭代、可定制性和隐私性正受到追捧。这些模型被社区迅速发展,给专有模型带来了强有力的挑战,能够改变大型科技公司的竞争格局。

不过此前人们的想法大多只是来自于「感觉」。今天早上,Meta 首席 AI 科学家、图灵奖获得者 Yann LeCun 突然发出了这样的感叹:「开源人工智能模型正走在超越专有模型的路上。」

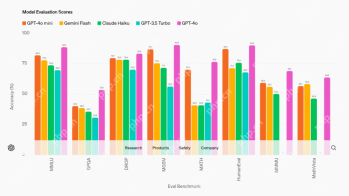

这个由方舟投资(ARK Invest)团队制作的趋势图被认为可能预测了2024年的人工智能发展。它展示了开源社区与专有模型在生成式人工智能方面的发展

随着OpenAI和Google等公司变得越来越封闭,他们公开最新模型信息的频率越来越少。因此,开源社区及其企业支持者Meta开始步入其后,使得生成式AI更加民主化,这或许会对专有模型的商业模式构成挑战

在这个散点图中显示了各种 AI 模型的性能百分比。专有模型用蓝色表示,开源模型用黑色表示。我们可以看到不同的 AI 模型如 GPT-3、Chinchilla 70B(谷歌)、PaLM(谷歌)、GPT-4(OpenAI)和 Llama65B(Meta)等在不同时间点的性能。

Meta 最初发布 LLaMA 时,参数量从 70 亿到 650 亿不等。这些模型的性能非常优异:具有 130 亿参数的 Llama 模型「在大多数基准上」可以胜过 GPT-3( 参数量达 1750 亿),而且可以在单块 V100 GPU 上运行;而最大的 650 亿参数的 Llama 模型可以媲美谷歌的 Chinchilla-70B 和 PaLM-540B。

Falcon-40B 刚发布就冲上了 Huggingface 的 OpenLLM 排行榜首位,改变了 Llama 一枝独秀的场面。

Llama 2 开源,再一次使大模型格局发生巨变。相比于 Llama 1,Llama 2 的训练数据多了 40%,上下文长度也翻倍,并采用了分组查询注意力机制。

最近,开源大模型宇宙又有了新的重量级成员 ——Yi 模型。它能一次处理 40 万汉字、中英均霸榜。Yi-34B 也成为迄今为止唯一成功登顶 Hugging Face 开源模型排行榜的国产模型。

根据散点图所示,开源模型的性能不断追赶专有模型。这意味着在不久的将来,开源模型有望与专有模型在性能上并驾齐驱,甚至超越

Mistral 8x7B在上周末以最朴素的发布方式和强大的性能引起了研究者的高度评价,他们表示「闭源大模型走到结局了。」

已经有网友开始预祝「2024年成为开源人工智能年」,认为「我们正在接近一个临界点。考虑到当前开源社区项目的发展速度,我们预计未来12个月内将达到GPT-4的水平。」

接下来,我们将拭目以待开源模型的未来是否一帆风顺,以及它将展现出怎样的表现

以上是开源大模型必须超越闭源——LeCun揭示2024年AI趋势图的详细内容。更多信息请关注PHP中文网其他相关文章!

如何使用LM Studio在本地运行LLM? - 分析VidhyaApr 19, 2025 am 11:38 AM

如何使用LM Studio在本地运行LLM? - 分析VidhyaApr 19, 2025 am 11:38 AM轻松在家运行大型语言模型:LM Studio 使用指南 近年来,软件和硬件的进步使得在个人电脑上运行大型语言模型 (LLM) 成为可能。LM Studio 就是一个让这一过程变得轻松便捷的优秀工具。本文将深入探讨如何使用 LM Studio 在本地运行 LLM,涵盖关键步骤、潜在挑战以及在本地拥有 LLM 的优势。无论您是技术爱好者还是对最新 AI 技术感到好奇,本指南都将提供宝贵的见解和实用技巧。让我们开始吧! 概述 了解在本地运行 LLM 的基本要求。 在您的电脑上设置 LM Studi

盖伊·佩里(Guy Peri)通过数据转换帮助麦考密克的未来Apr 19, 2025 am 11:35 AM

盖伊·佩里(Guy Peri)通过数据转换帮助麦考密克的未来Apr 19, 2025 am 11:35 AM盖伊·佩里(Guy Peri)是麦考密克(McCormick)的首席信息和数字官。尽管他的角色仅七个月,但Peri正在迅速促进公司数字能力的全面转变。他的职业生涯专注于数据和分析信息

迅速工程中的情感链是什么? - 分析VidhyaApr 19, 2025 am 11:33 AM

迅速工程中的情感链是什么? - 分析VidhyaApr 19, 2025 am 11:33 AM介绍 人工智能(AI)不仅要理解单词,而且要理解情感,从而以人的触感做出反应。 这种复杂的互动对于AI和自然语言处理的快速前进的领域至关重要。 Th

12个最佳数据科学工作流程的AI工具-Analytics VidhyaApr 19, 2025 am 11:31 AM

12个最佳数据科学工作流程的AI工具-Analytics VidhyaApr 19, 2025 am 11:31 AM介绍 在当今以数据为中心的世界中,利用先进的AI技术对于寻求竞争优势和提高效率的企业至关重要。 一系列强大的工具使数据科学家,分析师和开发人员都能构建,Depl

AV字节:OpenAI的GPT-4O Mini和其他AI创新Apr 19, 2025 am 11:30 AM

AV字节:OpenAI的GPT-4O Mini和其他AI创新Apr 19, 2025 am 11:30 AM本周的AI景观爆炸了,来自Openai,Mistral AI,Nvidia,Deepseek和Hugging Face等行业巨头的开创性发行。 这些新型号有望提高功率,负担能力和可访问性,这在TR的进步中推动了

报告发现,困惑的Android应用程序有安全缺陷。Apr 19, 2025 am 11:24 AM

报告发现,困惑的Android应用程序有安全缺陷。Apr 19, 2025 am 11:24 AM但是,该公司的Android应用不仅提供搜索功能,而且还充当AI助手,并充满了许多安全问题,可以将其用户暴露于数据盗用,帐户收购和恶意攻击中

每个人都擅长使用AI:关于氛围编码的想法Apr 19, 2025 am 11:17 AM

每个人都擅长使用AI:关于氛围编码的想法Apr 19, 2025 am 11:17 AM您可以查看会议和贸易展览中正在发生的事情。您可以询问工程师在做什么,或咨询首席执行官。 您看的任何地方,事情都以惊人的速度发生变化。 工程师和非工程师 有什么区别

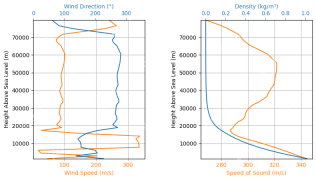

火箭发射模拟和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM

火箭发射模拟和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM模拟火箭发射的火箭发射:综合指南 本文指导您使用强大的Python库Rocketpy模拟高功率火箭发射。 我们将介绍从定义火箭组件到分析模拟的所有内容

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

Dreamweaver Mac版

视觉化网页开发工具

WebStorm Mac版

好用的JavaScript开发工具

禅工作室 13.0.1

功能强大的PHP集成开发环境