Adobe的新技术:用A100生成3D图像仅需30秒,让文本和图像动起来

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB转载

- 2023-11-27 14:29:18959浏览

2D扩散模型的引入极大地简化了图像内容的创作流程,对2D设计行业带来了革新。近年来,这一扩散模型已经扩展到了3D创作领域,降低了应用程序(如VR、AR、机器人技术和游戏等)中的人工成本。许多研究已经开始探索使用预训练的2D扩散模型,以及采用评分蒸馏采样(SDS)损失的NeRFs方法。然而,基于SDS的方法通常需要数小时的资源优化,并且经常引发图形中的几何问题,如多面Janus问题

另一方面,研究者对无需花费大量时间优化每个资源,也能够实现多样化生成的 3D 扩散模型也进行了多种尝试。这些方法通常需要获取包含真实数据的 3D 模型 / 点云用于训练。然而,对于真实图像来说,这种训练数据难以获得。由于目前的 3D 扩散方法通常基于两阶段训练,这导致在不分类、高度多样化的 3D 数据集上存在一个模糊且难以去噪的潜在空间,使得高质量渲染成为亟待解决的挑战。

为了解决这个问题,已经有研究者提出了单阶段模型,但是这些模型大多只针对特定的简单类别,泛化性较差

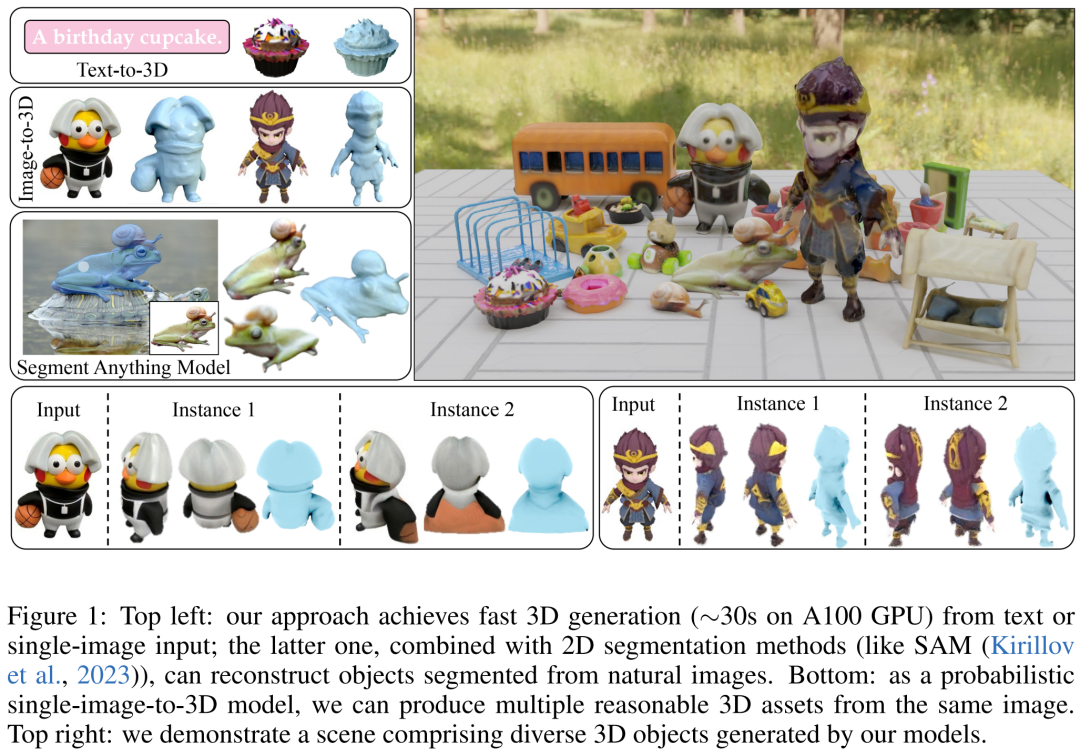

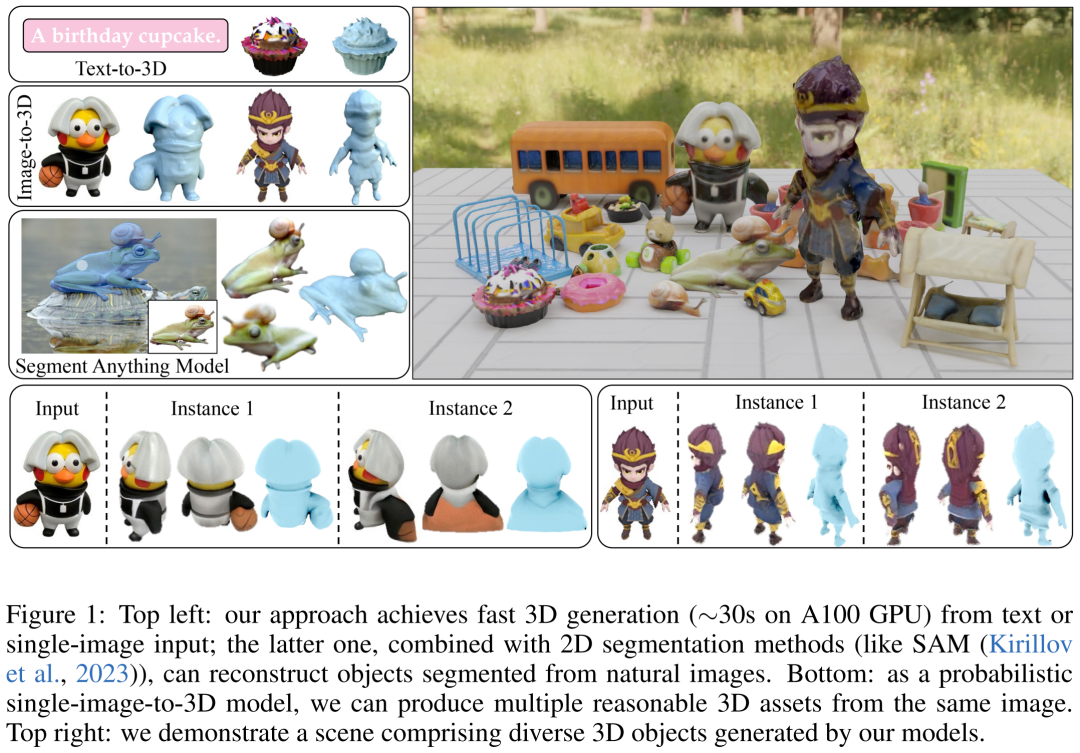

因此,本文研究者的目标是实现快速、逼真和通用的 3D 生成。为此,他们提出了 DMV3D。DMV3D 是一种全新的单阶段的全类别扩散模型,能直接根据模型文字或单张图片的输入,生成 3D NeRF。在单个 A100 GPU 上,仅需 30 秒,DMV3D 就能生成各种高保真 3D 图像。

具体而言,DMV3D是一个2D多视图图像扩散模型,它将3D NeRF的重建和渲染集成到其降噪器中,并以端到端的方式进行训练,无需直接进行3D监督。这样做避免了单独训练用于潜在空间扩散的3D NeRF编码器(例如两阶段模型)和繁琐的为每个对象进行优化的方法(例如SDS)中可能出现的问题

本文的方法本质上是在 2D 多视图扩散的框架基础上进行 3D 重建。这种方法是受到 RenderDiffusion 方法的启发,后者是一种通过单视图扩散实现 3D 生成的方法。然而,RenderDiffusion 方法的局限性在于,训练数据需要特定类别的先验知识,并且数据中的对象需要特定的角度或姿势,因此其泛化性很差,无法对任意类型的对象进行 3D 生成

据研究者认为,相较而言,只需要一组包含一个物体的四个多视角的稀疏投影,即可描述一个未被遮挡的3D物体。这种训练数据源于人类的空间想象能力,人们能够通过几个物体周围的平面视图构建出一个完整的3D物体。这种想象通常非常确切和具体化

不过,在应用这种输入时,仍然需要解决稀疏视图下进行3D重建的任务。这是一个长期存在的问题,即使在输入没有噪声的情况下,也是非常具有挑战性的

本文的方法能够基于单个图像 / 文本实现 3D 生成。对于图像输入,他们固定一个稀疏视图作为无噪声输入,并对其他视图进行类似于 2D 图像修复的降噪。为了实现基于文本的 3D 生成,研究者使用了在 2D 扩散模型中通常会用到的、基于注意力的文本条件和不受类型限制的分类器。

他们在训练过程中只使用了图像空间监督,并使用了由Objaverse合成的图像和MVImgNet真实捕获的图像组成的大型数据集。根据结果显示,DMV3D在单图像3D重建方面达到了SOTA水平,超过了以前基于SDS的方法和3D扩散模型。此外,基于文本的3D模型生成方法也比之前的方法更优

- 论文地址:https://arxiv.org/pdf/2311.09217.pdf

- 官网地址:https://justimyhxu.github.io/projects/dmv3d/

我们来看一下生成的 3D 图像效果。

方法概览

如何训练并推理单阶段 3D 扩散模型?

研究者首先引入了一种新的扩散框架,该框架使用基于重建的降噪器来对有噪声的多视图图像去噪以进行 3D 生成;其次他们提出了一种新的、以扩散时间步为条件的、基于 LRM 的多视图降噪器,从而通过 3D NeRF 重建和渲染来渐进地对多视图图像进行去噪;最后进一步对模型进行扩散,支持文本和图像调节,实现可控生成。

需要重写的内容是:多视图扩散和去噪。 重写后的内容:多角度视图扩散和降噪

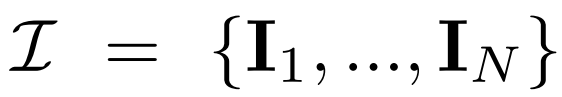

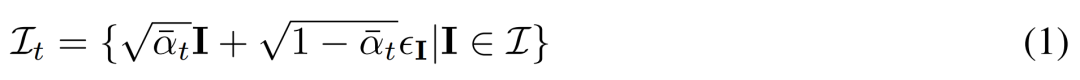

多视图扩散。2D扩散模型中处理的原始 x_0 分布在数据集中是单个图像分布。相反,研究者考虑的是多视图图像  的联合分布,其中每组

的联合分布,其中每组 都是从视点 C = {c_1, .. ., c_N} 中相同 3D 场景(资产)的图像观察结果。扩散过程相当于使用相同的噪声调度独立地对每个图像进行扩散操作,如下公式 (1) 所示。

都是从视点 C = {c_1, .. ., c_N} 中相同 3D 场景(资产)的图像观察结果。扩散过程相当于使用相同的噪声调度独立地对每个图像进行扩散操作,如下公式 (1) 所示。

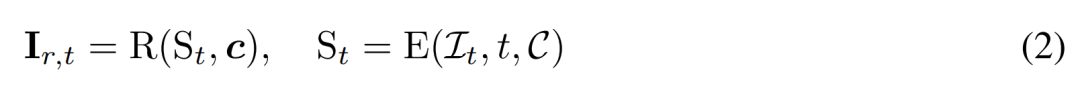

基于重建的去噪。2D 扩散过程的逆过程本质上是去噪。本文中,研究者提出利用 3D 重建和渲染来实现 2D 多视图图像去噪,同时输出干净的、用于 3D 生成的 3D 模型。具体来讲,他们使用 3D 重建模块 E (・) 来从有噪声的多视图图像 中重建 3D 表示 S,并使用可微渲染模块 R (・) 对去噪图像进行渲染,如下公式 (2) 所示。

中重建 3D 表示 S,并使用可微渲染模块 R (・) 对去噪图像进行渲染,如下公式 (2) 所示。

基于重建的多视图降噪器

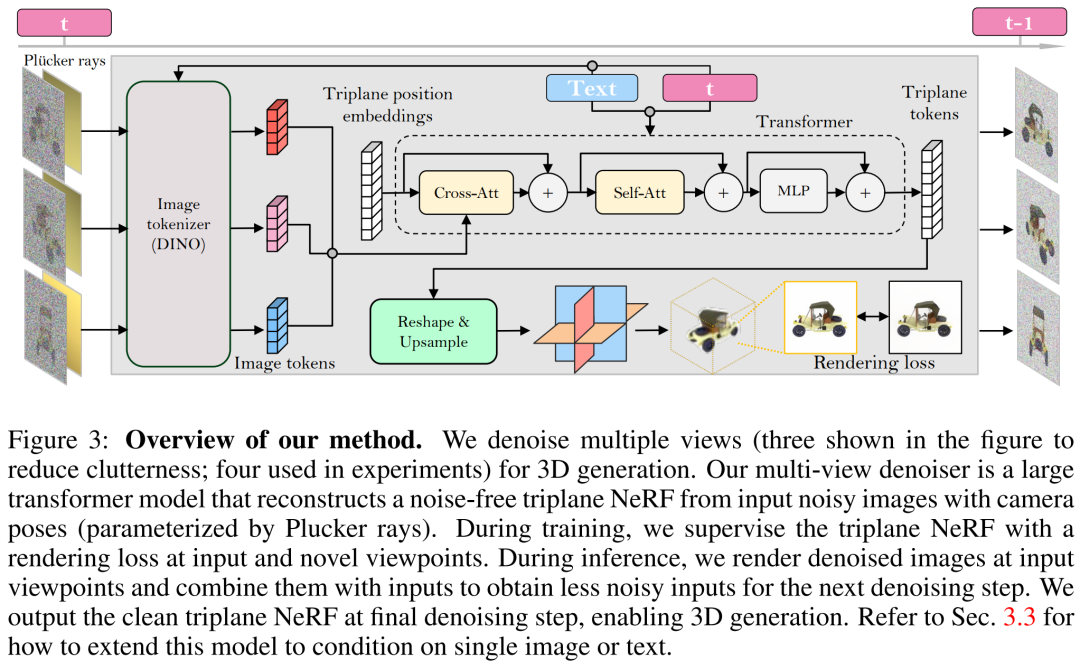

研究者基于 LRM 构建了多视图降噪器,并使用大型 transformer 模型从有噪声的稀疏视图姿态图像中重建了一个干净的三平面 NeRF,然后将重建后的三平面 NeRF 的渲染用作去噪输出。

重建和渲染。如下图 3 所示,研究者使用一个 Vision Transformer(DINO)来将输入图像  转化为 2D token,然后使用 transformer 将学得的三平面位置嵌入映射到最后的三平面,以表示资产的 3D 形状和外观。接下来将预测到的三平面用来通过一个 MLP 来解码体积密度和颜色,以进行可微体积渲染。

转化为 2D token,然后使用 transformer 将学得的三平面位置嵌入映射到最后的三平面,以表示资产的 3D 形状和外观。接下来将预测到的三平面用来通过一个 MLP 来解码体积密度和颜色,以进行可微体积渲染。

时间调节。与基于 CNN 的 DDPM(去噪扩散概率模型)相比,本文基于 transformer 的模型需要不同的时间调节设计。

在训练本文模型时,研究者指出,在具有高度多样化的相机内参和外参数据集(如MVImgNet)上,需要有效设计输入相机调节,以帮助模型理解相机并进行3D推理

进行内容的重写时,需要将原文的语言转换成中文,但不改变原文的意思

以上方法使研究者提出的模型可以充当一个无条件生成模型。他们介绍了如何利用条件降噪器  来对条件概率分布进行建模,其中 y 表示文本或图像,以实现可控 3D 生成。

来对条件概率分布进行建模,其中 y 表示文本或图像,以实现可控 3D 生成。

在图像调节方面,研究人员提出了一种简单而有效的策略,无需对模型的架构进行修改

文本调节。为了将文本调节添加到自己的模型中,研究者采用了类似于 Stable Diffusion 的策略。他们使用 CLIP 文本编码器生成文本嵌入,并使用交叉注意力将它们注入到降噪器中。

需要进行改写的内容是:培训和推理

训练。在训练阶段,研究者在范围 [1, T] 内均匀地采样时间步 t,并根据余弦调度来添加噪声。他们使用随机相机姿态对输入图像进行采样,还随机采样额外的新视点来监督渲染以获得更好的质量。

研究者使用条件信号y来最小化训练目标

推理。在推理阶段,研究者选择了以圆圈均匀围绕对象的视点,以确保很好地覆盖生成的 3D 资产。他们将四个视图的相机市场角固定为 50 度。

实验结果

在实验中,研究人员采用了AdamW优化器来训练他们的模型,初始学习率为4e^-4。他们为了这个学习率使用了3K步的预热和余弦衰减,使用256×256的输入图像来训练去噪模型,并使用128×128的裁剪图像进行监督渲染

关于数据集的内容需要重写为:研究者的模型只需使用多视图姿态图像进行训练。因此,他们使用了来自Objaverse数据集的约730k个对象的渲染后多视图图像。对于每个对象,他们按照LRM的设定,在固定50度FOV的随机视点下进行了32次图像渲染,并进行了均匀照明

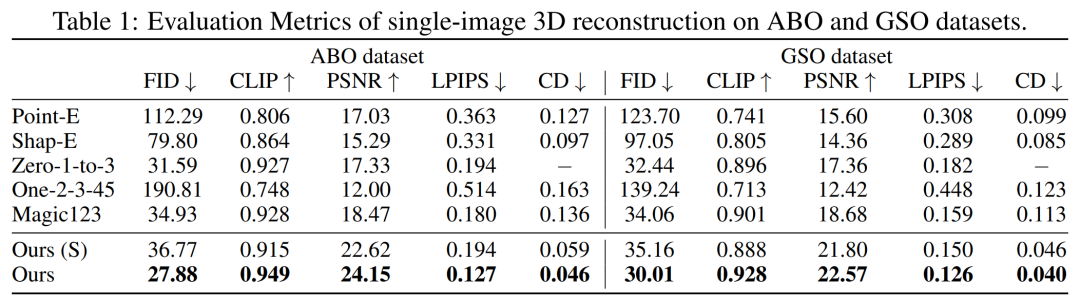

首先是单图像重建。研究者将自己的图像 - 调节模型与 Point-E、Shap-E、Zero-1-to-3 和 Magic123 等以往方法在单图像重建任务上进行了比较。他们使用到的指标有 PSNR、LPIPS、CLIP 相似性得分和 FID,以评估所有方法的新视图渲染质量。

GSO和ABO测试集上的定量结果如下表1所示。研究者的模型优于所有基线方法,并且在这两个数据集上实现了所有指标的新SOTA

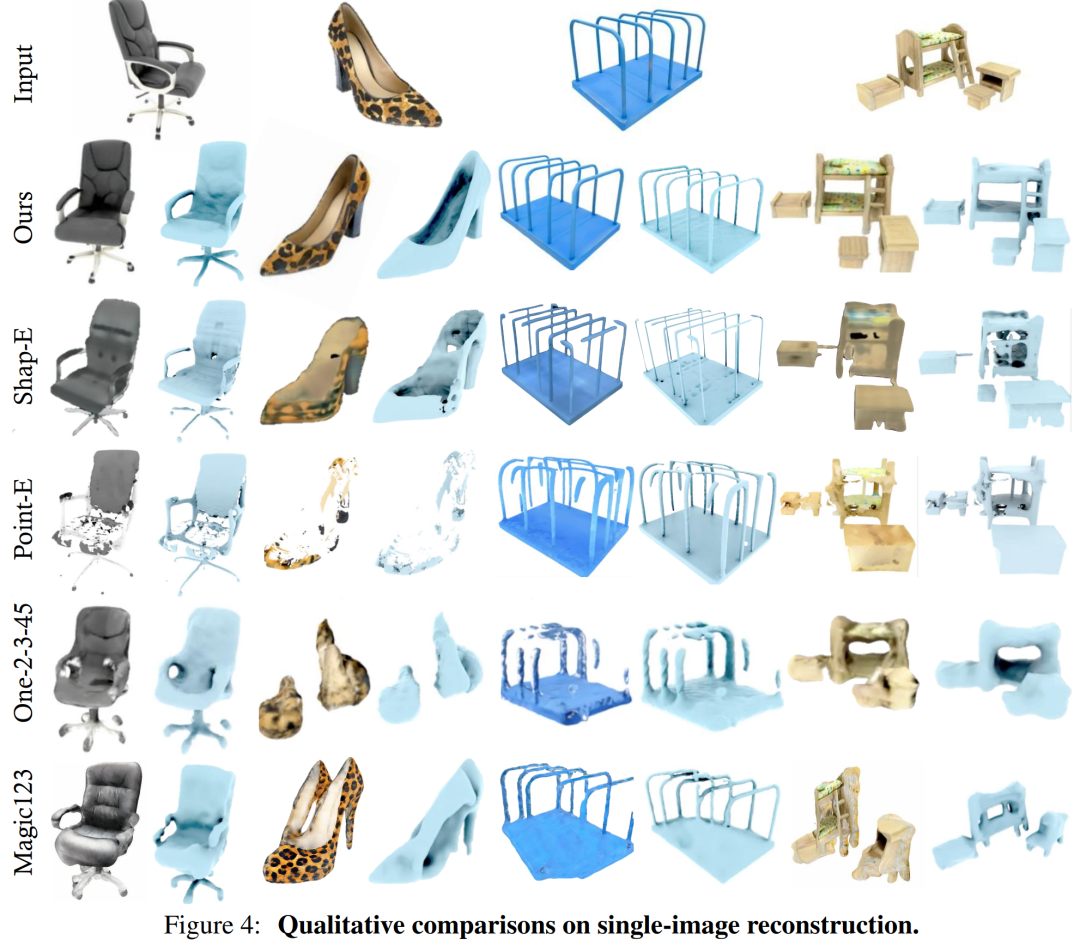

本文模型生成的结果在几何和外观细节方面相比基线具有更高质量,这一结果可以通过图4进行定性展示

DMV3D 是一个以2D图像为训练目标的单阶段模型,与之相比,它无需对每个资产单独优化,同时可以消除多视图扩散噪声并直接生成3D NeRF模型。总体而言,DMV3D能够快速生成3D图像,并获得最佳的单图像3D重建结果

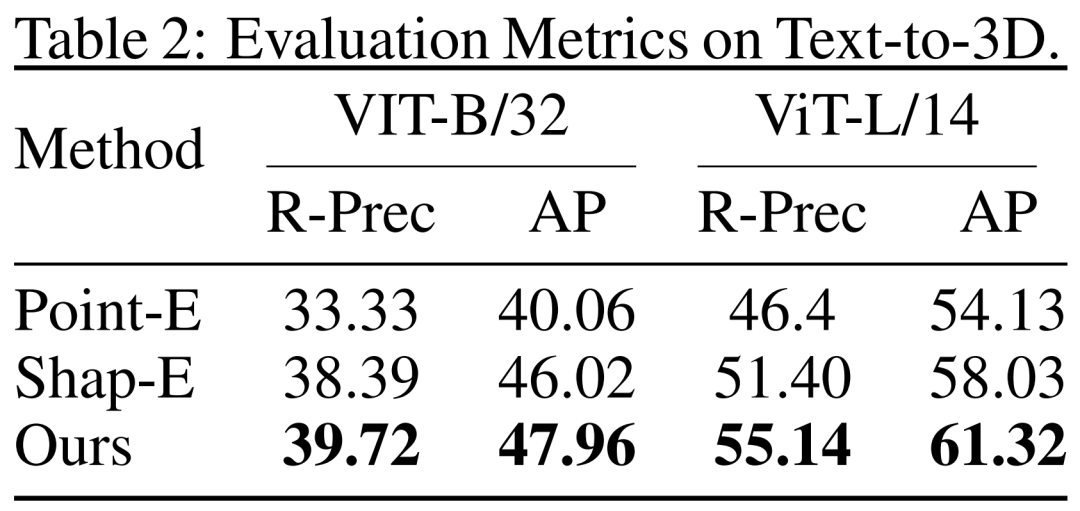

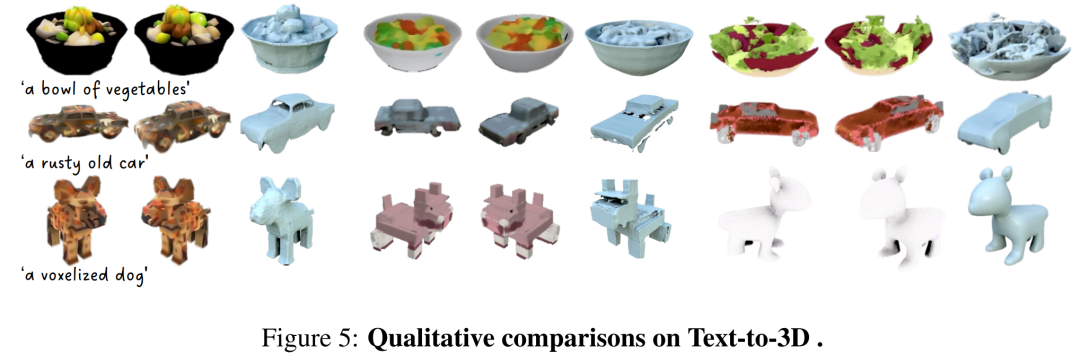

重新写作如下:研究人员还对基于文本的3D生成结果进行了DMV3D的评估。研究人员对比了DMV3D与同样支持全类别快速推理的Shap-E和Point-E。研究人员让这三个模型根据Shap-E的50个文本提示进行生成,并使用两个不同的ViT模型的CLIP准确度和平均准确度来评估生成结果,如表2所示

根据表中的数据显示,DMV3D展现出了最佳的精度。从图5中的定性结果可以看出,与其他模型生成的结果相比,DMV3D生成的图形明显包含更丰富的几何和外观细节,结果也更加逼真

需要重新改写的是:其他成果

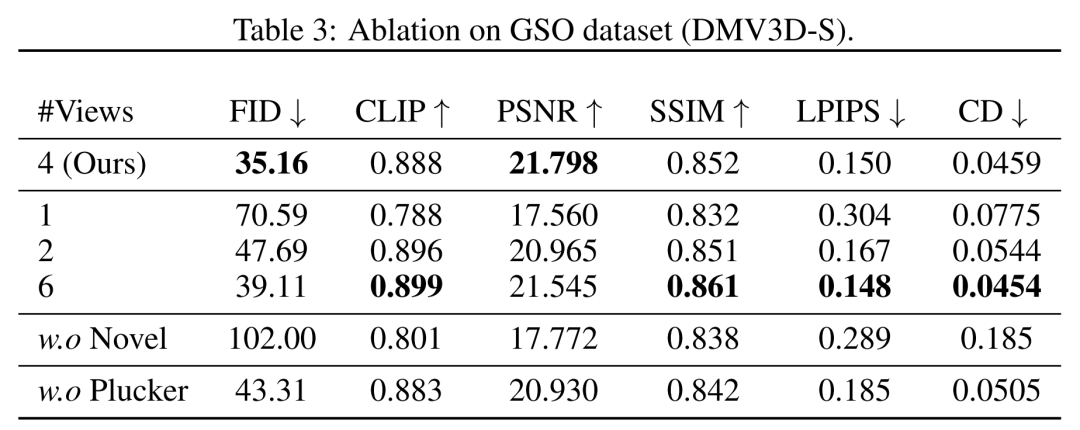

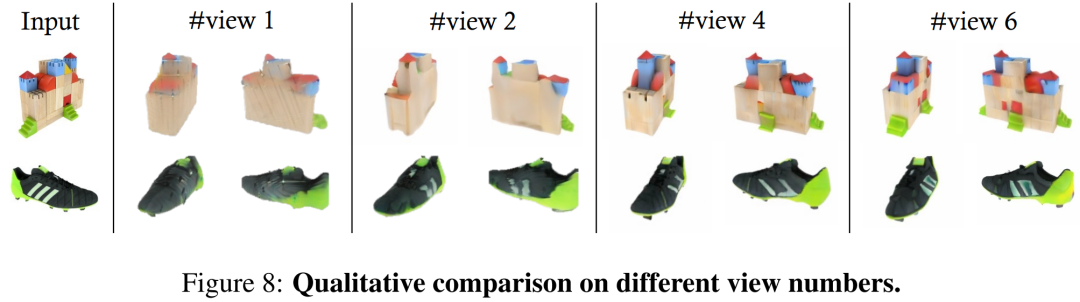

在视角方面,研究者在表 3 和图 8 中显示了用不同数量(1、2、4、6)的输入视图训练的模型的定量和定性比较。

在多实例生成方面,与其他扩散模型类似,本文提出的模型可以根据随机输入生成多种示例,如图 1 所示,展示了该模型生成结果的泛化性。

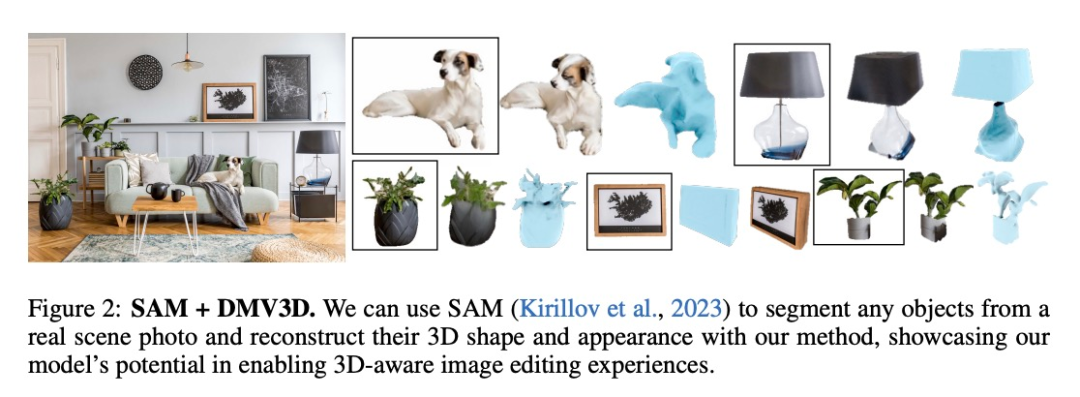

DMV3D在应用方面具有广泛的灵活性和通用性,在3D生成应用领域具有强大的发展潜力。如图1和图2所示,本文的方法可以通过分割(例如SAM)等方法,在图像编辑应用程序中将2D照片中的任意对象提升到3D维度

请阅读原论文以了解更多技术细节和实验结果

以上是Adobe的新技术:用A100生成3D图像仅需30秒,让文本和图像动起来的详细内容。更多信息请关注PHP中文网其他相关文章!