NVIDIA RTX显卡AI推理提速5倍!RTX PC轻松在本地搞定大模型

- 王林转载

- 2023-11-17 23:05:431532浏览

在微软Iginte全球技术大会上,微软发布了一系列AI相关的全新优化模型和开发工具资源,旨在帮助开发者更充分地发挥硬件性能,扩展AI应用领域

尤是对于当下在AI领域占据绝对主导地位的NVIDIA来说,微软这次送上了一份大礼包,无论是面向OpenAI Chat API的TensorRT-LLM封装接口,还是RTX驱动的性能改进DirectML for Llama 2,以及其他热门大语言模型(LLM),都可以在NVIDIA硬件上获得更好的加速和应用。

其中,TensorRT-LLM是一款用于加速LLM推理的库,可大大提升AI推理性能,还在不断更以支持越来越多的语言模型,而且它还是开源的。

NVIDIA在10月份发布了适用于Windows平台的TensorRT-LLM。对于配备RTX 30/40系列GPU显卡的台式机和笔记本电脑来说,只要显存达到8GB以上,就能更加轻松地完成高要求的AI工作负载

现在,Tensor RT-LLM for Windows可以通过全新的封装接口,与 OpenAI 广受欢迎的聊天 API 兼容,因此可以在本地直接运行各种相关应用,而不需要连接云端,有利于在 PC 上保留私人和专有数据,防范隐私泄露。

只要是经过TensorRT-LLM优化的大型语言模型,都可以与这个封装接口配合使用,包括Llama 2、Mistral、NV LLM等等

对于开发者来说,无需繁琐的代码重写和移植,只需修改一两行代码,就可以让AI应用在本地快速执行。

↑↑↑基于TensorRT-LLM的微软Visual Studio代码插件——Continue.dev编码助手

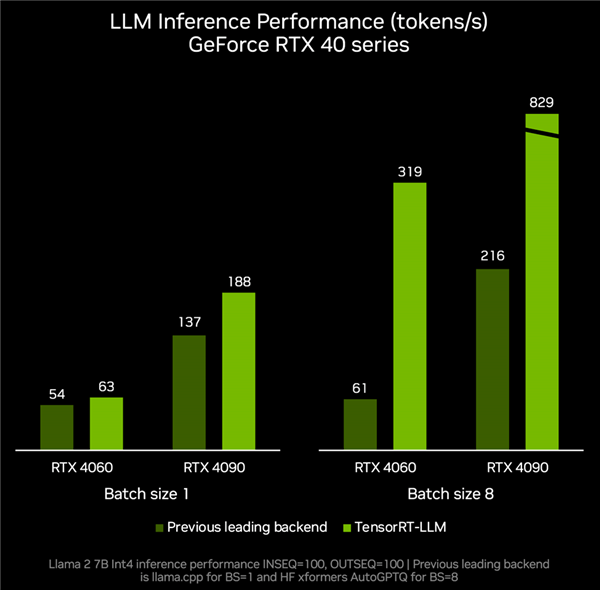

本月底还会有TensorRT-LLM v0.6.0版本更新,将会在RTX GPU上带来最多达5倍的推理性能提升,并支持更多热门的 LLM,包括全新的70亿参数Mistral、80亿参数Nemotron-3,让台式机和笔记本也能随时、快速、准确地本地运行LLM。

根据实测数据,RTX 4060显卡搭配TenroRT-LLM,推理性能可以跑到每秒319 tokens,相比其他后端的每秒61 tokens提速足足4.2倍。

RTX 4090则可以从每秒tokens加速到每秒829 tokens,提升幅度达2.8倍。

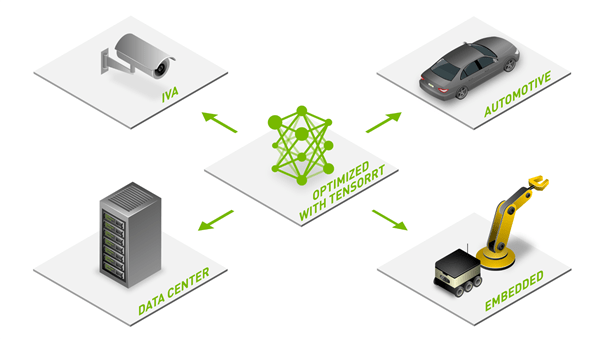

凭借强大的硬件性能、丰富的开发生态和广泛的应用场景,NVIDIA RTX正在成为本地端AI不可或缺的有力助手。同时,随着优化、模型和资源的不断丰富,AI功能在亿万台RTX PC上的普及也在加速推进

目前已经有400多个合作伙伴发布了支持RTX GPU加速的AI应用、游戏,而随着模型易用性的不断提高,相信会有越来越多的AIGC功能出现在Windows PC平台上。

以上是NVIDIA RTX显卡AI推理提速5倍!RTX PC轻松在本地搞定大模型的详细内容。更多信息请关注PHP中文网其他相关文章!