UC伯克利脑机接口突破:利用脑电波重现音乐,为语言障碍者带来福音!

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB转载

- 2023-09-30 15:49:071132浏览

脑机接口时代,天天都有新鲜玩意儿。

今天带来四个字:脑植音乐。

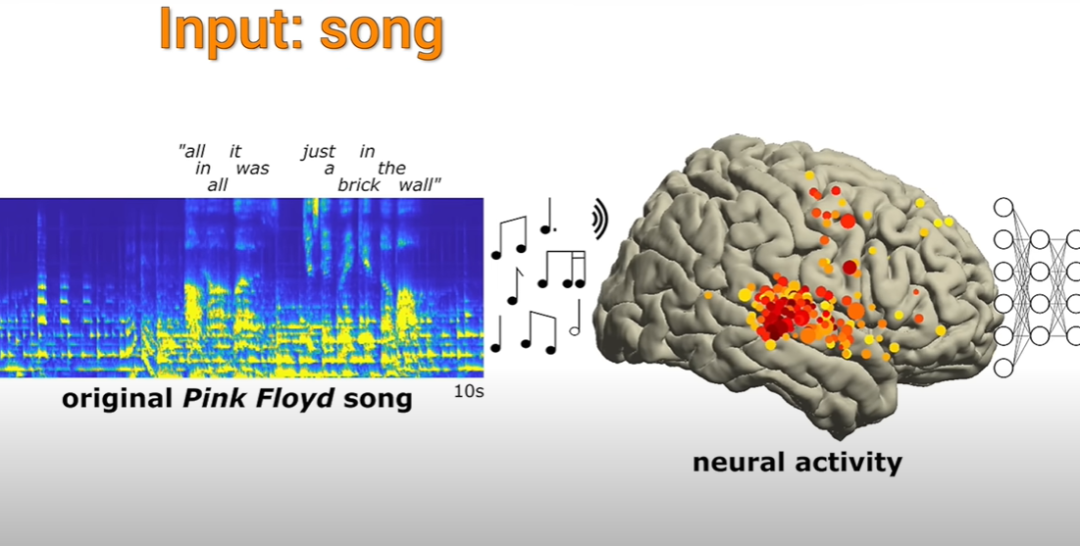

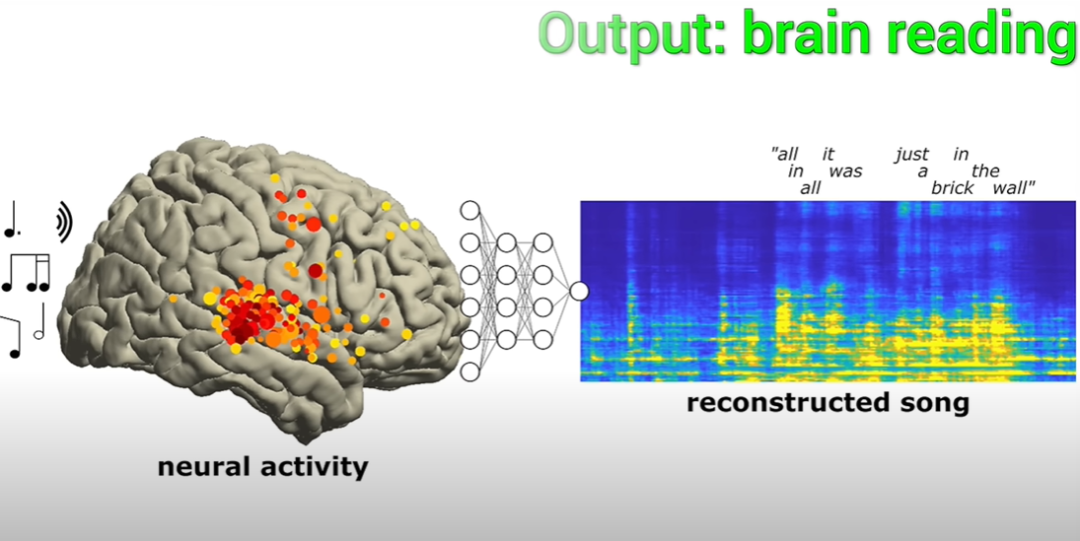

具体来说,就是先用AI来观察某段音乐会让人的大脑中产生什么样的电波,然后直接在有需要的人的大脑里模拟这个电波的活动,以此来达到治疗某类疾病的目的。

让我们回顾一下几年前的Albany医疗中心,看看那里的神经科学家们是如何进行研究的

语言障碍者的福音!

在奥尔巴尼医疗中心,一首名为「另一堵墙」的音乐缓缓响起,充满了整个医院病房

躺在病床上准备接受癫痫手术的病人们,他们并非医生,而是在聆听

神经科学家们聚集在一旁,观察电脑屏幕上显示的病人脑电图活动

主要观察的内容,就是大脑部分区域在听到一些独属于音乐的东西后所产生的电极活动,然后看看通过这些记录下来的电极活动能不能复现出他们在听什么音乐。

在前面提到的内容中,涉及到音乐的要素包括音调、节奏、和声以及歌词

这个研究进行了十多年。加利福尼亚大学伯克利分校的神经科学家们对29名参与实验的癫痫患者的数据进行了详细分析

科学家们能够根据病人大脑中电极活动的结果,成功重建了这段音乐

在复现的歌曲中,其中的一句歌词「All in all it was just a brick in the wall」的节奏非常完整,虽说歌词不算太清晰,但研究人员表示,可以破译出来,并非混沌一片。

而这首歌曲也是科学家们第一个通过大脑电极活动重建歌曲成功的案例。

结果表明,通过对脑电波的记录和解除,是可以捕捉到一些音乐元素以及音节的。

这些音乐元素可以用专业术语称为韵律(prosody),包括节奏、重音、抑扬顿挫等等。这些元素的意义无法仅通过语言来表达

此外,由于这些颅内脑电图(iEEG)只记录在大脑表层进行的活动(也就是最接近听觉中心的部分),因此无需担心有人会通过这种方式偷听你在听什么歌(笑)

但是,对于那些得了中风,或者瘫痪,导致交流困难的人来说,这种从大脑表层电极活动进行的复现,可以帮助他们重现乐曲的音乐性。

显然,这比之前那种机器人式的、语调呆呆的复现要好得多。就像上面提到的一样,有些东西光靠文字真不够,咱听的是那个调调。

Helen Wills神经科学研究所的神经科学家,兼加州大学伯克利分校的心理学教授Robert Knight表示,这是一项了不起的成果。

「对于我来说,音乐的魅力之一就在于它的前奏和所要表达的情感内容。而随着脑机接口领域的不断突破,这项技术就可以给有需要的人,通过植入的方式提供只有音乐才能提供的东西。受众可能包括患有渐冻人症的病人,或是癫痫病人,总之一切因为病症影响到语言输出神经的人。」

换句话说,我们现在能做的不仅仅是语言本身,与音乐相比,文字所表达的情感可能会显得有些单薄。我相信,从现在开始,我们才真正踏上了解读之旅

而随着脑电波记录技术的更迭,未来的某一天我们也有可能在不打开大脑的情况下,通过附着在头皮上的电极进行记录。

Knight表示,目前的头皮脑电图已经可以测量并记录一些大脑活动,比方说从一大串字母中检测出单个字母。虽说效率不高,每个字母都得花上至少20秒钟,但总归是个开始。

大力发展头皮电极的原因在于目前无创技术的熟练程度不够。换句话说,开颅测量无法百分之百确保安全性

头皮电极的测量准确度,特别是对于大脑深层的测量,仍然有待提高。可以说已经取得了一定的成功,但并不完全成功

能读心吗?

直接给答案:no。

打个比方,对于那些说话有障碍的人来说,脑机接口技术相当于给了他们一把「键盘」,通过捕捉脑电波的活动,他们就可以在这把「键盘」上打字,表达他们所想表达的。

例如,以霍金为例,他所使用的装置就是通过捕捉他的脑电波来生成机器人声音的语音

通过类比,你应该能够理解了。仅仅看到这个「键盘」,你无法知道它在想些什么。现在的技术使得键盘可以启动并输出语音。如果没有人想要输入,键盘就不会启动,你也无法知道它在想什么

所以,读心是不可行的

实验内容

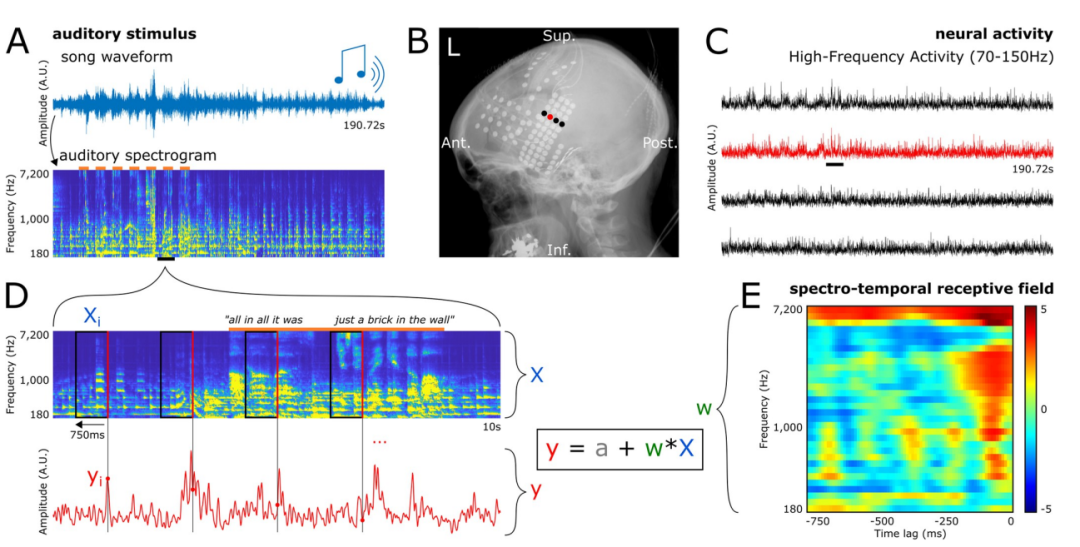

请看下图,图A展示了实验中使用的歌曲的整体波形图。图A下方是该歌曲的听觉频谱图,最顶部的橙色条表示有人声出现

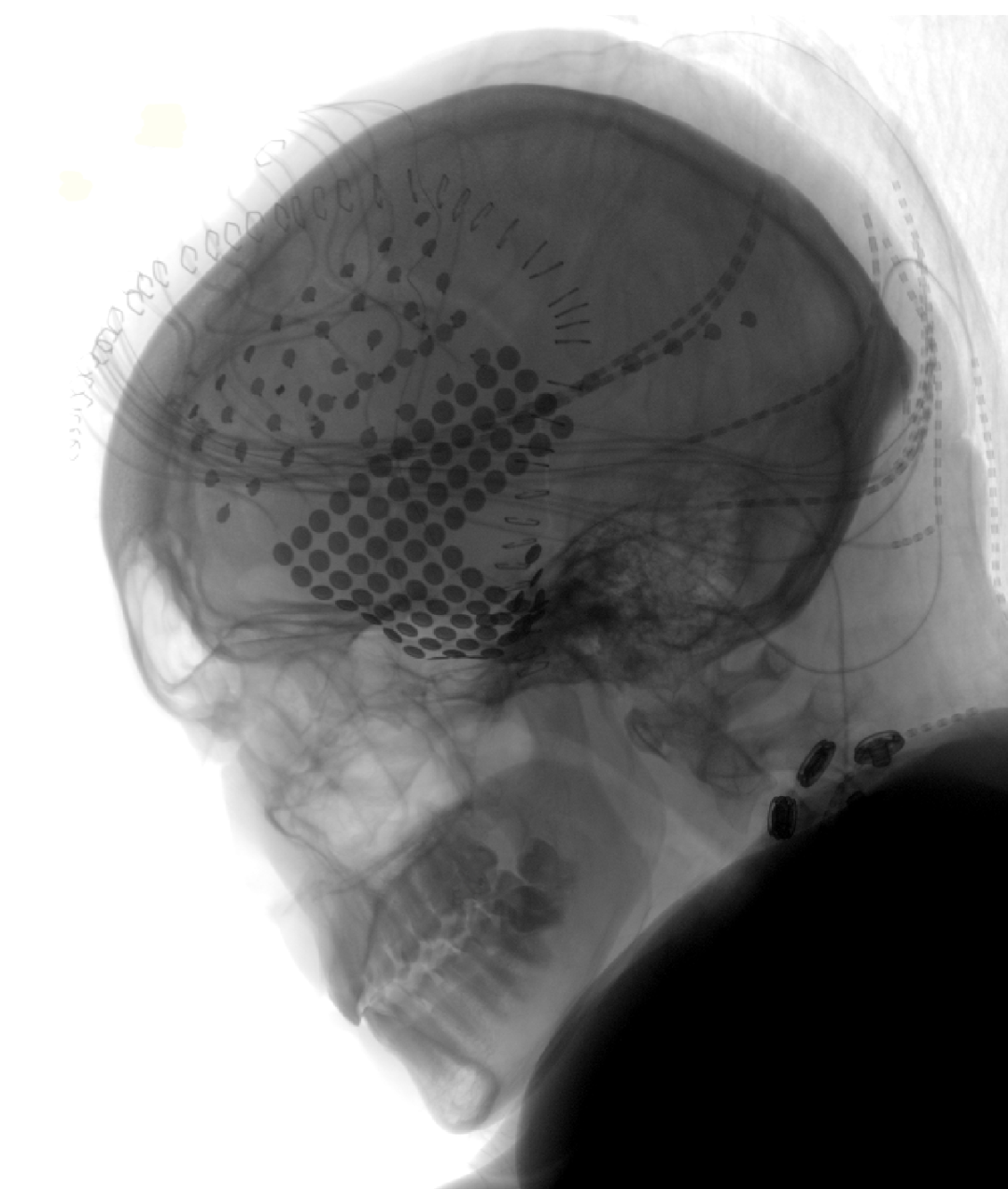

图B为X光片下,一名患者的电极覆盖图。每一个点代表着一个电极。

C图展示了B图中四个电极的电极信号。同时,图中还显示了歌曲刺激引发的高频活动(HFA),用下滑的黑色短线表示,频率在70到150赫兹之间

图D展示了A中一小段(10秒)歌曲播放时的放大听觉频谱图和电极神经活动图。我们可以观察到,HFA的时间点与频谱图中每个标出的矩形的右侧红色线条相吻合

这些配对情况就构成了研究人员用于训练和评估编码模型的示例。

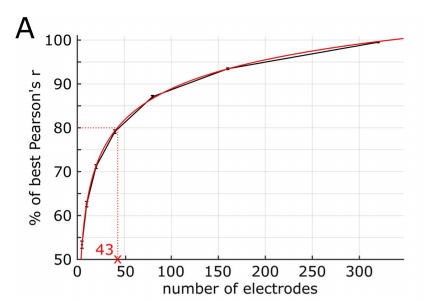

研究人员的实验结果显示,解码模型中用作预测因子的电极数量与预测准确率之间存在对数关系,如下图所示。

例如,使用43个电极(或12.4%)可以获得80%的最佳预测准确率(最佳预测准确率即为使用所有347个电极的结果)。

在单个患者身上观察到了相同的关系,这是研究人员的发现

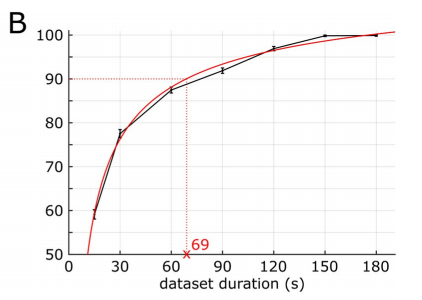

此外,通过引导分析,研究人员观察到数据集持续的时间与预测准确率之间也存在类似的对数关系,如下图所示。

举个例子,如果使用长度为69秒(占总长度的36.1%)的数据,可以获得90%的最佳性能(最佳性能是指使用整首歌长190.72秒的数据得出的)

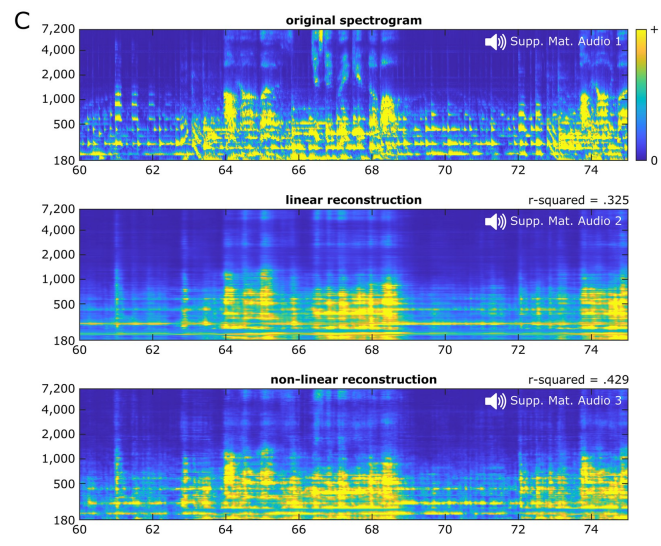

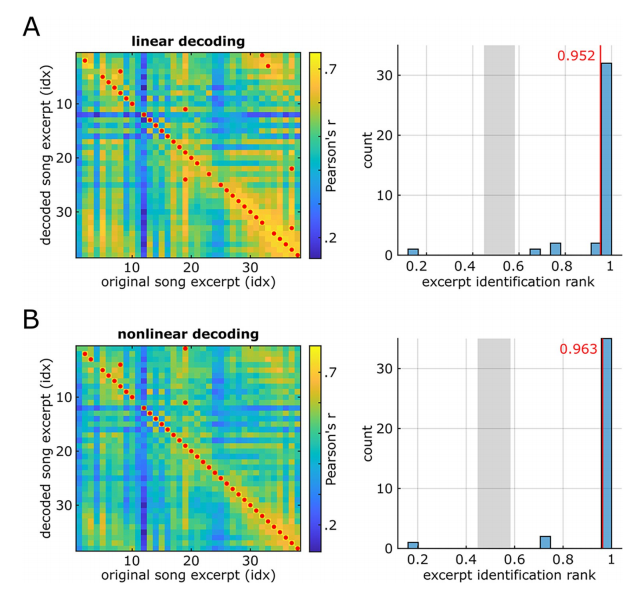

而关于模型类型,线性解码的平均解码准确率为0.325,而使用双层全连接神经网络的非线性解码的平均解码准确率则为0.429。

总体而言,线性音乐歌曲重建(音频S2)听起来闷闷的,对一些音乐元素(指人声音节和主音吉他)的存在有很强的节奏提示,但可能对另外一些元素的感知有限。

非线性歌曲重建的(音频S3)再现了一首可辨识的歌曲,与线性重建相比,细节更加丰富。音高和音色等频谱元素的感知质量明显提高,音素特征也更加清晰可辨。线性重建中存在的一些识别盲区也得到了一定程度的改进

以下是图示:

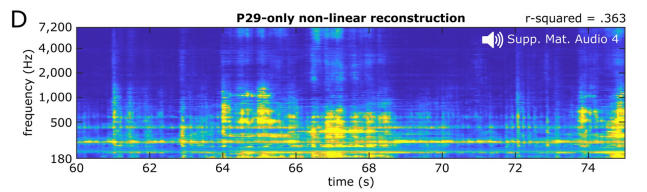

所以研究人员使用非线性模型通过第29个患者的61个电极重建了歌曲。

这些模型的性能优于基于所有患者电极的线性重建,但解码准确度不及使用所有患者的347个电极所获得的准确度

在感知方面,这些基于单个患者的模型提供了足够高的频谱-时间的细节,足以让研究人员识别出歌曲(音频S4)

同时,为了评估基于单个患者的解码下限,研究人员从另外3位患者的脑神经活动中重建了歌曲,这3位患者的电极数量较少,分别为23、17和10个,而上述第29个患者的电极数量为61个,电极密度也相对较低。当然,还是覆盖了歌曲的反应区域,线性解码的准确性也算良好。

在重建的波形图(音频文件S5、S6 和 S7)中,研究人员检索到了部分人声。然后,他们将原始歌曲与解码歌曲的频谱图进行关联,对解码歌曲的可识别性进行了量化。

线性重构(下图A)和非线性重构(下图B)都提供了较高比例的正确识别率。

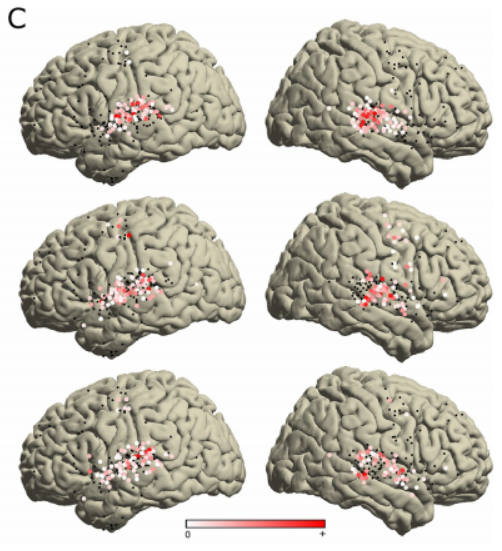

另外,研究人员分析了所有347个重要电极的STRF(频谱-时间接受域)系数,以评估不同音乐元素在不同脑区的编码情况。

这项分析揭示了不同频谱和时间的调谐模式

为了全面描述歌曲频谱图与神经活动之间的关系,研究人员对所有重要的STRFs进行了独立成分分析(ICA)。

研究人员发现了3个具有不同频谱-时间调谐模式的组成部分,每个部分的方差解释率均超过了5%,合计方差解释率达52.5%,如下图所示。

第一个部分(解释方差为28%)展示了一个正系数的集群,该集群在大约500Hz到7000Hz的宽频率范围内分布,并且在观察到HFA之前的约90ms的狭窄时间窗口内可见

这个瞬时集群显示了声音起始的调谐。这部分被称为起始部分,只出现在双侧STG后部的电极上,如下图所示的位置

最后,研究人员表示,未来的研究可能会扩大电极的覆盖范围,改变模型的特征和目标,或增加新的行为维度

以上是UC伯克利脑机接口突破:利用脑电波重现音乐,为语言障碍者带来福音!的详细内容。更多信息请关注PHP中文网其他相关文章!