多模态大模型最全综述来了!7位微软研究员大力合作,5大主题,成文119页

- 王林转载

- 2023-09-25 16:49:061000浏览

多模态大模型最全综述来了!

由微软7位华人研究员撰写,足足119页——

它从目前已经完善的和还处于最前沿的两类多模态大模型研究方向出发,全面总结了五个具体研究主题:

- 视觉理解

- 视觉生成

- 统一视觉模型

- LLM加持的多模态大模型

- 多模态agent

并重点关注到一个现象:

多模态基础模型已经从专用走向通用。

Ps. 这也是为什么论文开头作者就直接画了一个哆啦A梦的形象。

谁适合阅读这份综述(报告)?

用微软的原话来说:

只要你有兴趣学习多模态基础模型的基础知识和最新进展,无论你是专业研究员还是在校学生,这个内容都非常适合你

一起来看看~

一文摸清多模态大模型现状

这五个具体主题中的前两个是目前已经成熟的领域,而后三个则属于前沿领域

1、视觉理解

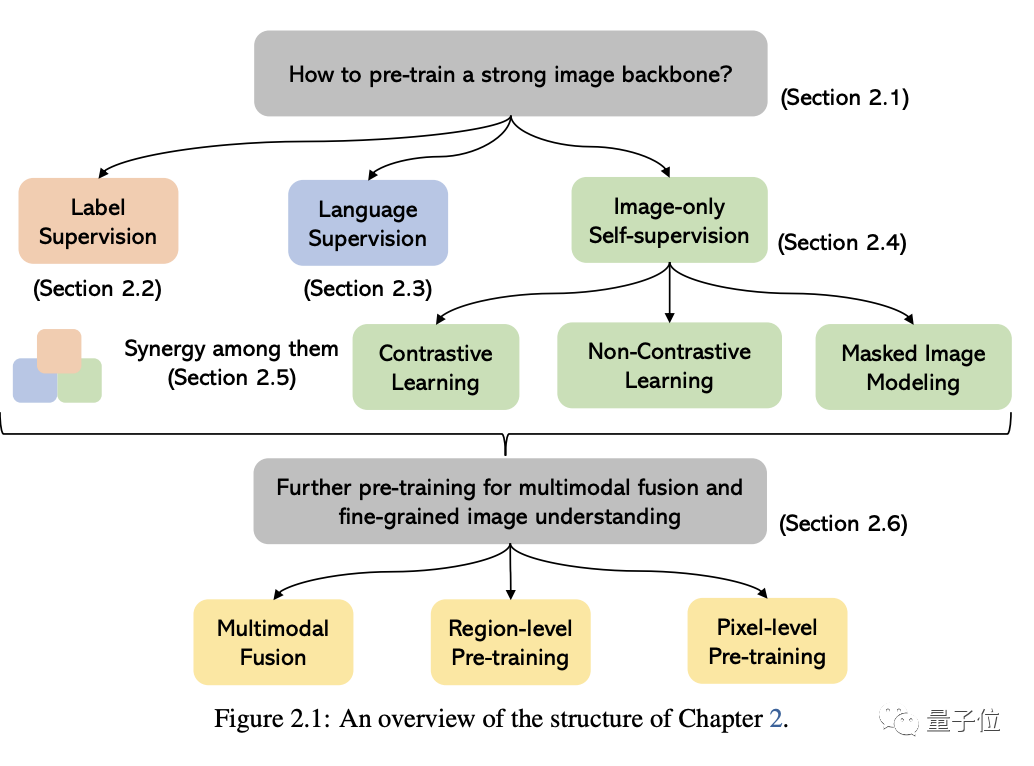

这部分的核心问题是如何预训练一个强大的图像理解backbone。

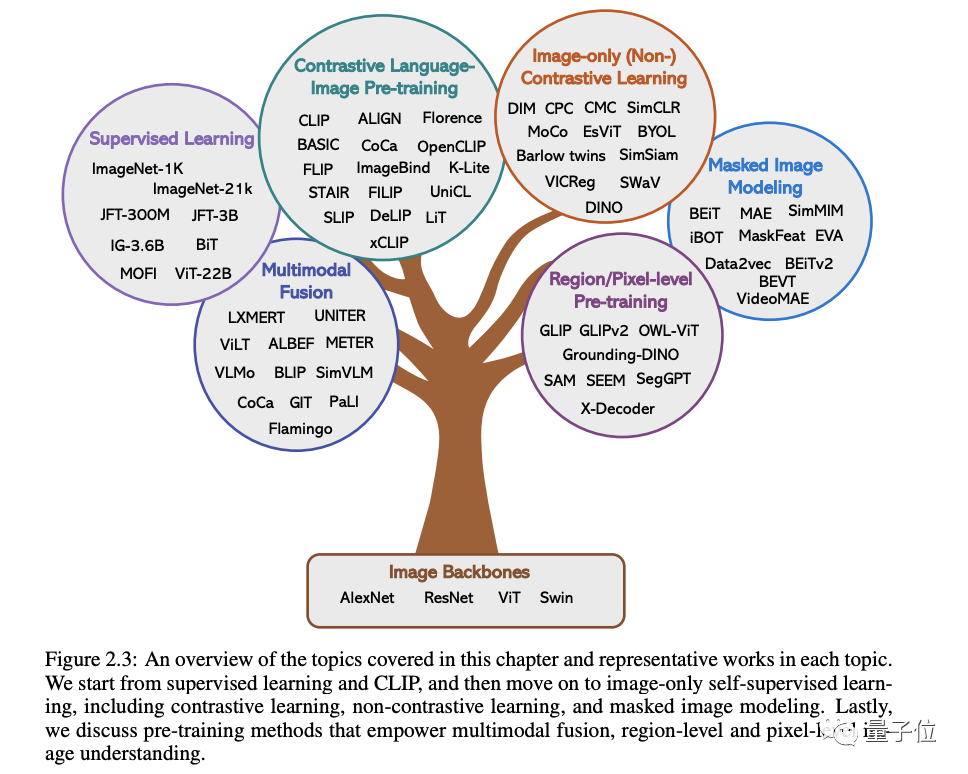

如下图所示,根据用于训练模型的监督信号的不同,我们可以将方法分为三类:

标签监督、语言监督(以CLIP为代表)和只有图像的自监督。

其中最后一个表示监督信号是从图像本身中挖掘出来的,流行的方法包括对比学习、非对比学习和masked image建模。

除了这些方法之外,文章还进一步讨论了多模态融合、区域级和像素级图像理解等类别的预训练方法

还列出了以上这些方法各自的代表作品。

2、视觉生成

这个主题是AIGC的核心,不限于图像生成,还包括视频、3D点云图等等。

并且它的用处不止于艺术、设计等领域——还非常有助于合成训练数据,直接帮助我们实现多模态内容理解和生成的闭环。

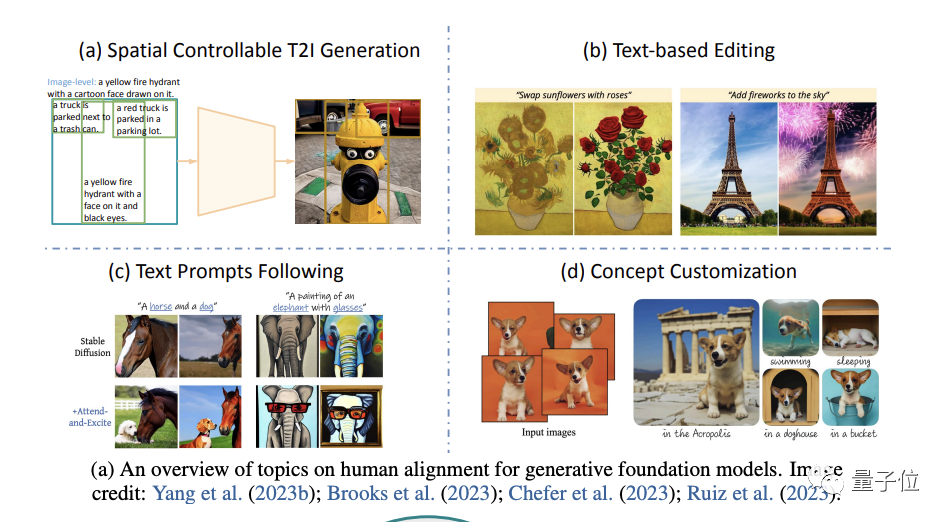

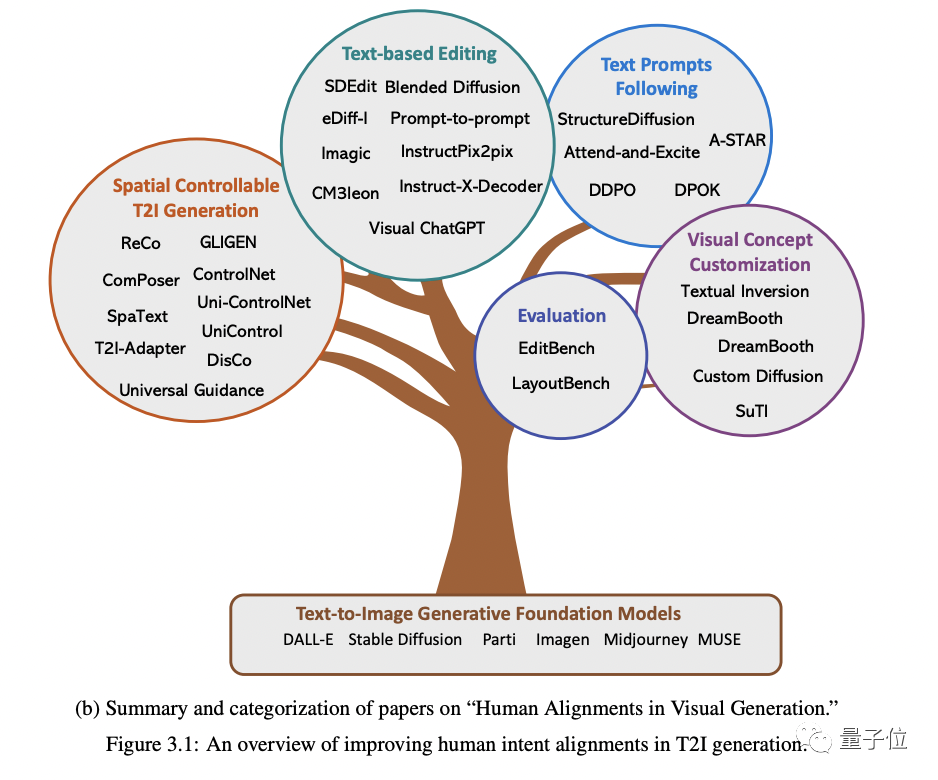

在这部分,作者重点讨论了生成与人类意图严格一致的效果的重要性和方法(重点是图像生成)。

具体则从空间可控生成、基于文本再编辑、更好地遵循文本提示和生成概念定制(concept customization)四个方面展开。

在本节的结尾,作者还分享了他们对目前研究趋势和即将展开的研究方向的观点

为了更好地遵循人类的意图并使上述四个方向都能够更加灵活和可替代,我们需要开发一个通用的文生成模型

列举了四个方向的各自代表作如下:

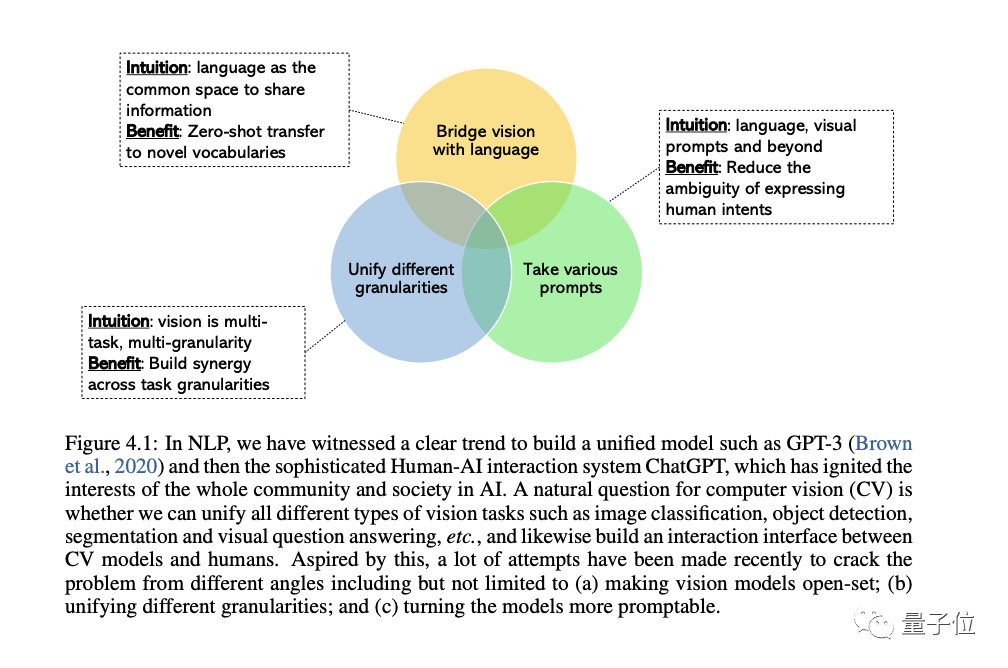

3、统一视觉模型

这部分内容探讨了构建统一视觉模型所面临的挑战:

需要进行改写的内容是:首先,输入类型不同;

需要进行改写的内容是:其次,不同的任务需要采用不同的细粒度,并且输出也要求采用不同的格式;

数据也面临挑战,除了建模之外

比如不同类型的标签注释成本差异很大,收集成本比文本数据高得多,这导致视觉数据的规模通常比文本语料库小得多。

不过,尽管挑战多多,作者指出:

CV领域对于开发通用、统一的视觉系统的兴趣是越来越高涨,还衍生出来三类趋势:

一是从闭集(closed-set)到开集(open-set),它可以更好地将文本和视觉匹配起来。

从特定任务到通用能力的转变最重要的原因是为每个新任务开发一个新模型的成本太高

三是从静态模型到可提示模型,LLM可以采用不同的语言和上下文提示作为输入,并在不进行微调的情况下产生用户想要的输出。我们要打造的通用视觉模型应该具有相同的上下文学习能力。

4、LLM加持的多模态大模型

本节全面探讨多模态大模型。

先是深入研究背景和代表实例,并讨论OpenAI的多模态研究进展,确定该领域现有的研究空白。

接下来作者详细考察了大语言模型中指令微调的重要性。

再接着,作者探讨了多模态大模型中的指令微调工作,包括原理、意义和应用。

最后,我们还将涉及一些多模态模型领域中的高级主题,以便更深入地了解,其中包括:

更多超越视觉和语言的模态、多模态的上下文学习、参数高效训练以及Benchmark等内容。

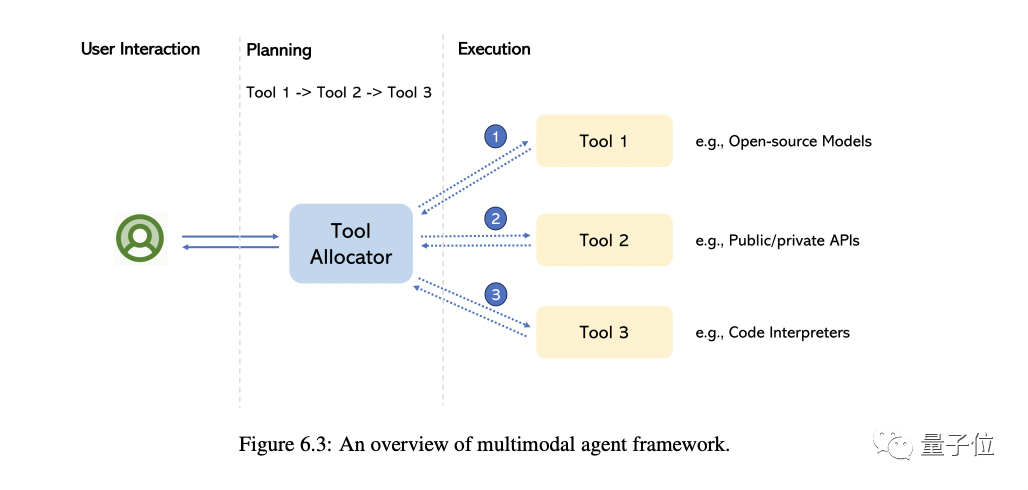

5、多模态agent

所谓多模态agent,就是一种将不同的多模态专家与LLM联系起来解决复杂多模态理解问题的办法。

这部分,作者主要先带大家回顾了这种模式的转变,总结该方法与传统方法的根本差异。

以MM-REACT为例,我们将详细介绍这种方法的具体运作方式

我们进一步总结了如何构建多模态代理的全面方法,以及它在多模态理解方面的新兴能力。同时,我们还介绍了如何轻松地扩展这种能力,包括最新、最强大的LLM和潜在的数百万种工具

当然,最后也是一些高阶主题讨论,包括如何改进/评估多多模态agent,由它建成的各种应用程序等。

作者介绍

这份报告共有7位作者

发起人和整体负责人为Chunyuan Li。

他是微软雷德蒙德首席研究员,博士毕业于杜克大学,最近研究兴趣为CV和NLP中的大规模预训练。

他负责了开头介绍和结尾总结以及“利用LLM训练的多模态大模型”这章的撰写。 重写后的内容:他负责撰写了文章的开头介绍和结尾总结,以及关于“利用LLM训练的多模态大模型”这一章的部分

核心作者共有4位:

- Zhe Gan

目前已进入Apple AI/ML工作,负责大规模视觉和多模态基础模型研究。此前是Microsoft Azure AI的首席研究员,北大本硕毕业,杜克大学博士毕业。

- Zhengyuan Yang

他是微软的高级研究员,毕业于罗切斯特大学并获得了ACM SIGMM杰出博士奖等荣誉。他本科就读于中国科学技术大学

- Jianwei Yang

微软雷德蒙德研究院深度学习小组首席研究员。佐治亚理工学院博士毕业。

- Linjie Li(女)

Microsoft Cloud & AI计算机视觉组研究员,普渡大学硕士毕业。

他们分别负责了剩下四个主题章节的撰写。

综述地址:https://arxiv.org/abs/2309.10020

以上是多模态大模型最全综述来了!7位微软研究员大力合作,5大主题,成文119页的详细内容。更多信息请关注PHP中文网其他相关文章!