一口气看完《哈利波特》:AI大模型「量子速读」,一分钟抵人类五小时

- PHPz转载

- 2023-05-16 12:49:141446浏览

最近一段时间,OpenAI 凭借 GPT 系列模型以及 ChatGPT,一直是最受关注的研究机构。但最近两年,一家 AI 初创公司正在走进大家的视野,这家公司名为 Anthropic,成立于 2021 年,专注于开发通用 AI 系统和语言模型,并秉持负责任的 AI 使用理念。

不知大家是否还记得 2020 年末,OpenAI 核心员工集体离职事件,当时这件事在 AI 圈还引起了不小的轰动。Anthropic 就是由这些离职的人员创建的,其中包括 OpenAI 前研究副总裁 Dario Amodei、GPT-3 论文一作 Tom Brown 等人。

今年一月,Anthropic 已筹集了超过 7 亿美元的资金,最新一轮的估值达到了 50 亿美元。与此同时,在 ChatGPT 发布两个月后,这家公司就迅速开发了一种对标老东家 ChatGPT 的人工智能系统 Claude。

Claude 申请访问地址:https://www.anthropic.com/earlyaccess

Claude 使用了 Anthropic 自行开发的一种被称为「constitutional AI」的机制,其旨在提供一种「基于原则」的方法使 AI 系统与人类意图保持一致。

Claude 可以完成摘要总结、搜索、协助创作、问答、编码等任务。根据用户反馈,Claude 生成有害输出的可能性较小,更容易进行对话,并且更易于控制。除此以外,Claude 还可以根据指示来设定个性、语气和行为。

不过 Anthropic 并没有提供关于 Claude 的太多技术细节,但在论文《Constitutional AI: Harmlessness from AI Feedback》中描述了 Claude 背后技术,感兴趣的读者可以前去查看。

论文地址:https://arxiv.org/pdf/2212.08073.pdf

早在一月份,就有研究者对 Claude 一次性可以处理的最大文本量进行了测试,显示 Claude 可以回忆起 8k 个 token 中的信息。

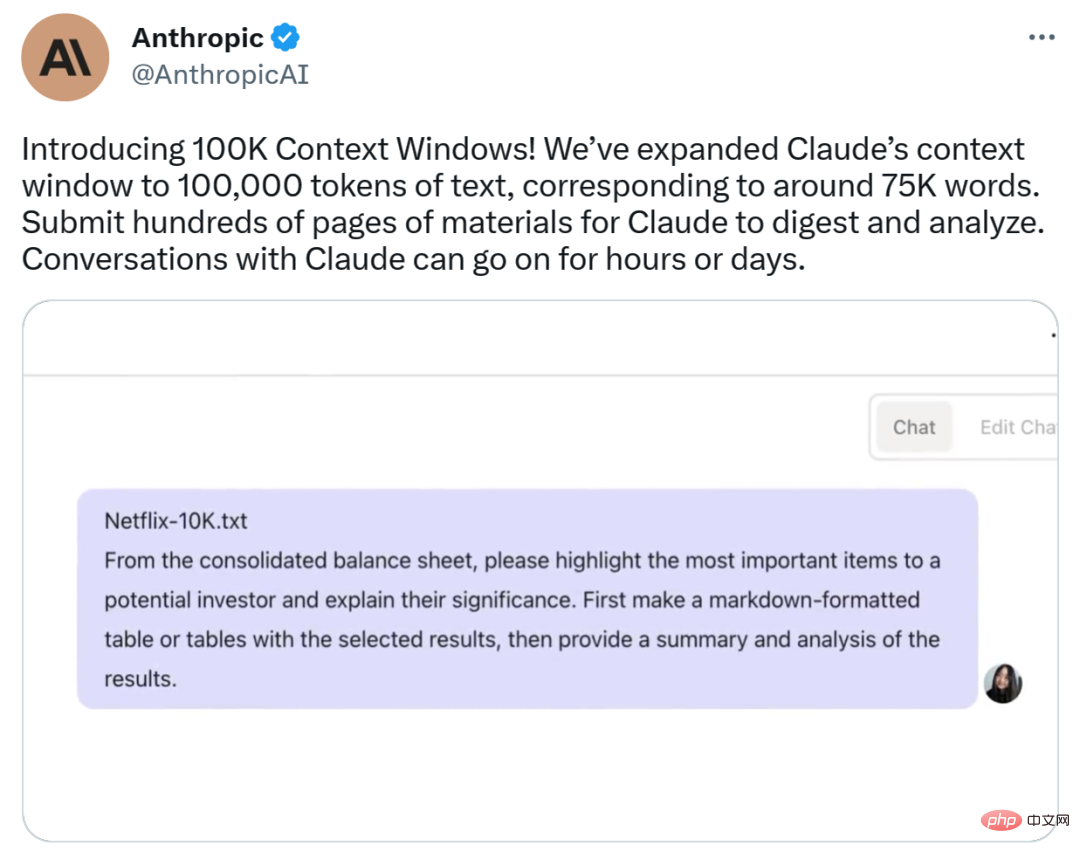

时隔没多久,本周四,Anthropic 推出了 100K Context Windows,它将 Claude 的上下文窗口从 9k token 扩展到了 100k,这相当于 75,000 个单词。这意味着企业可以提交数百页材料让 Claude 消化和解释,并且与它的对话可以持续数小时甚至数天。现在可以通过 Anthropic API 访问 100K context windows。

我们知道,大模型越先进,能够同时处理的文本就越长,7.5 万字是个什么概念呢?大概相当于一键总结《哈利波特》第一部。

看起来绝大多数论文、新闻报道和中短篇小说都不在话下了。

Claude 再进化:真「AI 量子速读」

根据科学研究,普通人可以在 5 小时左右的时间里阅读 100,000 个 token,并可能需要更长的时间来消化、记忆和分析这些信息。现在 Claude 可以在不到 1 分钟的时间里完成这些。

上下文窗口的一般计算。

Anthropic 首先将《了不起的盖茨比》的整个文本加载到了 Claude-Instant(72 K tokens,Claude 两个版本 Claude 和 Claude Instant,Claude 是最先进的高性能模型,而 Claude Instant 是更轻、更便宜、更快的选择。)中,并修改了一行「Carraway 先生是一位在 Anthropic 从事机器学习工作的软件工程师」。当 Anthropic 要求模型找出与原文的不同之处时,它会在 22 秒内给出正确答案。

除了阅读长文本之外,Claude 还有助于从文档中检索信息,从而对业务运营产生助益。用户可以将多个文档甚至一本书放入 prompt 中,然后向 Claude 提出问题(需要对文本的很多部分进行综合知识分析)。对于复杂的问题,这可能比基于向量搜索的方法有效得多。Claude 可以按照用户的指令返回他们正在搜寻的信息,就像人类助手一样。

Anthropic 接着将大语言集成工具 LangChain API 开发者文档(240 页)放入模型中,然后针对所提问题给出了使用 Anthropic 语言模型的 LangChain demo。

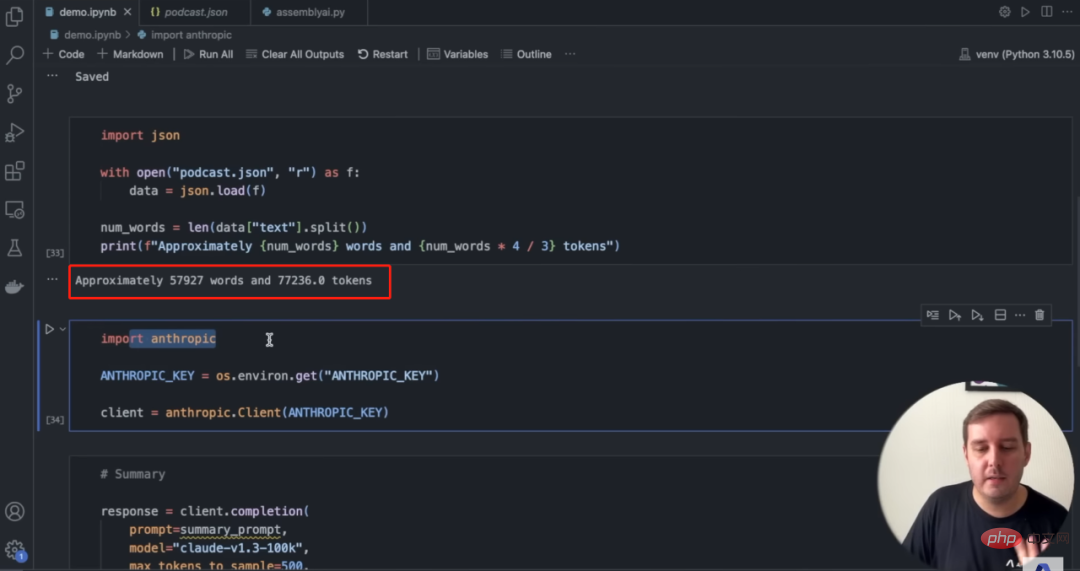

与此同时,100k token 可以转换为 6 个小时左右的音频。AssemblyAI 对此做了很好的演示,他们将一个长播客转录为了近 58k 个单词,然后使用 Claude 进行摘要总结和问答。

图源:AssemblyAI

总之,使用 100k context windows,用户可以做到如下:

- 消化、总结和解释财务报表或研究论文等密集文件;

- 基于公司年度报告分析战略风险和机遇;

- 评估一项立法的利弊;

- 识别法律文件中的风险、主题和不同形式的争论;

- 阅读数百页的开发者文档,并给出技术问题的答案;

- 通过将整个代码库放入上下文并智能地构建或修改以快速制作原型。

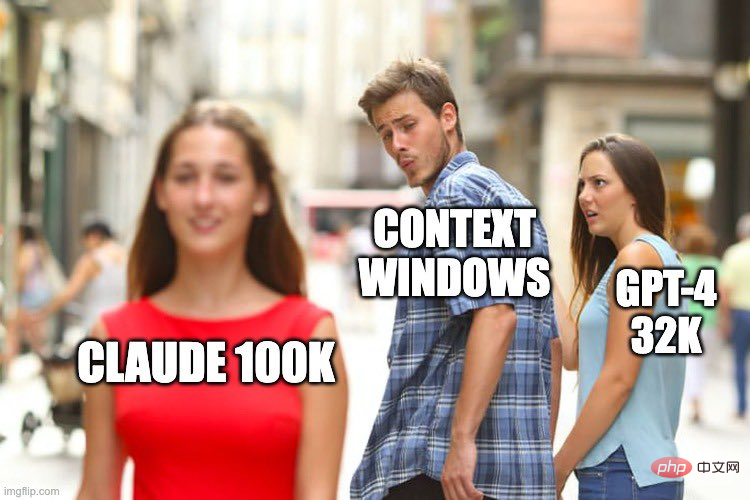

有网友用以下梗图形象地描述了 Context Windows 与 Claude 100k、GPT-4 32K 的关系。

图源:推特 @nathanwchan

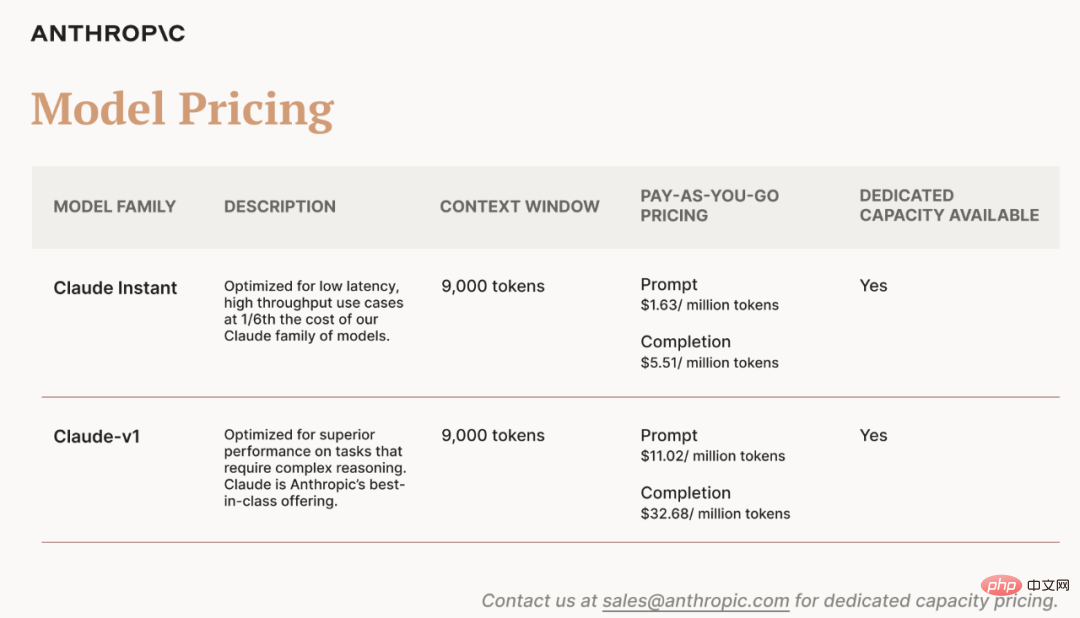

至于价格,Anthropic 技术人员 Ben Mann 表示,100K Context Windows 的百万 token 售价与以往模型一样。

以上是一口气看完《哈利波特》:AI大模型「量子速读」,一分钟抵人类五小时的详细内容。更多信息请关注PHP中文网其他相关文章!