如何减少人工智能不断增长的碳足迹

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB转载

- 2023-05-12 10:37:061274浏览

随着机器学习实验变得越来越复杂,它们的碳足迹正在膨胀。现在,研究人员已经计算了在不同地点的云计算数据中心训练一系列模型的碳成本1。他们的发现可以帮助研究人员减少依赖人工智能 (AI) 的工作所产生的排放。

研究小组发现,不同地理位置的排放存在显著差异。华盛顿西雅图艾伦人工智能研究所(Allen Institute For AI)机器学习研究员、该研究的共同负责人杰西·道奇(Jesse Dodge)表示,在同样的人工智能实验中,“效率最高的地区产生的排放约为效率最低的地区的三分之一”。

宾夕法尼亚州匹兹堡卡内基梅隆大学的机器学习研究员、气候变化 AI 组织的联合创始人 Priya Donti 表示,到目前为止,还没有任何好的工具可以测量基于云的人工智能产生的排放量。

“这是伟大的工作,有助于就如何管理机器学习工作负载以减少排放进行重要对话,”她说。

位置很重要

Dodge 和他的合作者(包括来自微软的研究人员)在训练 11 种常见 AI 模型的同时监控电力消耗,从支持谷歌翻译的语言模型到自动标记图像的视觉算法。他们将这些数据与为 16 台 Microsoft Azure 云计算服务器供电的电网排放量如何随时间变化的估计值结合在一起,以计算一系列地点的训练能耗。

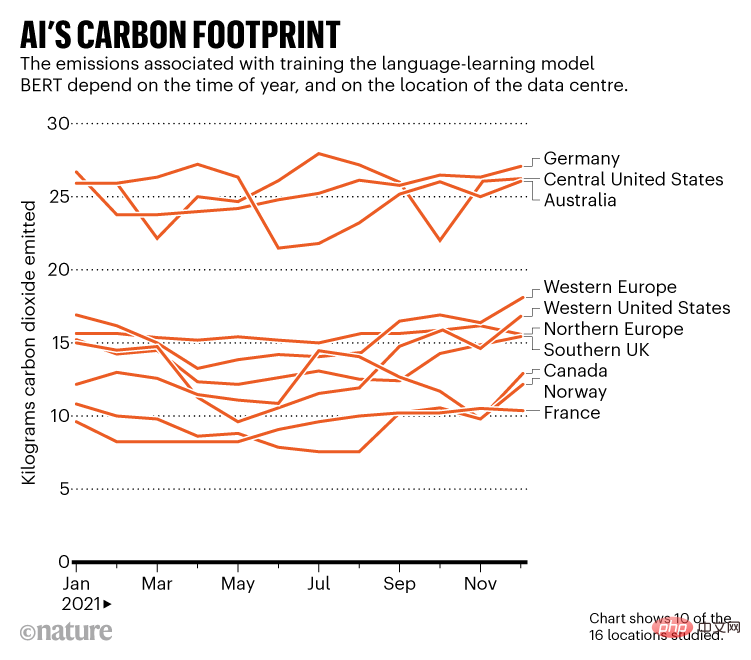

由于全球电源的变化以及需求的波动,不同地点的设施具有不同的碳足迹。该团队发现,在美国中部或德国的数据中心训练 BERT(一种常见的机器学习语言模型)会排放 22-28 公斤的二氧化碳,具体取决于一年中的时间。这是在挪威进行相同实验产生的排放量的两倍多,挪威的大部分电力来自水力发电,而法国主要依赖核能。

每天进行实验的时间也很重要。例如,道奇说,在华盛顿的夜间训练人工智能,当该州的电力来自水力发电时,比在白天训练人工智能的排放量更低,因为白天的电力也来自燃气站。他上个月在首尔举行的公平、问责和透明计算机器协会会议上展示了这一结果。

人工智能模型的排放量也有很大差异。图像分类器 DenseNet 产生了与给手机充电相同的 CO 2排放量,同时训练了一种称为 Transformer 的中型语言模型(它比研究公司 OpenAI 制造的流行语言模型 GPT-3 小得多)在加利福尼亚州旧金山产生的排放量与典型的美国家庭一年产生的排放量大致相同。此外,该团队只进行了 Transformer训练过程的 13%;道奇说,完全训练它会产生“相当于燃烧一整辆装满煤的轨道车的数量级”的排放量。

他补充说,排放数据也被低估了,因为它们不包括诸如用于数据中心开销的电力或用于创建必要硬件的排放等因素。Donti 说,理想情况下,这些数字还应包括误差线,以说明给定时间电网排放的重大潜在不确定性。

更环保的选择

在其他因素相同的情况下,道奇希望这项研究可以帮助科学家选择用于实验的数据中心,以最大限度地减少排放。他说,“事实证明,这个决定是该学科中人们可以做的最有影响力的事情之一”。由于这项工作,微软现在正在向使用其 Azure 服务的研究人员提供有关其硬件电力消耗的信息。

英国布里斯托大学研究数字技术对环境可持续性影响的克里斯·普雷斯特(Chris Preist)表示,减少排放的责任应该由云提供商而不是研究人员承担。他说,供应商可以确保在任何时候,碳强度最低的数据中心使用最多。Donti 补充说,他们还可以采用灵活的策略,允许机器学习运行在减少排放的时候启动和停止。

道奇表示,进行最大规模实验的科技公司应该对排放的透明度以及尽量减少或抵消排放承担最大的责任。他指出,机器学习并不总是对环境有害。它可以帮助设计高效材料、模拟气候以及追踪森林砍伐和濒危物种。尽管如此,人工智能日益增长的碳足迹正成为一些科学家关注的主要原因。道奇说,尽管一些研究小组正在致力于追踪碳排放量,但透明度“尚未发展成为社区规范”。

“这项工作的重点是试图让这个主题变得透明,因为现在严重缺失,”他说。

参考文献:

1.Dodge, J. et al. Preprint at https://arxiv.org/abs/2206.05229 (2022)。

以上是如何减少人工智能不断增长的碳足迹的详细内容。更多信息请关注PHP中文网其他相关文章!