从姿态图像重建 3D 室内场景通常分为两个阶段:图像深度估计,然后是深度合并(depth merging)和表面重建(surface reconstruction)。最近,多项研究提出了一系列直接在最终 3D 体积特征空间中执行重建的方法。虽然这些方法已经获得出令人印象深刻的重建结果,但它们依赖于昂贵的 3D 卷积层,限制其在资源受限环境中的应用。

现在,来自 Niantic 和 UCL 等机构的研究者尝试重新使用传统方法,并专注于高质量的多视图深度预测,最终使用简单现成的深度融合方法实现了高精度的 3D 重建。

- 论文地址:https://nianticlabs.github.io/simplerecon/resources/SimpleRecon.pdf

- GitHub 地址:https://github.com/nianticlabs/simplerecon

- 论文主页:https://nianticlabs.github.io/simplerecon/

该研究利用强大的图像先验以及平面扫描特征量和几何损失,精心设计了一个 2D CNN。所提方法 SimpleRecon 在深度估计方面取得了显著领先的结果,并且允许在线实时低内存重建。

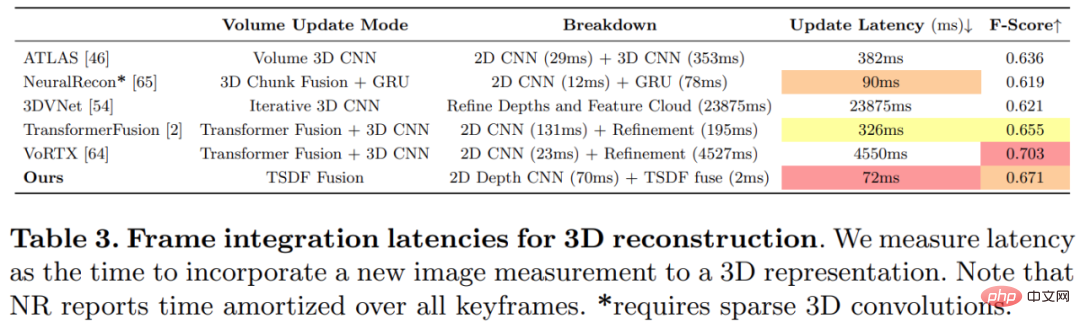

如下图所示,SimpleRecon 的重建速度非常快,每帧仅用约 70ms。

SimpleRecon 和其他方法的比较结果如下:

方法

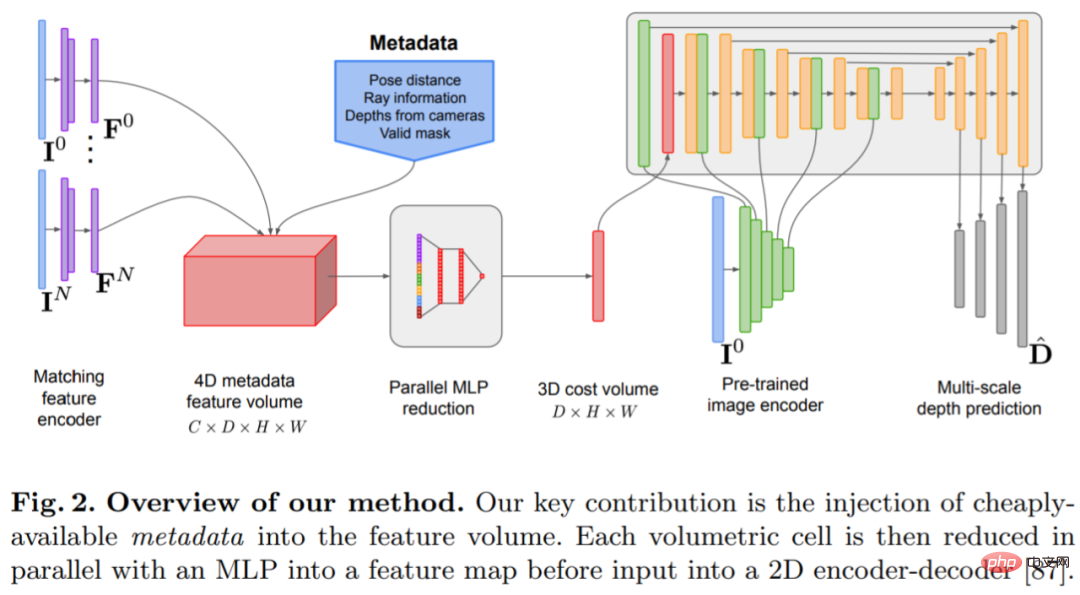

深度估计模型位于单目深度估计与平面扫描 MVS 的交点,研究者用 cost volume(代价体积)来增加深度预测编码器 - 解码器架构,如图 2 所示。图像编码器从参考图像和源图像中提取匹配特征,以输入到 cost volume。使用 2D 卷积编码器 - 解码器网络来处理 cost volume 的输出,此外研究者还使用单独的预训练图像编码器提取的图像级特征进行增强。

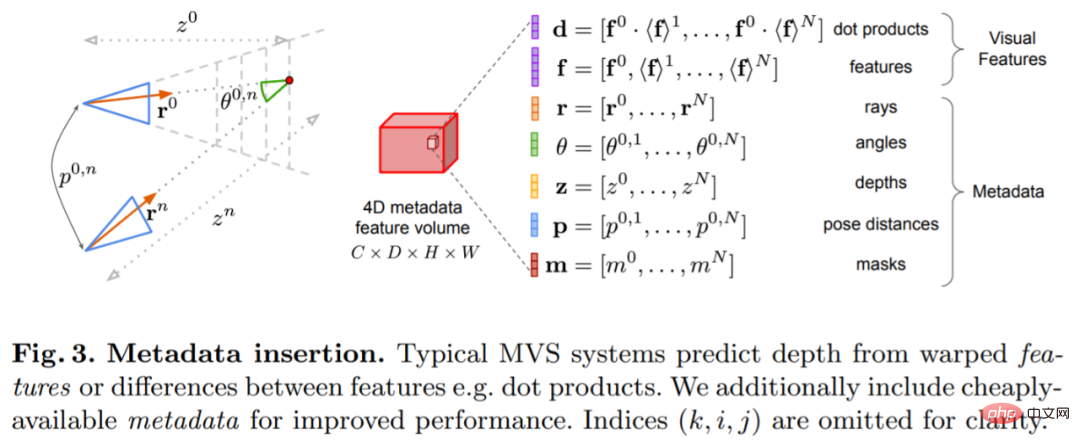

该研究的关键是将现有的元数据与典型的深度图像特征一起注入到 cost volume 中,以允许网络访问有用的信息,如几何和相对相机姿态信息。图 3 详细地显示了 feature volume 构造。通过整合这些之前未开发的信息,该研究的模型能够在深度预测方面显著优于之前的方法,而无需昂贵的 4D cost volume 成本、复杂的时间融合以及高斯过程。

该研究使用 PyTorch 来实现,并使用 EfficientNetV2 S 作为主干,其具有类似于 UNet++ 的解码器,此外,他们还使用 ResNet18 的前 2 个块进行匹配特征提取,优化器为 AdamW ,在两块 40GB A100 GPU 上耗时 36 小时完成。

网络架构设计

网络是基于 2D 卷积编码器 - 解码器架构实现的。在构建这种网络时,研究发现有一些重要的设计选择可以显著提高深度预测准确率,主要包括:

基线 cost volume 融合:虽然基于 RNN 的时间融合方法经常被使用,但它们显著增加了系统的复杂性。相反,该研究使得 cost volume 融合尽可能简单,并发现简单地将参考视图和每个源视图之间的点积匹配成本相加,可以得到与 SOTA 深度估计相竞争的结果。

图像编码器和特征匹配编码器:先前研究表明,图像编码器对深度估计非常重要,无论是在单目和多视图估计中。例如 DeepVideoMVS 使用 MnasNet 作为图像编码器,其具有相对较低的延迟。该研究建议使用很小但更强大的 EfficientNetv2 S 编码器,虽然这样做的代价是增加了参数量,并降低了 10% 的执行速度,但它大大提高了深度估计的准确率。

融合多尺度图像特征到 cost volume 编码器:在基于 2D CNN 的深度立体和多视角立体中,图像特征通常与单尺度上的 cost volume 输出相结合。最近,DeepVideoMVS 提出在多尺度上拼接深度图像特征,在所有分辨率上增加图像编码器和 cost volume 编码器之间的跳跃连接。这对基于 LSTM 的融合网络很有帮助,该研究发现这对他们的架构也同样重要。

实验

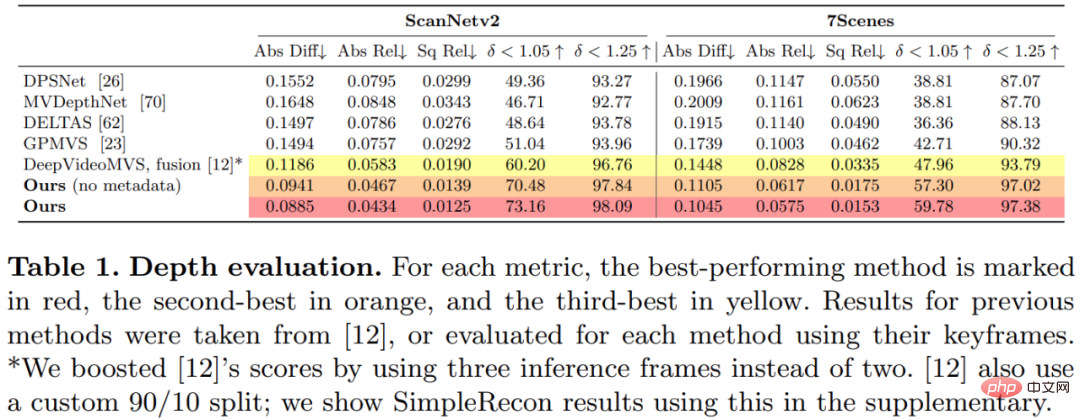

该研究在 3D 场景重建数据集 ScanNetv2 上训练和评估了所提方法。下表 1 使用 Eigen 等人 (2014) 提出的指标来评估几个网络模型的深度预测性能。

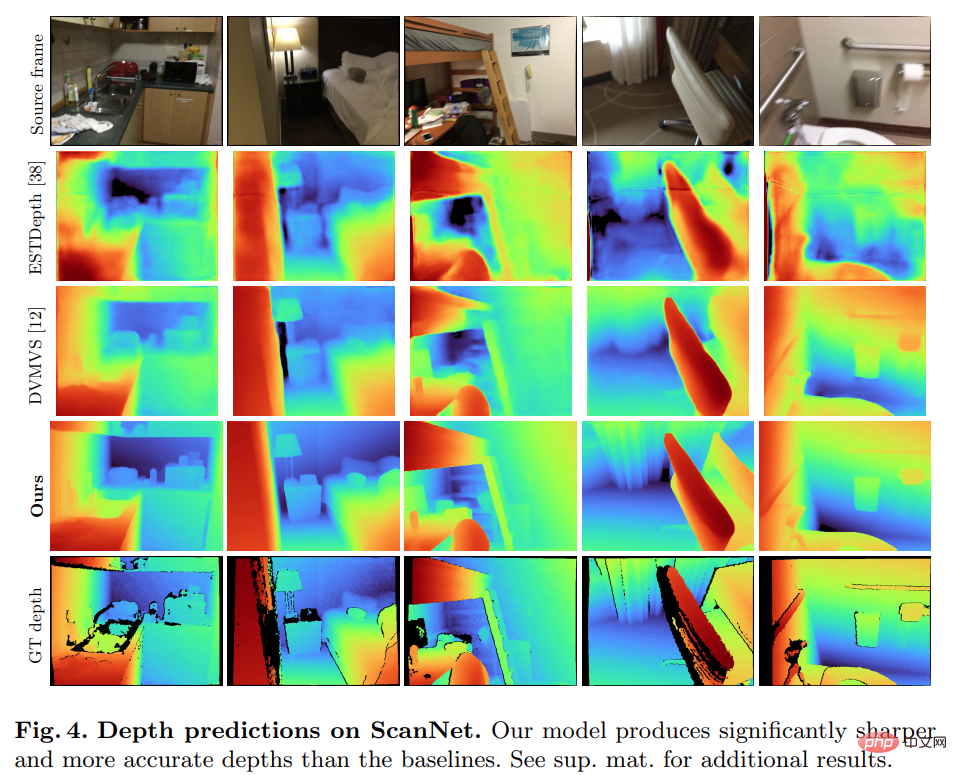

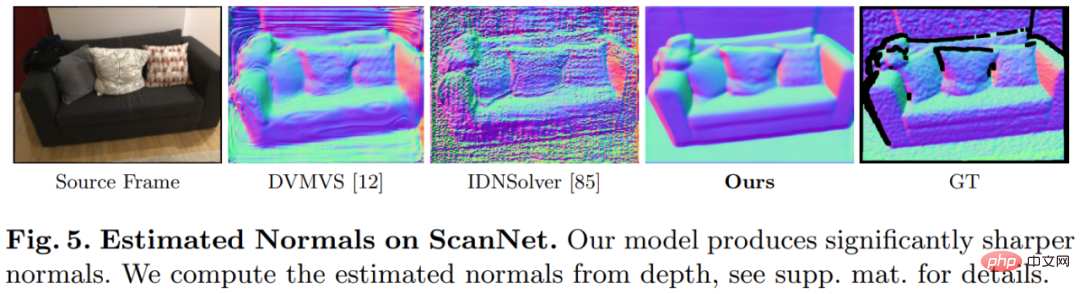

令人惊讶的是,该研究所提模型不使用 3D 卷积,在深度预测指标上却优于所有基线模型。此外,不使用元数据编码的基线模型也比以前的方法表现更好,这表明精心设计和训练的 2D 网络足以进行高质量的深度估计。下图 4 和图 5 显示了深度和法线的定性结果。

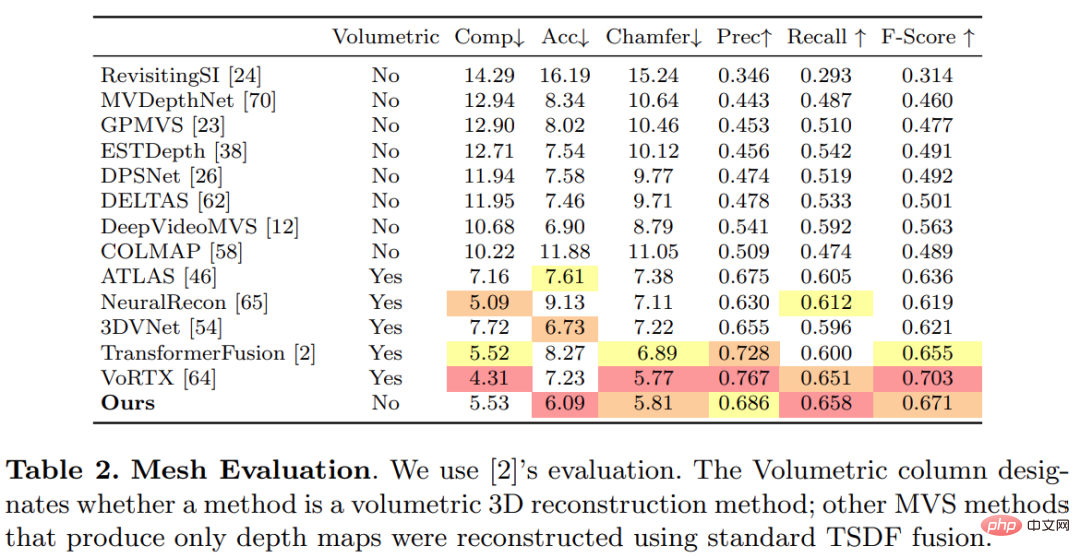

该研究使用 TransformerFusion 建立的标准协议进行 3D 重建评估,结果如下表 2 所示。

对于在线和交互式 3D 重建应用,减少传感器延迟是至关重要的。下表 3 展示了给定一个新的 RGB 帧,各个模型对每帧的集成计算时间。

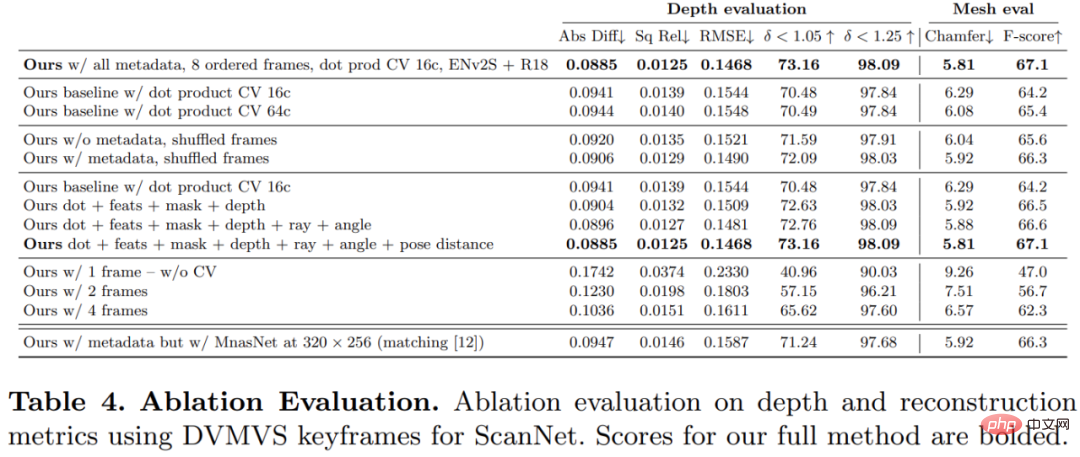

为了验证该研究所提方法中各个组件的有效性,研究者进行了消融实验,结果如下表 4 所示。

感兴趣的读者可以阅读论文原文,了解更多研究细节。

以上是A100实现无需3D卷积的3D重建方法,每帧重建仅需70ms的详细内容。更多信息请关注PHP中文网其他相关文章!

优化您的组织与Genai代理商的电子邮件营销Apr 13, 2025 am 11:44 AM

优化您的组织与Genai代理商的电子邮件营销Apr 13, 2025 am 11:44 AM介绍 恭喜!您经营一家成功的业务。通过您的网页,社交媒体活动,网络研讨会,会议,免费资源和其他来源,您每天收集5000个电子邮件ID。下一个明显的步骤是

Apache Pinot实时应用程序性能监视Apr 13, 2025 am 11:40 AM

Apache Pinot实时应用程序性能监视Apr 13, 2025 am 11:40 AM介绍 在当今快节奏的软件开发环境中,确保最佳应用程序性能至关重要。监视实时指标,例如响应时间,错误率和资源利用率可以帮助MAIN

Chatgpt击中了10亿用户? Openai首席执行官说:'短短几周内翻了一番Apr 13, 2025 am 11:23 AM

Chatgpt击中了10亿用户? Openai首席执行官说:'短短几周内翻了一番Apr 13, 2025 am 11:23 AM“您有几个用户?”他扮演。 阿尔特曼回答说:“我认为我们上次说的是每周5亿个活跃者,而且它正在迅速增长。” “你告诉我,就像在短短几周内翻了一番,”安德森继续说道。 “我说那个私人

pixtral -12b:Mistral AI'第一个多模型模型 - 分析VidhyaApr 13, 2025 am 11:20 AM

pixtral -12b:Mistral AI'第一个多模型模型 - 分析VidhyaApr 13, 2025 am 11:20 AM介绍 Mistral发布了其第一个多模式模型,即Pixtral-12b-2409。该模型建立在Mistral的120亿参数Nemo 12B之上。是什么设置了该模型?现在可以拍摄图像和Tex

生成AI应用的代理框架 - 分析VidhyaApr 13, 2025 am 11:13 AM

生成AI应用的代理框架 - 分析VidhyaApr 13, 2025 am 11:13 AM想象一下,拥有一个由AI驱动的助手,不仅可以响应您的查询,还可以自主收集信息,执行任务甚至处理多种类型的数据(TEXT,图像和代码)。听起来有未来派?在这个a

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

Dreamweaver CS6

视觉化网页开发工具

螳螂BT

Mantis是一个易于部署的基于Web的缺陷跟踪工具,用于帮助产品缺陷跟踪。它需要PHP、MySQL和一个Web服务器。请查看我们的演示和托管服务。

DVWA

Damn Vulnerable Web App (DVWA) 是一个PHP/MySQL的Web应用程序,非常容易受到攻击。它的主要目标是成为安全专业人员在合法环境中测试自己的技能和工具的辅助工具,帮助Web开发人员更好地理解保护Web应用程序的过程,并帮助教师/学生在课堂环境中教授/学习Web应用程序安全。DVWA的目标是通过简单直接的界面练习一些最常见的Web漏洞,难度各不相同。请注意,该软件中

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。

SecLists

SecLists是最终安全测试人员的伙伴。它是一个包含各种类型列表的集合,这些列表在安全评估过程中经常使用,都在一个地方。SecLists通过方便地提供安全测试人员可能需要的所有列表,帮助提高安全测试的效率和生产力。列表类型包括用户名、密码、URL、模糊测试有效载荷、敏感数据模式、Web shell等等。测试人员只需将此存储库拉到新的测试机上,他就可以访问到所需的每种类型的列表。