从视频到音频:使用VIT进行音频分类

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB转载

- 2023-04-12 11:43:051075浏览

就机器学习而言,音频本身是一个有广泛应用的完整的领域,包括语音识别、音乐分类和声音事件检测等等。传统上音频分类一直使用谱图分析和隐马尔可夫模型等方法,这些方法已被证明是有效的,但也有其局限性。近期VIT已经成为音频任务的一个有前途的替代品,OpenAI的Whisper就是一个很好的例子。

数据集介绍

GTZAN 数据集是在音乐流派识别 (MGR) 研究中最常用的公共数据集。 这些文件是在 2000-2001 年从各种来源收集的,包括个人 CD、收音机、麦克风录音,代表各种录音条件下的声音。

这个数据集由子文件夹组成,每个子文件夹是一种类型。

加载数据集

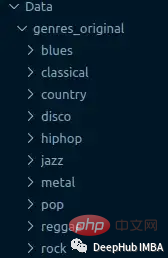

我们将加载每个.wav文件,并通过librosa库生成相应的Mel谱图。

mel谱图是声音信号的频谱内容的一种可视化表示,它的垂直轴表示mel尺度上的频率,水平轴表示时间。它是音频信号处理中常用的一种表示形式,特别是在音乐信息检索领域。

梅尔音阶(Mel scale,英语:mel scale)是一个考虑到人类音高感知的音阶。因为人类不会感知线性范围的频率,也就是说我们在检测低频差异方面要胜于高频。 例如,我们可以轻松分辨出500 Hz和1000 Hz之间的差异,但是即使之间的距离相同,我们也很难分辨出10,000 Hz和10,500 Hz之间的差异。所以梅尔音阶解决了这个问题,如果梅尔音阶的差异相同,则意指人类感觉到的音高差异将相同。

def wav2melspec(fp):

y, sr = librosa.load(fp)

S = librosa.feature.melspectrogram(y=y, sr=sr, n_mels=128)

log_S = librosa.amplitude_to_db(S, ref=np.max)

img = librosa.display.specshow(log_S, sr=sr, x_axis='time', y_axis='mel')

# get current figure without white border

img = plt.gcf()

img.gca().xaxis.set_major_locator(plt.NullLocator())

img.gca().yaxis.set_major_locator(plt.NullLocator())

img.subplots_adjust(top = 1, bottom = 0, right = 1, left = 0,

hspace = 0, wspace = 0)

img.gca().xaxis.set_major_locator(plt.NullLocator())

img.gca().yaxis.set_major_locator(plt.NullLocator())

# to pil image

img.canvas.draw()

img = Image.frombytes('RGB', img.canvas.get_width_height(), img.canvas.tostring_rgb())

return img上述函数将产生一个简单的mel谱图:

现在我们从文件夹中加载数据集,并对图像应用转换。

class AudioDataset(Dataset):

def __init__(self, root, transform=None):

self.root = root

self.transform = transform

self.classes = sorted(os.listdir(root))

self.class_to_idx = {c: i for i, c in enumerate(self.classes)}

self.samples = []

for c in self.classes:

for fp in os.listdir(os.path.join(root, c)):

self.samples.append((os.path.join(root, c, fp), self.class_to_idx[c]))

def __len__(self):

return len(self.samples)

def __getitem__(self, idx):

fp, target = self.samples[idx]

img = Image.open(fp)

if self.transform:

img = self.transform(img)

return img, target

train_dataset = AudioDataset(root, transform=transforms.Compose([

transforms.Resize((480, 480)),

transforms.ToTensor(),

transforms.Normalize((0.5, 0.5, 0.5), (0.5, 0.5, 0.5))

]))ViT模型

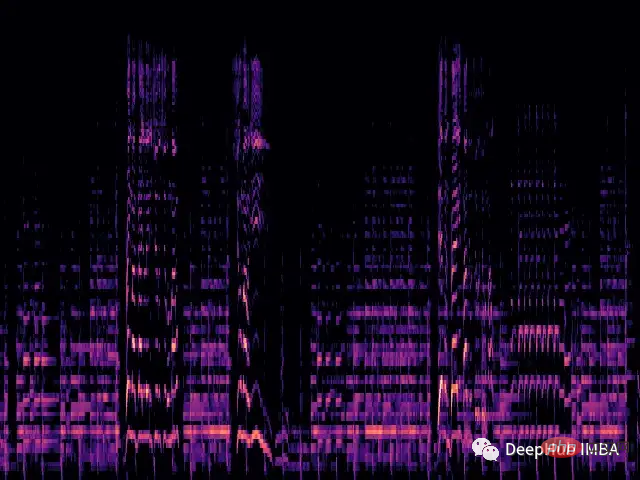

我们将利用ViT来作为我们的模型:Vision Transformer在论文中首次介绍了一幅图像等于16x16个单词,并成功地展示了这种方式不依赖任何的cnn,直接应用于图像Patches序列的纯Transformer可以很好地执行图像分类任务。

将图像分割成Patches,并将这些Patches的线性嵌入序列作为Transformer的输入。Patches的处理方式与NLP应用程序中的标记(单词)是相同的。

由于缺乏CNN固有的归纳偏差(如局部性),Transformer在训练数据量不足时不能很好地泛化。但是当在大型数据集上训练时,它确实在多个图像识别基准上达到或击败了最先进的水平。

实现的结构如下所示:

class ViT(nn.Sequential): def __init__(self, in_channels: int = 3, patch_size: int = 16, emb_size: int = 768, img_size: int = 356, depth: int = 12, n_classes: int = 1000, **kwargs): super().__init__( PatchEmbedding(in_channels, patch_size, emb_size, img_size), TransformerEncoder(depth, emb_size=emb_size, **kwargs), ClassificationHead(emb_size, n_classes)

训练

训练循环也是传统的训练过程:

vit = ViT(

n_classes = len(train_dataset.classes)

)

vit.to(device)

# train

train_loader = DataLoader(train_dataset, batch_size=32, shuffle=True)

optimizer = optim.Adam(vit.parameters(), lr=1e-3)

scheduler = ReduceLROnPlateau(optimizer, 'max', factor=0.3, patience=3, verbose=True)

criterion = nn.CrossEntropyLoss()

num_epochs = 30

for epoch in range(num_epochs):

print('Epoch {}/{}'.format(epoch, num_epochs - 1))

print('-' * 10)

vit.train()

running_loss = 0.0

running_corrects = 0

for inputs, labels in tqdm.tqdm(train_loader):

inputs = inputs.to(device)

labels = labels.to(device)

optimizer.zero_grad()

with torch.set_grad_enabled(True):

outputs = vit(inputs)

loss = criterion(outputs, labels)

_, preds = torch.max(outputs, 1)

loss.backward()

optimizer.step()

running_loss += loss.item() * inputs.size(0)

running_corrects += torch.sum(preds == labels.data)

epoch_loss = running_loss / len(train_dataset)

epoch_acc = running_corrects.double() / len(train_dataset)

scheduler.step(epoch_acc)

print('Loss: {:.4f} Acc: {:.4f}'.format(epoch_loss, epoch_acc))总结

使用PyTorch从头开始训练了这个Vision Transformer架构的自定义实现。因为数据集非常小(每个类只有100个样本),这影响了模型的性能,只获得了0.71的准确率。

这只是一个简单的演示,如果需要提高模型表现,可以使用更大的数据集,或者稍微调整架构的各种超参数!

这里使用的vit代码来自:

https://medium.com/artificialis/vit-visiontransformer-a-pytorch-implementation-8d6a1033bdc5

以上是从视频到音频:使用VIT进行音频分类的详细内容。更多信息请关注PHP中文网其他相关文章!