你说ChatGPT,它写的东西逼真到傻傻分不清?

没关系!

现在,它的“克星”来了——

一位华人小哥专门搞了这么一个网站,专门鉴别文字到底是出自于AI还是人类。

你只需要把相应的内容粘进去,几秒内就能分析出结果。

它:“就知道是AI。”

如此神器一出,可谓迅速俘获大家的芳心。

这不,直接把服务器都给挤崩喽(好在还有个备用的)。

这下,那些用ChatGPT写作业的“熊孩子”也要惨啦?

是人还是ChatGPT?GPTZero:看我的

这个网站名叫GPTZero。

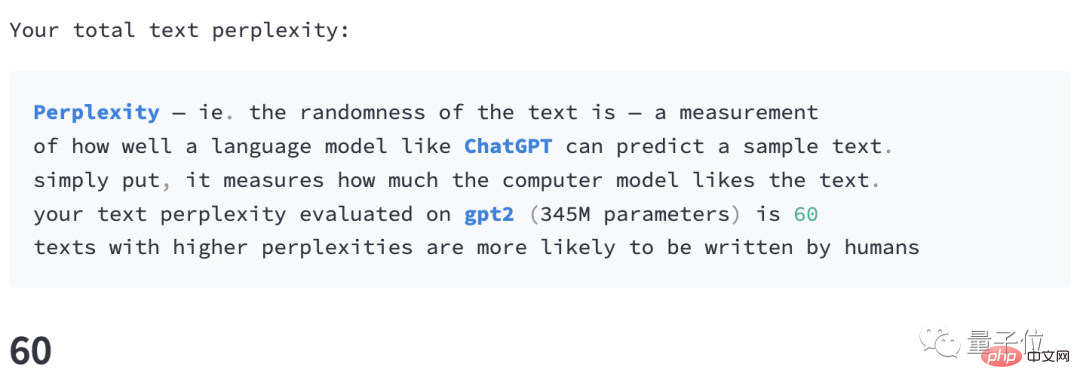

它主要靠“perplexity”,即文本的“困惑度”作为指标来判断所给内容到底是谁写的。

NLP领域的朋友们都知道,这个指标就是用来评价一个语言模型的好坏的。

在这里,每当你喂给GPTZero一段测试内容,它就会分别计算出:

1、文字总困惑度

这个值越高,就越可能出自人类之手。

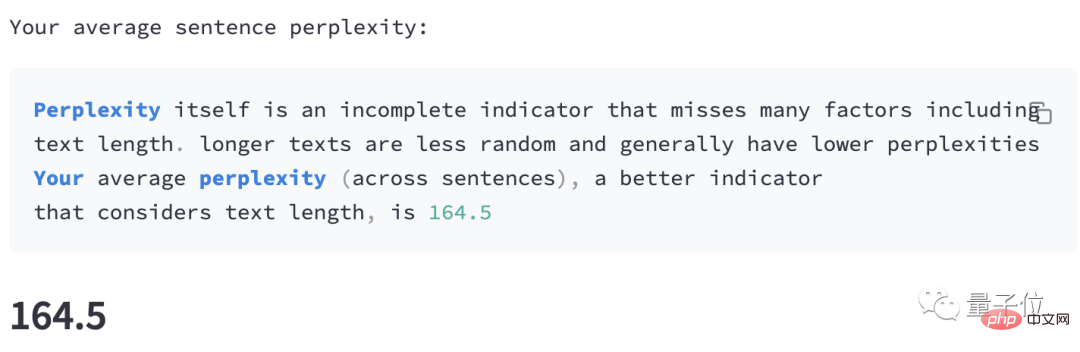

2、所有句子的平均困惑度

句子越长,这个值通常就越低。

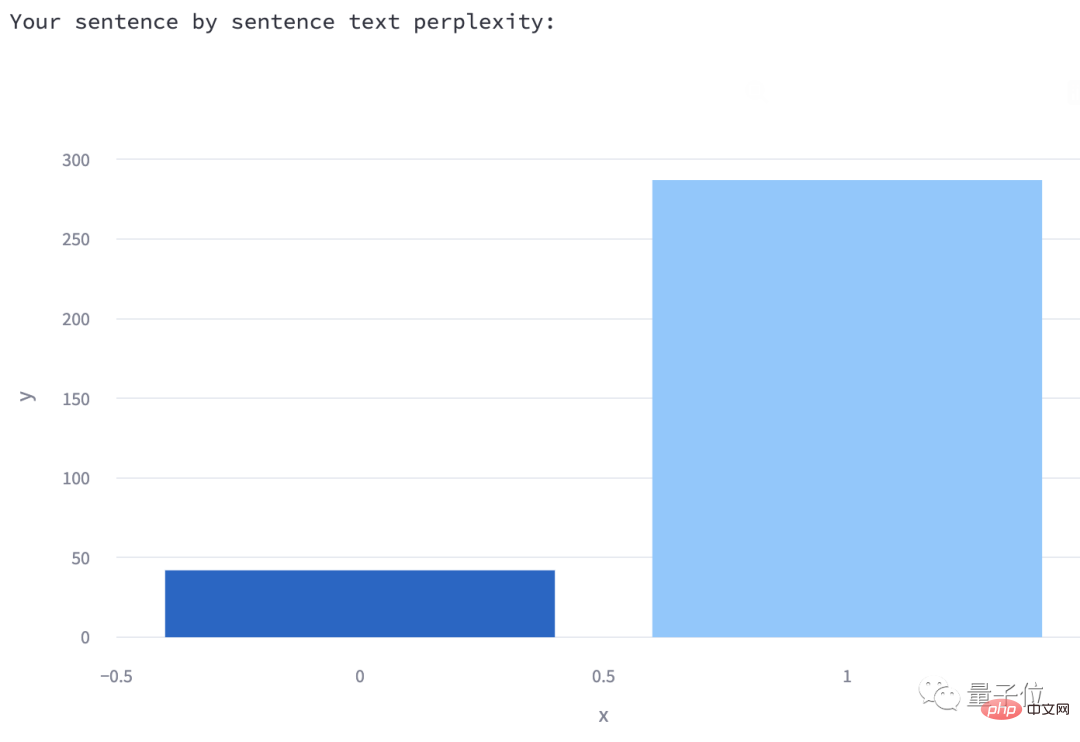

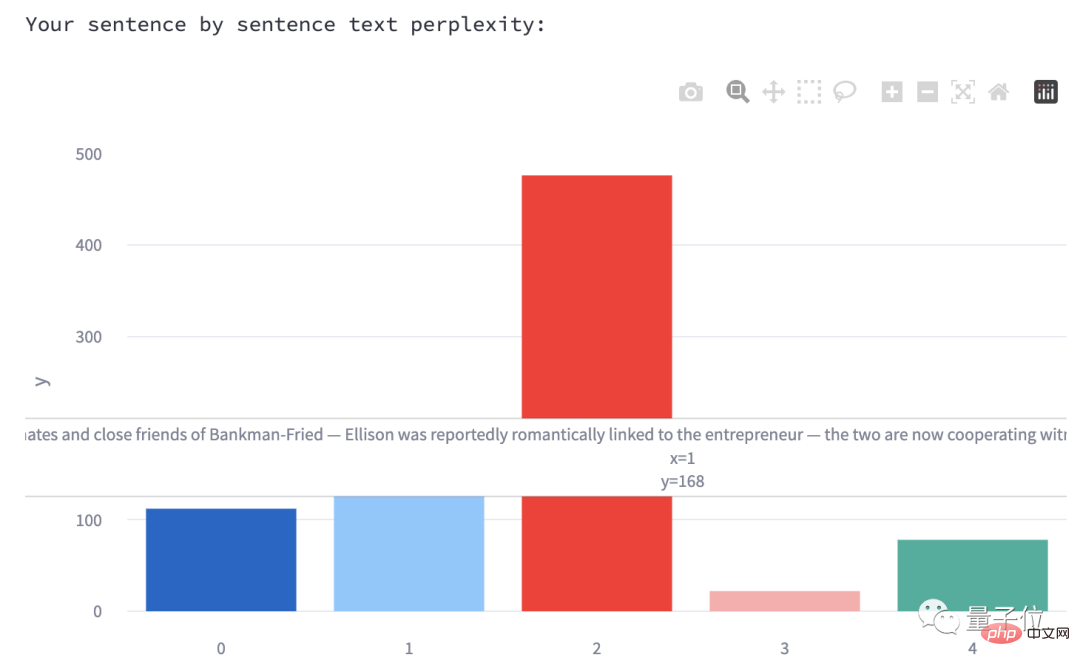

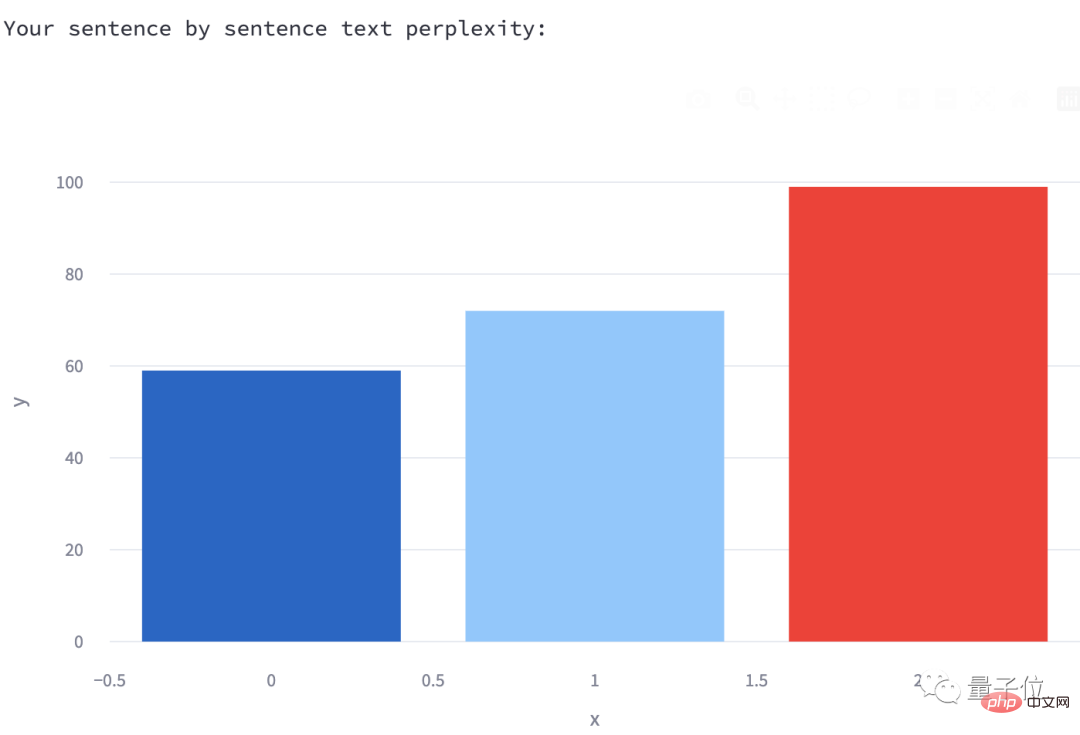

3、每个句子的困惑度

通过条形图的方式呈现,鼠标悬浮到各个方块就可以查看相应的句子是什么(这里就两块,因为我此时输入的测试内容就俩句子)。

之所以要绘制这样的条形图,作者也作出了解释:

根据最新的一些研究:人类书写的一些句子可能具有较低的困惑度(前面说过,人类的困惑度是比较高的),但随着继续写,困惑度势必会出现峰值。

相反,用机器生成的文本,其困惑度是均匀分布的,并且总是很低。

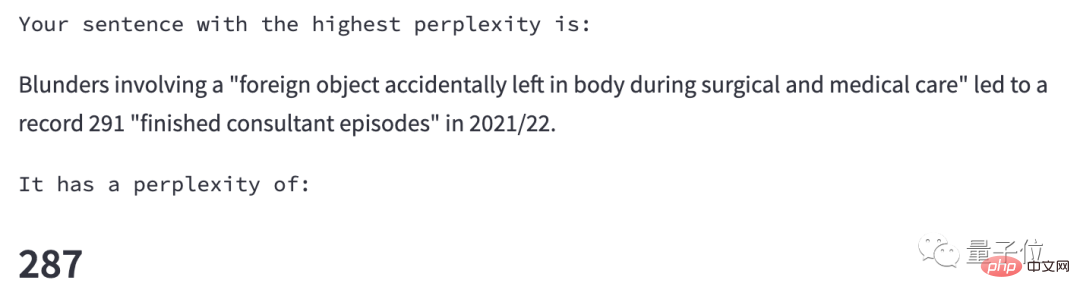

除此之外,GPTZero还会挑出困惑度最高的那个句子(也就是最像人写的):

规则就是这些,接下来实际测一测。

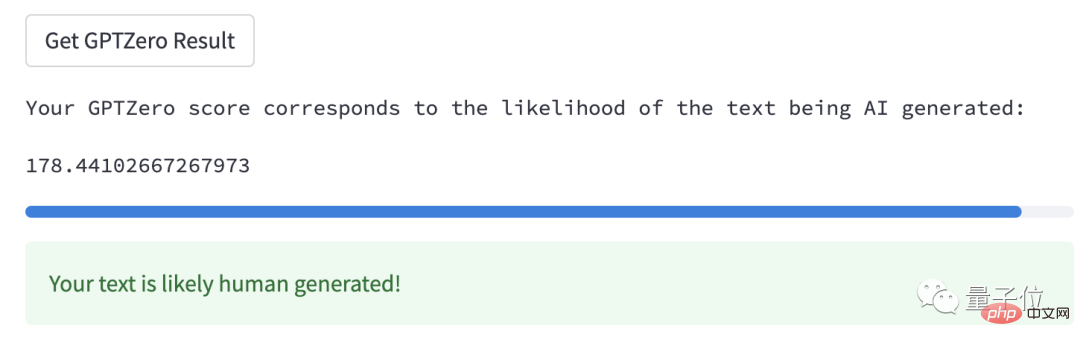

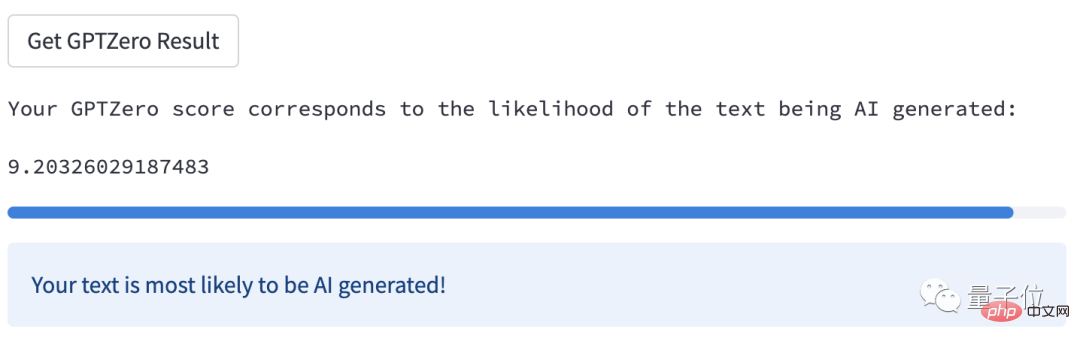

测试1:成功

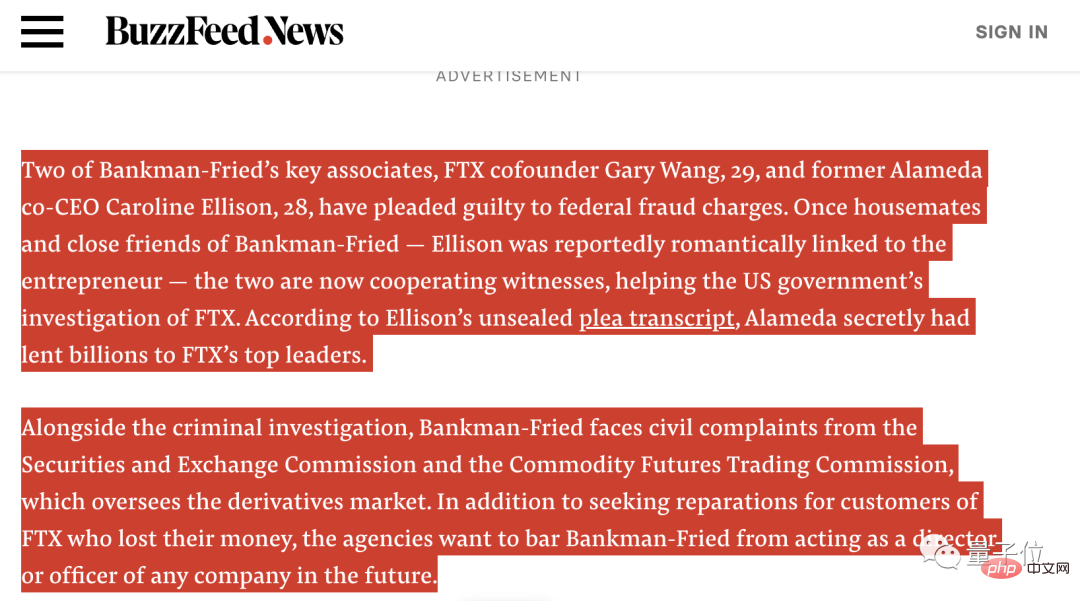

首先来一段最新的英文新闻(目前还不支持测中文):

将它粘贴进测试框(需注意每句至少5个单词,建议每段能有10个句子,结果会更准一些)。

很快,GPTZero计算出这段文字的总文字困惑度为27,句子平均困惑度为171.2,每条句子的困惑度图长这样:

以及困惑度最高的句子的值为476。

看这个结果,估计你也猜出了GPTZero的答案:

是人类写的。

答对了。

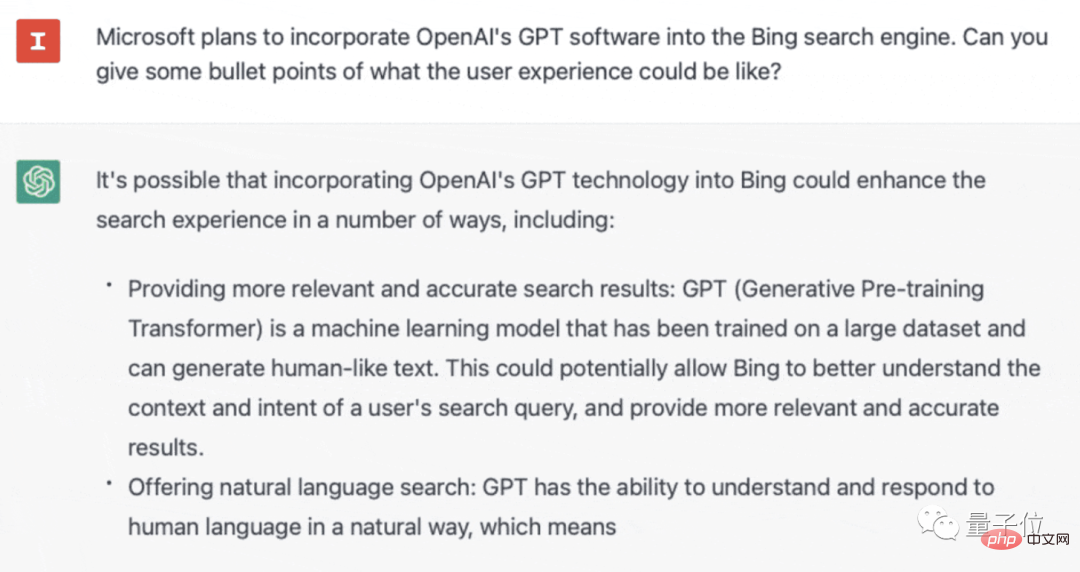

测试2:失败

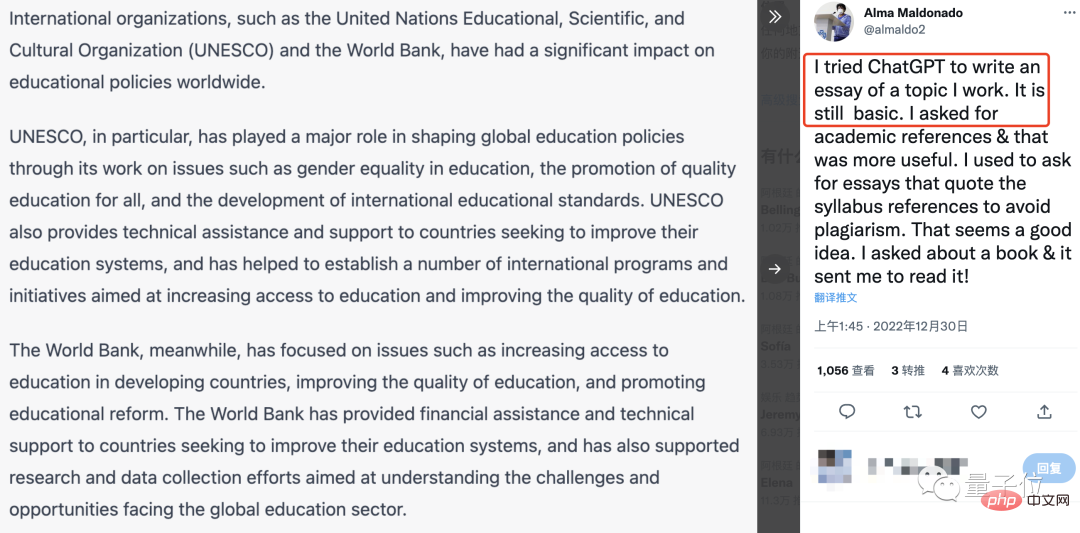

来一段ChatGPT的。

将内容粘贴进测试框,得出这段文字的总文字困惑度为31,句子平均困惑度为76.67,每条句子的困惑度图长这样:

以及困惑度最高的句子的值为99。

看起来,每项困惑度值都和上面那段差距都挺大的,应该能猜出来是AI写的吧。

不过遗憾的是,GPTZero无法给出答案,还希望我们再多加一点文字试试。

显然,这段话字数够多,但句子不够多,无法让GPTZero一眼识破ChatGPT的“伪装”。

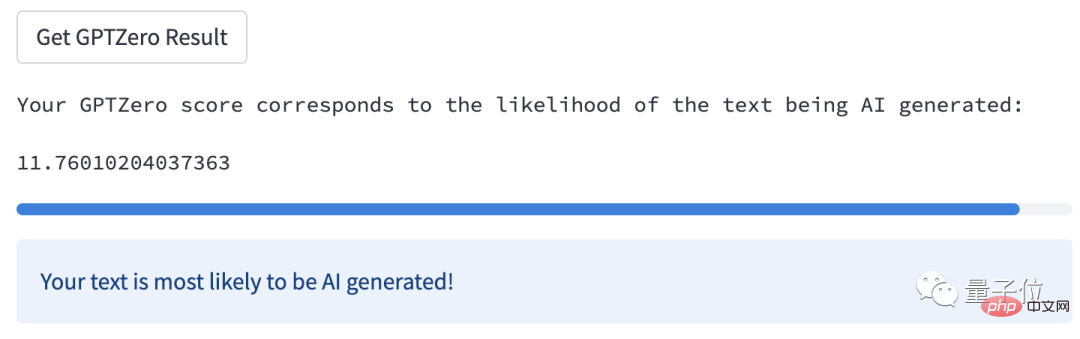

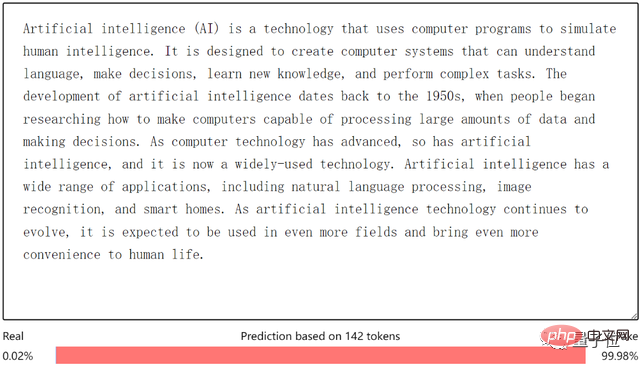

测试3:成功

那我们再来一段ChatGPT的试试。

这回内容够长,句子也够多。

果然没问题了,GPTZero直接答对:

好像确实摸出来一点门道:

那就是字多的同时,句子数量也一定要多,至少5句,好让GPTZero通过直方图的分布加码识别,最后的准确率就可以提高一些。

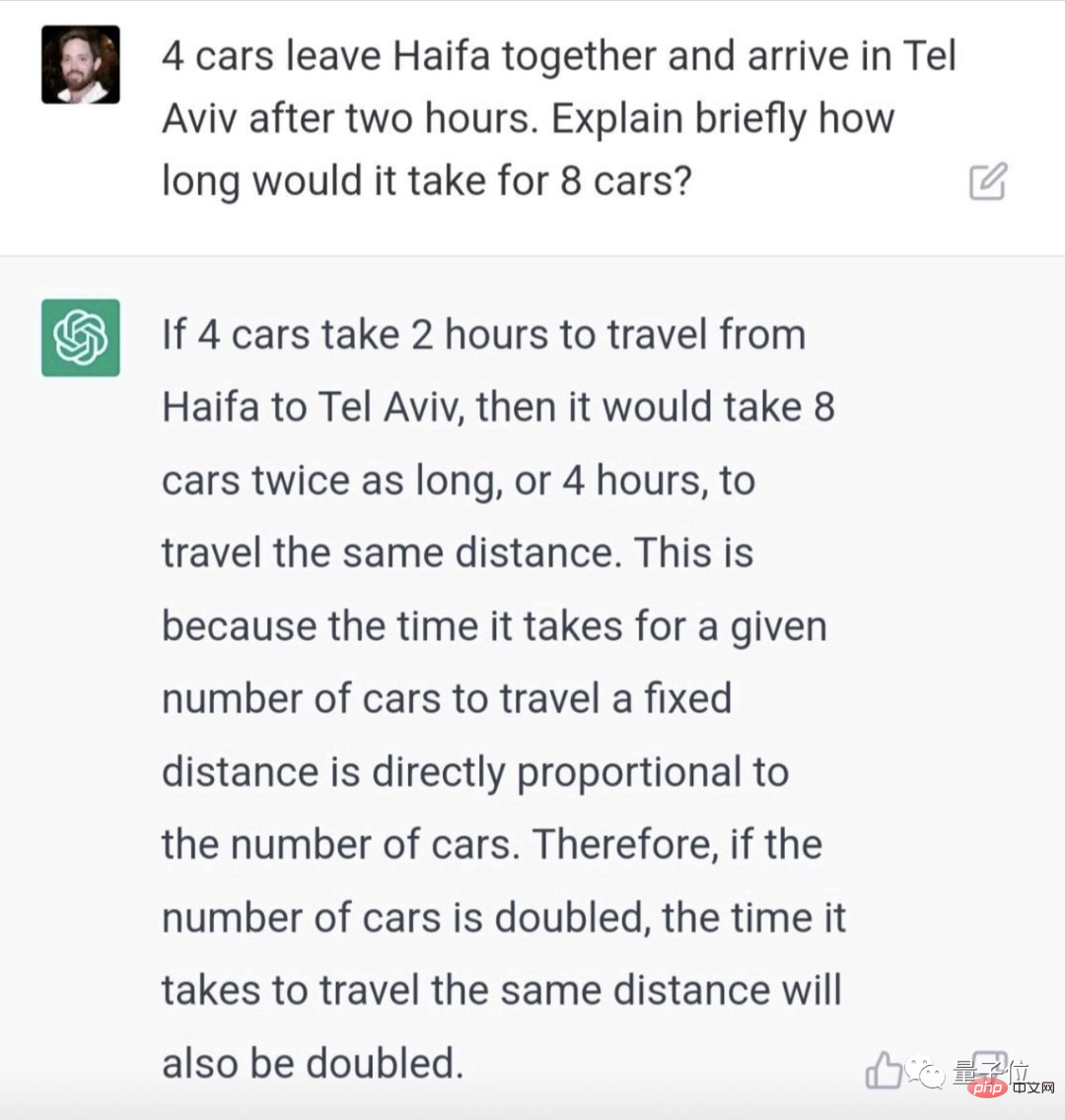

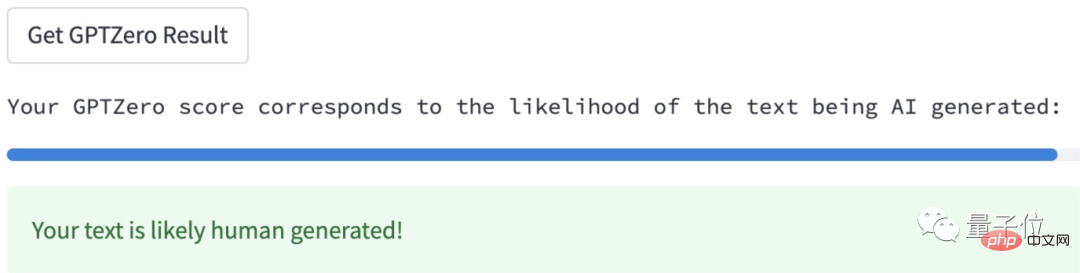

另外还需要提的是,我们发现在挑战失败的情况中,除了上面这种识别不出来的时候,也有直接识别错误的——

比如把AI写的判断成人写的:

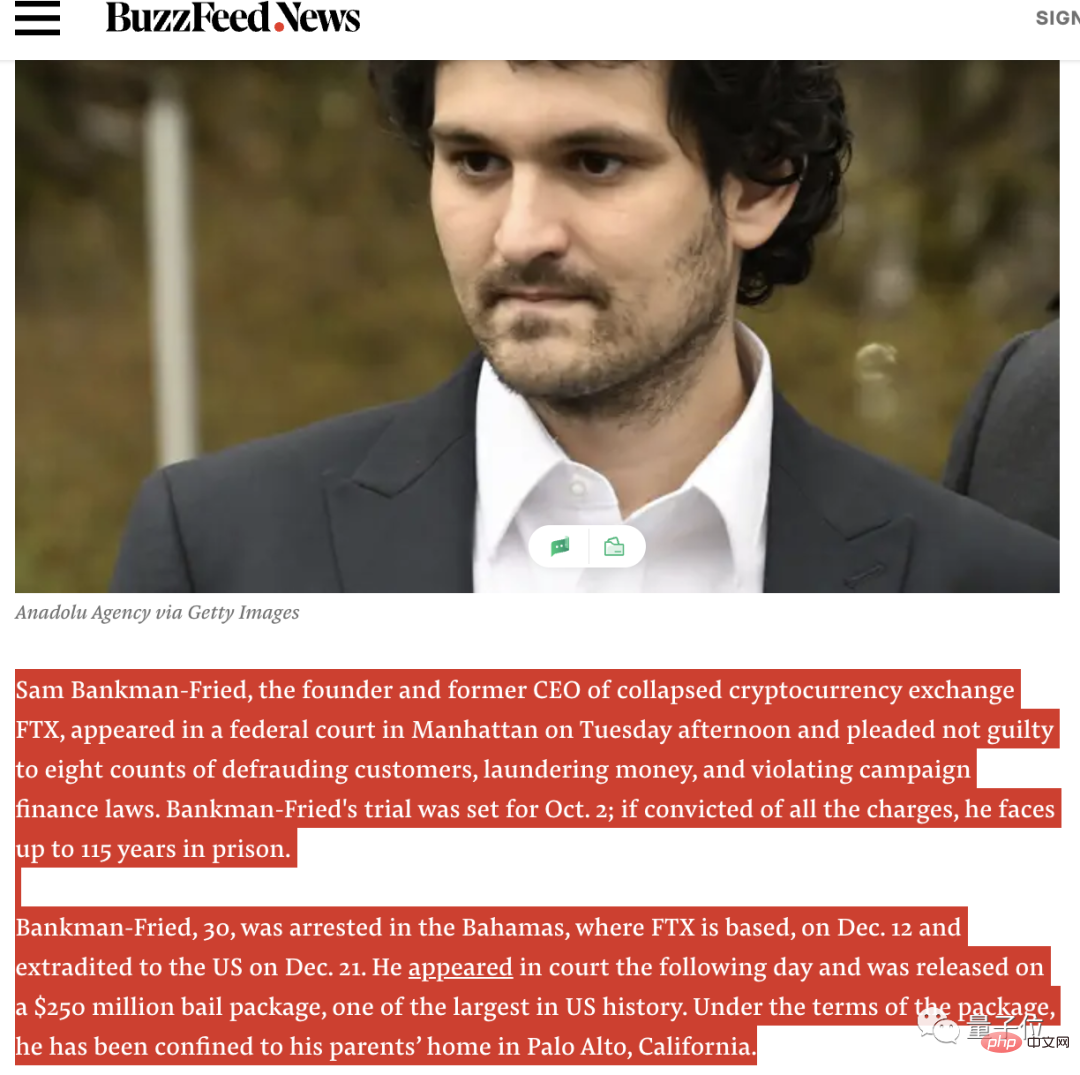

把人写的新闻判断成AI的:

这种情况按照上面所说的窍门,再多加点内容可能就能将结果扳回来。

(注意是可能哈,就上面这段新闻,我们把所有内容都粘进去了,它也说不行,还说要再多来点。)

普林斯顿华人小哥出品

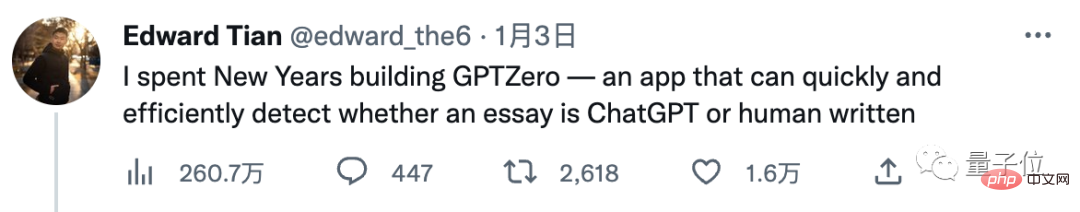

创建该网站的,是一个22岁的华人小哥Edward Tian,来自加拿大多伦多。

目前是美国普林斯顿CS专业大四学生,辅修认知科学和新闻学,对软件工程、机器学习等有浓厚的兴趣。

他现在微软实习,曾在BBC、贝灵猫等公司撰写过科技稿件,还曾加入到地图工具Representable的创始团队。

学习期间,他曾来到清华大学参加为期四周的城市研究研讨会。

据他表示,这个应用程序是新年假期在咖啡店完成的。

之所以想要开发这款应用程序,简而言之就是因为有太多ChatGPT炒作,人类应该知道有哪些是AI写的文章。

目前仍处于准系统阶段,预计在接下来几周内改进模型和分析。

除此之外,他还透露,正在测试由学生撰写的新闻文章数据集,并希望最终能发表论文。

更多ChatGPT杀手

事实上,也不只有这位小哥看ChatGPT不顺眼了。还有其他人类组织也相应开发了AI文本检测器,AKA ChatGPT杀手。

大体思路也都差不多,那就是“用魔法打败魔法”,用AI写的东西来训练新AI。

前阵子,OpenAI自己联合哈佛等高校机构联合打造了一款检测器:GPT-2 Output Detector。

作者们先是发布了一个“GPT-2生成内容”和WebText(专门从国外贴吧Reddit上扒下来的)数据集,让AI理解“AI语言”和“人话”之间的差异。

随后,用这个数据集对RoBERTa模型进行微调,就得到了这个AI检测器。其中人话一律被识别为True,AI生成的内容则一律被识别为Fake。

(RoBERTa是BERT的改进版。原始的BERT使用了13GB大小的数据集,但RoBERTa使用了包含6300万条英文新闻的160GB数据集。)

另一位早年代表选手,也因为这次新进展再次被提及。

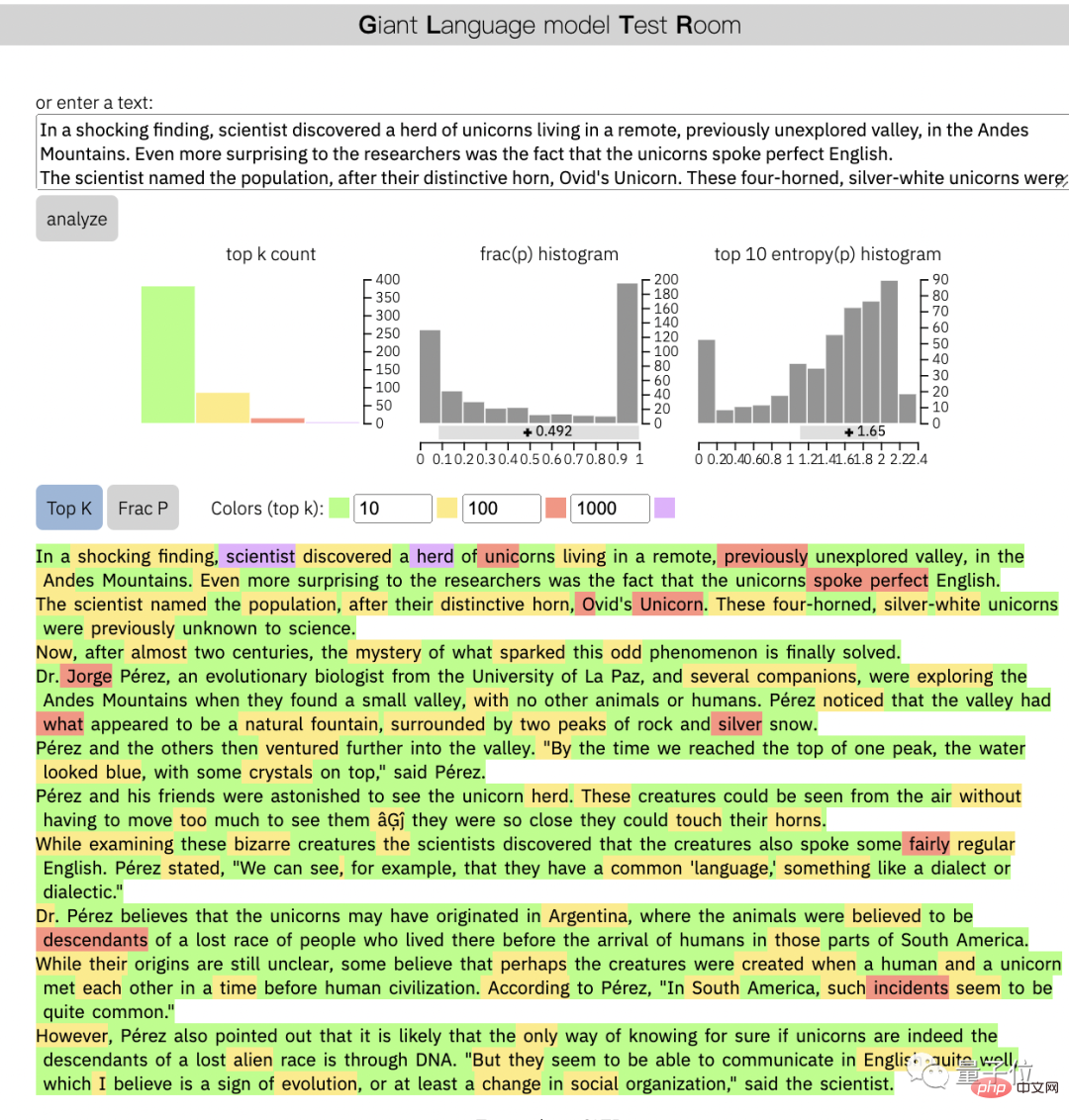

它就是MIT-IBM沃森AI实验室的以及哈佛NLP实验室开发的GLTR模型。

它主要通过对文本进行统计分析和可视化,而用来检测的是最初用来生成文本的相同or类似模型。目前主要支持GPT-2和BERT两个模型。

由于输出是模型知道的所有单词排名,根据排名对文本每个单词进行颜色编码,前10名是绿色,前100名是黄色,前1000名是红色,紫色则是不太可能出现的词。

如果一段文本黄绿色过多,那么这段文字主要是由AI生成的。

此番GPTZero再度亮相,不少网友惊叹:Incredible work!

但也有人表示,文本检测器根本就是一场失败的军备竞赛,他们的实际效果并不好。也阻挡不了ChatGPT的发展。

与此同时,还有网友探讨起关于「文章是否需要明确指示由AI还是人类编写」的必要性。

有位词曲创作者认为,这是有必要的,就像在看杂志时会标注“广告”,这应该是一个简单的要求。

但有网友立即表示反对,为什么要设置障碍?这就跟使用PS然后加上Adobe水印,对产品没有任何益处。

对于这个问题,你怎么看呢?

试玩链接:

https://etedward-gptzero-main-zqgfwb.streamlit.app/

参考链接:

[1]https://brackets.substack.com/about

[2]https://www.reddit.com/r/programming/comments/102hxlg/gptzero_an_app_to_efficiently_tell_if_an_essay_is/

[3]https://twitter.com/Marc__Watkins/status/1601746409203863553

[4]http://gltr.io/

以上是ChatGPT「克星」来了!文章作者是人是AI几秒检出,华人小哥元旦假期搞定,服务器已挤爆的详细内容。更多信息请关注PHP中文网其他相关文章!

微软工作趋势指数2025显示工作场所容量应变Apr 24, 2025 am 11:19 AM

微软工作趋势指数2025显示工作场所容量应变Apr 24, 2025 am 11:19 AM由于AI的快速整合而加剧了工作场所的迅速危机危机,要求战略转变以外的增量调整。 WTI的调查结果强调了这一点:68%的员工在工作量上挣扎,导致BUR

AI可以理解吗?中国房间的论点说不,但是对吗?Apr 24, 2025 am 11:18 AM

AI可以理解吗?中国房间的论点说不,但是对吗?Apr 24, 2025 am 11:18 AM约翰·塞尔(John Searle)的中国房间论点:对AI理解的挑战 Searle的思想实验直接质疑人工智能是否可以真正理解语言或具有真正意识。 想象一个人,对下巴一无所知

中国的'智能” AI助手回应微软召回的隐私缺陷Apr 24, 2025 am 11:17 AM

中国的'智能” AI助手回应微软召回的隐私缺陷Apr 24, 2025 am 11:17 AM与西方同行相比,中国的科技巨头在AI开发方面的课程不同。 他们不专注于技术基准和API集成,而是优先考虑“屏幕感知” AI助手 - AI T

Docker将熟悉的容器工作流程带到AI型号和MCP工具Apr 24, 2025 am 11:16 AM

Docker将熟悉的容器工作流程带到AI型号和MCP工具Apr 24, 2025 am 11:16 AMMCP:赋能AI系统访问外部工具 模型上下文协议(MCP)让AI应用能够通过标准化接口与外部工具和数据源交互。由Anthropic开发并得到主要AI提供商的支持,MCP允许语言模型和智能体发现可用工具并使用合适的参数调用它们。然而,实施MCP服务器存在一些挑战,包括环境冲突、安全漏洞以及跨平台行为不一致。 Forbes文章《Anthropic的模型上下文协议是AI智能体发展的一大步》作者:Janakiram MSVDocker通过容器化解决了这些问题。基于Docker Hub基础设施构建的Doc

使用6种AI街头智能策略来建立一家十亿美元的创业Apr 24, 2025 am 11:15 AM

使用6种AI街头智能策略来建立一家十亿美元的创业Apr 24, 2025 am 11:15 AM有远见的企业家采用的六种策略,他们利用尖端技术和精明的商业敏锐度来创造高利润的可扩展公司,同时保持控制权。本指南是针对有抱负的企业家的,旨在建立一个

Google照片更新解锁了您所有图片的惊人Ultra HDRApr 24, 2025 am 11:14 AM

Google照片更新解锁了您所有图片的惊人Ultra HDRApr 24, 2025 am 11:14 AMGoogle Photos的新型Ultra HDR工具:改变图像增强的游戏规则 Google Photos推出了一个功能强大的Ultra HDR转换工具,将标准照片转换为充满活力的高动态范围图像。这种增强功能受益于摄影师

Descope建立AI代理集成的身份验证框架Apr 24, 2025 am 11:13 AM

Descope建立AI代理集成的身份验证框架Apr 24, 2025 am 11:13 AM技术架构解决了新兴的身份验证挑战 代理身份集线器解决了许多组织仅在开始AI代理实施后发现的问题,即传统身份验证方法不是为机器设计的

Google Cloud Next 2025以及现代工作的未来Apr 24, 2025 am 11:12 AM

Google Cloud Next 2025以及现代工作的未来Apr 24, 2025 am 11:12 AM(注意:Google是我公司的咨询客户,Moor Insights&Strateging。) AI:从实验到企业基金会 Google Cloud Next 2025展示了AI从实验功能到企业技术的核心组成部分的演变,

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

VSCode Windows 64位 下载

微软推出的免费、功能强大的一款IDE编辑器

ZendStudio 13.5.1 Mac

功能强大的PHP集成开发环境

螳螂BT

Mantis是一个易于部署的基于Web的缺陷跟踪工具,用于帮助产品缺陷跟踪。它需要PHP、MySQL和一个Web服务器。请查看我们的演示和托管服务。

记事本++7.3.1

好用且免费的代码编辑器

mPDF

mPDF是一个PHP库,可以从UTF-8编码的HTML生成PDF文件。原作者Ian Back编写mPDF以从他的网站上“即时”输出PDF文件,并处理不同的语言。与原始脚本如HTML2FPDF相比,它的速度较慢,并且在使用Unicode字体时生成的文件较大,但支持CSS样式等,并进行了大量增强。支持几乎所有语言,包括RTL(阿拉伯语和希伯来语)和CJK(中日韩)。支持嵌套的块级元素(如P、DIV),