作为一个起名困难户,高中写作文最困扰我的就是写好文章却不知道起什么题目,开始做公众号以后,每次想标题也都要掉一大把头发......

最近,终于让我在 GitHub 发现了「取名废」之光,由清华大学与 OpenBMB 开源社区推出的大模型趣味应用:「智取标题」,输入正文内容就能一键生成劲爆标题!

开箱即用,试过后我只能说:真香!

在线体验:https://live.openbmb.org/ant

GitHub:https://github.com/OpenBMB/CPM-Live

提到这个标题党神器,就不得不先好好聊一聊它的「本体」——大模型 CPM-Ant。

CPM-Ant 作为国内首个直播训练百亿大模型, 训练耗时 68 天,于 2022 年 8 月 5 日完成,并由 OpenBMB 正式发布!

- 五大卓越特性

- 四大创新突破

- 训练过程 低成本且环境友好!

- 最重要的是——完全开源!

作为首个直播训练中文大模型,CPM-Ant 在大模型训练、微调、压缩、推理、应用等环节均提供了一份可行的实践方案,希望能为不同的关注者提供不同的帮助与参考。

下面,让我们一起来看看 CPM-Ant 发布成果内容报告吧!

模型概览

CPM-Ant 是一个开源的中文预训练语言模型,拥有 10B 参数,也是 CPM-Live 直播训练过程中的第一个里程碑。

整个训练过程低成本且环境友好,不需要高昂的硬件要求和运行成本,基于 增量微调(delta tuning)方法,在 CUGE 基准测试中取得了优异的结果。

CPM-Ant 相关代码、日志文件和模型参数在一个开放的许可协议下完全开源。除了完整的模型,OpenBMB 还提供了各种压缩版本以适应不同的硬件配置。

CPM-Ant 的五大卓越特性:

(1)计算高效

通过 BMTrain[1] 工具包,能够充分利用分布式计算资源的能力来高效训练大模型。

CPM-Ant 的训练持续了 68 天,花费了 43 万人民币,是谷歌训练 T5-11B 模型约 130 万美元费用的 1/20。训练 CPM-Ant 的温室气体排放量约为 4872kg CO₂e,而训练 T5-11B 的排放量为 46.7t CO₂e[9] ,CPM-Ant 的方案约为其排放量的 1/10。

(2)性能优异

借助 OpenDelta[3] 工具,能够非常方便地通过增量微调将 CPM-Ant 适配到下游任务。

实验表明,CPM-Ant 仅仅微调了 6.3M 参数就在 3/6 个 CUGE 任务上取得了最好的结果。这一结果超越了其他全参数微调的模型,举例来说:CPM-Ant 的微调参数量仅为 CPM2(微调了 11B 参数) 的 0.06%。

(3)部署经济

借助BMCook[7] 和 BMInf[4] 工具包,能够在有限的计算资源下驱动 CPM-Ant。

基于 BMInf ,能够替代计算集群 在单块 GPU 上进行大模型推理(即便是一块 GTX 1060 这样的消费级显卡)。为了使 CPM-Ant 的部署更加经济, OpenBMB 使用 BMCook 进一步将原始的 10B 模型压缩为不同的版本。压缩后的模型(7B,3B,1B,300M)能够适应不同低资源场景下的需求。

(4)使用便捷

不管是原始 10B 模型还是相关的压缩版本,通过几行代码就能够轻松地加载与运行。

OpenBMB 也会将 CPM-Ant 加入到 ModelCenter[8] 中,对模型的进一步开发会变得更加容易。

(5)开放民主

CPM-Ant 的训练过程完全开放。

OpenBMB 发布了所有的代码、日志文件和模型存档并提供开放获取。CPM-Ant 也采用了允许商业化的开放许可协议。

一份完整的大模型训练实践

对于有能力进行大模型训练的厂商与研究机构,CPM-Ant 训练过程提供了一份完整的中文大模型训练实战记录。

OpenBMB 发布了 CPM-Live 系列模型的 模型设计、训练方案、数据需求和实现代码。基于 CPM-Live 的模型架构,能够方便快速地设计实现大模型训练方案并整理相关的业务数据,完成模型预研和数据准备工作。

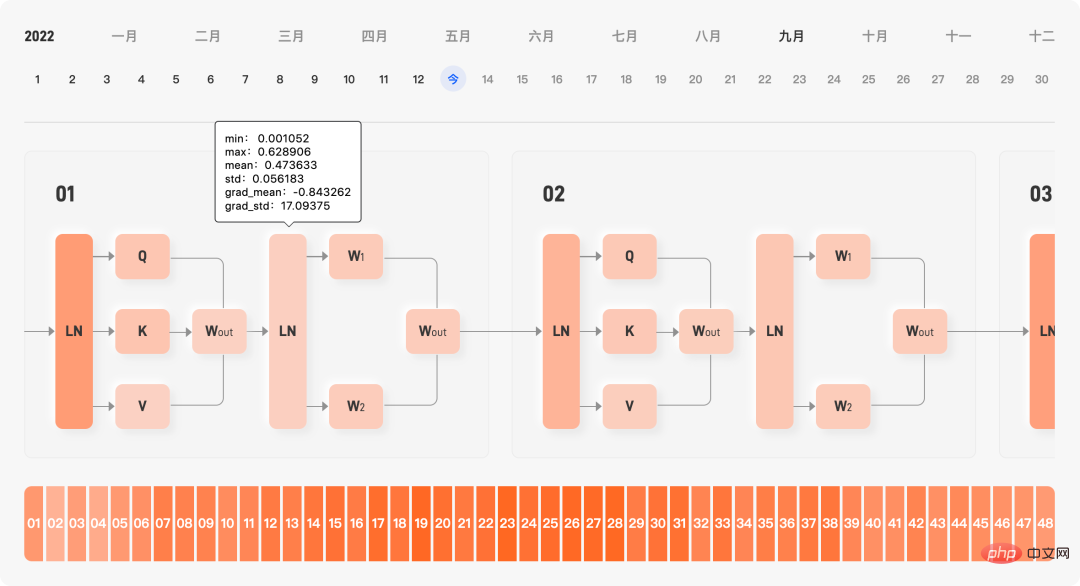

官方网站中记录了训练过程中的 全部训练动态,包括损失函数、学习率、已学习数据、吞吐量、梯度大小、花费成本曲线,以及模型内部参数均值和标准差实时展示,通过这些训练动态,使用者能够快速诊断模型训练过程是否出现问题。

模型训练内部参数实时展示

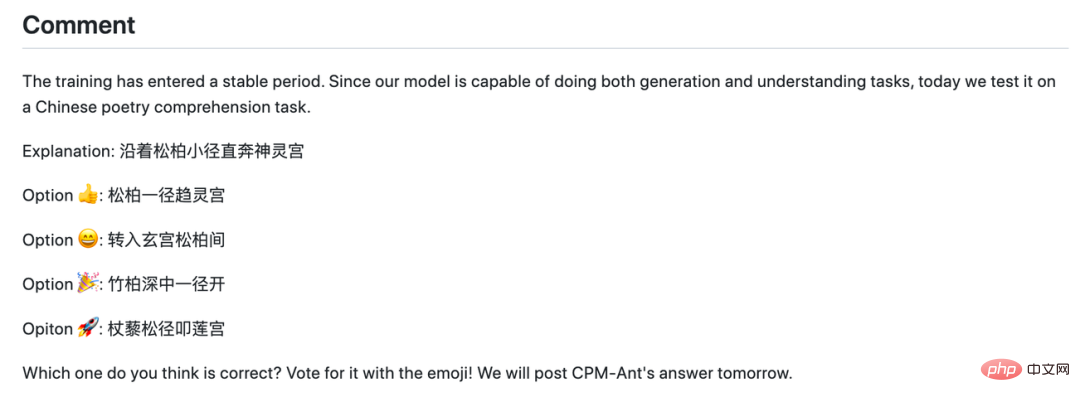

此外,OpenBMB 的研发同学每天实时更新 训练记录总结,总结内容包括损失值、梯度值、总体进展,还记录了遇到的一些问题和训练过程中的 bug,方便使用者提前了解模型训练过程中的可能会遇到的各种「坑」。

在模型训练「风平浪静」的日子,研发小哥也会抛出一些名言名句、介绍一些最新论文、甚至发起猜谜活动。

日志中的一次猜谜活动

除此之外,OpenBMB 还提供了 成本经济 的 训练方案,对于实际有大模型训练需求的企业,通过相关训练加速技术,训练成本已经降低到可以接受的水平。

使用 BMTrain[1] 工具包,百亿大模型 CPM-Ant 训练的算力花费仅 43 万人民币(当前花费依照公有云价格计算,实际成本会更低),是 11B 大模型 T5 外界估算成本 130 万美元的约 1/20!

一份屡创 SOTA 的高效微调方案

CPM-Ant 如何帮助我们进行下游任务适配?

对于大模型研究者,OpenBMB 提供了一份基于参数高效微调的大模型性能评测方案,方便快速进行下游任务适配并评测模型性能。

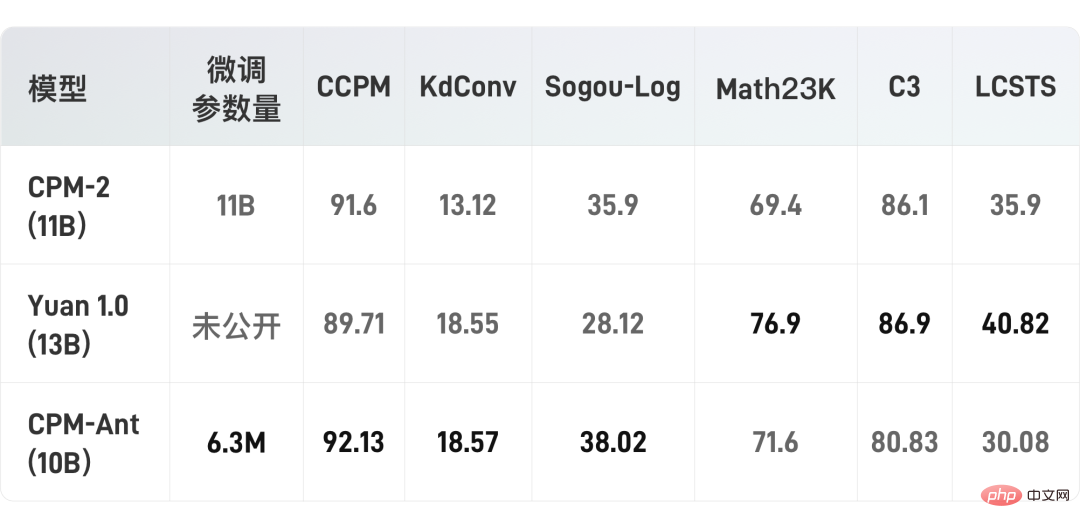

使用参数高效微调,即增量微调(delta tuning)来评估 CPM-Ant 在六个下游任务上的性能。实验中采用了 LoRA[2] ,它在每个注意层中插入了两个可调整的低秩矩阵,并冻结了原始模型的所有参数。使用这种方法,每个任务只微调了 6.3M 的参数,仅占总参数的 0.067%。

在 OpenDelta[3] 的帮助下,OpenBMB 进行了所有的实验,而没有修改原始模型的代码。需要指出的是,在下游任务上评测 CPM-Ant 模型时,没有使用任何数据增强的方法。实验结果如下表所示:

可以看到,在仅微调极少参数的情况下,OpenBMB 的模型在三个数据集上的性能已经超过了 CPM-2 和源 1.0。

有些任务(例如 LCSTS)在微调参数极少时可能会比较难以学习, CPM-Live 的训练过程将会持续进行,在各个任务上的性能也会被进一步打磨。

感兴趣的同学,可访问下方 GitHub 链接,抢先体验下 CPM-Ant 和 OpenDelta,进一步探索 CPM-Ant 在其他任务上的能力!

https://github.com/OpenBMB/CPM-Live

一系列硬件友好的推理方式

大模型性能固然惊艳,但高昂的硬件要求和运行成本一直困扰着许多使用者。对于大模型使用者,OpenBMB提供了一系列硬件友好的使用方式,能够较为方便地在不同硬件环境下运行不同的模型版本。

使用 BMInf[4] 工具包, CPM-Ant 可以在单卡 1060 这样的 低资源环境 中运行!

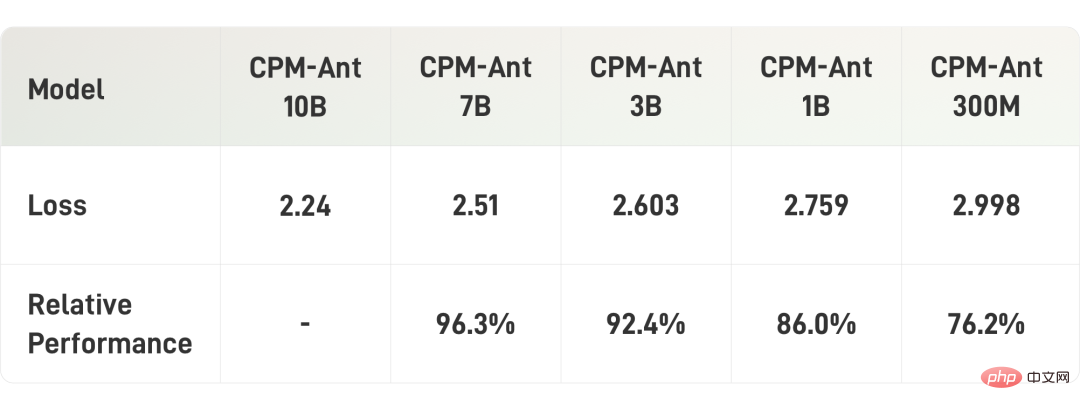

除此之外,OpenBMB 还将 CPM-Ant 进行了压缩。这些压缩的模型包括 CPM-Ant-7B/3B/1B/0.3B。而所有这些模型压缩尺寸都可以对应于现有的开源预训练语言模型的经典尺寸。

考虑到用户可能会在发布的检查点上进行进一步的开发,OpenBMB 主要使用 任务无关的结构化剪枝 来压缩 CPM-Ant。剪枝过程也是渐进的,即从 10B 到 7B,从 7B 到 3B,从 3B 到 1B,最后从 1B 到 0.3B。

在具体的剪枝过程中,OpenBMB 会训练一个 动态的可学习的掩码矩阵,然后用这个掩码矩阵来 裁剪相应的参数。最后,根据掩码矩阵的阈值修剪参数,该阈值是根据目标稀疏度确定的。更多压缩的细节可以参考技术博客[5] 。

下表展示了模型压缩的结果:

硬核的内容讲完了,那么大模型到底怎么帮我们「取标题」呢?

一款出乎意料的大模型趣味应用

基于 CPM-Ant,所有大模型开发者与爱好者都可以开发感兴趣的文本趣味应用。

为了进一步验证模型的有效性并提供范例,OpenBMB 在 CPM-Ant 基础上微调了一个 劲爆标题生成器 以展示模型能力。

只需要把正文内容粘贴到下方文本框,一键点击生成,就可以得到大模型提供的劲爆标题!

CPM-Ant 成果报告首发文章标题即由生成器生成

这款 demo将不断被打磨,并在未来添加更多的特殊效果,增强用户体验

感兴趣的用户也可以使用 CPM-Ant 构建自己的展示应用。如果有任何应用想法、需要技术支持或者在使用 demo 过程中遇到任何问题,可以随时在 CPM-Live 论坛[6] 发起讨论!

CPM-Ant 的发布是 CPM-Live 的第一个里程碑,但也仅仅是训练的第一期,未来OpenBMB还会继续进行一系列训练。

简单剧透一下,下一期的训练中将新增多语言支持、结构化输入输出等新特性,欢迎大家继续关注!

传送门|项目链接

项目 GitHub 地址:

https://github.com/OpenBMB/CPM-Live

Demo 体验地址(仅限 PC 访问):

https://live.openbmb.org/ant

以上是干掉「标题党」,清华团队又一开源力作!的详细内容。更多信息请关注PHP中文网其他相关文章!

Gemma范围:Google'用于凝视AI的显微镜Apr 17, 2025 am 11:55 AM

Gemma范围:Google'用于凝视AI的显微镜Apr 17, 2025 am 11:55 AM使用Gemma范围探索语言模型的内部工作 了解AI语言模型的复杂性是一个重大挑战。 Google发布的Gemma Scope是一种综合工具包,为研究人员提供了一种强大的探索方式

谁是商业智能分析师以及如何成为一位?Apr 17, 2025 am 11:44 AM

谁是商业智能分析师以及如何成为一位?Apr 17, 2025 am 11:44 AM解锁业务成功:成为商业智能分析师的指南 想象一下,将原始数据转换为驱动组织增长的可行见解。 这是商业智能(BI)分析师的力量 - 在GU中的关键作用

如何在SQL中添加列? - 分析VidhyaApr 17, 2025 am 11:43 AM

如何在SQL中添加列? - 分析VidhyaApr 17, 2025 am 11:43 AMSQL的Alter表语句:动态地将列添加到数据库 在数据管理中,SQL的适应性至关重要。 需要即时调整数据库结构吗? Alter表语句是您的解决方案。本指南的详细信息添加了Colu

业务分析师与数据分析师Apr 17, 2025 am 11:38 AM

业务分析师与数据分析师Apr 17, 2025 am 11:38 AM介绍 想象一个繁华的办公室,两名专业人员在一个关键项目中合作。 业务分析师专注于公司的目标,确定改进领域,并确保与市场趋势保持战略一致。 simu

什么是Excel中的Count和Counta? - 分析VidhyaApr 17, 2025 am 11:34 AM

什么是Excel中的Count和Counta? - 分析VidhyaApr 17, 2025 am 11:34 AMExcel 数据计数与分析:COUNT 和 COUNTA 函数详解 精确的数据计数和分析在 Excel 中至关重要,尤其是在处理大型数据集时。Excel 提供了多种函数来实现此目的,其中 COUNT 和 COUNTA 函数是用于在不同条件下统计单元格数量的关键工具。虽然这两个函数都用于计数单元格,但它们的设计目标却针对不同的数据类型。让我们深入了解 COUNT 和 COUNTA 函数的具体细节,突出它们独特的特性和区别,并学习如何在数据分析中应用它们。 要点概述 理解 COUNT 和 COU

Chrome在这里与AI:每天都有新事物!Apr 17, 2025 am 11:29 AM

Chrome在这里与AI:每天都有新事物!Apr 17, 2025 am 11:29 AMGoogle Chrome的AI Revolution:个性化和高效的浏览体验 人工智能(AI)正在迅速改变我们的日常生活,而Google Chrome正在领导网络浏览领域的负责人。 本文探讨了兴奋

AI的人类方面:福祉和四人底线Apr 17, 2025 am 11:28 AM

AI的人类方面:福祉和四人底线Apr 17, 2025 am 11:28 AM重新构想影响:四倍的底线 长期以来,对话一直以狭义的AI影响来控制,主要集中在利润的最低点上。但是,更全面的方法认识到BU的相互联系

您应该知道的5个改变游戏规则的量子计算用例Apr 17, 2025 am 11:24 AM

您应该知道的5个改变游戏规则的量子计算用例Apr 17, 2025 am 11:24 AM事情正稳步发展。投资投入量子服务提供商和初创企业表明,行业了解其意义。而且,越来越多的现实用例正在出现以证明其价值超出

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

Atom编辑器mac版下载

最流行的的开源编辑器

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。

SecLists

SecLists是最终安全测试人员的伙伴。它是一个包含各种类型列表的集合,这些列表在安全评估过程中经常使用,都在一个地方。SecLists通过方便地提供安全测试人员可能需要的所有列表,帮助提高安全测试的效率和生产力。列表类型包括用户名、密码、URL、模糊测试有效载荷、敏感数据模式、Web shell等等。测试人员只需将此存储库拉到新的测试机上,他就可以访问到所需的每种类型的列表。

VSCode Windows 64位 下载

微软推出的免费、功能强大的一款IDE编辑器