在处理大数据时,Java 框架的选择至关重要。流行的框架包括 Hadoop(用于批处理)、Spark(高性能交互式分析)、Flink(实时流处理)和 Beam(统一编程模型)。选择依据包括处理类型、延迟要求、数据量和技术栈。实战案例展示了使用 Spark 读取和处理 CSV 数据。

大数据处理中的 Java 框架选择

在当今大数据时代,使用合适的 Java 框架来处理海量数据至关重要。本文将介绍一些流行的 Java 框架及其优缺点,帮助您根据自己的需求做出明智的选择。

1. Apache Hadoop

- Hadoop 是处理大数据最常用的框架之一。

- 主要组件:Hadoop 分布式文件系统 (HDFS)、MapReduce 和 YARN

- 优点:可扩展性高、数据容错性好

- 缺点:延迟高,适合处理批处理任务

2. Apache Spark

- Spark 是一个内存计算框架,针对交互式分析和快速数据处理进行了优化。

- 优点:超高速、低延迟、支持多种数据源

- 缺点:集群管理和内存管理相对复杂

3. Apache Flink

- Flink 是一个分布式流处理引擎,专注于连续实时数据处理。

- 优点:低延迟、高吞吐量、状态管理能力强

- 缺点:学习曲线陡峭,对集群资源要求高

4. Apache Beam

- Beam 是一个统一的编程模型,用于构建管道以处理各种数据处理模式。

- 优点:数据模型统一、支持多种编程语言和云平台

- 缺点:性能可能会因具体技术栈而异

实战案例:使用 Spark 读取和处理 CSV 数据

import org.apache.spark.sql.Dataset;

import org.apache.spark.sql.Row;

import org.apache.spark.sql.SparkSession;

public class SparkCSVExample {

public static void main(String[] args) {

// 创建 SparkSession

SparkSession spark = SparkSession.builder().appName("Spark CSV Example").getOrCreate();

// 从 CSV 文件读取数据

Dataset<Row> df = spark.read()

.option("header", true)

.option("inferSchema", true)

.csv("path/to/my.csv");

// 打印数据集的前 10 行

df.show(10);

// 对数据集进行转换和操作

Dataset<Row> filtered = df.filter("age > 30");

filtered.show();

}

}选择依据

选择正确的 Java 框架取决于您的具体需求:

- 处理类型:批处理 vs. 实时处理

- 延迟要求:高延迟 vs. 低延迟

- 数据量:少量 vs. 海量数据

- 技术栈:现有技术和资源限制

以上是大数据处理中的Java框架选择的详细内容。更多信息请关注PHP中文网其他相关文章!

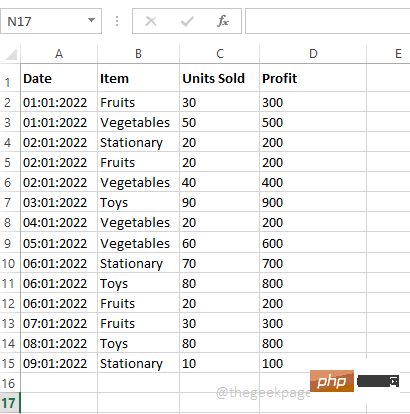

在 Microsoft Excel 中如何创建数据透视表Apr 22, 2023 pm 12:10 PM

在 Microsoft Excel 中如何创建数据透视表Apr 22, 2023 pm 12:10 PM当您拥有大量数据时,分析数据通常会变得越来越困难。但真的必须如此吗?MicrosoftExcel提供了一个令人惊叹的内置功能,称为数据透视表,可用于轻松分析庞大的数据块。它们可用于通过创建您自己的自定义报告来有效地汇总您的数据。它们可用于自动计算列的总和,可以对其应用过滤器,可以对其中的数据进行排序等。可以对数据透视表执行的操作以及如何使用数据透视表为了缓解您的日常excel障碍是无止境的。继续阅读,了解如何轻松创建数据透视表并了解如何有效组织它。希望你喜欢阅读这篇文章。第1节:什么是数据透视

如何阻止 Apple 在 iPhone 上收集诊断和使用数据Apr 16, 2023 pm 09:25 PM

如何阻止 Apple 在 iPhone 上收集诊断和使用数据Apr 16, 2023 pm 09:25 PM苹果以其对用户隐私的承诺而闻名。当您购买iPhone或Mac时,您知道您正在投资一家承诺保护您的数据的公司的产品。这在我们这个时代非常重要——因为我们越来越多地将更多的个人信息存储在这些设备上。我们使用的大多数设备都会收集使用数据以改进相应的产品和服务。例如,当应用程序在您的手机上崩溃时,可以通知开发人员以帮助他们查明此错误的原因。虽然这些数据通常是匿名的,但一些用户不喜欢让公司收集他们的日志。此外,通过共享这些诊断信息,您的设备会将它们上传到公司的服务器。这可能会耗尽您的(有限)数据计划和部分

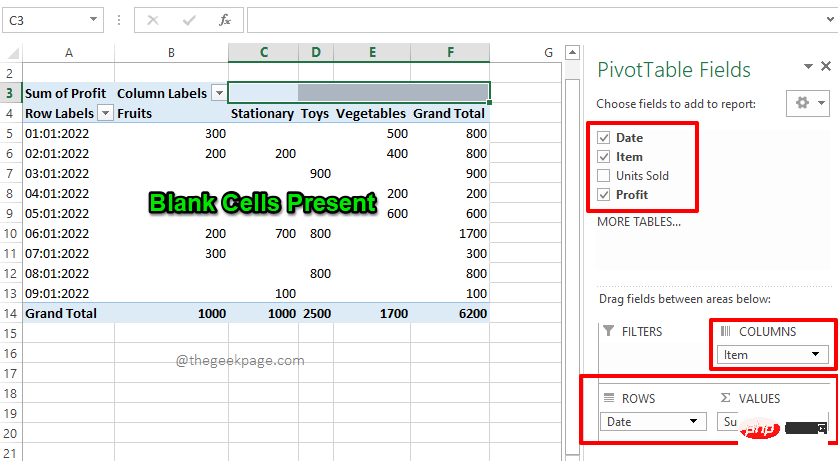

如何用零替换 Excel 数据透视表中的空白单元格Apr 15, 2023 am 11:52 AM

如何用零替换 Excel 数据透视表中的空白单元格Apr 15, 2023 am 11:52 AM了COLUMNS部分下的字段Item、ROWS部分下的字段Date和VALUES部分下的Profit字段。注意:如果您需要有关数据透视表如何工作以及如何有效地创建数据透视表的更多信息,请参阅我们的文章如何在MicrosoftExcel中创建数据透视表。因此,根据我的选择,我的数据透视表生成如下面的屏幕截图所示,使其成为我想要的完美摘要报告。但是,如果您查看数据透视表,您会发现我的数据透视表中有一些空白单元格。现在,让我们在接下来的步骤中将它们替换为零。第6步:要用零替换空白单元格,首先右键单击数

如何在 Microsoft Excel 图表中添加和自定义数据标签?May 07, 2023 pm 04:22 PM

如何在 Microsoft Excel 图表中添加和自定义数据标签?May 07, 2023 pm 04:22 PMMicrosoft Excel有许多至今令人们惊叹的功能。人们每天都会学到一些新东西。今天,我们将了解如何在Excel图表中添加和自定义数据标签。Excel图表包含大量数据,一眼看懂图表可能具有挑战性。使用数据标签是指出重要信息的好方法。数据标签可以用作柱形图或条形图的一部分。当您创建饼图时,它甚至可以用作标注。添加数据标签为了展示如何添加数据标签,我们将以饼图为例。虽然大多数人使用图例来显示饼图中的内容,但数据标签的效率要高得多。要添加数据标签,请创建饼图。打开它,然后单击显示图表设计

AI 算法在大数据治理中的应用Apr 12, 2023 pm 01:37 PM

AI 算法在大数据治理中的应用Apr 12, 2023 pm 01:37 PM本文主要分享 Datacake 在大数据治理中,AI 算法的应用经验。本次分享分为五大部分:第一部分阐明大数据与 AI 的关系,大数据不仅可以服务于 AI,也可以使用 AI 来优化自身服务,两者是互相支撑、依赖的关系;第二部分介绍利用 AI 模型综合评估大数据任务健康度的应用实践,为后续开展数据治理提供量化依据;第三部分介绍利用 AI 模型智能推荐 Spark 任务运行参数配置的应用实践,实现了提高云资源利用率的目标;第四部分介绍在 SQL 查询场景中,由模型智能推荐任务执行引擎的实践;第五部分

腾讯广告模型基于"太极"的训练成本优化实践Apr 14, 2023 pm 06:46 PM

腾讯广告模型基于"太极"的训练成本优化实践Apr 14, 2023 pm 06:46 PM近年来,大数据加大模型成为了AI领域建模的标准范式。在广告场景,大模型由于使用了更多的模型参数,利用更多的训练数据,模型具备了更强的记忆能力和泛化能力,为广告效果向上提升打开了更大的空间。但是大模型在训练过程中所需要的资源也是成倍的增长,存储以及计算上的压力对机器学习平台都是巨大的挑战。腾讯太极机器学习平台持续探索降本增效方案,在广告离线训练场景利用混合部署资源大大降低了资源成本,每天为腾讯广告提供50W核心廉价混合部署资源,帮助腾讯广告离线模型训练资源成本降低30%,同时通过一系列优化手段使得

如何使用 Go 语言进行大数据分析?Jun 11, 2023 am 11:11 AM

如何使用 Go 语言进行大数据分析?Jun 11, 2023 am 11:11 AM随着数据规模逐渐增大,大数据分析变得越来越重要。而Go语言作为一门快速、轻量级的编程语言,也成为了越来越多数据科学家和工程师的选择。本文将介绍如何使用Go语言进行大数据分析。数据采集在开始大数据分析之前,我们需要先采集数据。Go语言有很多包可以用于数据采集,例如“net/http”、“io/ioutil”等。通过这些包,我们可以从网站、API、日志

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

ZendStudio 13.5.1 Mac

功能强大的PHP集成开发环境

EditPlus 中文破解版

体积小,语法高亮,不支持代码提示功能

螳螂BT

Mantis是一个易于部署的基于Web的缺陷跟踪工具,用于帮助产品缺陷跟踪。它需要PHP、MySQL和一个Web服务器。请查看我们的演示和托管服务。

SublimeText3 Linux新版

SublimeText3 Linux最新版

mPDF

mPDF是一个PHP库,可以从UTF-8编码的HTML生成PDF文件。原作者Ian Back编写mPDF以从他的网站上“即时”输出PDF文件,并处理不同的语言。与原始脚本如HTML2FPDF相比,它的速度较慢,并且在使用Unicode字体时生成的文件较大,但支持CSS样式等,并进行了大量增强。支持几乎所有语言,包括RTL(阿拉伯语和希伯来语)和CJK(中日韩)。支持嵌套的块级元素(如P、DIV),