近日,由顏水成教授帶隊,崑崙萬維2050全球研究院、新加坡國立大學、新加坡南洋理工大學團隊聯合發布並開源了Vitron通用像素級視覺多模態大語言模型。

這是一款重磅的通用視覺多模態大模型,支援從視覺理解到視覺生成、從低層次到高層次的一系列視覺任務,解決了困擾大語言模型產業已久的圖像/視訊模型割裂問題,提供了一個全面統一靜態圖像與動態視訊內容的理解、生成、分割、編輯等任務的像素級通用視覺多模態大模型,為下一代通用視覺大模型的終極形態奠定了基礎,也標誌著大模型邁向通用人工智慧(AGI)的又一大步。

Vitron作為一個統一的像素級視覺多模態大語言模型,實現了從低層次到高層次的視覺任務的全面支持,能夠處理複雜的視覺任務,並理解和生成圖像和影片內容,提供了強大的視覺理解和任務執行能力。 同時,Vitron支援與使用者的連續操作,實現了靈活的人機互動,展示了通往更統一的視覺多模態通用模型的巨大潛力。

Vitron相關的論文、程式碼和Demo已全部公開,其在綜合性、技術創新、人機互動和應用潛力等方面展現出的獨特優勢和潛力,不僅推動了多模態大模型的發展,也為未來的視覺大模型研究提供了一個新的方向。

一直以來,崑崙萬維2050全球研究院都致力於打造一家面向未來世界的卓越科學研究機構,與科學社群共同跨越「奇點」#,探索未知世界,創造美好未來。 先前,崑崙萬維2050全球研究院已經發布並開源了數位智能體研發工具包AgentStudio #,未來,研究院也將持續推動人工智慧科技突破#,為中國人工智慧生態建設

貢獻力量。 目前視覺大語言模型(LLMs)的發展取得了喜人進展。社群越來越相信,建構更通用、更強大的多模態大模型(MLLMs)將會是通往通用人工智慧(AGI)的必經之路。但在向多模態通用大模型(Generalist)的邁進過程中,目前仍存在一些關鍵挑戰。例如很大一部分工作都沒有實現細粒度像素層級的視覺理解,或是缺乏對影像和視訊的統一支援。抑或對於各種視覺任務的支持不充分,離通用大模型相差甚遠。

為了補充這個空白,近日,崑崙萬維2050全球研究院、新加坡國立大學、新加坡南洋理工大學團隊聯合發布開源了Vitron通用像素級視覺多模態大語言模型。 Vitron支援從視覺理解到視覺生成、從低層次到高層次的一系列視覺任務,包括靜態影像和動態影片內容進行全面的理解、生成、分割和編輯等任務。 ###############Vitron在四大視覺相關任務的功能支援上進行了綜合描繪。以及其關鍵優勢。 Vitron也支援與使用者的連續操作,實現靈活的人機互動。該計畫展示了面向更統一的視覺多模態通用模型的巨大潛力,為下一代通用視覺大模型的終極形態奠定了基礎。 ######Vitron相關論文、程式碼、Demo目前已全部公開。 #########論文標題:Vitron: A Unified Pixel-level Vision LLM for Understanding, Generating, Segmenting, Editing######專案首頁&Demo:https://vitron-llm.github.io /######論文連結:https://is.gd/aGu0VV######開源程式碼:https://github.com/SkyworkAI/Vitron########### ##########0######1######. ######大一學的終極多模態大語言模型#######近年來,大語言模型(LLMs)展現出了前所未有的強大能力,其被逐漸驗證為乃是通往AGI的技術路線。而多模態大語言模型(MLLMs)在多個社區火熱發展且迅速出圈,透過引入能進行視覺感知的模組,擴展純語言基礎LLMs至MLLMs,眾多在圖像理解方面強大卓越的MLLMs被研發問世,例如BLIP-2、LLaVA、MiniGPT-4等等。同時,專注於視訊理解的MLLMs也陸續面世,如VideoChat、Video-LLaMA和Video-LLaVA等等。

隨後,研究人員主要從兩個維度試圖進一步擴展MLLMs的能力。一方面,研究人員嘗試深化MLLMs對視覺的理解,從粗略的實例級理解過渡到對圖像的像素級細粒度理解,從而實現視覺區域定位(Regional Grounding)能力,如GLaMM、PixelLM、NExT-Chat和MiniGPT-v2等。另一方面,研究人員嘗試擴展MLLMs可以支援的視覺功能。部分研究已經開始研究讓MLLMs不僅理解輸入視覺訊號,還能支援生成輸出視覺內容。例如,GILL、Emu等MLLMs能夠靈活產生影像內容,以及GPT4Video和NExT-GPT實現視訊生成。

目前人工智慧社群已逐漸達成一致,認為視覺MLLMs的未來趨勢必然會朝著高度統一、能力更強的方向發展。然而,儘管社區開發了眾多的MLLMs,但仍然存在明顯的鴻溝。

- 首先,幾乎所有現有的視覺LLMs將圖像和視訊視為不同的實體,要么僅支援圖像,要么僅支援視訊。研究人員主張,視覺應該同時包含了靜態影像和動態影片兩個面向的內涵——這兩者都是視覺世界的核心組成,在大多數場景中甚至可以互換。所以,需要建構一個統一的MLLM框架能夠同時支援影像和視訊模態。

- 其次,目前MLLMs對視覺功能的支援仍有所不足。大多數模型僅能進行理解,或最多生成圖像或影片。研究人員認為,未來的MLLMs應該是一個通用大語言模型,能涵蓋更廣泛的視覺任務和操作範圍,實現對所有視覺相關任務的統一支持,達到「one for all」的能力。這一點對實際應用尤其是在經常涉及一系列迭代和互動操作的視覺創作中至關重要。例如,使用者通常首先從文字開始,透過文生圖,將一個想法轉化為視覺內容;然後透過進一步的細粒度圖像編輯來完善初始想法,添加更多細節;接著,透過圖像生成影片來創建動態內容;最後,進行幾輪迭代交互,如影片編輯,完善創作。

上表簡單地歸納了現有的視覺MLLM的能力(只代表性地囊括了部分模型,覆蓋不完整)。為了彌補這些差距,該團隊提出一種通用的像素級視覺MLLM—Vitron。

02. Vitron系統架構:三大關鍵模組

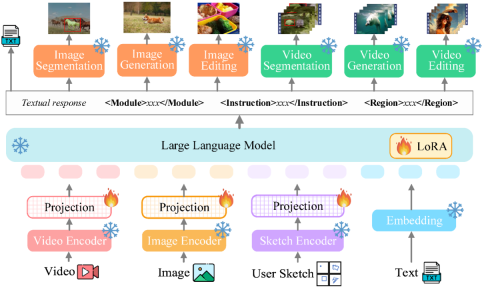

##Vitron整體框架如下圖所示。 Vitron採用了與現有相關MLLMs相似的架構,包括三個關鍵部分:1) 前端視覺&語言編碼模組,2) 中心LLM理解和文本生成模組,以及3) 後端用戶響應和模組調用以進行視覺操控模組。

- 前端模組:視覺語言編碼。為了感知影像和視訊模態訊號,並支援細粒度使用者視覺輸入,Vitron整合了影像編碼器、視訊編碼器、區域框架/草圖編碼器。

- 中心模組:核心LLM。 Vitron使用的是Vicuna(7B,1.5),來實現理解、推理、決策和多輪使用者互動。

- 後端模組:使用者回應與模組呼叫。 Vitron採用以文字為中心的呼叫策略,整合現成的幾個強大先進(SoTA)的圖像和視訊處理模組,用於解碼和執行從低層到高層的一系列視覺終端任務。透過採用以文字為中心的模組整合呼叫方法,Vitron不僅實現了系統統一,還確保了對齊效率和系統可擴展性。

03. Vitron模型訓練三大階段

基於上述架構,再對Vitron進行訓練微調,以賦予其強大的視覺理解和任務執行能力。模型訓練主要囊括三個不同的階段。- 步驟一:視覺-語言整體對齊學習。將輸入的視覺語言特徵映射到一個統一的特徵空間中,從而使其能夠有效理解輸入的多模態訊號。這是一種粗粒度的視覺-語言對齊學習,可以讓系統具有整體上有效處理傳入的視覺訊號。研究人員採用了現存的圖像-標題對(CC3M)、視訊-標題對(Webvid)和區域-標題對(RefCOCO)的資料集進行訓練。

- 步驟二:細粒度的時空視覺定位指令微調。系統採用了呼叫外部模組方式來執行各種像素級視覺任務,但LLM本身並未經過任何細粒度的視覺訓練,這將會阻礙了系統實現真正的像素級視覺理解。為此,研究人員提出了一種細粒度的時空視覺定位指令微調訓練,核心思想是使LLM能夠定位影像的細粒度空間性和視訊的具體時序特性。 步驟三:輸出端面向指令呼叫的指令微調。上述第二階段的訓練賦予了LLM和前端編碼器在像素層級理解視覺的能力。這最後一步,以指令呼叫為導向的指令微調,旨在讓系統具備精確執行指令的能力,讓LLM產生適當且正確的呼叫文字。由於不同的終端視覺任務可能需要不同的呼叫命令,為了統一這一點,研究人員提出將LLM的回應輸出標準化為結構化文字格式,其中包括:

1)使用者回應輸出,直接回覆用戶的輸入。

2)模組名稱,指示將要執行的功能或任務。

3)呼叫指令,觸發任務模組的元指令。

4)區域(可選輸出),指定某些任務所需的細粒度視覺特徵,例如在視訊追蹤或視覺編輯中,後端模組需要這些資訊。對於區域,基於LLM的像素級理解,將輸出由座標描述的邊界框。

04#. 評估實驗

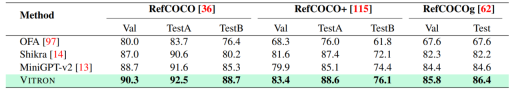

研究人員基於Vitron在22個常見的基準資料集、12個影像/影片視覺任務上進行了廣泛的實驗評估。 Vitron展現出在四大主要視覺任務群組(分割、理解、內容生成和編輯)中的強大能力,同時其具備靈活的人機互動能力。以下代表性地展示了一些定性比較結果:

- Vision Segmentation

#Results of image referring image segmentation

- Fine-grained Vision Understanding

##Results of image referring expression comprehension.

#Results on video QA.

- #Vision Generation

Vision Editing

##########Image editing results#######具體詳細實驗內容和細節請移步論文。 #########0######5######. ######。未來方向展望#########整體上,這項工作展現了研發大一統的視覺多模態通用大模型的巨大潛力,為下一代視覺大模型的研究奠定了一個新的形態,邁出了這個方向的第一步。儘管團隊所提出的Vitron系統表現出強大的通用能力,但仍存在自身的限制。以下研究人員列出一些未來可進一步探索的方向。 ###- 系統架構

Vitron系統仍採用半聯合、半代理的方式來呼叫外部工具。雖然這種基於呼叫的方法便於擴展和替換潛在模組,但這也意味著這種管線結構的後端模組不參與到前端與LLM核心模組的聯合學習。這項限制不利於系統的整體學習,這意味著不同視覺任務的表現上限將受到後端模組的限制。未來的工作應將各種視覺任務模組整合成一個統一的單元。實現對影像和視訊的統一理解和輸出,同時透過單一生成範式支援生成和編輯能力,仍然是一個挑戰。目前一個有希望的方式是結合modality-persistent的tokenization, 提升系統在不同輸入和輸出以及各種任務上的統一化。

- 使用者互動性

與先前專注於單一視覺任務的模型(例如,Stable Diffusion和SEEM)不同,Vitron旨在促進LLM和使用者之間的深度交互,類似於業界的OpenAI的DALL-E系列,Midjourney等。實現最佳的使用者互動性是本項工作的核心目標之一。 Vitron利用現有的基於語言的LLM,結合適當的指令調整,以實現一定程度的互動。例如,系統可以靈活地回應使用者輸入的任何預期訊息,產生相應的視覺操作結果,而不要求使用者輸入精確匹配後端模組條件。然而,該工作在增強互動性方面仍有很大的提升空間。例如,從閉源的Midjourney系統汲取靈感,不論LLM在每一步做出何種決定,系統都應積極向用戶提供回饋,以確保其行動和決策與用戶意圖一致。

模態能力

目前,Vitron整合了一個7B的Vicuna模型,其可能對其理解語言、圖像和影片的能力會產生某些限制。未來的探索方向可以發展一個全面的端到端系統,例如擴大模型的規模,以實現對視覺的更徹底和全面的理解。此外,應該努力使LLM能夠完全統一影像和視訊模態的理解。

以上是顏水成掛帥,崑崙萬維2050全球研究院聯合NUS、NTU發表Vitron,奠定通用視覺多模態大模型終極形態的詳細內容。更多資訊請關注PHP中文網其他相關文章!

AI太空公司誕生了May 12, 2025 am 11:07 AM

AI太空公司誕生了May 12, 2025 am 11:07 AM本文展示了AI如何以Tomorrow.io為典型的例子來徹底改變空間行業。 與像SpaceX這樣的建立太空公司不同,SpaceX並非沒有AI的核心,明天是AI本地公司。 讓我們探索

印度的10個機器學習實習(2025)May 12, 2025 am 10:47 AM

印度的10個機器學習實習(2025)May 12, 2025 am 10:47 AM在印度(2025)登陸您夢想中的機器學習實習! 對於學生和早期職業專業人員來說,機器學習實習是一個有意義的職業的完美髮射台。 跨不同部門的印度公司 - 尖端的基因

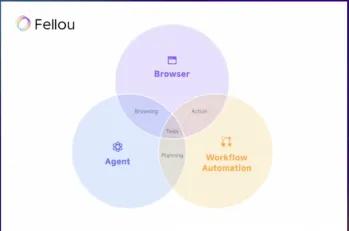

嘗試Fellou AI並向Google和Chatgpt說再見May 12, 2025 am 10:26 AM

嘗試Fellou AI並向Google和Chatgpt說再見May 12, 2025 am 10:26 AM在過去的一年中,在線瀏覽的景觀經歷了重大轉變。 這種轉變始於增強,個性化的搜索結果,例如困惑和副駕駛等平台,並隨著Chatgpt的整合而加速了

個人黑客將是一隻非常兇猛的熊May 11, 2025 am 11:09 AM

個人黑客將是一隻非常兇猛的熊May 11, 2025 am 11:09 AM網絡攻擊正在發展。 通用網絡釣魚電子郵件的日子已經一去不復返了。 網絡犯罪的未來是超個性化的,利用了容易獲得的在線數據和AI來製作高度針對性的攻擊。 想像一個知道您的工作的騙子

教皇獅子座XIV揭示了AI如何影響他的名字選擇May 11, 2025 am 11:07 AM

教皇獅子座XIV揭示了AI如何影響他的名字選擇May 11, 2025 am 11:07 AM新當選的教皇獅子座(Leo Xiv)在對紅衣主教學院的就職演講中,討論了他的同名人物教皇里奧XIII的影響,他的教皇(1878-1903)與汽車和汽車和汽車公司的黎明相吻合

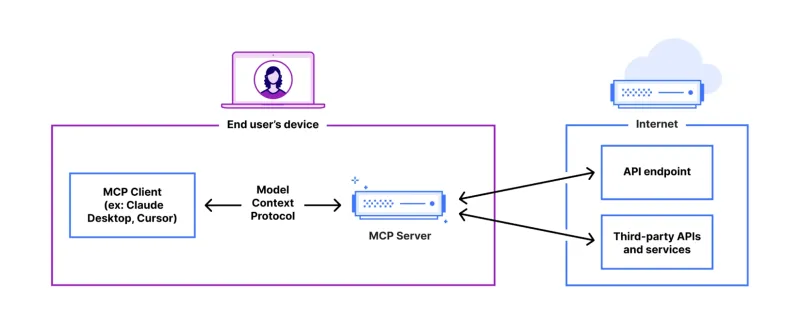

Fastapi -MCP初學者和專家教程-Analytics VidhyaMay 11, 2025 am 10:56 AM

Fastapi -MCP初學者和專家教程-Analytics VidhyaMay 11, 2025 am 10:56 AM本教程演示瞭如何使用模型上下文協議(MCP)和FastAPI將大型語言模型(LLM)與外部工具集成在一起。 我們將使用FastAPI構建一個簡單的Web應用程序,並將其轉換為MCP服務器,使您的L

dia-1.6b tts:最佳文本到二元格生成模型 - 分析vidhyaMay 11, 2025 am 10:27 AM

dia-1.6b tts:最佳文本到二元格生成模型 - 分析vidhyaMay 11, 2025 am 10:27 AM探索DIA-1.6B:由兩個本科生開發的開創性的文本對語音模型,零資金! 這個16億個參數模型產生了非常現實的語音,包括諸如笑聲和打噴嚏之類的非語言提示。本文指南

AI可以使指導比以往任何時候都更有意義May 10, 2025 am 11:17 AM

AI可以使指導比以往任何時候都更有意義May 10, 2025 am 11:17 AM我完全同意。 我的成功與導師的指導密不可分。 他們的見解,尤其是關於業務管理,構成了我的信念和實踐的基石。 這種經驗強調了我對導師的承諾

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

Safe Exam Browser

Safe Exam Browser是一個安全的瀏覽器環境,安全地進行線上考試。該軟體將任何電腦變成一個安全的工作站。它控制對任何實用工具的訪問,並防止學生使用未經授權的資源。

Atom編輯器mac版下載

最受歡迎的的開源編輯器

SublimeText3漢化版

中文版,非常好用

WebStorm Mac版

好用的JavaScript開發工具

Dreamweaver Mac版

視覺化網頁開發工具