筆者個人理解

自動駕駛的基礎任務之一是三維目標偵測,而現在許多方法都是基於多感測器融合的方法實現的。那為什麼要進行多感測器融合?無論是光達和相機融合,又或者是毫米波雷達和相機融合,其最主要的目的就是利用點雲和影像之間的互補聯繫,從而提高目標檢測的準確度。隨著Transformer架構在電腦視覺領域的不斷應用,基於注意力機制的方法提高了多感測器之間融合的精確度。分享的兩篇論文便是基於此架構,提出了新穎的融合方式,以更大程度地利用各自模態的有用信息,實現更好的融合。

TransFusion:

主要貢獻

雷射雷達和相機是自動駕駛中兩個重要的三維目標偵測感測器,但是在感測器融合上,主要面臨影像條紋條件差導致檢測精度較低的問題。基於點的融合方法是將雷射雷達和相機透過硬關聯(hard association)進行融合,會導致一些問題:a)簡單地拼接點雲和影像特徵,在低品質的影像特徵下,檢測性能會嚴重下降;b)尋找稀疏點雲和影像的硬關聯會浪費高品質的影像特徵,同時難以對齊。 為了解決這個問題,提出了一種軟體關聯(soft association)方法。此方法將雷射雷達和相機作為兩個獨立的偵測器,相互協作,充分利用兩個偵測器的優點。首先,透過傳統的目標偵測器來偵測物件並產生邊緣框(bounding box),然後將邊緣框和點雲匹配,得到每個點與哪個邊緣框相關聯的分數。最後,將邊緣框對應的影像特徵與點雲生成的特徵進行融合。這種方法可以有效地避免影像條紋條件差導致的偵測精度下降,同時

此論文介紹了一種雷射雷達和相機的融合框架TransFusion,來解決兩種感測器之間的關聯問題。主要貢獻如下:

- 提出一種基於transformer的雷射雷達和相機的3D偵測融合模型,對較差的影像品質和感測器未對齊表現出優異的穩健性;

- 為物件查詢引入了幾個簡單而有效的調整,以提高圖像融合的初始邊界框預測的質量,還設計了一個圖像引導查詢初始化模組來處理在點雲中難以檢測到的對象;

- 不僅在nuScenes實現了先進的三維檢測性能,還將模型擴展到三維追蹤任務,並取得了不錯的成果。

模組詳解

#圖1 TransFusion的整體框架

為了解決上述的圖片條目差以及不同感測器之間的關聯問題,提出了一個基於Transformer的融合框架—TransFusion。此模型依賴標準3D和2D主幹網路來提取LiDAR BEV特徵和影像特徵,然後用兩層Transformer解碼器組成:第一層解碼器利用稀疏的點雲產生初始邊界框;第二層解碼器將第一層的物件查詢與影像特徵查詢相結合,以獲得更好的檢測結果。其中也引入了空間調製注意力機制(SMCA)和影像引導的查詢策略來提高檢測準確性。透過此模型的檢測,可以獲得更好的影像特徵和檢測精度。

Query Initialization(查詢初始化)

LiDAR-Camera Fusion

如果當一個物體只包含少量的光達點時,那麼只能獲得相同數量的圖像特徵,浪費了高品質的圖像語義資訊。所以論文保留所有的影像特徵,使用Transformer中交叉注意機制和自適應的方式進行特徵融合,使網路能夠自適應地從影像中提取位置和資訊。為了緩解LiDAR BEV特徵和圖像特徵來自不同的感測器的空間不對齊問題,設計了一個空間調製交叉注意模組(SMCA),該模組通過圍繞每個查詢投影的二維中心的二維圓形高斯掩模對交叉注意進行加權。

Image-Guided Query Initialization(映像引導查詢初始化)

圖2 映像引導查詢模組

此模組同時利用雷射雷達和影像資訊作為物件查詢,就是透過將影像特徵和光達BEV特徵送入交叉關注機製網絡,投射到BEV平面上,產生融合的BEV特徵。具體如圖2所示,首先沿著高度軸折疊多視圖影像特徵作為交叉注意機製網絡的鍵值,而雷射雷達BEV特徵作為查詢送入註意力網絡,得到融合的BEV特徵,使用進行熱圖預測,並與僅雷射雷達的熱圖Ŝ做平均得到最終的熱圖Ŝ來選擇和初始化目標查詢。這樣的操作使得模型能夠偵測到在雷射雷達點雲中難以偵測到的目標。

實驗

資料集和指標

#nuScenes資料集是一個用於3D偵測和追蹤的大規模自動駕駛資料集,包含700、150和150個場景,分別用於訓練、驗證和測試。每幀包含一個雷射測距儀點雲和六個覆蓋360度水平視場的校準影像。對於3D檢測,主要指標是平均平均精確度(mAP)和nuScenes檢測分數(NDS)。 mAP是由BEV中心距離而不是3D IoU定義的,最終mAP是透過對10個類別的0.5m, 1m, 2m, 4m的距離閾值進行平均來計算的。 NDS是mAP和其他屬性測量的綜合量測,包括平移、比例、方向、速度和其他方框屬性。 。

Waymo資料集包括798個用於訓練的場景和202個用於驗證的場景。官方的指標是mAP和mAPH (mAP以航向精度加權)。 mAP和mAPH是基於3D IoU閾值定義的,車輛為0.7,行人和騎自行車者為0.5。這些指標進一步分解為兩個難度等級:LEVEL1用於超過5個雷射雷達點的邊界框,LEVEL2用於至少有一個雷射測距儀點的邊界框。與nuScenes的360度攝影機不同,Waymo的攝影機只能覆蓋水平方向的250度左右。

訓練 在nuScenes資料集上,使用DLA34作為影像的2D骨幹網路並凍結其權重,將影像大小設定為448×800;選擇VoxelNet作為雷射雷達的3D骨幹網路。訓練過程分成兩個階段:第一階段僅以雷射雷達資料作為輸入,以第一層解碼器和FFN前饋網路訓練3D骨幹20次,產生初始的3D邊界框預測;第二階段對LiDAR-Camera融合和影像引導查詢初始化模組進行6次訓練。左圖是用於初始邊界框預測的transformer解碼器層架構;右圖是用於LiDAR-Camera融合的transformer解碼器層架構。

圖3 解碼器層設計

#與最先進方法比較

首先比較TransFusion和其他SOTA方法在3D目標檢測任務的效能,如下表1所示的是在nuScenes測試集中的結果,可以看到該方法已經達到了當時的最佳性能(mAP為68.9%,NDS為71.7%)。而TransFusion-L是僅使用雷射雷達進行檢測的,其檢測的性能明顯優於先前的單模態檢測方法,甚於超過了一些多模態的方法,這主要是由於新的關聯機制和查詢初始化策略。而在表2中則是展示了在Waymo驗證集上LEVEL 2 mAPH的結果。

表1 與SOTA方法在nuScenes測試中的比較

表2 Waymo驗證集上的LEVEL 2 mAPH

對惡劣影像條件的穩健性

以TransFusion-L為基準,設計不同的融合框架來驗證穩健性。其中三種融合框架分別是逐點拼接融合雷射雷達和影像特徵(CC)、點增強融合策略(PA)和TransFusion。如表3中顯示,將nuScenes資料集劃分成白天和黑夜,TransFusion的方法在夜間將會帶來更大的效能提升。在推理過程中將影像的特徵設為零,以達到在每一幀隨機丟棄若干影像的效果,那麼在表4中可以看到,在推理過程中某些影像不可用時,偵測的效能會顯著下降,其中CC和PA的mAP分別下降23.8%和17.2%,而TransFusion仍維持在61.7%。感測器未校準的情況也會大大影響3D目標偵測的性能,實驗設定從相機到雷射雷達的變換矩陣中隨機添加平移偏移量,如圖4所示,當兩個感測器偏離1m時,TransFusion的mAP僅下降0.49%,而PA和CC的mAP分別下降2.33%和2.85%。

表3 白天和夜間的mAP

表4 在不同數量的影像下的mAP

消融實驗

由表5 d)-f)的結果可看出,在沒有進行查詢初始化的情況下,偵測的效能下降很多,雖然增加訓練輪數和解碼器層數可以提高效能,但是仍舊達不到理想效果,這也從側面證明了所提出來的初始化查詢策略能夠減小網路層數。而如表6所示,影像特徵融合和影像引導查詢初始化分別帶來4.8%和1.6%的mAP增益。在表7中,透過在不同範圍內精度的比較,TransFusion與僅雷射雷達的偵測相比,在難以偵測的物體或遙遠區域的偵測的性能都得到了提升。

#結論

設計了一個有效且穩健的基於Transformer的雷射雷達相機3D檢測框架,該框架具有軟關聯機制,可自適應地確定應該從影像中獲取的位置和資訊。 TransFusion在nuScenes檢測和追蹤排行榜上達到最新的最先進的結果,並在Waymo檢測基準上顯示了具有競爭力的結果。大量的消融實驗證明了該方法對較差影像條件的穩健性。DeepInteraction:

主要貢獻:

主要解決的問題是現有的多模態融合策略忽略了特定於模態的有用信息,最終阻礙了模型的性能。點雲在低解析度下提供必要的定位和幾何訊息,影像在高解析度下提供豐富的外觀信息,因此跨模態的信息融合對於增強3D目標目標偵測效能尤為重要。現有的融合模組如圖1(a)所示,將兩個模態的資訊整合到一個統一的網路空間中,但是這樣做會使得部分資訊無法融合到統一的表示裡,降低了一部分特定於模態的表示優勢。為了克服上述限制,文章提出了一種新的模態互動模組(圖1(b)),其關鍵思想是學習並維護兩種特定於模態的表示,從而實現模態間的交互作用。主要貢獻如下:- 提出了一種新的多模態三維目標檢測的模態交互策略,旨在解決以前模態融合策略在每個模態中丟失有用資訊的基本限制;

- 設計了一個帶有多模態特徵交互編碼器和多模態特徵預測交互解碼器的DeepInteraction架構。

#模組詳解

多模態表徵交互編碼器 將編碼器定制為多輸入多輸出(MIMO)結構:將雷射雷達和相機主幹獨立提取的兩個模態特定場景資訊作為輸入,並產生兩個增強的特徵資訊。每一層編碼器都包括:i)多模態特徵交互作用(MMRI);ii)模態內特徵學習;iii)表徵整合。

#

#

#圖3 多模態預測互動模組

實驗

資料集和指標同TransFusion的nuScenes資料集部分。

實驗細節 影像的主幹網路是ResNet50,為了節省運算成本,在輸入網路之前將輸入影像重新調整為原始大小的1/2,並在訓練時凍結影像分支的權重。體素大小設定為(0.075m,0.075m,0.2m),偵測範圍設為X軸和Y軸是[-54m,54m],Z軸是[-5m,3m],設計2層編碼器層和5層級聯的解碼器層。另外也設定了兩種線上提交測試模型:測試時間增加(TTA)和模型集成,將兩個設定分別稱為DeepInteraction-large和DeepInteraction-e。其中DeepInteraction-large使用Swin-Tiny作為圖像骨幹網絡,並且將雷射雷達骨幹網路中捲積塊的通道數量增加一倍,體素大小設定為[0.5m,0.5m,0.2m],使用雙向翻轉和旋轉偏航角度[0°,±6.25°,±12.5°]以增加測試時間。 DeepInteraction-e整合了多個DeepInteraction-large模型,輸入的雷射雷達BEV網格尺寸為[0.5m,0.5m]和[1.5m,1.5m]。

依據TransFusion的配置進行資料增強:使用範圍為[-π/4,π/4]的隨機旋轉,隨機縮放係數為[0.9,1.1],標準差為0.5的三軸隨機平移和隨機水平翻轉,也使用CBGS中類平衡重採樣來平衡nuScenes的類別分佈。和TransFusion一樣採用兩階段訓練的方法,以TransFusion-L作為僅雷射雷達訓練的基線。使用單週期學習率策略的Adam優化器,最大學習率1×10−3,權衰減0.01,動量0.85 ~ 0.95,遵循CBGS。光達基線訓練為20輪,光達影像融合為6輪,批量大小為16個,使用8個NVIDIA V100 GPU進行訓練。

與最先進方法比較

#表1 在nuScenes測試集上與最先進方法的比較

如表1所示,DeepInteraction在所有設定下都實現了最先進的效能。而在表2中分別比較了在NVIDIA V100、A6000和A100上測試的推理速度。可以看到,在取得高性能的前提下,仍舊保持著較高的推理速度,驗證了該方法在檢測性能和推理速度之間實現了優越權衡。

表2 推理速度比較

消融實驗

##解碼器的消融實驗

在表3(a)中比較了多模態互動預測解碼器和DETR解碼器層的設計,並且使用了混合設計:使用普通的DETR解碼器層來聚合雷射雷達表示中的特徵,使用多模態交互預測解碼器(MMPI)來聚合影像表示中的特徵(第二行)。 MMPI明顯優於DETR,提高了1.3% mAP和1.0% NDS,具有設計上的組合彈性。表3(c)進一步探討了不同的解碼器層數對於偵測效能的影響,可以發現增加到5層解碼器時效能是不斷提升的。最後也比較了訓練和測試時採用的查詢數的不同組合,在不同的選擇下,性能上穩定的,但以200/300作為訓練/測試的最佳設定。

#編碼器的消融實驗##從表4(a )中可以觀察到:(1)與IML相比,多模態表徵交互編碼器(MMRI)可以顯著提高性能;(2) MMRI和IML可以很好地協同工作以進一步提高性能。從表4(b)可以看出,堆疊編碼器層用於迭代MMRI是有益的。

表4 編碼器的消融實驗

光達骨幹網路的消融實驗

使用兩種不同的激光雷達骨幹網路:PointPillar和VoxelNet來檢查框架的一般性。對於PointPillars,將體素大小設定為(0.2m, 0.2m),同時保持與DeepInteraction-base相同的其餘設定。由於提出的多模態交互策略,DeepInteraction在使用任何一種骨幹網時都比僅使用lidar基線表現出一致的改進(基於體素的骨幹網提高5.5% mAP,基於支柱的骨幹網提高4.4% mAP )。這反映了DeepInteraction在不同點雲編碼器中的通用性。

表5不同雷射雷達主幹網的評估

#結論

在這項工作中,提出了一種新的3D目標偵測方法DeepInteraction,用於探索固有的多模態互補性質。這個關鍵思想是維持兩種特定於模態的表徵,並在它們之間建立表徵學習和預測解碼的相互作用。該策略是專門為解決現有單側融合方法的基本限製而設計的,即由於其輔助源角色處理,圖像表示未充分利用。

兩篇論文的總結:

以上的兩篇論文都是基於雷射雷達和相機融合的三維目標檢測,從DeepInteraction中也可以看到它是藉鑒了TransFusion的進一步工作。從這兩篇論文中可以總結出多感測器融合的一個方向,就是探究更有效率的動態融合方式,以關注更多不同模態的有效資訊。當然了,這一切建立在兩種模態都有高品質的資訊。多模態融合在未來的自動駕駛、智慧機器人等領域都會有很重要的應用,隨著不同模態擷取的資訊逐漸豐富起來,我們能夠利用到的資訊將會越來越多,那麼如何將這些數據更有效率的運用起來也是一個值得思考的問題。

以上是如何利用transformer有效關聯雷射雷達-毫米波雷達-視覺特徵?的詳細內容。更多資訊請關注PHP中文網其他相關文章!

如何使用Monsterapi微調大語言模型Apr 19, 2025 am 10:49 AM

如何使用Monsterapi微調大語言模型Apr 19, 2025 am 10:49 AM利用微調LLM的功能與Monsterapi:綜合指南 想像一個虛擬助手完美理解並預測您的需求。 由於大型語言模型(LLMS)的進步,這已成為現實。 但是,

5統計測試每個數據科學家都應該知道-Analytics VidhyaApr 19, 2025 am 10:27 AM

5統計測試每個數據科學家都應該知道-Analytics VidhyaApr 19, 2025 am 10:27 AM數據科學的基本統計測試:綜合指南 從數據中解鎖有價值的見解至關重要。 掌握統計測試對於實現這一目標至關重要。這些測試使數據科學家能夠嚴格瓦爾

如何使用Florence -2 -Analytics Vidhya執行計算機視覺任務Apr 19, 2025 am 10:21 AM

如何使用Florence -2 -Analytics Vidhya執行計算機視覺任務Apr 19, 2025 am 10:21 AM介紹 原始變壓器的引入為當前的大語言模型鋪平了道路。同樣,在引入變壓器模型之後,引入了視覺變壓器(VIT)。喜歡

使用Langchain Text Splitters -Analytics Vidhya拆分數據的7種方法Apr 19, 2025 am 10:11 AM

使用Langchain Text Splitters -Analytics Vidhya拆分數據的7種方法Apr 19, 2025 am 10:11 AMLangchain文本拆分器:優化LLM輸入以提高效率和準確性 我們上一篇文章介紹了Langchain的文檔加載程序。 但是,LLM具有上下文窗口大小的限制(以代幣測量)。 超過此限制會截斷數據,comp

免費生成的AI課程:開創創新的未來Apr 19, 2025 am 10:01 AM

免費生成的AI課程:開創創新的未來Apr 19, 2025 am 10:01 AM生成的AI:革命性的創造力和創新 生成的AI通過按下按鈕來創建文本,圖像,音樂和虛擬世界來改變行業。 它的影響跨越視頻編輯,音樂製作,藝術,娛樂,HEA

使用通用句子編碼器和Wikiqa創建QA模型Apr 19, 2025 am 10:00 AM

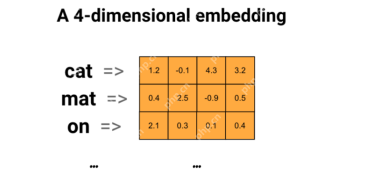

使用通用句子編碼器和Wikiqa創建QA模型Apr 19, 2025 am 10:00 AM利用嵌入模型的力量來回答高級問題 在當今信息豐富的世界中,立即獲得精確答案的能力至關重要。 本文展示了使用強大的提問(QA)模型

前十名必須閱讀機器學習研究論文Apr 19, 2025 am 09:53 AM

前十名必須閱讀機器學習研究論文Apr 19, 2025 am 09:53 AM本文探討了十個徹底改變人工智能(AI)和機器學習(ML)的開創性出版物。 我們將研究神經網絡和算法的最新突破,並解釋驅動現代AI的核心概念。 Th

替換SEO機構的11個AI工具 - 分析VidhyaApr 19, 2025 am 09:49 AM

替換SEO機構的11個AI工具 - 分析VidhyaApr 19, 2025 am 09:49 AMAI在SEO中的崛起:超過SEO代理商的前11個工具 AI的快速發展已深刻地重塑了SEO景觀。 旨在提高頂級搜索引擎排名的企業正在利用AI優化其在線策略的能力。 來自AU

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

Dreamweaver Mac版

視覺化網頁開發工具

記事本++7.3.1

好用且免費的程式碼編輯器

mPDF

mPDF是一個PHP庫,可以從UTF-8編碼的HTML產生PDF檔案。原作者Ian Back編寫mPDF以從他的網站上「即時」輸出PDF文件,並處理不同的語言。與原始腳本如HTML2FPDF相比,它的速度較慢,並且在使用Unicode字體時產生的檔案較大,但支援CSS樣式等,並進行了大量增強。支援幾乎所有語言,包括RTL(阿拉伯語和希伯來語)和CJK(中日韓)。支援嵌套的區塊級元素(如P、DIV),

Safe Exam Browser

Safe Exam Browser是一個安全的瀏覽器環境,安全地進行線上考試。該軟體將任何電腦變成一個安全的工作站。它控制對任何實用工具的訪問,並防止學生使用未經授權的資源。

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。