模型|https://www.php.cn/link/36ef259d4d9967f3a81aa326160128c7

論文| https://www.php.cn/link/ca0525bfe5cab4c577d169d3343a5452

#1、閃電般的圖片生成

生成式AI 正憑藉其根據文字提示(text prompts)創造出驚艷圖像乃至影片的能力,贏得全球的矚目。目前最先進的生成模型依賴擴散過程(diffusion),這是一個將雜訊逐步轉換為影像樣本的迭代過程。這個過程需要耗費龐大的運算資源且速度較慢,在產生高品質影像樣本的過程中,單張影像的處理時間約為5 秒,其中通常需要多次(20 到40 次)呼叫龐大的神經網路。這樣的速度限制了有快速、即時產生需求的應用場景。 如何在提升生成品質的同時加快速度,是目前研究的熱點領域,也是我們工作的核心目標。

SDXL-Lightning 透過創新技術——漸進式對抗蒸餾(Progressive Adversarial Distillation)——突破了這一障礙,實現了前所未有的生成速度。該模型能夠在短短 2 步或 4 步內產生極高品質和解析度的影像,將計算成本和時間降低十倍。我們的方法甚至可以在 1 步驟內為超時敏感的應用程式產生影像,雖然可能會稍微犧牲一些品質。

SDXL-Lightning 不僅具有速度優勢,而且在影像品質方面表現出色,在評估中超越了先前的加速技術。它能夠實現更高的解析度和更豐富的細節,同時保持良好的多樣性和圖文匹配度。

速度比較示意

# 原始模型(20 步驟),SDXL-Lightning 模型(2 步驟)

2、模型效果

SDXL-Lightning 模型可以透過1 步、2 步、4 步和8 步來生成圖像。推理步驟越多,影像品質越好。

以下是4 步驟產生結果-

A girl smiling

A pickup truck going up a mountain switchback

#A fish on a bicycle, colorful art

A close-up of an Asian lady with sunglasses

A beautiful cup

Mona Lisa, sketch

##A panda swimming

House in the desert, surreal landscapes

以下是 2 步生成结果——

Furniture design for a living room

A cinematic shot of a baby raccoon wearing an intricate Italian priest robe

A dog with soft fur and bright eyes jumping after a toy, in a cozy living room

A tea cup containing clouds

A family, medium shot

Baby playing with toys in the snow

An old man and a dog are walking in the park

Dragon driving a car

A monkey making latte art

与以前的方法(Turbo 和 LCM)相比,我们的方法生成的图像在细节上有显著改进,并且更忠实于原始生成模型的风格和布局。

3、回馈社区,开放模型

开源开放的浪潮已经成为推动人工智能迅猛发展的关键力量,字节跳动也自豪地成为这股浪潮的一部分。我们的模型基于目前最流行的文字生成图像开放模型 SDXL,该模型已经拥有一个繁荣的生态系统。现在,我们决定将 SDXL-Lightning 开放给全球的开发者、研究人员和创意从业者,以便他们能访问并运用这一模型,进一步推动整个行业的创新和协作。

在设计 SDXL-Lightning 时,我们就考虑到与开放模型社区的兼容。社区中已有众多艺术家和开发者创建了各种各样的风格化图像生成模型,例如卡通和动漫风格等。为了支持这些模型,我们提供 SDXL-Lightning 作为一个增速插件,它可以无缝地整合到这些多样风格的 SDXL 模型中,为各种不同模型加快图像生成的速度。

SDXL-Lightning 模型也可以和目前非常流行的控制插件 ControlNet 相结合,实现极速可控的图片生成。

SDXL-Lightning 模型也支持开源社区里目前最流行的生成软件 ComfyUI,模型可以被直接加载来使用:

4、關於技術細節

#從理論上來說,影像生成是一個由雜訊到清晰影像的逐步轉換過程。在這過程中,神經網路學習在這個轉換流(flow)中各個位置上的梯度。

產生影像的具體步驟是這樣的:

首先我們在流的起點,隨機取樣一個雜訊樣本,接著用神經網路計算出梯度。根據目前位置上的梯度,我們對樣本進行微小的調整,然後不斷重複這個過程。每一次迭代,樣本都會更接近最終的影像分佈,直到獲得一張清晰的影像。

圖:生成流##https://www .php.cn/link/5c9b5c47258cf1499c2dc64b7072e735

由於生成流複雜且非直線,生成過程必須一次只走一小步以減少梯度誤差累積,所以需要神經網路的頻繁計算,這就是計算量大的原因。

圖:曲線流程(圖片來自:# https://www.php.cn/link/d7bbb6396ce5daf19ec6cf4bb4453137

為了減少生成影像所需的步驟數量,許多研究致力於尋找解決方案。一些研究提出了減少誤差的採樣方法,而其他研究則試圖使生成流更加直線化。儘管這些方法有所進展,但它們仍然需要超過10 個推理步驟來生成圖像。

另一種方法是模型蒸餾,它能夠在少於10 個推理步驟的情況下產生高品質影像。不同於計算當前流位置下的梯度,模型蒸餾改變模型預測的目標,直接讓其預測下一個更遠的流位置。具體來說,我們訓練一個學生網路直接預測老師網路完成了多步驟推理後的結果。這樣的策略可以大幅減少所需的推理步驟數量。透過反覆應用這個過程,我們可以進一步降低推理步驟的數量。這種方法被先前的研究稱之為漸進式蒸餾。

圖:漸進式蒸餾,學生網路預測老師網路多步驟後的結果

在實際操作中,學生網路往往難以精確預測未來的流位置。誤差隨著每一步的累積而放大,導致在少於8 步推理的情況下,模型產生的圖像開始變得模糊不清。

為了解決這個問題,我們的策略是不強求學生網路精確匹配教師網路的預測,而是讓學生網路在機率分佈上與教師網路保持一致。換言之,學生網路被訓練來預測一個機率上可能的位置,即使這個位置並不完全準確,我們也不會對它進行懲罰。這個目標是透過對抗訓練來實現的,引入了一個額外的判別網路來幫助實現學生網路和教師網路輸出的分佈匹配。這是我們研究方法的簡要概述。在技術論文(https://www.php.cn/link /ca0525bfe5cab4c577d169d3343a5452

)中,我們提供了更深入的理論分析、訓練策略以及模型的具體公式化細節。

5、SDXL-Lightning 之外

儘管本研究主要探討瞭如何利用SDXL-Lightning 技術進行圖像生成,但我們所提出的漸進式對抗蒸餾方法的應用潛力不局限於靜態影像的範疇。這項創新技術也可以被運用於快速且高品質產生視訊、音訊以及其他多模態內容。我們誠摯邀請您在 HuggingFace 平台上體驗 SDXL-Lightning,並期待您寶貴的意見和回饋。 模型:https://www.php.cn/link/36ef259d4d9967f3a81aa326160128c7

#######以上是1024 解析度下最快模型,位元組跳動文生圖開放模型 SDXL-Lightning 發布的詳細內容。更多資訊請關注PHP中文網其他相關文章!

什麼是模型上下文協議(MCP)?Mar 03, 2025 pm 07:09 PM

什麼是模型上下文協議(MCP)?Mar 03, 2025 pm 07:09 PM模型上下文協議(MCP):AI和數據的通用連接器,我們都熟悉AI在日常編碼中的作用。 REPLIT,GitHub副詞,黑匣子AI和光標IDE只是AI如何簡化我們的工作流程的幾個示例。 但是想像一下

使用OmniparSer V2和Omnitool建立本地視覺代理Mar 03, 2025 pm 07:08 PM

使用OmniparSer V2和Omnitool建立本地視覺代理Mar 03, 2025 pm 07:08 PMMicrosoft的OmniparSer V2和Omnitool:用AI Imagion AI徹底改變了GUI自動化,不僅可以理解,而且還與您的Windows 11界面互動,例如經驗豐富的專業人員。 Microsoft的OmniparSer V2和Omnitool使它成為RE

我嘗試了使用光標AI編碼的Vibe編碼,這太神奇了!Mar 20, 2025 pm 03:34 PM

我嘗試了使用光標AI編碼的Vibe編碼,這太神奇了!Mar 20, 2025 pm 03:34 PMVibe編碼通過讓我們使用自然語言而不是無盡的代碼行創建應用程序來重塑軟件開發的世界。受Andrej Karpathy等有遠見的人的啟發,這種創新的方法使Dev

補充代理:帶有實際示例的指南Mar 04, 2025 am 10:52 AM

補充代理:帶有實際示例的指南Mar 04, 2025 am 10:52 AM革命性應用程序開發:深入研究厭倦了使用複雜開發環境和晦澀的配置文件搏鬥的代理人? Replit Agent旨在簡化將想法轉換為功能應用程序的過程。 這個AI-P

跑道Act-One指南:我拍攝了自己的測試Mar 03, 2025 am 09:42 AM

跑道Act-One指南:我拍攝了自己的測試Mar 03, 2025 am 09:42 AM這篇博客文章分享了我測試跑道ML的新ACT ONE動畫工具的經驗,涵蓋其Web界面和Python API。雖然有希望,但我的結果比預期的不那麼令人印象深刻。 想探索生成的AI嗎? 在P中學習使用LLM

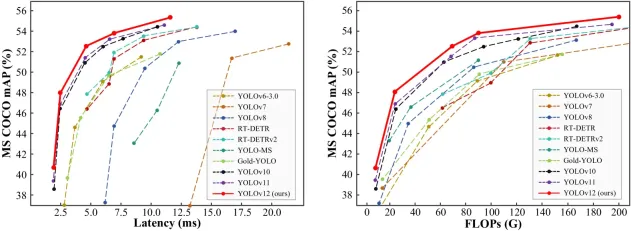

如何使用Yolo V12進行對象檢測?Mar 22, 2025 am 11:07 AM

如何使用Yolo V12進行對象檢測?Mar 22, 2025 am 11:07 AMYolo(您只看一次)一直是領先的實時對象檢測框架,每次迭代都在以前的版本上改善。最新版本Yolo V12引入了進步,可顯著提高準確性

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!Mar 22, 2025 am 10:58 AM

2025年2月的Genai推出前5名:GPT-4.5,Grok-3等!Mar 22, 2025 am 10:58 AM2025年2月,Generative AI又是一個改變遊戲規則的月份,為我們帶來了一些最令人期待的模型升級和開創性的新功能。從Xai的Grok 3和Anthropic的Claude 3.7十四行詩到Openai的G

Elon Musk&Sam Altman衝突超過5000億美元的星際之門項目Mar 08, 2025 am 11:15 AM

Elon Musk&Sam Altman衝突超過5000億美元的星際之門項目Mar 08, 2025 am 11:15 AM這項耗資5000億美元的星際之門AI項目由OpenAI,Softbank,Oracle和Nvidia等科技巨頭支持,並得到美國政府的支持,旨在鞏固美國AI的領導力。 這項雄心勃勃

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

Dreamweaver CS6

視覺化網頁開發工具

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。

Safe Exam Browser

Safe Exam Browser是一個安全的瀏覽器環境,安全地進行線上考試。該軟體將任何電腦變成一個安全的工作站。它控制對任何實用工具的訪問,並防止學生使用未經授權的資源。

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

mPDF

mPDF是一個PHP庫,可以從UTF-8編碼的HTML產生PDF檔案。原作者Ian Back編寫mPDF以從他的網站上「即時」輸出PDF文件,並處理不同的語言。與原始腳本如HTML2FPDF相比,它的速度較慢,並且在使用Unicode字體時產生的檔案較大,但支援CSS樣式等,並進行了大量增強。支援幾乎所有語言,包括RTL(阿拉伯語和希伯來語)和CJK(中日韓)。支援嵌套的區塊級元素(如P、DIV),