近期,AI 視訊技術領域備受關注,尤其是OpenAI推出的Sora視訊生成大模型引起了廣泛討論。同時,在影片剪輯領域,Agent等大型AI模型也展現出強大的實力。

儘管自然語言被用於處理影片剪輯任務,使用者可以直接表達意圖而無需手動操作。然而,目前大多數影片剪輯工具仍然需要大量手動操作,並且缺乏個人化的上下文支援。這導致用戶需要自行解決複雜的視訊剪輯問題。

關鍵在於如何設計一個可以充當協作者、並在剪輯過程中不斷協助使用者的影片剪輯工具?在本文中,來自多倫多大學、 Meta(Reality Labs Research)、加州大學聖迭戈分校的研究者提出利用大語言模型(LLM)的多功能語言能力來進行視頻剪輯,並探討了未來的視頻剪輯範式,從而減少與手動視訊剪輯過程的阻礙。

- 論文標題:LAVE: LLM-Powered Agent Assistance and Language Augmentation for Video Editing

- #論文網址:https://arxiv.org/pdf/2402.10294.pdf

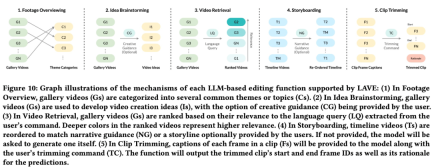

#研究者開發了一個名為LAVE的影片剪輯工具,它整合了LLM提供的多項語言增強功能。 LAVE引入了一個基於LLM的智慧規劃和執行系統,能夠解釋使用者的自由格式語言指令,規劃並執行相關操作,以達成使用者的影片剪輯目標。這個智慧系統能夠提供概念化幫助,如創意腦力激盪和影片素材概覽,並提供操作協助,包括基於語意的影片檢索、分鏡和剪輯修剪等功能。

為了順利進行這些智能體的操作,LAVE 使用了視覺語言模型(VLM)來自動產生影片視覺效果的語言描述。這些視覺敘述使得LLM能夠理解影片內容,並利用他們的語言能力來協助使用者完成剪輯。此外,LAVE 提供了兩種互動視訊剪輯模式,即智能體協助和直接操作。這種雙重模式為使用者提供了更大的靈活性,讓他們可以根據需要改進智能體的操作。

至於 LAVE 的剪輯效果如何?研究者對包括剪輯新手和老手在內的 8 名參與者進行了用戶研究,結果表明,參與者可以使用 LAVE 製作出令人滿意的 AI 協作影片。

值得關注的是,這項研究的六位作者中有5 位華人,包括一作、多倫多大學電腦科學博士生Bryan Wang、Meta 研究科學家Yuliang Li、Zhaoyang Lv和Yan Xu、加州大學聖迭戈分校助理教授Haijun Xia。

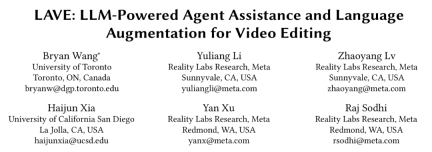

LAVE 使用者介面(UI)

我們先來看 LAVE 的系統設計,具體如下圖 1 所示。

LAVE 的使用者介麵包含三個主要元件,分別如下:

- 語言增強影片庫,顯示帶有自動生成的語言描述的影片片段;

- 影片剪輯時間軸,包括用於剪輯的主時間軸;

- 影片剪輯智能體,使用戶與一個會話智能體進行互動並獲得幫助。

設計邏輯是這樣的:當使用者與智慧體互動時,訊息交換會在聊天 UI 中顯示。當進行相關操作時,智能體會對影片庫和剪輯時間軸進行變更。此外,使用者可以使用遊標直接對影片庫和時間軸進行操作,類似於傳統的剪輯介面。

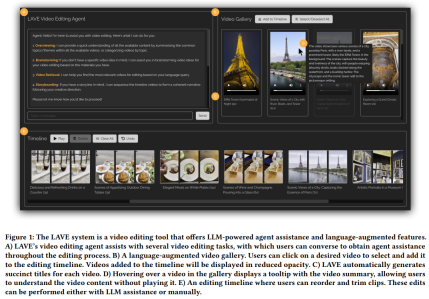

語言增強影片庫

語言增強影片庫的功能如下圖3 所示。

與傳統工具一樣,該功能允許剪輯播放,但會提供視覺敘述,即為每個影片自動產生文字描述,包括語義標題和摘要。這些標題可以幫助理解和索引剪輯,摘要提供了每個剪輯的視覺內容的概述,幫助使用者形成自身編輯專案的故事情節。每個影片下方都會顯示標題和時長。

此外,LAVE 使用戶可以利用語義語言查詢來搜尋視頻,檢索到的影片會在影片庫中顯示並按相關性排序。這項功能必須透過剪輯智能體來執行。

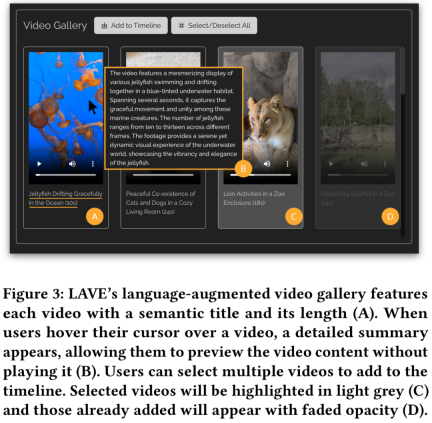

影片剪輯時間軸

#從影片庫中選取影片並將它新增至剪輯時間軸後,它們會顯示在介面底部的影片剪輯時間軸上,如下圖2 所示。其中,時間軸上的每個剪輯都由一個框表示,並顯示三個縮圖幀,分別是開始幀、中間幀和結束幀。

在 LAVE 系統中,每個縮圖幀代表剪輯中一秒鐘的素材。與影片庫一樣,每個剪輯的標題和描述都會提供。 LAVE 中的剪輯時間軸具有兩個關鍵功能,即剪輯排序和修剪。

其中在時間軸上進行剪輯排序是影片剪輯中的常見任務,對於創建連貫的敘述非常重要。 LAVE 支援兩種排序方法,一是基於 LLM 的排序利用視訊剪輯智能體的故事板功能進行操作,二是手動排序透過使用者直接操作來排序,拖放每個視訊框來設定剪輯出現的順序。

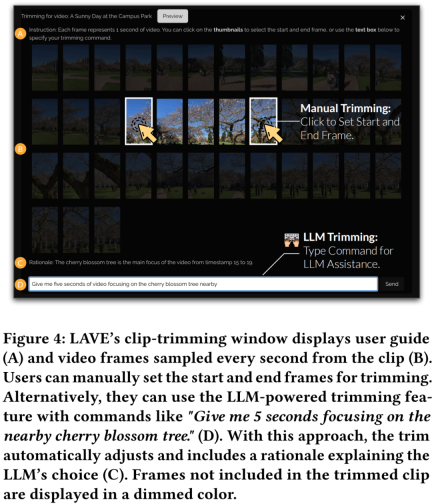

修剪在影片剪輯中也很重要,可以突出顯示關鍵片段並刪除多餘內容。在修剪時,使用者雙擊時間軸中的剪輯,打開一個顯示一秒鐘幀的彈出窗口,如下圖 4 所示。

影片剪輯智慧體

LAVE的視訊剪輯智能體是一個基於聊天的元件,可促進使用者和基於LLM 的智能體之間的互動。與命令列工具不同,使用者可以使用自由格式的語言與智慧體互動。此智能體利用 LLM 的語言智慧提供影片剪輯輔助,並提供具體的回應,以在整個編輯過程中指導和幫助使用者。 LAVE 的智能體協助功能是透過智能體操作提供的,每個智能體操作都涉及執行系統支援的編輯功能。

總的來說,LAVE 提供的功能涵蓋了從構思和預先規劃到實際編輯作業的整個工作流程,但該系統並沒有強制規定嚴格的工作流程。使用者可以靈活地利用與其編輯目標相符的功能子集。例如,具有清晰編輯願景和明確故事情節的使用者可能會繞過構思階段並直接投入編輯。

後端系統

該研究採用OpenAI 的GPT-4 來闡述LAVE 後端系統的設計,主要包括智能體設計、實作由LLM 驅動的編輯功能兩個面向。

智能體設計

#該研究利用LLM(即GPT-4)的多種語言能力(包括推理、規劃和說故事)建構了LAVE 智能體。

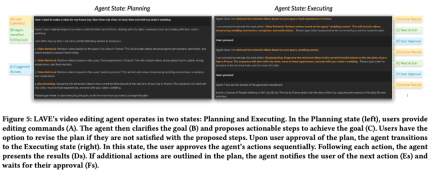

LAVE 智能體有兩種狀態:規劃與執行。這種設定有兩個主要好處:

- 允許使用者設定包含多個操作的高級目標,因此無需像傳統命令列工具那樣詳細說明每個單獨的操作。

- 在執行前,智能體會將規劃呈現給用戶,提供修改的機會並確保使用者可以完全控制智能體的操作。研究團隊設計了一個後端 pipeline 來完成規劃和執行流程。

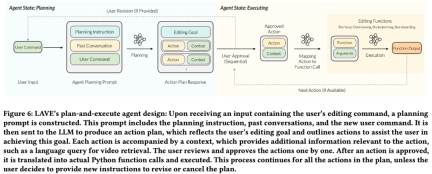

如下圖 6 所示,該 pipeline 首先根據使用者輸入建立行動規劃。然後,該規劃從文字描述轉換為函數調用,隨後執行相應的函數。

實作LLM 驅動的編輯功能

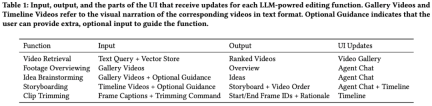

為了幫助用戶完成視頻編輯任務,LAVE 主要支援五種由LLM 驅動的功能,包括:

- 素材概述

- 創意腦力激盪

- 影片檢索

- 故事板

- 剪輯修剪

#其中前四個可透過智慧體存取(圖5),而剪輯修剪功能可透過雙擊時間軸中的剪輯,開啟一個顯示一秒幀的彈出視窗(圖4)。

其中,基於語言的視訊檢索是透過向量儲存資料庫實現的,其餘的則透過 LLM 提示工程(prompt engineering)來實現。所有功能都建立在自動產生的原始素材語言描述之上,包括影片庫中每個剪輯的標題和摘要(圖 3)。研究團隊將這些影片的文字描述稱為視覺敘述(visual narration)。

有興趣的讀者可以閱讀論文原文,了解更多研究內容。

以上是在Sora引爆影片生成時,Meta開始用Agent自動剪影片了,華人作者主導的詳細內容。更多資訊請關注PHP中文網其他相關文章!

什麼是Alteryx? |分析VidhyaApr 15, 2025 am 11:03 AM

什麼是Alteryx? |分析VidhyaApr 15, 2025 am 11:03 AMAlteryx:您的多合一數據分析解決方案 想像一下,僅使用統計數據作為線索來解決一個複雜的謎團。 數據專業人士每天面臨類似的挑戰。 Alteryx是解決方案,使用戶能夠征服數據複雜性。

Llama 3.1 vs Llama 3:哪個更好?Apr 15, 2025 am 10:53 AM

Llama 3.1 vs Llama 3:哪個更好?Apr 15, 2025 am 10:53 AMMeta的Llama 3.1 70b和Llama 3 70b:詳細的比較 Meta最近發布了Llama 3.1,包括70B參數模型,以及較大和較小的變體。 此次升級是在三個月前的Llama 3發布之後發布的。而駱駝3.1

您可以免費開始的7個AI PPT製造商!Apr 15, 2025 am 10:51 AM

您可以免費開始的7個AI PPT製造商!Apr 15, 2025 am 10:51 AM釋放您的演示文稿能力:7個免費的AI驅動PowerPoint Maker 無論您是製作傑出的頂峰項目的最後一年學生還是忙碌的專業雜耍會議和演講,給人留下深刻的印像都是至關重要的。

什麼是Power BI語義模型?Apr 15, 2025 am 10:46 AM

什麼是Power BI語義模型?Apr 15, 2025 am 10:46 AM介紹 想像一個場景:您的團隊被來自不同來源的大量數據集所淹沒。 整合,分類和分析此信息以進行有意義的演示是一個挑戰。這是Power BI語義模型(PBISM)EX

如何使用Llama索引和Monsterapi建立AI代理Apr 15, 2025 am 10:44 AM

如何使用Llama索引和Monsterapi建立AI代理Apr 15, 2025 am 10:44 AMAI特工:由Llamaindex和Monsterapi提供支持的AI的未來 AI代理有望徹底改變我們與技術的互動方式。 這些自主系統模仿人類行為,執行需要推理,決策和REA的任務

在沒有人類干預的情況下訓練LLM的7種方法Apr 15, 2025 am 10:38 AM

在沒有人類干預的情況下訓練LLM的7種方法Apr 15, 2025 am 10:38 AM解鎖自治AI:自我訓練LLMS的7種方法 想像一個未來AI系統在沒有人類干預的情況下學習和發展的未來,就像孩子獨立掌握複雜概念的孩子一樣。這不是科幻小說;這是自我的應許

通過AI和NLG進行財務報告 - 分析VidhyaApr 15, 2025 am 10:35 AM

通過AI和NLG進行財務報告 - 分析VidhyaApr 15, 2025 am 10:35 AMAI驅動的財務報告:通過自然語言產生革新見解 在當今動態的業務環境中,準確及時的財務分析對於戰略決策至關重要。 傳統財務報告

這款Google DeepMind機器人會在2028年奧運會上演奏嗎?Apr 15, 2025 am 10:16 AM

這款Google DeepMind機器人會在2028年奧運會上演奏嗎?Apr 15, 2025 am 10:16 AMGoogle DeepMind的乒乓球機器人:體育和機器人技術的新時代 巴黎2024年奧運會可能已經結束,但是由於Google DeepMind,運動和機器人技術的新時代正在興起。 他們的開創性研究(“實現人類水平的競爭

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

SublimeText3 Linux新版

SublimeText3 Linux最新版

Dreamweaver CS6

視覺化網頁開發工具

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中