GPT-4,自發布以來被視為全球最強大的語言模型之一,但也不幸經歷了一系列的信任危機。

如果我們將今年早些時候的"間歇式降智"事件與OpenAI對GPT-4架構的重新設計聯繫起來,那麼最近有關GPT-4變得"懶惰"的傳聞就更加有趣了。有人測試發現,只要告訴GPT-4"現在是寒假",它就會變得懶洋洋的,彷彿進入了冬眠狀態。

要解決模型在新任務上的零樣本表現變差的問題,我們可以採取以下方法: 1. 資料增強:透過對現有資料進行擴充和變換,來增加模型的泛化能力。例如,可以透過旋轉、縮放、平移等方式改變影像數據,或透過合成新的資料樣本。 2. 遷移學習:利用已經在其他任務上訓練好的模型,將其參數和知識遷移到新任務。這樣可以利用已有的知識和經驗,提

最近,來自加州大學聖克魯斯分校的研究人員在一篇論文中發布了一項新的發現,可能能夠解釋GPT-4性能下降的深層原因。

「我們發現,在訓練資料建立日期之前發布的資料集上,LLM 的表現出奇地好於之後發布的資料集。」

它們在「見過的」任務上表現出色,而在新任務上則表現糟糕。這意味著,LLM 只是基於近似檢索的模仿智慧方法,主要是記憶東西,而沒有任何程度的理解。

說穿了,就是 LLM 的泛化能力「沒說的那麼強」-- 基礎不紮實,實戰總有出紕漏的時候。

造成這種結果的一大原因是「任務污染」,這是資料污染的其中一種形式。我們先前熟知的資料污染是測試資料污染,即在預訓練資料中包含測試資料範例和標籤。而「任務污染」則是在預訓練資料中加入任務訓練範例,使零樣本或少樣本方法中的評估不再真實有效。

研究者在論文中首次對資料污染問題進行了系統分析:

論文連結:https://arxiv.org/pdf/2312.16337.pdf

看完論文,有人「悲觀」地表示:

#這是所有不具備持續學習能力的機器學習(ML)模型的命運,即ML 模型權重在訓練後會被凍結,但輸入分佈會不斷變化,如果模型無法持續適應這種變化,就會慢慢退化。

這意味著,隨著程式語言的不斷更新,基於 LLM 的編碼工具也會退化。這就是為什麼你不必過度依賴這種脆弱工具的原因之一。

不斷重新訓練這些模型的成本很高,遲早有人會放棄這些低效率的方法。

目前還沒有任何 ML 模型能夠可靠地持續適應不斷變化的輸入分佈,而不會對先前的編碼任務造成嚴重干擾或效能損失。

而這正是生物神經網路所擅長的領域之一。由於生物神經網具有強大的泛化能力,學習不同的任務可以進一步提高系統的性能,因為從一項任務中獲得的知識有助於改善整個學習過程本身,這就是所謂的「元學習」。

「任務污染」的問題有多嚴重?我們一起來看下論文內容。

模型與資料集

實驗所使用的模型有12 個(如表1 所示),其中5 個是專有的GPT-3 系列模型,7 個是可免費取得權重的開放模型。

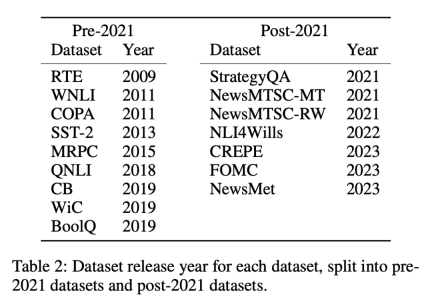

#資料集分為兩類:2021 年1 月1 日之前或之後發布的資料集,研究者使用這種劃分方法來分析舊資料集與新資料集之間的零樣本或少樣本表現差異,並對所有LLM 採用相同的劃分方法。表 1 列出了每個模型訓練資料的建立時間,表 2 列出了每個資料集的發布日期。

上述做法的考慮是,零樣本和少樣本評估涉及模型對其在訓練期間從未見過或僅見過幾次的任務進行預測,其關鍵前提是模型事先沒有接觸過要完成的特定任務,從而確保對其學習能力進行公平的評估。然而,受污染的模型會給人一種未接觸或僅接觸過幾次的能力的假象,因為它們在預訓練期間已經接受過任務示例的訓練。在按時間順序排列的資料集中,檢測這種不一致性會相對容易一些,因為任何重疊或異常都會很明顯。

測量方法

研究者採用了四種方法來測量「任務污染」:

- #訓練資料檢查:在訓練資料中搜尋任務訓練範例。

- 任務範例擷取:從現有模型中擷取任務範例。只有經過指令調優的模型才能進行擷取,這種分析也可用於訓練資料或測試資料的擷取。注意,為了檢測任務污染,提取的任務範例不必與現有的訓練資料範例完全匹配。任何演示任務的範例都表明零樣本學習和少樣本學習可能存在污染。

- 成員推理:此方法僅適用於生成任務。檢查輸入實例的模型產生內容是否與原始資料集完全相同。如果完全匹配,就可以推斷它是 LLM 訓練資料中的一員。這與任務範例提取不同,因為產生的輸出會被檢查是否完全匹配。開放式生成任務的精確匹配強烈表明模型在訓練過程中見過這些範例,除非模型「通靈」,知道資料中使用的確切措辭。 (注意,這只能用於生成任務。)

- 時序分析:對於在已知時間範圍內收集訓練資料的模型集,在已知發布日期的資料集上測量其效能,並使用時序證據檢查污染證據。

前三種方法精確度高,但召回率低。如果能在任務的訓練數據中找到數據,那麼就能確定模型曾經看過範例。但由於資料格式的變化、用於定義任務的關鍵字的變化以及資料集的大小,使用前三種方法找不到污染證據並不能證明沒有污染。

第四種方法,以時間順序分析的召回率高,但精確度低。如果由於任務污染而導致表現較高,那麼按時間順序分析就有很大機會發現它。但隨著時間的推移,其他因素也可能導致效能提高,因此精確度較低。

因此,研究者採用了所有四種方法來檢測任務污染,發現了在某些模型和資料集組合中存在任務污染的有力證據。

他們首先對所有測試過的模型和資料集進行時序分析,因為它最有可能發現可能的污染;然後使用訓練資料檢查和任務範例提取尋找任務污染的進一步證據;接下來觀察了LLM 在無污染任務中的表現,最後使用成員推理攻擊進行額外分析。

重點結論如下:

1、研究者對每個模型在其訓練資料在網路上抓取之前所建立的資料集和之後創建的資料集進行了分析。結果發現,對於在收集 LLM 訓練資料之前創建的資料集,其效能高於大多數基線的幾率明顯更高(圖 1)。

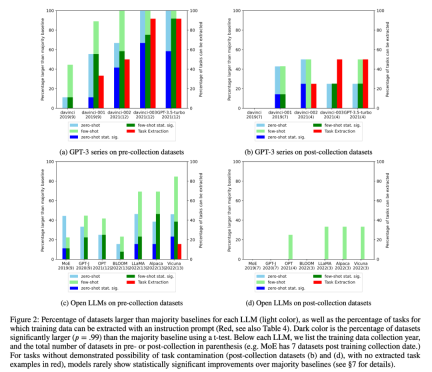

2、研究者進行了訓練資料檢查和任務範例提取,以查找可能存在的任務污染。結果發現,對於不可能存在任務污染的分類任務,在一系列任務中,模型很少比簡單多數基線有統計意義上的顯著提高,無論是零樣本還是少樣本(圖 2)。

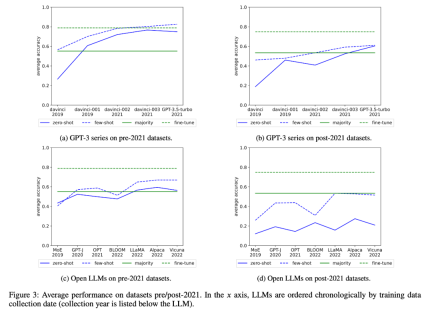

研究者也檢視了GPT-3 系列和開放式LLM 的平均表現隨時間的變化,如圖3 :

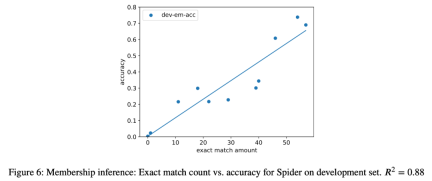

3、作為案例研究,研究者也嘗試對分析中的所有模型進行語義解析任務的成員推理攻擊,發現在最終任務中,提取實例的數量與模型的準確性之間存在很強的相關性(R=.88)(圖6)。這有力地證明了在這項任務中零樣本表現的提高是由於任務污染造成的。

4、研究者也仔細研究了GPT-3 系列模型,發現可以從GPT-3 模型中提取訓練範例,而且從davinci 到GPT-3.5-turbo 的每個版本中,可提取的訓練範例數量都在增加,這與GPT-3 模型在該任務上零樣本表現的提升密切相關(圖2)。這有力地證明了從 davinci 到 GPT-3.5-turbo 的 GPT-3 模型在這些任務上的表現提高是由於任務污染造成的。

以上是GPT-4的智慧水準下降的新詮釋的詳細內容。更多資訊請關注PHP中文網其他相關文章!

商業領袖生成引擎優化指南(GEO)May 03, 2025 am 11:14 AM

商業領袖生成引擎優化指南(GEO)May 03, 2025 am 11:14 AMGoogle正在領導這一轉變。它的“ AI概述”功能已經為10億用戶提供服務,在任何人單擊鏈接之前提供完整的答案。 [^2] 其他球員也正在迅速獲得地面。 Chatgpt,Microsoft Copilot和PE

該初創公司正在使用AI代理來與惡意廣告和模仿帳戶進行戰鬥May 03, 2025 am 11:13 AM

該初創公司正在使用AI代理來與惡意廣告和模仿帳戶進行戰鬥May 03, 2025 am 11:13 AM2022年,他創立了社會工程防禦初創公司Doppel,以此做到這一點。隨著網絡犯罪分子越來越高級的AI模型來渦輪增壓,Doppel的AI系統幫助企業對其進行了大規模的對抗 - 更快,更快,

世界模型如何從根本上重塑生成AI和LLM的未來May 03, 2025 am 11:12 AM

世界模型如何從根本上重塑生成AI和LLM的未來May 03, 2025 am 11:12 AM瞧,通過與合適的世界模型進行交互,可以實質上提高生成的AI和LLM。 讓我們來談談。 對創新AI突破的這種分析是我正在進行的《福布斯》列的最新覆蓋範圍的一部分,包括

2050年五月:我們要慶祝什麼?May 03, 2025 am 11:11 AM

2050年五月:我們要慶祝什麼?May 03, 2025 am 11:11 AM勞動節2050年。全國范圍內的公園充滿了享受傳統燒烤的家庭,而懷舊遊行則穿過城市街道。然而,慶祝活動現在具有像博物館般的品質 - 歷史重演而不是紀念C

您從未聽說過的DeepFake探測器準確是98%May 03, 2025 am 11:10 AM

您從未聽說過的DeepFake探測器準確是98%May 03, 2025 am 11:10 AM為了幫助解決這一緊急且令人不安的趨勢,在2025年2月的TEM期刊上進行了同行評審的文章,提供了有關該技術深擊目前面對的最清晰,數據驅動的評估之一。 研究員

量子人才戰爭:隱藏的危機威脅技術的下一個邊界May 03, 2025 am 11:09 AM

量子人才戰爭:隱藏的危機威脅技術的下一個邊界May 03, 2025 am 11:09 AM從大大減少制定新藥所需的時間到創造更綠色的能源,企業將有巨大的機會打破新的地面。 不過,有一個很大的問題:嚴重缺乏技能的人

原型:這些細菌可以產生電力May 03, 2025 am 11:08 AM

原型:這些細菌可以產生電力May 03, 2025 am 11:08 AM幾年前,科學家發現某些類型的細菌似乎通過發電而不是吸收氧氣而呼吸,但是它們是如何做到的,這是一個謎。一項發表在“雜誌”雜誌上的新研究確定了這種情況的發生方式:Microb

AI和網絡安全:新政府的100天估算May 03, 2025 am 11:07 AM

AI和網絡安全:新政府的100天估算May 03, 2025 am 11:07 AM在本週的RSAC 2025會議上,Snyk舉辦了一個及時的小組,標題為“前100天:AI,政策和網絡安全如何碰撞”,其中包括全明星陣容:前CISA董事Jen Easterly;妮可·珀洛斯(Nicole Perlroth),前記者和帕特納(Partne)

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SublimeText3漢化版

中文版,非常好用

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。

MinGW - Minimalist GNU for Windows

這個專案正在遷移到osdn.net/projects/mingw的過程中,你可以繼續在那裡關注我們。 MinGW:GNU編譯器集合(GCC)的本機Windows移植版本,可自由分發的導入函式庫和用於建置本機Windows應用程式的頭檔;包括對MSVC執行時間的擴展,以支援C99功能。 MinGW的所有軟體都可以在64位元Windows平台上運作。

mPDF

mPDF是一個PHP庫,可以從UTF-8編碼的HTML產生PDF檔案。原作者Ian Back編寫mPDF以從他的網站上「即時」輸出PDF文件,並處理不同的語言。與原始腳本如HTML2FPDF相比,它的速度較慢,並且在使用Unicode字體時產生的檔案較大,但支援CSS樣式等,並進行了大量增強。支援幾乎所有語言,包括RTL(阿拉伯語和希伯來語)和CJK(中日韓)。支援嵌套的區塊級元素(如P、DIV),

Atom編輯器mac版下載

最受歡迎的的開源編輯器