JavaScript是一種廣泛應用於Web開發的程式語言,而WebSocket則是一種用於即時通訊的網路協定。結合二者的強大功能,我們可以打造一個高效率的即時影像處理系統。本文將介紹如何利用JavaScript和WebSocket來實作這個系統,並提供具體的程式碼範例。

首先,我們需要明確即時影像處理系統的需求和目標。假設我們有一個攝影機設備,可以擷取即時的影像資料。我們希望能夠將這些影像資料傳輸到伺服器端進行處理,並即時地將處理結果展示在使用者的瀏覽器上。因此,我們需要設計一個可以同時處理資料傳輸和影像處理的系統。

首先,我們需要建立一個WebSocket伺服器端,用於接收來自客戶端的影像數據,並進行處理。下面是一個用Node.js寫的簡單WebSocket伺服器端範例程式碼:

const WebSocket = require('ws');

const wss = new WebSocket.Server({ port: 8080 });

wss.on('connection', function connection(ws) {

console.log('New client connected');

ws.on('message', function incoming(message) {

// 在这里进行图像处理

const processedImage = processImage(message);

// 将处理后的图像数据发送给客户端

ws.send(processedImage);

});

ws.on('close', function() {

console.log('Client disconnected');

});

});

function processImage(image) {

// 在这里进行图像处理的具体逻辑

// ...

return processedImage;

}上述程式碼使用了Node.js的WebSocket函式庫來建立伺服器端的WebSocket。當有新的客戶端連線時,伺服器會列印相關訊息,並等待客戶端發送影像資料。一旦收到影像數據,伺服器會呼叫processImage函數進行處理,並將處理結果傳回給客戶端。

在客戶端的Web頁面中,我們需要編寫JavaScript程式碼,用於擷取影像資料並將其傳送給伺服器。以下是一個簡單的客戶端範例程式碼:

const socket = new WebSocket('ws://localhost:8080');

socket.onopen = function() {

console.log('Connected to server');

};

socket.onmessage = function(event) {

// 接收到服务器发送的图像数据时的回调函数

const processedImage = event.data;

// 在Web页面上展示处理后的图像数据

displayImage(processedImage);

};

function sendImage(imageData) {

// 发送图像数据给服务器

socket.send(imageData);

}

function displayImage(imageData) {

// 在Web页面上展示图像数据的具体逻辑

// ...

}在上述程式碼中,我們使用了瀏覽器內建的WebSocket API來建立WebSocket連接,並實作了相關的事件處理函數。當與伺服器連線成功時,會在控制台輸出相關資訊。當接收到伺服器傳送的影像資料時,會呼叫displayImage函數來展示處理後的影像資料。

此外,我們還需要在Web頁面中實現影像擷取的功能。可以使用HTML5提供的getUserMediaAPI來取得攝影機裝置的即時影像數據,並把它傳輸給伺服器。以下是一個簡單的影像擷取範例程式碼:

// 获取设备的媒体流

navigator.mediaDevices.getUserMedia({ video: true })

.then(function(stream) {

const video = document.querySelector('video');

const canvas = document.createElement('canvas');

const ctx = canvas.getContext('2d');

video.srcObject = stream;

video.play();

setInterval(function() {

// 将视频帧绘制到canvas上

ctx.drawImage(video, 0, 0, canvas.width, canvas.height);

// 获取canvas中的图像数据

const imageData = ctx.getImageData(0, 0, canvas.width, canvas.height);

// 将图像数据发送给服务器

sendImage(imageData);

}, 1000 / 10);

})

.catch(function(error) {

console.log('Error accessing media devices:', error);

});上述程式碼使用了getUserMediaAPI來取得裝置的媒體串流,並將其播放在一個HTML5的<video>元素上。然後,我們可以使用Canvas API將視訊幀繪製到一個Canvas元素上,並透過呼叫<code>getImageData函數來取得影像資料。最後,我們可以將圖像資料傳送給伺服器。

透過上述的程式碼範例,我們可以看到如何結合JavaScript和WebSocket來打造一個高效的即時影像處理系統。伺服器端的程式碼負責接收和處理影像數據,並將結果傳回客戶端,而客戶端的程式碼則負責擷取影像資料並展示處理結果。這種方式可以實現即時的影像處理,並能適用於各種不同的應用場景,如視訊監控、人臉辨識等。

要注意的是,上述程式碼僅提供了一個簡單的範例,實際應用中可能還需要考慮一些其他的因素,如資料壓縮、網路延遲和安全性等。然而,透過學習和理解上述範例程式碼,我們可以掌握利用JavaScript和WebSocket來建立即時影像處理系統的基本原理和方法,並能進一步優化和擴展實作。

以上是JavaScript與WebSocket:打造高效率的即時影像處理系統的詳細內容。更多資訊請關注PHP中文網其他相關文章!

Python vs. JavaScript:社區,圖書館和資源Apr 15, 2025 am 12:16 AM

Python vs. JavaScript:社區,圖書館和資源Apr 15, 2025 am 12:16 AMPython和JavaScript在社區、庫和資源方面的對比各有優劣。 1)Python社區友好,適合初學者,但前端開發資源不如JavaScript豐富。 2)Python在數據科學和機器學習庫方面強大,JavaScript則在前端開發庫和框架上更勝一籌。 3)兩者的學習資源都豐富,但Python適合從官方文檔開始,JavaScript則以MDNWebDocs為佳。選擇應基於項目需求和個人興趣。

從C/C到JavaScript:所有工作方式Apr 14, 2025 am 12:05 AM

從C/C到JavaScript:所有工作方式Apr 14, 2025 am 12:05 AM從C/C 轉向JavaScript需要適應動態類型、垃圾回收和異步編程等特點。 1)C/C 是靜態類型語言,需手動管理內存,而JavaScript是動態類型,垃圾回收自動處理。 2)C/C 需編譯成機器碼,JavaScript則為解釋型語言。 3)JavaScript引入閉包、原型鍊和Promise等概念,增強了靈活性和異步編程能力。

JavaScript引擎:比較實施Apr 13, 2025 am 12:05 AM

JavaScript引擎:比較實施Apr 13, 2025 am 12:05 AM不同JavaScript引擎在解析和執行JavaScript代碼時,效果會有所不同,因為每個引擎的實現原理和優化策略各有差異。 1.詞法分析:將源碼轉換為詞法單元。 2.語法分析:生成抽象語法樹。 3.優化和編譯:通過JIT編譯器生成機器碼。 4.執行:運行機器碼。 V8引擎通過即時編譯和隱藏類優化,SpiderMonkey使用類型推斷系統,導致在相同代碼上的性能表現不同。

超越瀏覽器:現實世界中的JavaScriptApr 12, 2025 am 12:06 AM

超越瀏覽器:現實世界中的JavaScriptApr 12, 2025 am 12:06 AMJavaScript在現實世界中的應用包括服務器端編程、移動應用開發和物聯網控制:1.通過Node.js實現服務器端編程,適用於高並發請求處理。 2.通過ReactNative進行移動應用開發,支持跨平台部署。 3.通過Johnny-Five庫用於物聯網設備控制,適用於硬件交互。

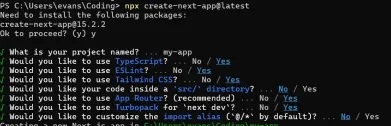

使用Next.js(後端集成)構建多租戶SaaS應用程序Apr 11, 2025 am 08:23 AM

使用Next.js(後端集成)構建多租戶SaaS應用程序Apr 11, 2025 am 08:23 AM我使用您的日常技術工具構建了功能性的多租戶SaaS應用程序(一個Edtech應用程序),您可以做同樣的事情。 首先,什麼是多租戶SaaS應用程序? 多租戶SaaS應用程序可讓您從唱歌中為多個客戶提供服務

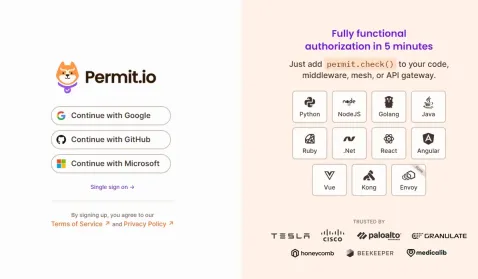

如何使用Next.js(前端集成)構建多租戶SaaS應用程序Apr 11, 2025 am 08:22 AM

如何使用Next.js(前端集成)構建多租戶SaaS應用程序Apr 11, 2025 am 08:22 AM本文展示了與許可證確保的後端的前端集成,並使用Next.js構建功能性Edtech SaaS應用程序。 前端獲取用戶權限以控制UI的可見性並確保API要求遵守角色庫

JavaScript:探索網絡語言的多功能性Apr 11, 2025 am 12:01 AM

JavaScript:探索網絡語言的多功能性Apr 11, 2025 am 12:01 AMJavaScript是現代Web開發的核心語言,因其多樣性和靈活性而廣泛應用。 1)前端開發:通過DOM操作和現代框架(如React、Vue.js、Angular)構建動態網頁和單頁面應用。 2)服務器端開發:Node.js利用非阻塞I/O模型處理高並發和實時應用。 3)移動和桌面應用開發:通過ReactNative和Electron實現跨平台開發,提高開發效率。

JavaScript的演變:當前的趨勢和未來前景Apr 10, 2025 am 09:33 AM

JavaScript的演變:當前的趨勢和未來前景Apr 10, 2025 am 09:33 AMJavaScript的最新趨勢包括TypeScript的崛起、現代框架和庫的流行以及WebAssembly的應用。未來前景涵蓋更強大的類型系統、服務器端JavaScript的發展、人工智能和機器學習的擴展以及物聯網和邊緣計算的潛力。

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

Safe Exam Browser

Safe Exam Browser是一個安全的瀏覽器環境,安全地進行線上考試。該軟體將任何電腦變成一個安全的工作站。它控制對任何實用工具的訪問,並防止學生使用未經授權的資源。

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

Dreamweaver Mac版

視覺化網頁開發工具

Dreamweaver CS6

視覺化網頁開發工具