麻省理工Andrew McAfee博士揭露了AI監管的全新方案

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-11-18 10:37:581419瀏覽

自從人工智慧誕生以來,對於如何監管人工智慧的討論從未間斷

但事實上,如何監管AI是一個非常複雜的議題,不同的國家和地區也有不同的監管政策和框架,如歐盟的《人工智慧法案》、美國的《人工智慧問責政策徵求意見》 、中國的《生成式人工智慧服務管理暫行辦法》等,對AI的定義、分類、風險分級、責任劃分等方面提出了一些規範與要求。

在最近舉行的2023年葡萄牙里斯本Web Summit峰會上,麻省理工學院斯隆管理學院的首席研究科學家安德魯·麥卡菲給我們帶來了一個全新的思路——"無需許可的創新" 。這個觀念與先前提出的許多關於人工智慧監管的方案形成了鮮明的對立

麻省理工學院的安德魯麥卡菲博士

「無許可證」真的不會帶來災難嗎?

在這場備受關注的演講中,他提到了兩個概念:上游治理和無需許可的創新。其中,上游治理意為在技術創新之前,就先對其可能帶來的風險和影響進行預防性的監管和控制

相反的是permissionless innovation,它指的是無需事先獲得政府或其他機構的許可,就可以自由地進行新技術和新商業模式的實驗和探索

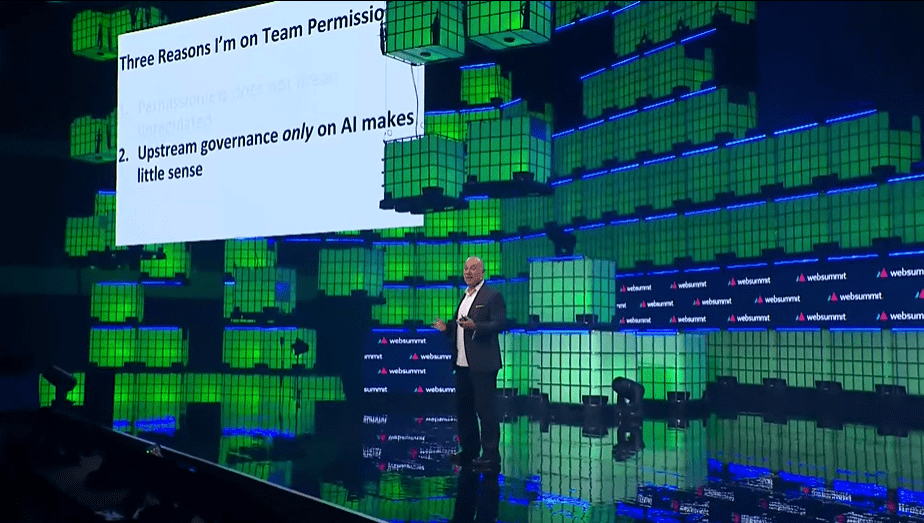

安德魯麥卡菲明確地支持自由創新,原因有三個面向:

首先,自由創新並不意味著沒有規範和監督。

安德魯認為,這個問題從根本上而言這是一個監管時機的問題,也就是不應該進行“預防性治理”,而應該有針對性地進行監管。例如以前有相機的智慧型手機剛興起的時候,有人用它來偷拍女性裙底,而當時由於手機相機還是個新鮮事物,法律並沒有相關的規定來保護女性權益。

後來,相關立法機構很快就推出了相關法律規定,並對技術發展後的使用進行了規範。換句話說,如果有人用菜刀傷人,應該加強管理,使菜刀更加安全,而不是透過法規使菜刀失去刀鋒

用我們常說的話而言就是:「發展的問題要用發展來解決」。 AI也是如此,我們應該做的是在AI發展過程中動態地解決中間出現的問題,不能因為發展AI可能產生的一些危險就止步不前,希望透過限制發展來避免危險,用安德魯的原話就是要“讓改錯更簡單”,而不是“保證不犯錯”,這樣才能使監管真正起到作用。

其次,安德魯認為我們可能高估了AI的危害。

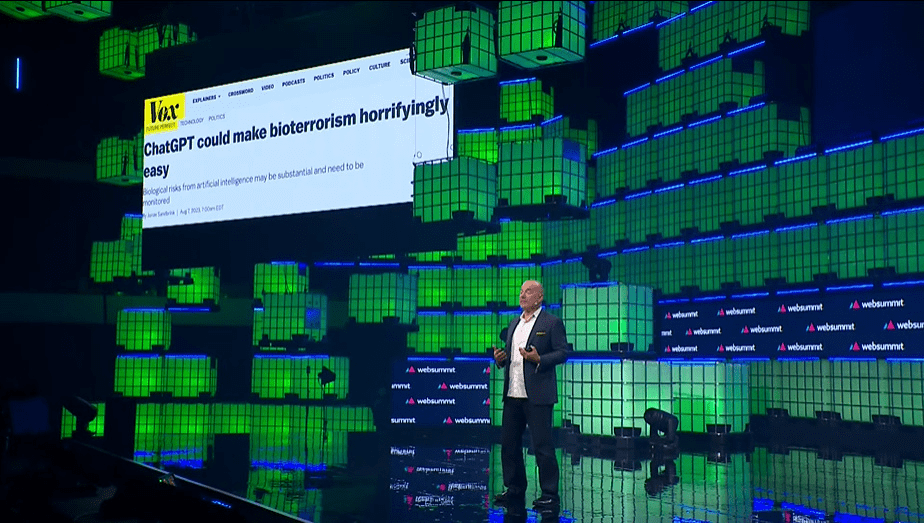

自AI誕生以來,各種關於AI將會帶來大災難的消息就一直沒有消失過,甚至還有很多人將其與核戰、大流行病等事物列在一起,認為AI是像「潘朵拉的魔盒」一樣的存在,達到了聳人聽聞的地步。

但安德魯博士認為我們可能過於專注於AI,而忽略了許多其他更危險的技術。例如生物技術,每個人都可以獲得相關的知識和設備,且不需要經過審核或許可。如果你在生物技術領域工作,你可以在無需審核或許可的情況下做很多事,這是一個不合理的平衡。

最後,也許是最重要的一個原因是,這種「無需許可的創新」可以激發創造力和想像力

我們有一個基本的常識,即創新是一種不可預測的、具有分散性的活動,這是它的核心屬性,我們很難預測未來的發展方向,尤其在當AI變得越來越強大的當下,未來發展的發展方向可能會越來越多地出現在我們沒有註意到的地方。

在演講開頭,他也提到了學習語言的軟體-多鄰國APP,認為這很能說明Permissionless innovation的優勢。這款APP利用了最新的AI技術,能夠更方便、快速、低成本地評估英語能力。但如果要求其在技術上市前就滿足一系列例如資料保護、演算法透明、人類監督等要求的做法,會限制創新的空間和速度,從而錯失創新的好機會。

Permissionless innovation不只應用在科技領域

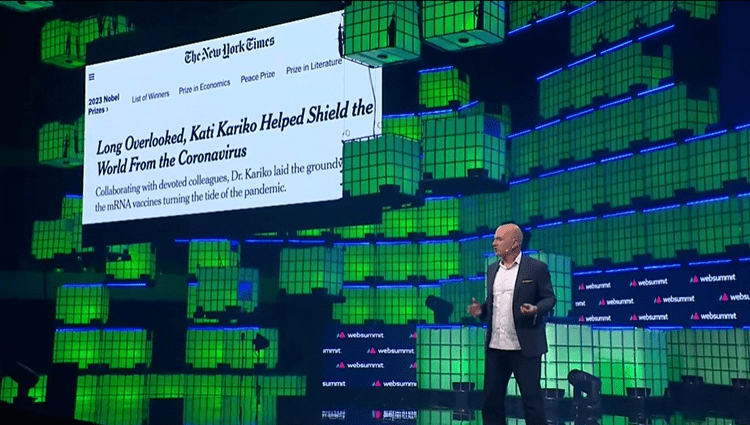

#實際上,這種無需許可的創新優勢不僅在人工智慧領域有所體現,在2023年的Web Summit演講中,安德魯還提到了兩個例子,分別是關於mRNA和邱吉爾的對話,向我們展示了無需許可的創新概念在其他領域的作用

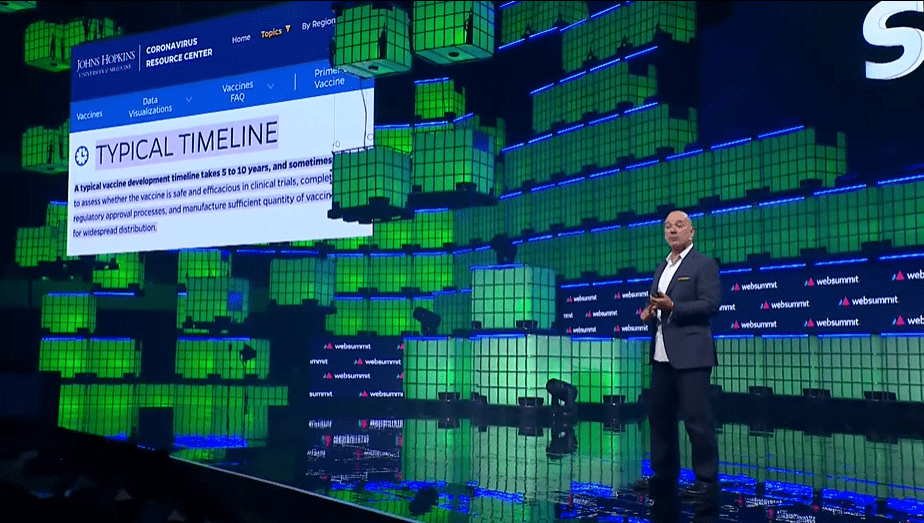

今年獲得諾貝爾醫學與生物學獎的卡塔林·卡里科(Katalin Kariko)曾離開學術界十年之久,mRNA研究方向在當時也普遍不被看好,這個時候如果有一個主張“前瞻性治理(upstream governance)」的力量介入進來,那麼mRNA方向的研究很有可能就會因為經費、項目等諸多原因而被「前瞻性地」廢棄掉,這無疑對於整個人類而言都是非常重大的損失。

實際上,"前瞻性治理"的基礎在於對未來的準確判斷。然而,顯然沒有人能夠預測哪個方向將會出現突破。如果判斷錯誤,就會失去許多出現優秀創新的機會,這正體現了無需許可的創新理念的重要性

另一個例子發生在1938年,此時正處於二戰爆發前夕,戰爭的陰影籠罩著歐洲,時任英國首相張伯倫在與希特勒接觸後簽訂了著名的「綏靖政策」代表作《慕尼黑協定》,認為可以透過與希特勒簽訂和平協議來換來和平。但在返回英國後,邱吉爾一語道破天機,打破了張伯倫以及當時很流行的綏靖主義風氣。

他說:「你認為你可以在戰爭和恥辱(指與納粹簽訂合約)之間做一個選擇,於是你選擇了恥辱,但戰爭仍然是不可避免的。」可以看出,Andrew先生認為AI帶來的危機可能不是「預防性治理」就可以避免的。換言之,擺在人類面前的並不是「加強微觀管理」和「混亂」兩個選擇,而是無論怎樣選擇,由AI帶來的混亂或許都難以避免。

當然,這個道理還有一個廣為人知的中國名字──捨本逐末。在人工智慧已成浪潮洶湧之勢的當下,或許積極著眼於怎樣面對新的浪潮才是更好的態度

以上是麻省理工Andrew McAfee博士揭露了AI監管的全新方案的詳細內容。更多資訊請關注PHP中文網其他相關文章!