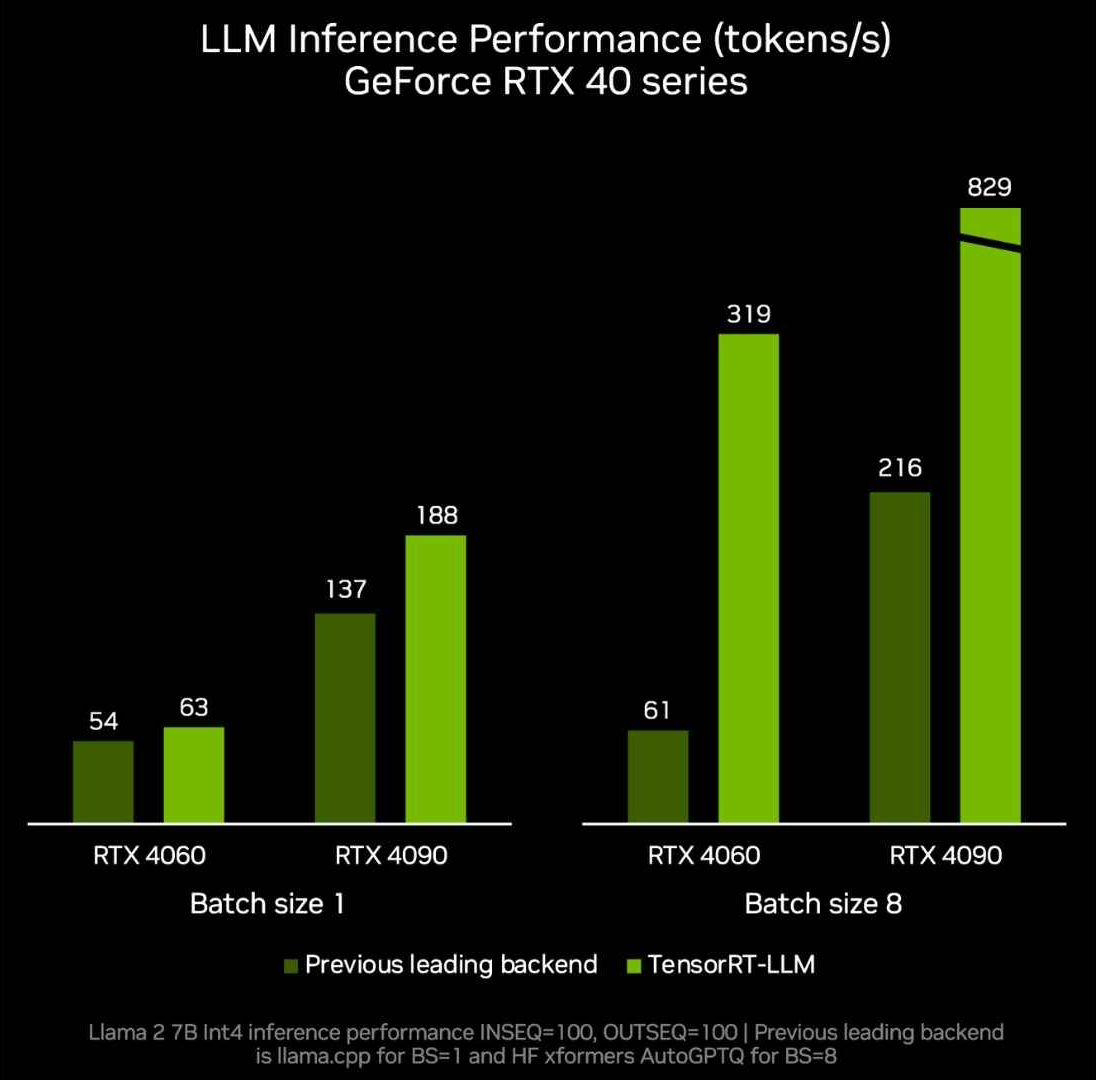

英偉達揭示新版 TensorRT-LLM:推理能力增長 5 倍,適用於 8GB 以上顯示卡本地運行,並支援 OpenAI 的 Chat API

- 王林轉載

- 2023-11-17 15:06:451266瀏覽

11 月 16 日消息,微軟 Ignite 2023 大會已於今天拉開帷幕,英偉達高管出席本次大會並宣布更新 TensorRT-LLM,添加了對 OpenAI Chat API 的支持。

英偉達在今年10月發布了Tensor RT-LLM開源程式庫,旨在為資料中心和Windows PC提供支援。這項開源程式庫的最大特色是,當Windows PC搭載英偉達的GeForce RTX GPU時,TensorRT-LLM能夠將LLM在Windows PC上的運行速度提高四倍

以上是英偉達揭示新版 TensorRT-LLM:推理能力增長 5 倍,適用於 8GB 以上顯示卡本地運行,並支援 OpenAI 的 Chat API的詳細內容。更多資訊請關注PHP中文網其他相關文章!

陳述:

本文轉載於:51cto.com。如有侵權,請聯絡admin@php.cn刪除