編輯 | 蘿蔔皮

在過去的幾個世紀中,研究人員一直在尋找將不同領域知識聯繫起來的方法。隨著人工智慧的出現,我們現在有機會去探索跨領域(例如力學和生物學)或不同領域(例如失效力學和藝術)之間的關係

為了達到這個目標,麻省理工學院(MIT)原子與分子力學實驗室(Laboratory for Atomistic and Molecular Mechanics,LAMM)的研究人員利用經過微調的大型語言模型(LLM)來獲得多尺度材料失效的相關知識分子集

這種方法的步驟是先使用通用的LLM從原始來源中提取問答對,然後再對LLM進行微調。利用這個微調後的MechGPT LLM基礎模型進行一系列計算實驗,以探索其在知識檢索、各種語言任務、假設生成以及跨不同領域連接知識方面的能力

儘管該模型具有一定的能力來回憶訓練中的知識,但研究人員發現LLM 對於透過本體知識圖提取結構見解更有意義。這些可解釋的圖形結構提供了解釋性見解、新研究問題的框架以及知識的視覺表示,這些知識也可用於檢索增強生成。

研究以「MechGPT, a Language-Based Strategy for Mechanics and Materials Modeling That Connects Knowledge Across Scales, Disciplines and Modalities」為題,於2023 年10 月19 日發佈在《Applied Mechanics Reviews》。

對物理、生物和形上學概念進行建模一直是許多學科研究人員關注的焦點。早期的科學家和工程師往往深深紮根於從科學到哲學、物理到數學以及藝術的多個領域(例如伽利略·伽利萊、列奧納多·達·芬奇、約翰·沃爾夫岡·馮·歌德),但是隨著科學的發展,專業化在如今已經佔據主導地位。部分原因是跨領域累積了大量知識,這需要人類花費大量的精力去研究實踐。

現在,大型語言模型(LLM)的出現對科學研究的典範提出了挑戰。它不僅帶來了基於人工智慧/機器學習的新建模策略,還為跨領域連接知識、想法和概念提供了機會。這些模型可以補充傳統的多尺度建模,用於分析和設計分層材料以及力學中的許多其他應用

圖:工作流程示意圖。 (資料來源:論文)

在這裡,LAMM 的研究人員以最近提出的LLM 在力學和材料研究和開發中的用途為基礎,並且基於Llama-2 based OpenOrca-Platypus2-13B 的通用LLM ,開發了一個經過微調的MechGPT 模型,該模型專注於模型材料失效、多尺度建模以及相關學科。

選擇OpenOrca-Platypus2-13B 模型的原因是因為它在推理、邏輯、數學/科學和其他學科等關鍵任務上表現出色,能夠以適中的模型大小提供豐富的、可應用於多學科的知識和通用概念,並且具備高效的計算能力

LLM 在科學領域有著強大的應用。除了能夠分析大量數據和複雜系統之外,在力學和材料科學領域,LLM 用於模擬和預測材料在不同條件下的行為,例如機械應力、溫度和化學相互作用等。如早期工作所示,透過在分子動力學模擬的大型資料集上訓練 LLM,研究人員可以開發能夠預測新情況下材料行為的模型,從而加速發現過程並減少實驗測試的需要。

此類模型對於分析書籍和出版物等科學文本也非常有效,使研究人員能夠從大量資料中快速提取關鍵資訊和見解。這可以幫助科學家識別趨勢、模式以及不同概念和想法之間的關係,並為進一步研究產生新的假設和想法。

請看下圖,這是用於建立MechGPT的自回歸解碼器transformer架構概述。 (來源:論文)

在這裡,該團隊將重點放在後者的開發上,並探索MechGPT 的使用,這是基於Transformer 的LLM 系列中的一種生成人工智慧工具,專門針對材料失效和相關的多尺度方法進行了訓練,從而評估這些策略的潛力。

該研究提出的策略包括幾個步驟。首先是蒸餾步驟,研究人員使用LLM從原始資料區塊中提取的文字(例如一個或多個PDF檔案)產生問答對。接下來,在第二步驟中利用這些數據來微調模型。這項研究也特別訓練了初始的MechGPT模型,在材料失效的原子建模領域展示了其在知識檢索、通用語言任務和假設生成等方面的有用性

圖:所使用的建模策略概述。 (資料來源:論文)

這篇論文介紹了一個總體的建模策略,研究人員採用特定的語言建模策略來產生資料集,以從來源中提取知識,並利用新穎的力學和材料資料集對模型進行訓練。研究人員對MechGPT的三個版本進行了分析和討論,這些版本的參數大小從130億到700億不等,上下文長度超過10,000個token

在對模型、提示以及訓練方式進行一些一般性評論之後,研究人員應用該模型並在各種設置中測試其性能,包括使用LLM 進行本體圖生成和開發有關跨學科複雜主題的見解,以及代理建模,其中多個LLM 以協作或對抗的方式交互,以產生對主題領域或問題回答的更深入的見解。

圖:發展本體知識圖表示,以在超音速斷裂和蛋白質展開機制的背景下關聯超彈性。 (資料來源:論文)

同時,該團隊進一步提供了不同抽象層級的語言模型和多粒子系統之間的概念比較,並解釋瞭如何將新框架視為提取管理複雜系統的普遍關係的手段。

重寫內容:上圖展示了LLM和多粒子模擬之間的概念類比。 (圖源:論文)

總體而言,該研究提出的工作有助於開發更強大、更通用的人工智慧模型,這些模型可以幫助推進科學研究並解決特定應用領域的複雜問題,從而可以深入評估模型的性能。與所有模型一樣,它們必須經過仔細驗證,它們的有用性存在於所提出的問題的背景、其優點和缺點以及幫助科學家推進科學和工程的更廣泛的工具中。

而且,人工智慧工具作為科學探究的工具,必須被視為理解、建模和設計我們周圍世界的工具集合。隨著人工智慧工具的快速發展,它們在科學背景下的應用才剛開始帶來新的機會

論文連結:https://arxiv.org/ftp/arxiv/papers/ 2310/2310.10445.pdf

相關報告:https://twitter.com/llama_index/status/1723379654550245719

#以上是可跨學科理解、多尺度建模,MIT LAMM發布微調的大語言模型 MechGPT的詳細內容。更多資訊請關注PHP中文網其他相關文章!

易於理解的解釋如何使用ChatGpt提高庫存管理效率!May 14, 2025 am 03:44 AM

易於理解的解釋如何使用ChatGpt提高庫存管理效率!May 14, 2025 am 03:44 AM即使對於中小型企業,易於實施!與Chatgpt和Excel的明智庫存管理 庫存管理是您業務的命脈。儲存過多和庫存的物品對現金流和客戶滿意度有嚴重影響。但是,目前的情況是,在成本方面引入全尺度庫存管理系統很高。 您想關注的是Chatgpt和Excel的組合。在本文中,我們將逐步解釋如何使用此簡單方法簡化庫存管理。 自動化數據分析,需求預測和報告以顯著提高運營效率等任務。而且,

易於理解的解釋如何檢查和切換chatgpt的版本!May 14, 2025 am 03:43 AM

易於理解的解釋如何檢查和切換chatgpt的版本!May 14, 2025 am 03:43 AM通過選擇chatgpt版本明智地使用AI!對最新信息以及如何檢查的詳盡說明 Chatgpt是一種不斷發展的AI工具,但其功能和性能因版本而異。在本文中,我們將以易於理解的方式解釋每個版本的Chatgpt的功能,如何檢查最新版本以及免費版本和付費版本之間的差異。選擇最佳版本,並充分利用您的AI潛力。 單擊此處以獲取有關Openai最新AI代理OpenAi Deep Research⬇️的更多信息 [chatgpt] openai d

解釋為什麼您不能將信用卡與Chatgpt的付費計劃一起使用以及如何處理的原因May 14, 2025 am 03:32 AM

解釋為什麼您不能將信用卡與Chatgpt的付費計劃一起使用以及如何處理的原因May 14, 2025 am 03:32 AMChatGPT付費訂閱的信用卡支付故障排除指南 使用ChatGPT付費訂閱時,信用卡支付可能會遇到問題。本文將探討信用卡被拒的原因以及相應的解決方法,從用戶自行解決的問題到需要聯繫信用卡公司的情況,提供詳盡的指南,助您順利使用ChatGPT付費訂閱。 OpenAI發布的最新AI代理,“OpenAI Deep Research”詳情請點擊⬇️ 【ChatGPT】OpenAI Deep Research詳解:使用方法及收費標準 目錄 ChatGPT信用卡支付失敗的原因 原因一:信用卡信息輸入錯誤 原

易於理解的解釋如何在Chatgpt中創建VBA宏!May 14, 2025 am 02:40 AM

易於理解的解釋如何在Chatgpt中創建VBA宏!May 14, 2025 am 02:40 AM對於初學者和對業務自動化感興趣的人,編寫VBA腳本(Microsoft Office的擴展程序)可能會覺得很困難。但是,ChatGpt使簡化和自動化業務流程變得容易。 本文以易於理解的方式解釋瞭如何使用ChatGpt開發VBA腳本。我們將詳細介紹特定的示例,包括從VBA的基礎到使用ChatGpt集成,測試和調試的所有內容,以及要注意的好處和點。為了提高編程技能並提高業務效率,

我無法使用ChatGpt插件功能!解釋在錯誤時該怎麼做May 14, 2025 am 01:56 AM

我無法使用ChatGpt插件功能!解釋在錯誤時該怎麼做May 14, 2025 am 01:56 AMChatGPT插件無法使用?這篇指南將幫助您解決問題!您是否遇到過ChatGPT插件無法使用或突然失效的情況? ChatGPT插件是提升用戶體驗的強大工具,但有時也會出現故障。本文將詳細分析ChatGPT插件無法正常工作的原因,並提供相應的解決方法。從用戶設置檢查到服務器故障排查,我們涵蓋了各種故障排除方案,助您高效利用插件完成日常任務。 OpenAI發布的最新AI代理——OpenAI Deep Research,詳情請點擊⬇️ [ChatGPT] OpenAI Deep Research詳解:使

chatgpt是否不遵循字符計數規範?關於如何處理這個問題的詳盡解釋!May 14, 2025 am 01:54 AM

chatgpt是否不遵循字符計數規範?關於如何處理這個問題的詳盡解釋!May 14, 2025 am 01:54 AM在使用chatgpt編寫句子時,有時您想指定字符數。但是,很難準確預測AI生成的句子的長度,並且匹配指定數量的字符並不容易。 在本文中,我們將解釋如何創建一個句子,其中chatgpt中的字符數量。我們將介紹有效的及時寫作,獲取適合您目的的答案的技術,並教您處理角色限制的技巧。此外,我們將解釋為什麼Chatgpt不擅長指定角色的數量及其工作方式,以及要謹慎和對策的要點。 本文

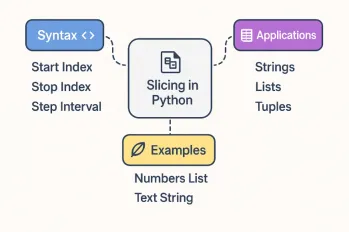

關於Python切片操作的所有內容May 14, 2025 am 01:48 AM

關於Python切片操作的所有內容May 14, 2025 am 01:48 AM對於每個Python程序員,無論是在數據科學和機器學習的領域還是軟件開發領域,Python切片操作都是最有效,最多功能和強大的操作之一。 Python切片語法

易於理解的解釋如何使用Chatgpt創建報價!May 14, 2025 am 01:44 AM

易於理解的解釋如何使用Chatgpt創建報價!May 14, 2025 am 01:44 AMAI技術的發展提高了業務效率。特別引起關注的是使用AI創建估計值。 Openai的AI助理Chatgpt有助於改善估計創建過程並提高準確性。 本文說明瞭如何使用chatgpt創建報價。我們將通過與Excel VBA的合作,系統開發項目的應用,AI實施的好處以及未來的前景來介紹效率提高。了解如何通過Chatgpt提高運營效率和生產力。 OP

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

mPDF

mPDF是一個PHP庫,可以從UTF-8編碼的HTML產生PDF檔案。原作者Ian Back編寫mPDF以從他的網站上「即時」輸出PDF文件,並處理不同的語言。與原始腳本如HTML2FPDF相比,它的速度較慢,並且在使用Unicode字體時產生的檔案較大,但支援CSS樣式等,並進行了大量增強。支援幾乎所有語言,包括RTL(阿拉伯語和希伯來語)和CJK(中日韓)。支援嵌套的區塊級元素(如P、DIV),

SublimeText3漢化版

中文版,非常好用

WebStorm Mac版

好用的JavaScript開發工具

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver Mac版

視覺化網頁開發工具