研究者:AI模型推理環節耗電較多,2027年產業用電將堪比荷蘭

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-10-14 08:25:141709瀏覽

IT之家 10 月 13 日消息,《Cell》的姊妹期刊《Joule》本週出版了一篇名為《持續成長的人工智能能源足跡(The growing energy footprint of artificial intelligence)》論文。

透過查詢,我們了解到這篇論文是由科學研究機構Digiconomist的創辦人Alex De Vries發表的。他聲稱未來人工智慧的推理性能可能會消耗大量的電力,預計到2027年,人工智慧的用電量可能會相當於荷蘭一年的電力消耗量

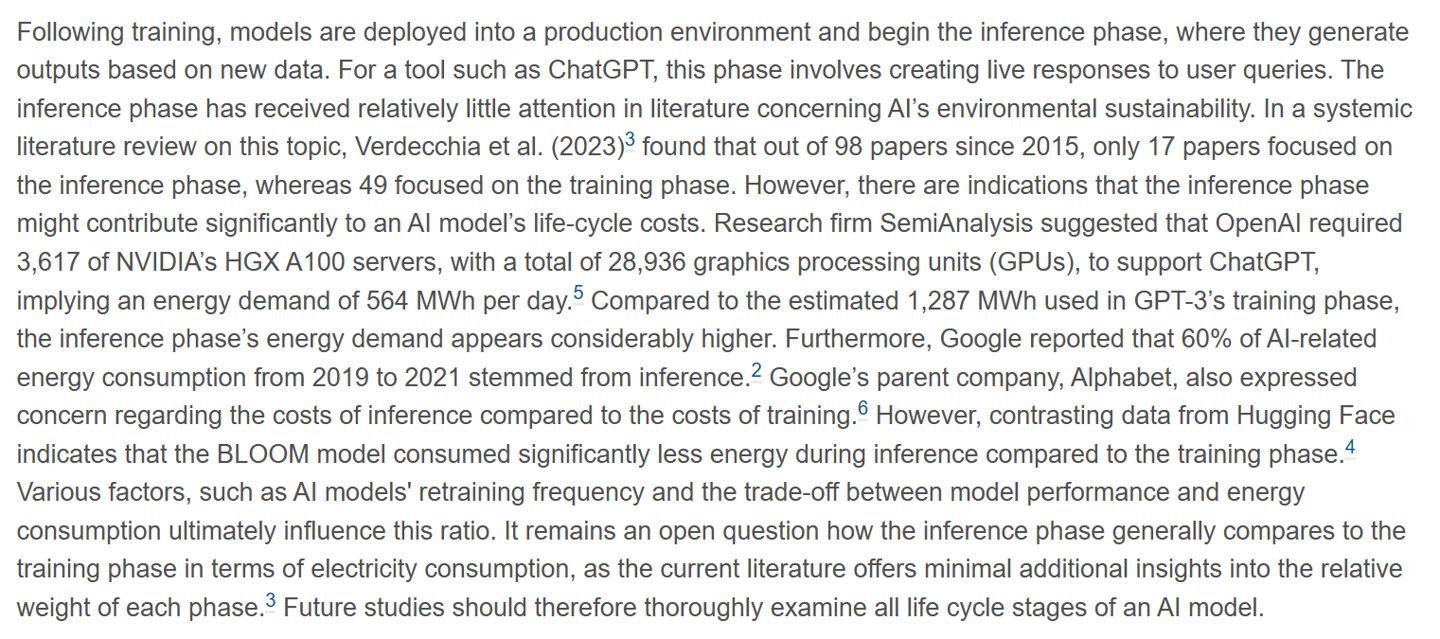

Alex De Vries 表示,外界一向認為訓練一個AI 模型“AI 最耗電的階段”,但Vries 引用了SemiAnalysis 及谷歌的報告指出,“推論環節”所消耗的電力更多,自2019 年到2021 年,與AI 相關的能源消耗中,預計有60% 來自模型推論。

▲ 圖表來源 相關論文

Alex De Vries 同時以穀歌在2021 年披露的18.3 TWh 耗電量來計算,聲稱當時AI 佔了谷歌公司整體耗電量的10%-15%,而在谷歌全面實施“AI 搜索”之後,該公司在AI 方面的耗電量最高可能達到27.4 TWh,接近愛爾蘭一整年所使用的電力(29.3 TWh)。

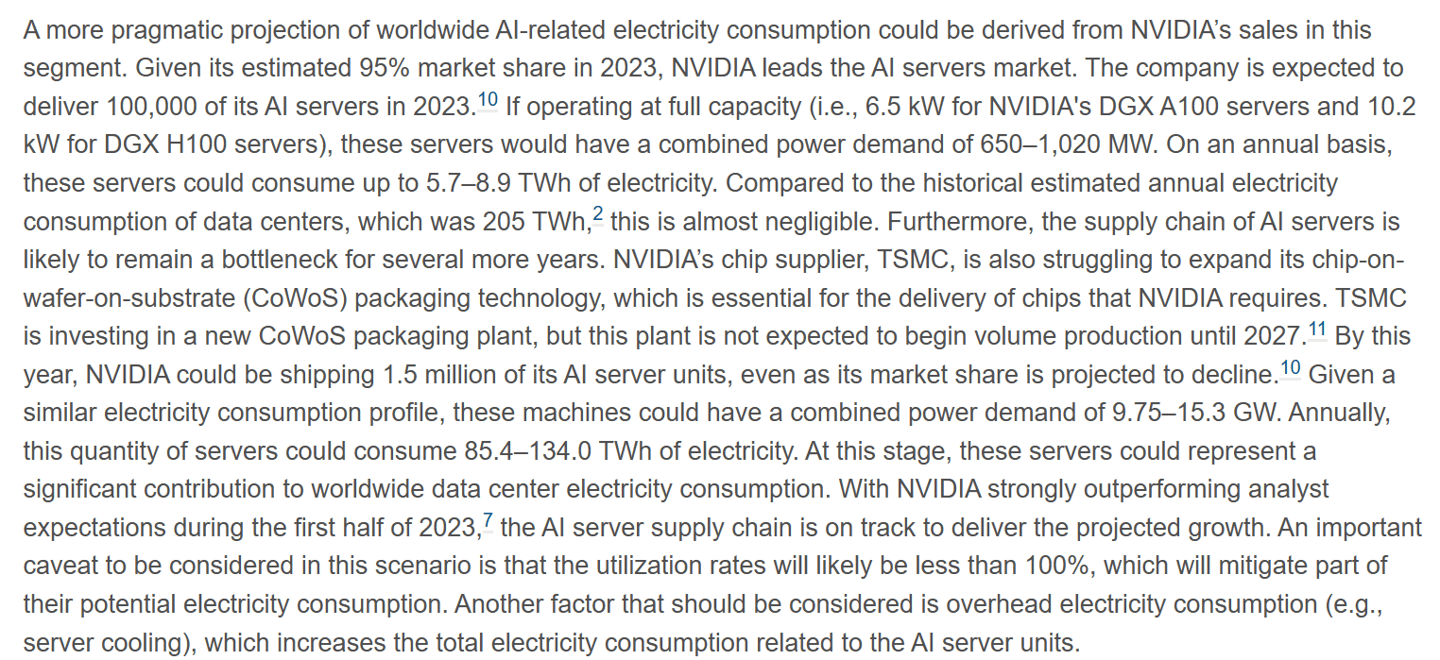

隨著英偉達合作夥伴台積電(TSMC)計劃於2027年開始量產新的CoWoS工廠,整個市場預計將出現變化。根據Alex De Vries的估計,到那時,英偉達交付的所有AI伺服器的總用電量將達到85-134 TWh,相當於荷蘭一年的電力使用量

▲ 圖表來源 相關論文

亞歷克斯·德弗里斯認為,人工智慧產業應該提高硬體效率,改善模型演算法的效率,以改善該產業的能源消耗。他還建議開發者不僅應該專注於優化人工智慧,還必須考慮使用人工智慧的必要性,以降低人工智慧產業的能源成本

為了不改變原始意思而重寫內容,需要將語言重寫為中文。沒有必要出現原始句子

以上是研究者:AI模型推理環節耗電較多,2027年產業用電將堪比荷蘭的詳細內容。更多資訊請關注PHP中文網其他相關文章!