對抗性攻擊對模型穩定性的影響問題,需要具體程式碼範例

#摘要:隨著人工智慧的快速發展,深度學習模型廣泛應用於各種領域。然而,這些模型在面對對抗性攻擊時往往表現出驚人的脆弱性。對抗性攻擊指的是對模型輸入進行微小的擾動,從而導致模型輸出產生誤判的行為。本文將討論對抗性攻擊對模型穩定性的影響,並透過實例程式碼示範如何對抗這種攻擊。

- 引言

隨著深度學習模型在電腦視覺、自然語言處理等領域取得了巨大的成功,人們對其穩定性問題產生了越來越大的關注。對抗性攻擊就是一種針對深度學習模型的安全威脅,攻擊者可以透過微小的擾動來欺騙模型,從而導致模型輸出錯誤的結果。對抗性攻擊對模型的可信度和可靠性造成了嚴重的威脅,因此研究如何應對對抗性攻擊變得至關重要。 - 對抗性攻擊的類型

對抗性攻擊可以分為兩大類:基於白盒攻擊和基於黑盒攻擊。基於白盒攻擊表示攻擊者對模型有完全的了解,包括模型結構、參數等訊息,而基於黑盒攻擊則表示攻擊者只能利用模型的輸出結果進行攻擊。 - 對抗性攻擊的影響

對抗性攻擊對模型穩定性的影響主要表現在以下幾個方面:

a. 訓練資料失效:對抗樣本能夠欺騙模型,使得模型在真實世界中失效。

b. 引入漏洞:對抗性攻擊可以透過小幅度的擾動來使模型輸出錯誤的結果,從而可能引發安全漏洞。

c. 輕易欺騙模型:對抗樣本通常在人眼看起來與原始樣本無異,但模型卻可以被輕易欺騙。

d. 模型無法泛化:對抗性攻擊可以透過對訓練集中樣本進行微小的擾動來使模型無法泛化到其他樣本上。 - 對抗性攻擊的防禦方法

針對對抗性攻擊,一些常見的防禦方法包括:

a. 對抗訓練:透過在訓練集中添加對抗樣本來提高模型的穩健性。

b. 波動性防禦:偵測輸入中的異常行為,如輸入的擾動過大,則判斷為對抗樣本進行丟棄。

c. 樣本預處理:對輸入樣本進行處理,使其在輸入模型之前變得更加淨化。

d. 參數調整:調整模型的參數以提高其穩健性。 - 程式碼範例

為了更好地理解對抗性攻擊的影響以及如何對抗這種攻擊,我們提供以下程式碼範例:

import tensorflow as tf

from cleverhans.attacks import FastGradientMethod

from cleverhans.utils_keras import KerasModelWrapper

# 导入模型

model = tf.keras.applications.VGG16(weights='imagenet')

model.compile(optimizer='adam', loss='categorical_crossentropy')

# 包装模型,方便使用cleverhans库进行对抗性攻击

wrap = KerasModelWrapper(model)

# 构建对抗性攻击

fgsm = FastGradientMethod(wrap, sess=tf.Session())

# 对测试集进行攻击

adv_x = fgsm.generate(x_test)

# 评估攻击效果

adv_pred = model.predict(adv_x)

accuracy = np.sum(np.argmax(adv_pred, axis=1) == np.argmax(y_test, axis=1)) / len(y_test)

print('攻击成功率:', accuracy)以上程式碼範例使用了TensorFlow和CleverHans庫,透過Fast Gradient Method(FGSM)進行對抗性攻擊。首先導入預先訓練的模型,然後使用KerasModelWrapper包裝模型,方便使用CleverHans庫進行攻擊。接著建構FGSM攻擊對象,最後對測試集進行攻擊並評估攻擊效果。

- 結論

對抗性攻擊對深度學習模型的穩定性造成了巨大的威脅,但我們可以透過對模型進行對抗訓練、波動性防禦、樣本預處理和參數調整等方法來提高模型的魯棒性。本文提供了一個程式碼範例,幫助讀者更好地理解對抗性攻擊的影響以及如何對抗這種攻擊。同時,讀者還可以對程式碼進行擴展,嘗試其他對抗性攻擊方法,以加強模型的安全性。

以上是對抗性攻擊對模型穩定性的影響問題的詳細內容。更多資訊請關注PHP中文網其他相關文章!

一個提示可以繞過每個主要LLM的保障措施Apr 25, 2025 am 11:16 AM

一個提示可以繞過每個主要LLM的保障措施Apr 25, 2025 am 11:16 AM隱藏者的開創性研究暴露了領先的大語言模型(LLM)的關鍵脆弱性。 他們的發現揭示了一種普遍的旁路技術,稱為“政策木偶”,能夠規避幾乎所有主要LLMS

5個錯誤,大多數企業今年將犯有可持續性Apr 25, 2025 am 11:15 AM

5個錯誤,大多數企業今年將犯有可持續性Apr 25, 2025 am 11:15 AM對環境責任和減少廢物的推動正在從根本上改變企業的運作方式。 這種轉變會影響產品開發,製造過程,客戶關係,合作夥伴選擇以及採用新的

H20芯片禁令震撼中國人工智能公司,但長期以來一直在為影響Apr 25, 2025 am 11:12 AM

H20芯片禁令震撼中國人工智能公司,但長期以來一直在為影響Apr 25, 2025 am 11:12 AM最近對先進AI硬件的限制突出了AI優勢的地緣政治競爭不斷升級,從而揭示了中國對外國半導體技術的依賴。 2024年,中國進口了價值3850億美元的半導體

如果Openai購買Chrome,AI可能會統治瀏覽器戰爭Apr 25, 2025 am 11:11 AM

如果Openai購買Chrome,AI可能會統治瀏覽器戰爭Apr 25, 2025 am 11:11 AM從Google的Chrome剝奪了潛在的剝離,引發了科技行業中的激烈辯論。 OpenAI收購領先的瀏覽器,擁有65%的全球市場份額的前景提出了有關TH的未來的重大疑問

AI如何解決零售媒體的痛苦Apr 25, 2025 am 11:10 AM

AI如何解決零售媒體的痛苦Apr 25, 2025 am 11:10 AM儘管總體廣告增長超過了零售媒體的增長,但仍在放緩。 這個成熟階段提出了挑戰,包括生態系統破碎,成本上升,測量問題和整合複雜性。 但是,人工智能

'AI是我們,比我們更多'Apr 25, 2025 am 11:09 AM

'AI是我們,比我們更多'Apr 25, 2025 am 11:09 AM在一系列閃爍和惰性屏幕中,一個古老的無線電裂縫帶有靜態的裂紋。這堆易於破壞穩定的電子產品構成了“電子廢物之地”的核心,這是沉浸式展覽中的六個裝置之一,&qu&qu

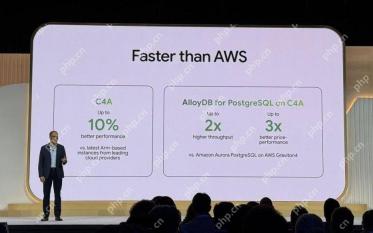

Google Cloud在下一個2025年對基礎架構變得更加認真Apr 25, 2025 am 11:08 AM

Google Cloud在下一個2025年對基礎架構變得更加認真Apr 25, 2025 am 11:08 AMGoogle Cloud的下一個2025:關注基礎架構,連通性和AI Google Cloud的下一個2025會議展示了許多進步,太多了,無法在此處詳細介紹。 有關特定公告的深入分析,請參閱我的文章

IR的秘密支持者透露,Arcana的550萬美元的AI電影管道說話,Arcana的AI Meme,Ai Meme的550萬美元。Apr 25, 2025 am 11:07 AM

IR的秘密支持者透露,Arcana的550萬美元的AI電影管道說話,Arcana的AI Meme,Ai Meme的550萬美元。Apr 25, 2025 am 11:07 AM本週在AI和XR中:一波AI驅動的創造力正在通過從音樂發電到電影製作的媒體和娛樂中席捲。 讓我們潛入頭條新聞。 AI生成的內容的增長影響:技術顧問Shelly Palme

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

記事本++7.3.1

好用且免費的程式碼編輯器

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器