在法國巴黎舉行了國際電腦視覺大會ICCV(International Conference on Computer Vision)本週開幕

作為全球電腦視覺領域頂級的學術會議,ICCV 每兩年召開一次。

ICCV的熱度一直以來都與CVPR不相上下,屢創新高

在今天的開幕式上,ICCV官方公佈了今年的論文數據:本屆ICCV共有8068篇投稿,其中有2160篇被接收,錄用率為26.8%,略高於上一屆ICCV 2021的錄用率25.9%

在論文主題方面,官方也公佈了相關數據:多視角和感測器的3D技術熱度最高

在今天的開幕式上,最重要的部分無疑是頒發獎項的環節。接下來,我們將逐一揭曉最佳論文、最佳論文提名和最佳學生論文的獲獎者

最佳論文-馬爾獎

今年的最佳論文(馬爾獎)有兩篇論文獲得該獎項

第一篇研究是由多倫多大學的研究者進行的

https://openaccess.thecvf.com/content/ICCV2023/papers/Wei_Passive_Ultra-Wideband_Single-Photon_Imaging_ICCV_2023_paper.pdf

作者: Mian Wei、Sotiris Nousias、Rah Lindellve、作者:Mian Wei、Sotiris Nousias、Rah Lindellve、David Bah. 、Kiriakos N. Kutulakos重寫後的內容:多倫多大學是一所知名的機構摘要:本文考慮在極端的時間尺度範圍內,同時(秒到皮秒)對動態場景進行成像的問題,並且是被動地進行成像,沒有太多的光,也沒有來自發射它的光源的任何定時信號。由於單光子相機現有的通量估計(flux estimation)技術在這種情況下會失效,因此本文開發了一種通量探測理論,該理論從隨機微積分中汲取見解,從而能夠從單調增加的光子偵測時間戳流中重建像素的時變通量。 本文利用這個理論來(1) 表明無源自由運行SPAD 相機在低通量條件下具有可實現的頻率頻寬,跨越整個DC-to31 GHz 範圍,(2) 推導了一種新穎的傅立葉域通量重建演算法,並且(3) 確保演算法的雜訊模型即使對於非常低的光子計數或不可忽略的死區時間也保持有效。 ControlNet、SAM等熱門論文獲獎,ICCV 2023論文獎項公佈。本文透過實驗展示了這種非同步成像機制的潛力:(1)對以截然不同的速度運行的光源(燈泡、投影機、多個脈衝雷射)同時照明的場景進行成像,而無需同步,(2 )被動非視距視頻採集;(3)記錄超寬頻視頻,稍後可以以30 Hz的速度播放以顯示日常運動,但也可以慢十億倍的速度播放以顯示光本身的傳播

論文地址:https ://arxiv.org/pdf/2302.05543.pdf

撰寫者:張綠民、饒安怡、Maneesh Agrawala機構:史丹佛大學摘要:本文提出了一個端到端的神經網路架構ControlNet,可以透過添加額外條件來控制擴散模型(如Stable Diffusion),從而改善圖生圖效果,並能實現線稿生成全彩圖、生成具有同樣深度結構的圖、透過手部關鍵點還能優化手部的生成等。 ###ControlNet 的核心思想是在文字描述之外添加一些額外條件來控制擴散模型(如 Stable Diffusion),從而更好地控制生成圖像的人物姿態、深度、畫面結構等資訊。

重新寫成: 我們可以透過將額外的條件以圖像的形式輸入,讓模型進行Canny邊緣檢測、深度檢測、語義分割、霍夫變換直線檢測、整體嵌套邊緣檢測(HED)、人體姿態辨識等操作,並在生成的影像中保留這些資訊。利用這個模型,我們可以將線稿或塗鴉直接轉換成全彩圖,並產生具有相同深度結構的圖像,同時還可以透過手部關鍵點來優化人物手部的生成

詳細介紹請參考本站報導:AI降維打擊人類畫家,文生圖引入ControlNet,深度、邊緣資訊全能復用

最佳論文提名:SAM

今年4月份,Meta發布了名為「分割一切(SAM)」的AI模型,它能夠為任何影像或影片中的物件產生遮罩。這項技術讓電腦視覺領域的研究者感到震驚,有人甚至稱之為“CV不存在了”

如今,這篇備受關注的論文摘的最佳論文提名。

論文網址:https://arxiv.org/abs/2304.02643

重寫後的內容:機構:Meta AI

重寫後的內容:對於分割問題的解決,目前大致上有兩種方法。第一種是互動式分割,這種方法可以用來分割任何類別的對象,但需要一個人透過迭代細化遮罩來指導方法。第二種是自動分割,可以用來分割預先定義的特定物件類別(例如貓或椅子),但需要大量手動註釋物件進行訓練(例如數千甚至數萬個分割貓的例子)。這兩種方法都沒有提供通用的、全自動的分割方法

Meta提出的SAM很好地總結了這兩種方法。它是一個單一的模型,可以輕鬆地執行互動式分割和自動分割。此模型的可提示介面允許使用者以靈活的方式使用它,只需為模型設計正確的提示(點擊、框選、文字等),就可以完成各種廣泛的分割任務

總結一下,這些功能使得SAM能夠適應新的任務和領域。這種彈性在影像分割領域是獨一無二的

詳細介紹請參考本站報道:CV不存在了? Meta發布「分割一切」AI 模型,CV或迎來GPT-3時刻

#最佳學生論文

該研究由康乃爾大學、Google研究院和UC 柏克萊的研究者共同完成,一作是來自Cornell Tech 的博士生Qianqian Wang。他們共同提出了一種完整且全局一致的運動表徵 OmniMotion,並提出一種新的測試時(test-time)最佳化方法,對影片中每個像素進行準確、完整的運動估計。

在電腦視覺領域,有兩種常用的運動估計方法:稀疏特徵追蹤和密集光流。然而,這兩種方法都存在一些缺點。稀疏特徵追蹤無法對所有像素的運動進行建模,而密集光流則無法長時間捕捉運動軌跡

OmniMotion 是一项研究提出的新技术,它使用了 quasi-3D 规范体积来表征视频。通过局部空间和规范空间之间的双射,OmniMotion 能够对每个像素进行追踪。这种表征方法不仅能够保证全局一致性,即使在物体被遮挡的情况下也能进行运动追踪,而且能够对相机和物体运动的任何组合进行建模。实验证明,OmniMotion 方法在性能上显著优于现有的 SOTA 方法

详细介绍请参考本站报道:随时随地,追踪每个像素,连遮挡都不怕的「追踪一切」视频算法来了

当然,除了这些获奖论文,今年ICCV还有许多优秀论文值得大家关注。最后为大家附上17篇获奖论文初始清单。

以上是ICCV 2023揭曉:ControlNet、SAM等熱門論文斬獲獎項的詳細內容。更多資訊請關注PHP中文網其他相關文章!

如何使用LM Studio在本地運行LLM? - 分析VidhyaApr 19, 2025 am 11:38 AM

如何使用LM Studio在本地運行LLM? - 分析VidhyaApr 19, 2025 am 11:38 AM輕鬆在家運行大型語言模型:LM Studio 使用指南 近年來,軟件和硬件的進步使得在個人電腦上運行大型語言模型 (LLM) 成為可能。 LM Studio 就是一個讓這一過程變得輕鬆便捷的優秀工具。本文將深入探討如何使用 LM Studio 在本地運行 LLM,涵蓋關鍵步驟、潛在挑戰以及在本地擁有 LLM 的優勢。無論您是技術愛好者還是對最新 AI 技術感到好奇,本指南都將提供寶貴的見解和實用技巧。讓我們開始吧! 概述 了解在本地運行 LLM 的基本要求。 在您的電腦上設置 LM Studi

蓋伊·佩里(Guy Peri)通過數據轉換幫助麥考密克的未來Apr 19, 2025 am 11:35 AM

蓋伊·佩里(Guy Peri)通過數據轉換幫助麥考密克的未來Apr 19, 2025 am 11:35 AM蓋伊·佩里(Guy Peri)是麥考密克(McCormick)的首席信息和數字官。儘管他的角色僅七個月,但Peri正在迅速促進公司數字能力的全面轉變。他的職業生涯專注於數據和分析信息

迅速工程中的情感鍊是什麼? - 分析VidhyaApr 19, 2025 am 11:33 AM

迅速工程中的情感鍊是什麼? - 分析VidhyaApr 19, 2025 am 11:33 AM介紹 人工智能(AI)不僅要理解單詞,而且要理解情感,從而以人的觸感做出反應。 這種複雜的互動對於AI和自然語言處理的快速前進的領域至關重要。 Th

12個最佳數據科學工作流程的AI工具-Analytics VidhyaApr 19, 2025 am 11:31 AM

12個最佳數據科學工作流程的AI工具-Analytics VidhyaApr 19, 2025 am 11:31 AM介紹 在當今以數據為中心的世界中,利用先進的AI技術對於尋求競爭優勢和提高效率的企業至關重要。 一系列強大的工具使數據科學家,分析師和開發人員都能構建,Depl

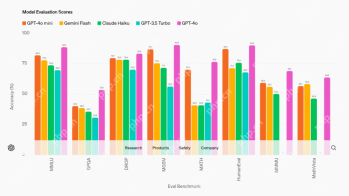

AV字節:OpenAI的GPT-4O Mini和其他AI創新Apr 19, 2025 am 11:30 AM

AV字節:OpenAI的GPT-4O Mini和其他AI創新Apr 19, 2025 am 11:30 AM本週的AI景觀爆炸了,來自Openai,Mistral AI,Nvidia,Deepseek和Hugging Face等行業巨頭的開創性發行。 這些新型號有望提高功率,負擔能力和可訪問性,這在TR的進步中推動了

報告發現,困惑的Android應用程序有安全缺陷。Apr 19, 2025 am 11:24 AM

報告發現,困惑的Android應用程序有安全缺陷。Apr 19, 2025 am 11:24 AM但是,該公司的Android應用不僅提供搜索功能,而且還充當AI助手,並充滿了許多安全問題,可以將其用戶暴露於數據盜用,帳戶收購和惡意攻擊中

每個人都擅長使用AI:關於氛圍編碼的想法Apr 19, 2025 am 11:17 AM

每個人都擅長使用AI:關於氛圍編碼的想法Apr 19, 2025 am 11:17 AM您可以查看會議和貿易展覽中正在發生的事情。您可以詢問工程師在做什麼,或諮詢首席執行官。 您看的任何地方,事情都以驚人的速度發生變化。 工程師和非工程師 有什麼區別

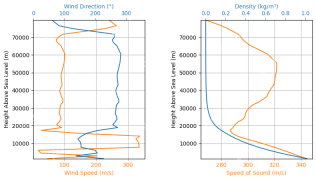

火箭發射模擬和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM

火箭發射模擬和分析使用Rocketpy -Analytics VidhyaApr 19, 2025 am 11:12 AM模擬火箭發射的火箭發射:綜合指南 本文指導您使用強大的Python庫Rocketpy模擬高功率火箭發射。 我們將介紹從定義火箭組件到分析模擬的所有內容

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中