英偉達為遠端會議通話研發AI 3D視訊聊天解決方案

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-08-23 18:49:011777瀏覽

視訊會議系統首次商用化於50多年前,它使人們能夠與千里之外的同事、朋友或家人進行視聽交流。視訊會議的最終目標是實現遠端參與者之間的沉浸式通信,彷彿大家身處同一地點

現有的3D視訊會議系統雖然展現了捕捉眼神交流和其他非語言線索的潛力,但卻需要昂貴的3D擷取設備

在名為「AI-Mediated 3D Video Conferencing」的計畫中,英偉達、美國加州大學聖迭戈分校和北卡羅來納大學教堂山分校的團隊透過AI人工智慧技術成功開發了一種高保真度、低成本的3D遠端呈現方法,並且提供了以3D掃描為基礎無法實現的新功能

此外,團隊的解決方案相容於多種現有的3D顯示器,包括立體顯示器和光場顯示器

延伸閱讀:利用AI縮小體積,Google展示光場通話專案Project Starline新迭代

值得注意的是,Google正在利用人工智慧來改進他們的光場通話專案Project Starline。簡單來說,Project Starline是一個3D視訊聊天室,利用光場技術創造出一種彷彿對方真的坐在你對面的感覺。這款創新的遠端通訊工具結合了Google在硬體和軟體方面的進步,旨在提升朋友、家人和同事在遠端交流時的身臨其境感

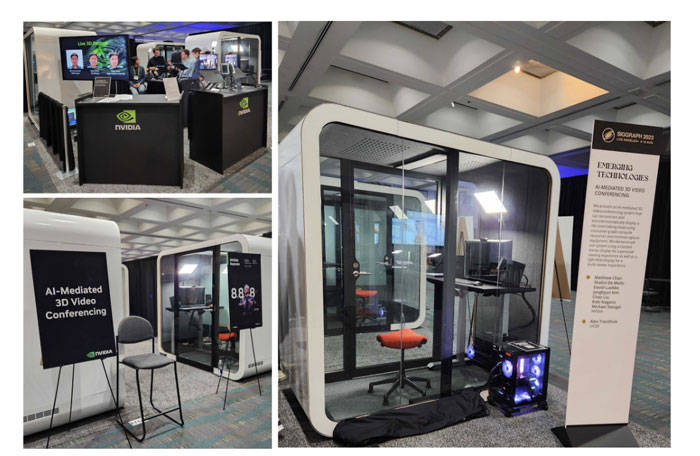

英偉達團隊回到了他們的“AI-Mediated 3D Video Conferencing”項目,並在SIGGRAPH大會上展示了該設置,並撰寫了相關介紹

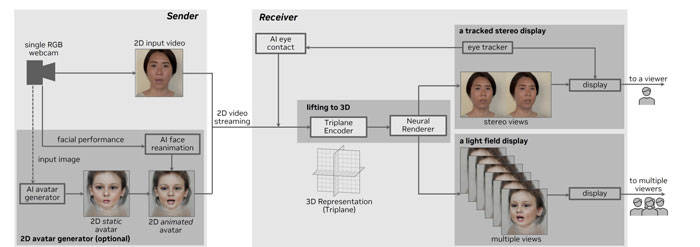

圖示系統包括一個sender,用於記錄和傳輸來自單一RGB網路攝影機的2D視訊;以及一個receiver,用於接收並將2D視訊轉換為3D,並呈現出新穎的3D視圖

透過使用one-shot方法,研究人員可以即時地從單一的unposed影像中推斷和渲染出真實的3D表示,並在NVIDIA RTX A5000筆記型電腦上產生光場影像。使用instant AI super-resolution技術,參與者可以立即看到他們的3D自我影像。在即時情況下,參與者可以觀察到2D網路攝影機影像被提升為具有頭部追蹤功能的立體3D視圖

使用者可以選擇使用2D Avatar生成器模組來產生和自訂由使用者驅動的2D Avatar,除了使用網路攝影機圖片

研究人員提出了一種基於Vision Transformer的新編碼器,用於將2D輸入轉換為有效的三平面隱式3D表示,從而在3D提升方面取得了重要進展。透過給定使用者的單一RGB影像,該方法能夠自動建立使用者的正面3D表示,並透過體三維繪製從新視點進行高效的渲染

這個句子的重寫如下:三平面編碼器完全依賴經過預訓練的EG3D產生的合成資料進行訓練,而3D提升模組使用產生的先驗來確保產生的視圖在多視圖一致性和照片真實感方面,並且能夠在沒有個人特定訓練的情況下以one shot方式適用於任何人

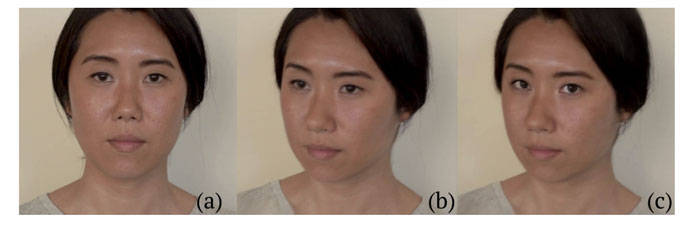

團隊使用最先進的神經方法,透過合成給定用戶圖片的重定向眼睛注視,將2D圖像經過注視校正提升為3D圖像,實現了眼神交流,如圖所示

系統支援多種現成的3D顯示器,包括單人立體顯示器和多人光場顯示器

這張圖展示了使用Dimenco的32吋3D立體顯示器的情況。它利用眼動追蹤和透鏡技術來呈現立體影像,準確地顯示使用者眼睛的位置。其中a提供了一個概覽,而b和c展示了系統能夠以正確的視角記錄參與者的立體圖像。同時,d和e說明了透過給定單一的RGB影像,該方法可以產生逼真的遠端呈現效果

此外,研究人員使用一台32吋的Looking Glass顯示器來評估AI系統。這款顯示器能夠同時展示真實大小的說話者頭,讓多人能夠清晰地觀看。這種光場顯示器為普通觀眾和等待演示的人員提供了清晰的技術展示

接下來,輪候排隊的人員可以嘗試不同展位的立體顯示器,並體驗多路人工智慧引導的3D視訊會議電話

延伸閱讀:AI-Mediated 3D Video Conferencing

延伸閱讀:Live 3D Portrait: Real-Time Radiance Fields for Single-Image Portrait View Synthesis

值得注意的是,團隊透過使用NVIDIA TensorRT對編碼器進行了最佳化,使其能夠在NVIDIA A6000 Ada Generation GPU上進行即時推理。整個系統的運作時間不到100毫秒,包括擷取、串流和渲染

以上是英偉達為遠端會議通話研發AI 3D視訊聊天解決方案的詳細內容。更多資訊請關注PHP中文網其他相關文章!