羊駝家族大模型集體演化! 32k上下文追平GPT-4,由田徑棟團隊出品

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-06-28 22:06:521865瀏覽

開源羊駝大模型LLaMA上下文追平GPT-4,只需要一個簡單改動!

Meta AI這篇剛提交的論文表示,LLaMA上下文視窗從2k擴展到32k後只需要小於1000步的微調。

與預訓練相比,成本忽略不計。

擴展上下文窗口,就意味著AI的「工作記憶」容量增加,具體來說可以:

- 支援更多輪對話,減少遺忘現象,如更穩定的角色扮演

- 輸入更多資料完成更複雜的任務,如一次處理更長文檔或多篇文檔

更重要的意義在於,所有基於LLaMA的羊駝大模型家族豈不是可以低成本採用此方法,集體進化?

羊駝是目前綜合能力最強的開源基礎模型,已經衍生出不少完全開源可商用大模型和垂直行業模型。

論文通信作者地棟也興奮地在朋友圈分享這項新進展。

基於RoPE的大模型都能用

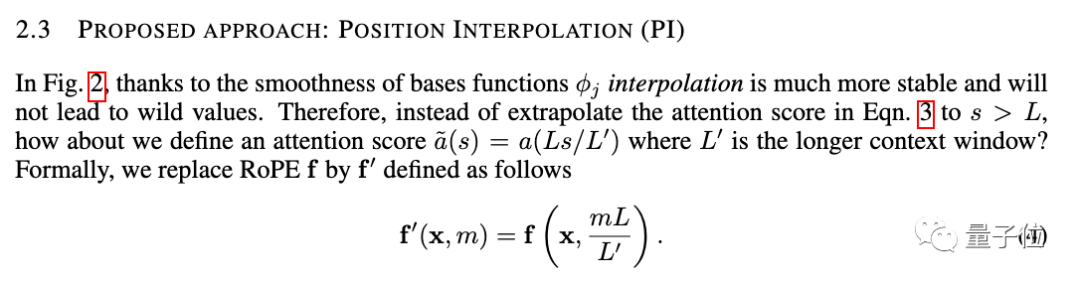

新方法名為位置插值(Position Interpolation),對使用RoPE(旋轉位置編碼)的大模型都適用。

RoPE早在2021年就由追一科技團隊提出,到現在已成為大模型最常見的位置編碼方法之一。

但在此架構下直接使用外推法(Extrapolation)擴展上下文窗口,會完全破壞自註意力機制。

具體來說,超出預訓練上下文長度之外的部分,會使模型困惑度(perplexity)飆升至和未經訓練的模型相當。

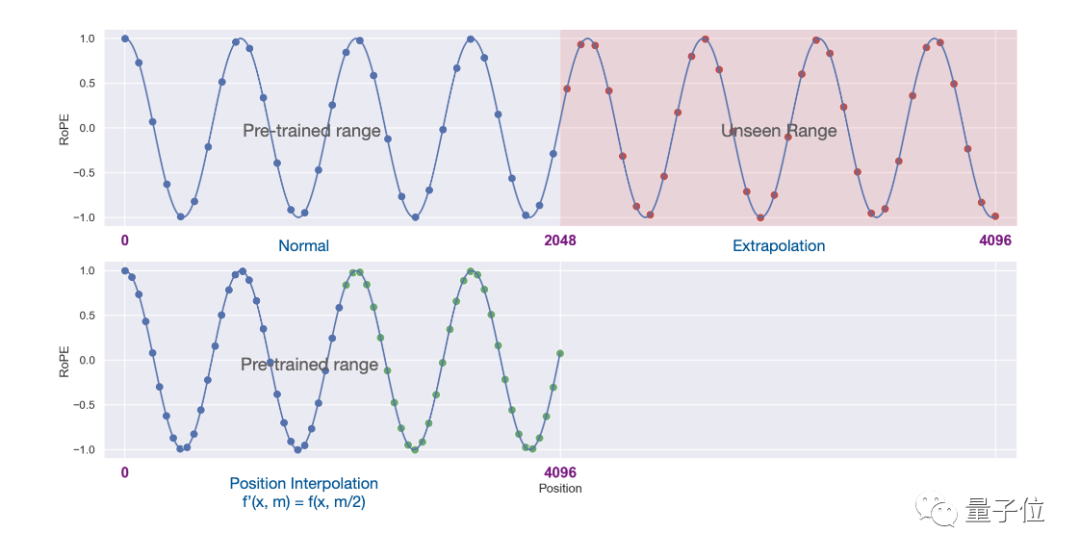

新方法改成線性地縮小位置索引,擴展前後位置索引和相對距離的範圍對齊。

用圖形表現二者的差異更為直覺。

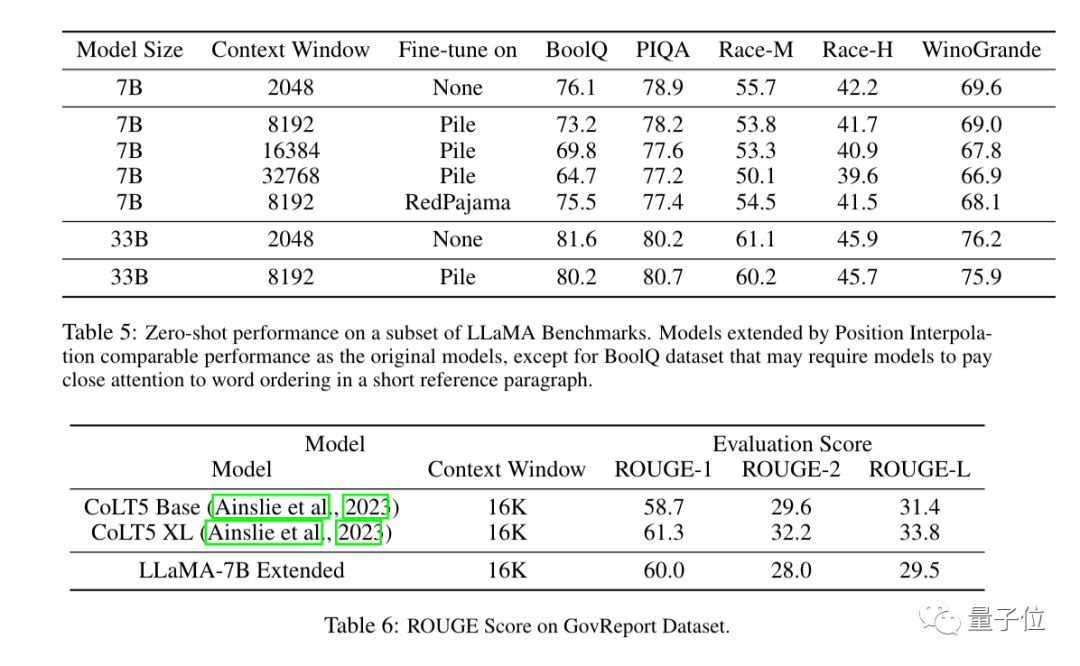

實驗結果顯示,新方法對從7B到65B的LLaMA大模型都有效。

在長序列語言建模(Long Sequence Language Modeling)、金鑰檢索(Passkey Retrieval)、長文件摘要(Long Document Summarization)中效能都沒有明顯下降。

除了實驗之外,論文附錄中也給出了新方法的詳細證明。

Three More Thing

上下文視窗曾經是開源大模型與商業大模型之間一個重要差距。

例如OpenAI的GPT-3.5最高支援16k,GPT-4支援32k,AnthropicAI的Claude更是高達100k。

同時許多開源大模型如LLaMA和Falcon還停留在2k。

現在,Meta AI的新成果直接把這一差距抹平了。

擴展上下文視窗也是近期大模型研究的焦點之一,除了位置插值方法之外,還有很多嘗試引起業界關注。

1、開發者kaiokendev在一篇技術部落格中探索了一種將LLaMa上下文視窗擴展到8k的方法。

2、資料安全公司Soveren機器學習負責人Galina Alperovich在一篇文章中總結了擴展上下文視窗的6個技巧。

3、來自Mila、IBM等機構的團隊也在一篇論文中嘗試了在Transformer中完全去掉位置編碼的方法。

有需要的小夥伴可以點擊下方連結查看~

Meta論文:https://www.php.cn/link/ 0bdf2c1f053650715e1f0c725d754b96

Extending Context is Hard…but not Impossiblehttps://www.php.cn/link/9659078925b57e621eb3f9ef19773ac3

The Secret Sauce behind 100K context window在 LLMshttps://www.php.cn/link/09a630e07af043e4cae879dd60db1cac

無地點編碼論文https://www.php.cn/link/fb6c84779f12283a81d7399

以上是羊駝家族大模型集體演化! 32k上下文追平GPT-4,由田徑棟團隊出品的詳細內容。更多資訊請關注PHP中文網其他相關文章!