基於資訊理論的校準技術,CML讓多模態機器學習更可靠

- PHPz轉載

- 2023-06-27 16:26:56917瀏覽

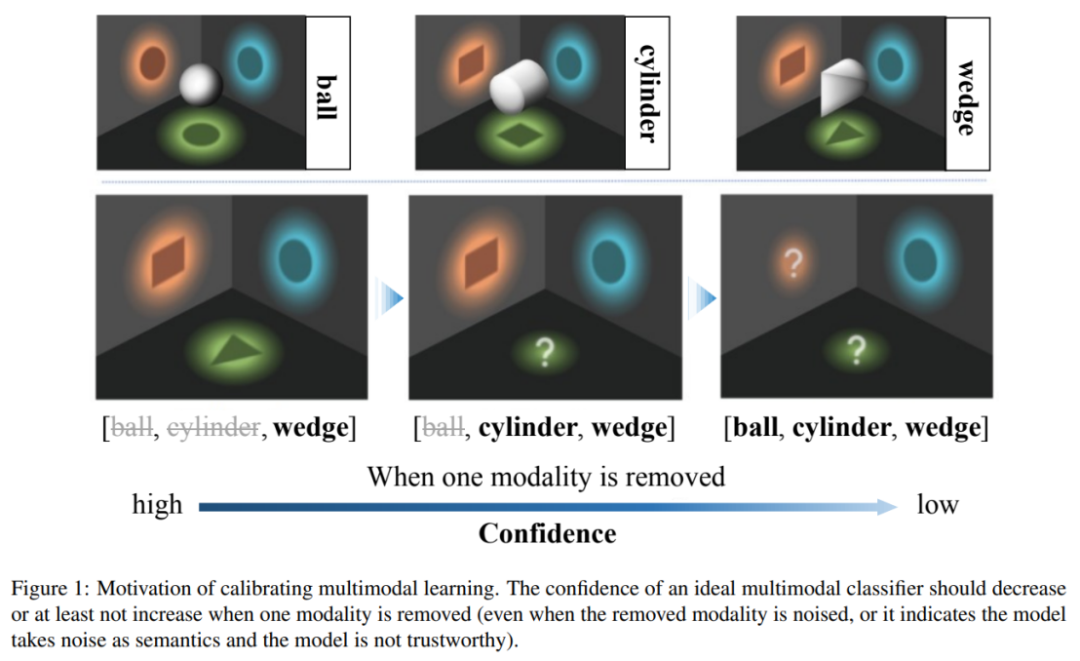

多模態機器學習在各種場景下都取得了令人矚目的進展。然而,多模態學習模型的可靠性尚缺乏深入研究。 「資訊是消除的不確定性」,多模態機器學習的初衷與這是一致的——增加的模態可以使得預測更為準確和可靠。然而,最近發表於 ICML2023 的論文《Calibrating Multimodal Learning》發現當前多模態學習方法違法了這一可靠性假設,並做出了詳細分析和矯正。

圖片

圖片

- #論文Arxiv:https:// arxiv.org/abs/2306.01265

- #程式碼GitHub:https://github.com/QingyangZhang/CML

#目前的多模態分類方法存在不可靠的置信度,即當部分模態被移除時,模型可能產生更高的置信度,違反了資訊理論中「資訊是消除的不確定性」這一基本原理。針對此問題,本文提出校準多模態學習(Calibrating Multimodal Learning)方法。此方法可以部署到不同的多模態學習範式中,提升多模態學習模型的合理性和可信賴性。

圖片

圖片

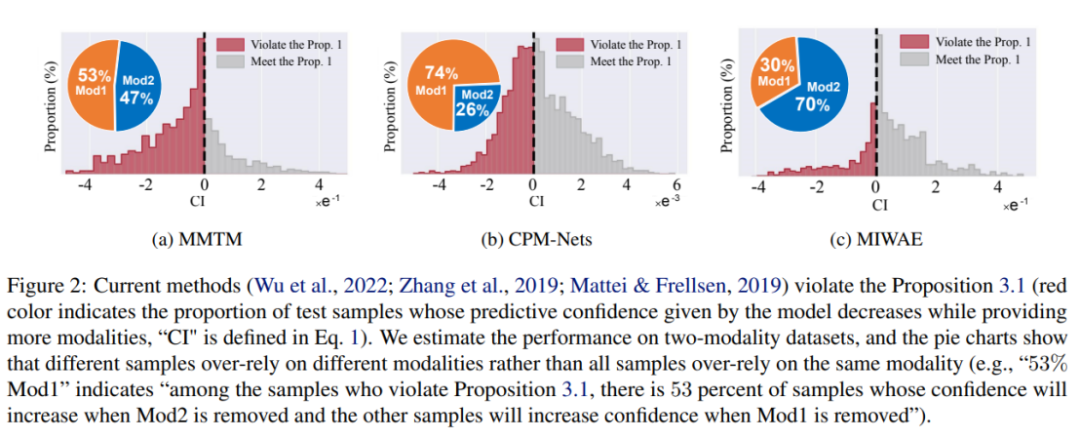

該工作指出,目前多模態學習方法存在不可靠的預測置信度問題,現有多模態機器學習模型傾向於依賴部分模態來估計置信度。特別地,研究發現,目前模型估計的置信度在某些模態被損壞時反而會增加。為了解決這個不合理問題,作者提出了一個直觀的多模態學習原則:當移除模態時,模型預測置信度不應增加。但是,目前的模型傾向於相信部分模態,容易受到這個模態的影響,而不是公平地考慮所有模態。這進一步影響了模型的穩健性,即當某些模態被損壞時,模型很容易受到影響。

為了解決上述問題,目前一些方法採用了現有的不確定性校準方法,例如 Temperature Scaling 或貝葉斯學習方法。這些方法可以建立比傳統訓練 / 推理方式更準確的置信度估計。但是,這些方法只是使最終融合結果的信心估計與正確率匹配,並沒有明確考慮模態資訊量與信心之間的關係,因此,無法本質上提升多模態學習模型的可信度。

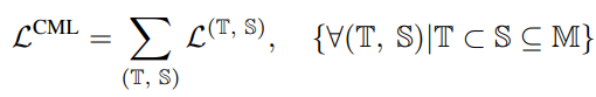

作者提出了一個新的正則化技術,稱為 “Calibrating Multimodal Learning (CML)”。該技術透過添加一項懲罰項來強制模型預測信心與資訊量的匹配關係,以實現預測置信度和資訊量之間的一致性。該技術基於一種自然的直覺,即當移除一個模態時,預測置信度應該會降低(至少不應該增加),這可以內在地提高置信度校準。具體來說,提出了一種簡單的正則化項,透過對那些當移除一個模態時預測置信度會增加的樣本添加懲罰,來強制模型學習直觀的次序關係:

上面的限制為正規損失,當模態訊息移除信心上升時作為懲罰出現。

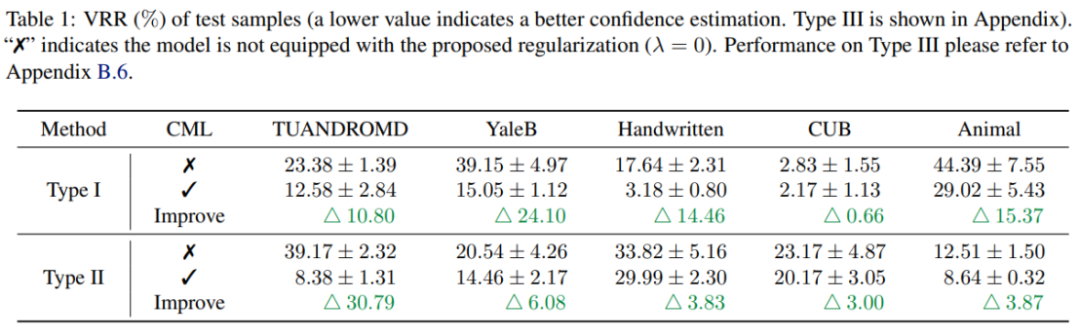

實驗結果表明,CML 正則化可以顯著提高現有多模態學習方法的預測置信度的可靠性。此外,CML 還可以提高分類精度,並提高模型的穩健性。

多模态机器学习在各种情境中取得了显著的进展,但是多模态机器学习模型的可靠性仍然是一个需要解决的问题。本文通过广泛的实证研究发现,当前多模态分类方法存在预测置信度不可靠的问题,违反了信息论原则。针对这一问题,研究人员提出了 CML 正则化技术,该技术可以灵活地部署到现有的模型,并在置信度校准、分类精度和模型鲁棒性方面提高性能。相信这个新技术将在未来的多模态学习中发挥重要作用,提高机器学习的可靠性和实用性。

以上是基於資訊理論的校準技術,CML讓多模態機器學習更可靠的詳細內容。更多資訊請關注PHP中文網其他相關文章!