最近,圖靈三巨頭之一的Yoshua Bengio接受了BBC的採訪。

Bengio在訪談中透出了一股濃濃的「憂鬱風」,表示他對自己一生所追求的事業感到某種程度上的迷失。

往具體了說,他覺得如果自己能早點體認到AI可能的發展速度,那他可能就會傾向於AI的安全性優先,而非實用性優先。

要知道,Bengio剛剛簽署了前幾天公佈的「AI可能滅絕人類」的公開信。

迷失的Bengio

公開信的簽署立場鮮明地表明了Bengio的態度。

這封只有22個字的公開信,將AI可能滅絕人類的風險和核戰、傳染病等社會危機做比較。

在BBC的訪談中,Bengio詳細地闡述了自己的看法。

他呼籲,我們應該對AI進行更嚴格地規範,舉例來說,軍方就絕對不應該被賦予使用AI的權力。

當然,政治機構也不是對AI的發展熟視無睹。

歐盟可能就會是最早針對AI進行立法的組織。也是在最近,歐盟表示,AI相關的行為準則可能在未來幾週內創建。

這種擔心不無道理。畢竟,AI的高性能可能被使用在對人類有害的目標上,例如開發新型化學武器。

Bengio表示,自己很擔心那些「有惡意」的人掌握AI,尤其是在AI發展速度如此之快的情況下。

「可能是軍方,可能是恐怖分子,也可能是精神情緒並不穩定的人。總之,如果這些人掌握了AI,讓AI執行一些極度危險的事情,那麼後果是不可預料的。」

另外,他表示,如果AI繼續發展,我們可能無法中斷進程中的AI。

接下來,Bengio又聊到自己了。

這些擔憂無疑增加了他的內耗,對他的個人生活和工作產生了影響。

從前的Bengio是榮譽傍身的AI大牛(當然現在也是),當時的他,願意為自己所熱愛和擅長的事業奮鬥終生。

AI事業曾經帶給他了認同感、認同感和人生方向。但現在,因為這些擔憂的存在,這些東西對他來說已經不再清晰。

「對於那些身在AI行業的人來說,這在情感上是具有挑戰性的。」

不過,憂鬱的背後仍是積極的態度。

「你可以說我感到迷失。但你必須堅持下去,你必須參與討論,鼓勵別人和你一起思考。」

馬斯克也表達過類似的擔憂。

雖然他不認為AI一定會滅絕人類,但他認為AI可能會限制並控制人類。

Bengio認為,所有和AI產品相關的科技巨頭公司都需要受管控,登記在冊。

「政府需要追蹤他們在做什麼,他們需要能夠審計他們。而這只是我們對其他任何行業(如建造飛機、汽車或製藥)所做的最基本的事情。」

「我們還需要引入一種道德訓練,而這通常來說都是電腦科學及不會接受到的。」

Huggingface的科學家Sasha Luccioni博士表示,社會應該關注諸如AI偏見,資訊的錯誤傳播等問題,她認為這些問題是具體的。

她的理念是,具體的問題應該要被我們更重視。滅絕人類什麼的,有點虛,還聊不到。

而實際上,也有許多實例顯示了AI為社會帶來的許多好處。

就在上週,憑藉AI的力量,一個癱瘓的人只需靠意念控制就能再次嘗試行走,這得益於使用AI開發的微晶片。

而在科技影響以外,AI對國家經濟的深遠影響也不能忽視。

許多公司已經開始用AI工具取代人工,這也正是好萊塢劇作家發動罷工的一個重要原因。

毅然離職的Hinton

無獨有偶,前一陣子,同為圖靈三巨頭的Hinton也因為同樣的原因上過一次熱搜。

當時,各大媒體充斥著這個標題:深度學習泰斗、神經網路之父Geoffrey Hinton突然宣布離職Google。

為了能夠自由談論人工智慧風險,而不考慮這對Google的影響。

在紐約時報的報導中,Hinton直接警示世人:注意,前方有危險,前方有危險,前方有危險!

而這正是他對人工智慧風險深深擔憂。 Hinton直言:「我對自己的畢生工作,感到非常後悔。」

從人工智慧的開創者到末日預言家,Hinton的轉變,也標誌著科技業正處於數十年來最重要的一個轉折點。

這一點同樣讓許多業內人士感到不安,他們擔心自己所做的研究,正在向外釋放某種危險。

因為生成式人工智慧可能已經成為產生錯誤訊息的工具。並在未來的某個時候,可能會對人類構成威脅。

在Hinton看來,如何防止壞人利用它做壞事,我們還未能找到方法。

而在Hinton辭職錢,在喧囂的反對浪潮中,人工智慧教父Hinton卻並未在限制AI發展的兩封公開信上簽名。

他表示,自己在辭去工作之前,並不想公開批評谷歌,或其他公司。

忍到上個月,Hinton終於下定決心,通知Google自己即將辭職。

選擇離職Google後,Hinton終於可以暢所欲言地談論AI的風險了。

#我對我的畢生工作,感到十分後悔。

我只能這樣安慰自己:即使沒有我,也會有別人。

以上是AI教父Bengio:我感到迷失,對AI擔憂已成「精神內耗」!的詳細內容。更多資訊請關注PHP中文網其他相關文章!

O3 vs O4 -Mini vs Gemini 2.5 Pro:終極推理戰 - 分析VidhyaApr 26, 2025 am 09:28 AM

O3 vs O4 -Mini vs Gemini 2.5 Pro:終極推理戰 - 分析VidhyaApr 26, 2025 am 09:28 AM該博客將三個領先的AI模型(O3,O4-Mini和Gemini 2.5 Pro)置於嚴格的推理挑戰中。 我們在物理,數學,編碼,網頁設計和圖像分析中測試它們的能力,揭示了它們的優勢

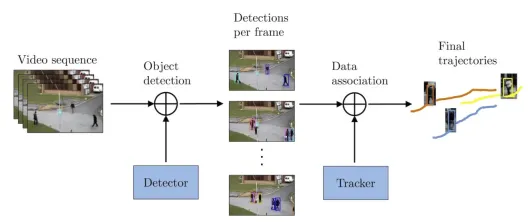

在Yolo -Analytics Vidhya中進行有效的重新ID跟踪Apr 26, 2025 am 09:26 AM

在Yolo -Analytics Vidhya中進行有效的重新ID跟踪Apr 26, 2025 am 09:26 AMYOLO,SSD和DETR等實時對象檢測工具對於監視對象運動和動作至關重要。 交通管理和安全等行業利用這些工具來跟踪和分析。但是,一個主要挑戰是維護

生成AI數據科學家:蓬勃發展的新工作角色Apr 26, 2025 am 09:22 AM

生成AI數據科學家:蓬勃發展的新工作角色Apr 26, 2025 am 09:22 AM生成AI(Genai)數據科學家:蓬勃發展的職業道路 執行摘要: 生成AI的新興領域需要專業人員熟練的大型數據集導航,LLM加速模型開發和現實世界中的AI部署。 蒂

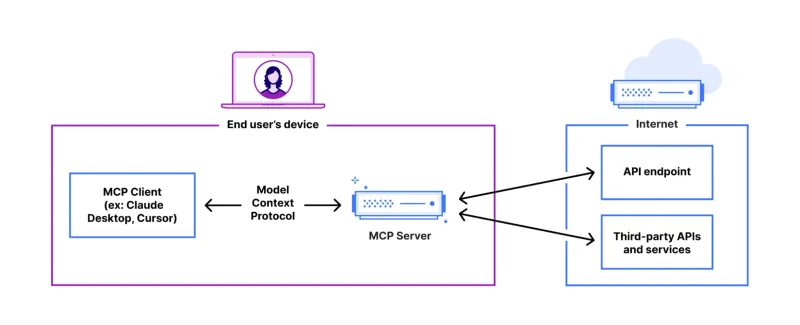

如何將MCP與光標AI一起使用?Apr 26, 2025 am 09:21 AM

如何將MCP與光標AI一起使用?Apr 26, 2025 am 09:21 AMAI正在改變我們構建軟件的方式。 MCP(模型上下文協議)和光標AI等工具正在領導這一轉變。光標AI使您可以使用自然語言編寫代碼,而MCP則在頂部添加了智能處理和自動化。 tog

Python 3.14更新 - 這個甜蜜的π切片中有什麼新功能? - 分析VidhyaApr 26, 2025 am 09:18 AM

Python 3.14更新 - 這個甜蜜的π切片中有什麼新功能? - 分析VidhyaApr 26, 2025 am 09:18 AMPython 3.14.0a6:π日發布的重大更新 2025年3月14日(π日),Python 3.14.0a6發布,這是3.14系列的倒數第二個alpha版本,預示著beta階段即將到來。此次發布包含大量新功能,讓我們一探究竟。 目錄 什麼是Python 3.14 Alpha版本? Python 3.14更新中的主要功能(目前為止) PEP 649 – 延遲求值註解(第二版) PEP 741 – 新的Python配置C API PEP 761 – 不再使用PGP簽名發布(Sigstore登

如何使用Langchain創建MCP客戶端服務器-Analytics VidhyaApr 26, 2025 am 09:17 AM

如何使用Langchain創建MCP客戶端服務器-Analytics VidhyaApr 26, 2025 am 09:17 AM本指南展示了使用Langchain和模型上下文協議(MCP)構建強大的AI代理。 MCP允許大型語言模型(LLM)與外部工具和實時數據進行交互,從而顯著增強其功能。我們會

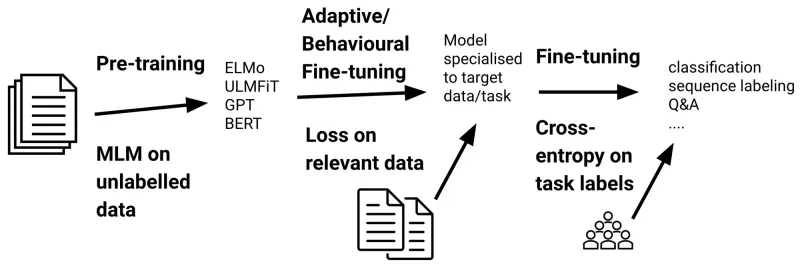

語言模型評估中的熵損失-Analytics VidhyaApr 26, 2025 am 09:14 AM

語言模型評估中的熵損失-Analytics VidhyaApr 26, 2025 am 09:14 AM理解交叉熵損失:大型語言模型的關鍵指標 交叉熵損失是評估語言模型的基石指標之一,它既是訓練目標,也是評估指標。本文將深入探討交叉熵損失的含義、在大型語言模型 (LLM) 中的工作原理及其重要性。無論您是機器學習從業者、研究人員,還是希望了解現代人工智能係統如何訓練和評估的人員,本文都將為您提供對交叉熵損失及其在語言建模領域意義的全面理解。 目錄 交叉熵損失是什麼? 交叉熵損失的關鍵特性 二元交叉熵與公式 交叉熵作為損失函數 交叉熵在大型語言模型中的作用 工作原理? 公式和解釋 PyT

訪問Google VEO 2的3種方法-Analytics VidhyaApr 26, 2025 am 09:13 AM

訪問Google VEO 2的3種方法-Analytics VidhyaApr 26, 2025 am 09:13 AMGoogle VEO 2:深入了解Google的高級生成視頻模型 Google揭示了Google VEO 2,這是迄今為止最複雜的生成視頻模型。 這個功能強大的工具將詳細的文本描述轉換為電影質量視頻,

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

WebStorm Mac版

好用的JavaScript開發工具

Atom編輯器mac版下載

最受歡迎的的開源編輯器

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

MinGW - Minimalist GNU for Windows

這個專案正在遷移到osdn.net/projects/mingw的過程中,你可以繼續在那裡關注我們。 MinGW:GNU編譯器集合(GCC)的本機Windows移植版本,可自由分發的導入函式庫和用於建置本機Windows應用程式的頭檔;包括對MSVC執行時間的擴展,以支援C99功能。 MinGW的所有軟體都可以在64位元Windows平台上運作。