从风险的角度来看,生成式人工智能聊天机器人和大型语言模型可能是一把双刃剑,但如果使用得当,它们也可以在关键方面改善网络安全。

OpenAI公司开发的ChatGPT的迅速崛起是今年最大的新闻之一,生成式AI聊天机器人和大型语言模型对网络安全的潜在影响是讨论的关键领域。关于这些新技术可能带来的安全风险有很多讨论,从担心与高级自学习算法共享敏感业务信息到恶意行为者使用它们来显著增强攻击。

一些国家、各州和企业以数据安全、保护和隐私为由,下令禁止使用ChatGPT等生成式人工智能技术。显然,生成式人工智能聊天机器人和大型大型语言模型带来的安全风险是相当大的。然而,生成式人工智能聊天机器人可以通过多种方式增强企业的网络安全,为安全团队打击网络犯罪活动提供急需的助力。

以下是生成式人工智能聊天机器人和大型语言模型提高安全性的6种方法。

漏洞扫描和过滤

根据云安全联盟(CSA)一份探讨大型语言模型网络安全影响的报告,生成式人工智能模型可用于显著增强安全漏洞的扫描和过滤。在论文中,云安全联盟(CSA)证明了OpenAI的CodexAPI是针对C、c#、Java和JavaScript等编程语言的有效漏洞扫描器。“我们可以预见,大型语言模型,就像Codex家族中的那些一样,将成为未来漏洞扫描器的标准组成部分,”论文写道。例如,可以开发扫描器来检测和标记各种语言中的不安全代码模式,帮助开发人员在潜在的漏洞成为关键的安全风险之前解决它们。

至于过滤,生成式人工智能模型可以解释并为威胁标识符添加有价值的场景,否则可能会被人类安全人员遗漏。例如,MITREATT&CK框架中的技术标识符TT1059.001可能会被报告,但对于一些网络安全专业人员来说并不熟悉,因此需要进行简要的解释。ChatGPT可以准确地将代码识别为MITREATT&CK标识符,并提供与之相关的具体问题的解释,其中涉及使用恶意PowerShell脚本。它还详细阐述了PowerShell的性质及其在网络安全攻击中的潜在用途,并提供了相关示例。

今年5月,OXSecurity宣布推出OX-gpt,这是一个ChatGPT集成,旨在帮助开发人员提供定制的代码修复建议和剪切粘贴代码修复,包括代码如何被黑客利用,攻击的可能影响以及对组织的潜在损害。

反转附加组件,分析PE文件的api

DeepInstinct网络智能工程经理MattFulmer表示,基于IDA和Ghidra等逆向工程框架,生成式人工智能/大型语言模型(LLM)技术可用于帮助构建规则和逆转流行的附加组件。“如果你明确了自己的需求,并将其与MITRE的攻击和攻击策略进行比较,你就可以将结果离线,并更好地将其用作防御。”

llm还可以通过应用程序进行交流,分析可移植可执行文件(PE)的API,并告诉你它们的用途,他补充道。“这可以减少安全研究人员花在查看PE文件和分析其中API通信上的时间。”

威胁搜索查询

根据CSA的说法,安全防御者可以通过利用ChatGPT和其他llm来创建威胁搜索查询来提高效率并加快响应时间。通过为恶意软件研究和检测工具(如YARA)生成查询,ChatGPT有助于快速识别和减轻潜在威胁,使防御者能够专注于其网络安全工作的关键方面。事实证明,在不断发展的威胁环境中,这种能力对于保持稳健的安全态势是无价的。可以根据特定需求和组织希望在其环境中检测或监视的威胁来定制规则。

人工智能可以提高供应链的安全性

生成式人工智能模型可以通过识别供应商的潜在漏洞来解决供应链安全风险。今年4月,SecurityScorecard宣布推出一个新的安全评级平台,通过与OpenAI的GPT-4系统和自然语言全球搜索集成来实现这一目标。据该公司称,客户可以询问有关其业务生态系统的开放式问题,包括供应商的详细信息,并迅速获得答案,以推动风险管理决策。例如,“找到我的10个评级最低的供应商”或“显示我的哪些关键供应商在过去一年中被入侵”——SecurityScorecard声称,这些问题将产生结果,使团队能够快速做出风险管理决策。

检测攻击中的生成AI文本

據CSA稱,大型語言模型不僅生成文本,而且還致力於檢測和水印人工智慧生成的文本,這可能成為電子郵件保護軟體的常見功能。 CSA表示,識別攻擊中人工智慧產生的文字可以幫助偵測網路釣魚郵件和多態程式碼,並且可以假設llm可以輕鬆偵測非典型電子郵件地址寄件者或其對應的網域,同時能夠檢查文字中的底層連結是否指向已知的惡意網站。

安全程式碼的產生和傳輸

像ChatGPT這樣的llm可以用來產生和傳輸安全碼。 CSA引用了一個網路釣魚活動的例子,該活動成功地針對了公司內的幾名員工,可能暴露了他們的憑證。雖然知道哪些員工打開了網路釣魚郵件,但尚不清楚他們是否無意中執行了旨在竊取他們憑證的惡意程式碼。

為了調查這個問題,可以使用Microsoft365Defender進階搜尋查詢來尋找電子郵件收件者在收到已知惡意電子郵件後30分鐘內執行的最近10次登入事件。該查詢有助於識別任何可能與受損憑證相關的可疑登入活動。 」

在這裡,ChatGPT可以提供Microsoft365Defender搜尋查詢,以檢查受感染的電子郵件帳戶的登入嘗試,這有助於阻止攻擊者進入系統,並澄清用戶是否需要更改密碼。這是在網路事件回應期間減少行動時間的一個很好的例子。

#基於相同的範例,您可能會遇到相同的問題並找到Microsoft365Defender查找查詢,但是您的系統不使用KQL程式語言。可以進行程式語言風格轉換,而不是用您想要的語言搜尋正確的範例。

他說,「這個例子說明了ChatGPT的底層Codex模型可以採用原始碼範例並用另一種程式語言產生範例。它還透過在其提供的答案和新創建背後的方法中添加關鍵細節,簡化了最終用戶的過程。 ”

根據CSA的說法,安全防禦者可以透過利用ChatGPT和其他llm來創建威脅搜尋查詢來提高效率並加快回應時間。透過為惡意軟體研究和偵測工具(如YARA)產生查詢,ChatGPT有助於快速識別和減輕潛在威脅,使防禦者能夠專注於其網路安全工作的關鍵方面。事實證明,在不斷發展的威脅環境中,這種能力對於保持穩健的安全態勢是無價的。可以根據特定需求和組織希望在其環境中檢測或監視的威脅來定制規則。

人工智慧可以提高供應鏈的安全性

產生式人工智慧模型可以透過識別供應商的潛在漏洞來解決供應鏈安全風險。今年4月,SecurityScorecard宣布推出一個新的安全評級平台,透過與OpenAI的GPT-4系統和自然語言全球搜尋整合來實現這一目標。據該公司稱,客戶可以詢問有關其業務生態系統的開放式問題,包括供應商的詳細信息,並迅速獲得答案,以推動風險管理決策。例如,「找到我的10個評級最低的供應商」或「顯示我的哪些關鍵供應商在過去一年中被入侵」——SecurityScorecard聲稱,這些問題將產生結果,使團隊能夠快速做出風險管理決策。

檢測攻擊中的生成AI文本

#據CSA稱,大型語言模型不僅生成文本,而且還致力於檢測和水印人工智慧產生的文本,這可能成為電子郵件保護軟體的常見功能。CSA表示,識別攻擊中人工智慧產生的文本可以幫助檢測網路釣魚郵件和多態程式碼,並且可以假設llm可以輕鬆檢測非典型電子郵件地址寄件者或其對應的網域,同時能夠檢查文字中的底層連結是否指向已知的惡意網站。

安全代碼的產生和傳輸

#像ChatGPT這樣的llm可以用來產生和傳輸安全代碼。CSA引用了一個網路釣魚活動的例子,該活動成功地針對了公司內的幾名員工,可能暴露了他們的憑證。雖然知道哪些員工打開了網路釣魚郵件,但尚不清楚他們是否無意中執行了旨在竊取他們憑證的惡意程式碼。

為了調查這個問題,可以使用Microsoft365Defender高級搜尋查詢來尋找電子郵件收件者在收到已知惡意電子郵件後30分鐘內執行的最近10次登入事件。此查詢有助於識別任何可能與受損憑證相關的可疑登入活動。」

在這裡,ChatGPT可以提供Microsoft365Defender搜尋查詢,以檢查受感染的電子郵件帳戶的登入嘗試,這有助於阻止攻擊者進入系統,並澄清使用者是否需要更改密碼。這是在網路事件回應期間減少行動時間的一個很好的例子。

#基於相同的範例,您可能會遇到相同的問題並找到Microsoft365Defender查找查詢,但是您的系統不使用KQL程式語言。您可以進行程式語言風格轉換,而不是用您想要的語言搜尋正確的範例。

「這個範例說明了ChatGPT的底層Codex模型可以採用原始程式碼範例並用另一種程式語言產生範例。它還透過在其提供的答案和新建立背後的方法中添加關鍵細節,簡化了最終用戶的過程。」領導者必須確保生成式人工智慧聊天機器人的安全使用

Gigamon首席策略長ChaimMazal表示,與許多現代技術一樣,從風險的角度來看,人工智慧和大型語言模型可能是一把雙面刃,因此,領導者必須確保自己的團隊安全可靠地使用這些產品。 「安全和法律團隊應該合作,為他們的組織找到最好的前進道路,在不損害知識產權或安全的情況下利用這些技術的能力。」

富爾默說,生成式人工智慧是基於過時的結構化數據,所以只有在評估其在安全和防禦方面的應用時,才能把它作為一個起點。例如,如果將其用於上述任何好處,則需要證明其輸出是合理的。把輸出放到線下,讓人把它做得更好、更精準、更可操作。 ”

隨著時間的推移,生成式人工智慧聊天機器人/大型語言模型最終將自然地增強安全性和防禦能力,但利用人工智慧/大型語言模型來幫助而不是傷害網路安全態勢,最終都將歸結為內部溝通和回應。到Mazal說。「生成式人工智慧/大型語言模型可以成為讓利害關係人以更快、更有效的方式全面解決安全問題的一種手段。領導者必須溝通如何利用工具來支持組織目標,同時教育他們了解潛在的威脅。 」

TovieAI公司的人工智慧技術主管兼執行長JoshuaKaiser表示,人工智慧聊天機器人也需要定期更新,以保持對威脅的有效防禦,而人類的監督對於確保大型語言模型的正常運作至關重要。他說,「此外,大型語言模型需要理解場景,以提供準確的回應並捕捉任何安全問題,並應定期進行測試和評估,以識別潛在的弱點或漏洞。 ”

以上是產生人工智慧聊天機器人和大型語言模型增強網路安全的六種方法的詳細內容。更多資訊請關注PHP中文網其他相關文章!

最新的最佳及時工程技術的年度彙編Apr 10, 2025 am 11:22 AM

最新的最佳及時工程技術的年度彙編Apr 10, 2025 am 11:22 AM對於那些可能是我專欄新手的人,我廣泛探討了AI的最新進展,包括體現AI,AI推理,AI中的高科技突破,及時的工程,AI培訓,AI,AI RE RE等主題

歐洲的AI大陸行動計劃:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM

歐洲的AI大陸行動計劃:Gigafactories,Data Labs和Green AIApr 10, 2025 am 11:21 AM歐洲雄心勃勃的AI大陸行動計劃旨在將歐盟確立為人工智能的全球領導者。 一個關鍵要素是建立了AI Gigafactories網絡,每個網絡都有大約100,000個高級AI芯片 - 2倍的自動化合物的四倍

微軟的直接代理商故事是否足以創造更多的粉絲?Apr 10, 2025 am 11:20 AM

微軟的直接代理商故事是否足以創造更多的粉絲?Apr 10, 2025 am 11:20 AM微軟對AI代理申請的統一方法:企業的明顯勝利 微軟最近公告的新AI代理能力清晰而統一的演講給人留下了深刻的印象。 與許多技術公告陷入困境不同

向員工出售AI策略:Shopify首席執行官的宣言Apr 10, 2025 am 11:19 AM

向員工出售AI策略:Shopify首席執行官的宣言Apr 10, 2025 am 11:19 AMShopify首席執行官TobiLütke最近的備忘錄大膽地宣布AI對每位員工的基本期望是公司內部的重大文化轉變。 這不是短暫的趨勢。這是整合到P中的新操作範式

IBM啟動具有完整AI集成的Z17大型機Apr 10, 2025 am 11:18 AM

IBM啟動具有完整AI集成的Z17大型機Apr 10, 2025 am 11:18 AMIBM的Z17大型機:集成AI用於增強業務運營 上個月,在IBM的紐約總部,我收到了Z17功能的預覽。 以Z16的成功為基礎(於2022年推出並證明持續的收入增長

5 Chatgpt提示取決於別人並完全相信自己Apr 10, 2025 am 11:17 AM

5 Chatgpt提示取決於別人並完全相信自己Apr 10, 2025 am 11:17 AM解鎖不可動搖的信心,消除了對外部驗證的需求! 這五個CHATGPT提示將指導您完全自力更生和自我感知的變革轉變。 只需複制,粘貼和自定義包圍

AI與您的思想危險相似Apr 10, 2025 am 11:16 AM

AI與您的思想危險相似Apr 10, 2025 am 11:16 AM人工智能安全與研究公司 Anthropic 最近的一項[研究]開始揭示這些複雜過程的真相,展現出一種令人不安地與我們自身認知領域相似的複雜性。自然智能和人工智能可能比我們想像的更相似。 窺探內部:Anthropic 可解釋性研究 Anthropic 進行的研究的新發現代表了機制可解釋性領域的重大進展,該領域旨在反向工程 AI 的內部計算——不僅僅觀察 AI 做了什麼,而是理解它在人工神經元層面如何做到這一點。 想像一下,試圖通過繪製當有人看到特定物體或思考特定想法時哪些神經元會放電來理解大腦。 A

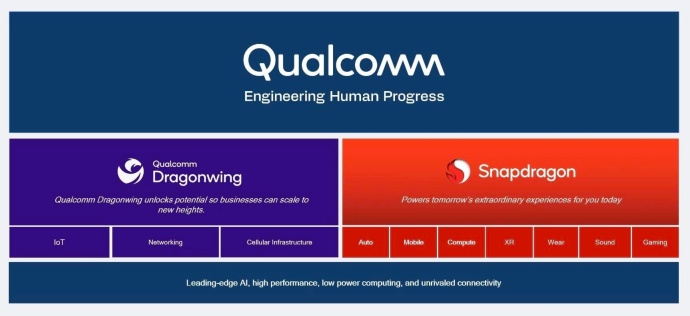

龍翼展示高通的邊緣動力Apr 10, 2025 am 11:14 AM

龍翼展示高通的邊緣動力Apr 10, 2025 am 11:14 AM高通的龍翼:企業和基礎設施的戰略飛躍 高通公司通過其新的Dragonwing品牌在全球範圍內積極擴展其範圍,以全球為目標。 這不僅僅是雷布蘭

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

WebStorm Mac版

好用的JavaScript開發工具

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

SublimeText3 Linux新版

SublimeText3 Linux最新版

Safe Exam Browser

Safe Exam Browser是一個安全的瀏覽器環境,安全地進行線上考試。該軟體將任何電腦變成一個安全的工作站。它控制對任何實用工具的訪問,並防止學生使用未經授權的資源。

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。