AI契約論⑤:生成式AI千帆競發,如何運用規則「掌舵」

- 王林轉載

- 2023-06-02 20:21:051183瀏覽

21世紀經濟報道記者 蔡姝越 郭美婷 實習生 譚硯文 麥子浩 上海、廣州報道

#編按:

#在2023年過去的幾個月裡,各大公司搶灘大模型、GPT商用化探索、算力基礎設施看漲……如同15世紀開啟的大航海時代,人類交往、貿易、財富有了爆炸性成長,空間革命席捲全球。改變同時,也帶來了秩序的挑戰,資料外洩、個人隱私風險、著作權侵權、虛假資訊......此外,AI帶來的後人類主義危機已然擺在桌面,人們該以何種姿態迎接人機混雜帶來的迷思?

此刻,尋求AI治理的共識、重塑新秩序成了各國共同面對的課題。南財合規科技研究院將推出AI契約論系列報道,從中外監管模式、主體責任分配、語料庫資料合規、AI倫理、產業發展等維度,進行剖析,以期為AI治理方案提供一些思路,保障負責任的創新。

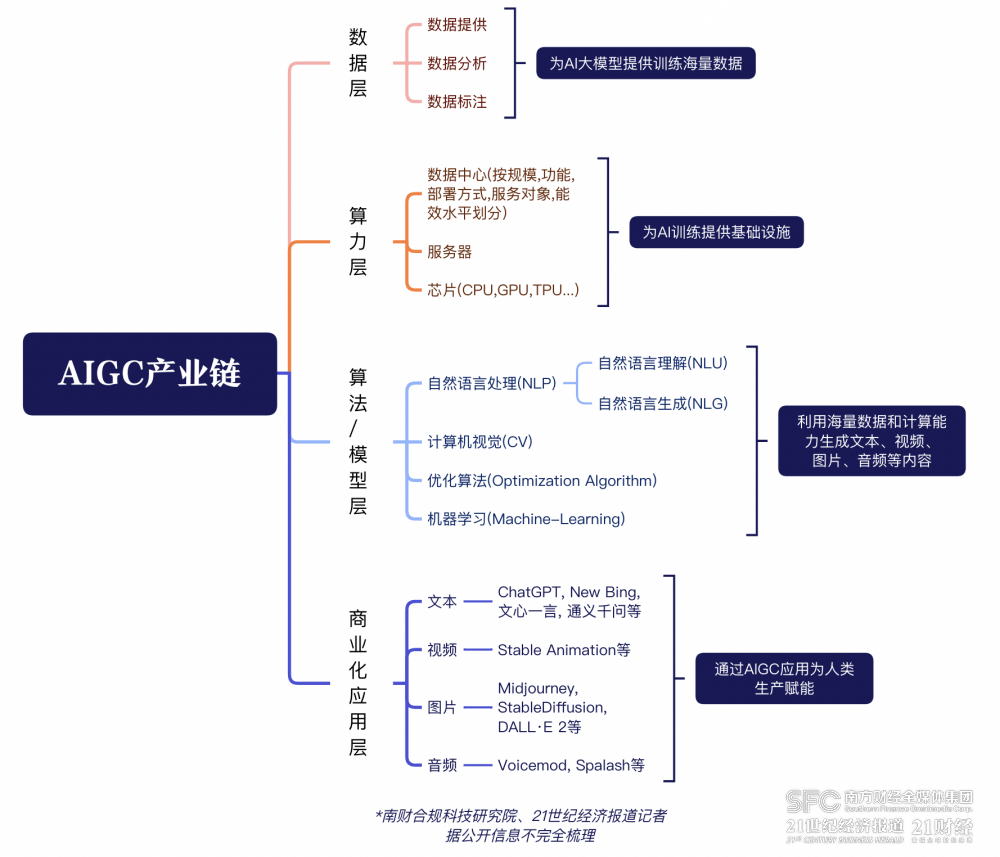

自生成式AI技術興起,到如今「百模大戰」的局面,該技術的產業鏈圖譜也已初步成形。

(AIGC產業鏈圖。製圖/南財合規科技研究院、21世紀經濟報道記者)

在生成式AI成為通用技術之前,每個生產鏈的參與者都必須考慮如何使其成為一個「可控制」的工具。

今年3月下旬,一封由特斯拉執行長馬斯克、 蘋果聯合創辦人史蒂夫沃茲尼亞克等千餘名企業家、學者簽署的《暫停大型人工智慧實驗》公開信發布。

信中提到,儘管近幾個月世界各地的人工智慧實驗室陷入了一場失控的競賽,以開發和部署更強大的數位思維,但包括技術的研發者在內, 「沒有任何人能真正理解、預測或完全控制這項技術。」

#清華大學新聞與傳播學院元宇宙文化實驗室也在《AIGC發展研究》報告中指出,AIGC強勢介入全球產業鏈,將全面替代程式設計師、平面設計、客服等工作,為人工成本劃定上限,第三世界產業鏈將因此遭受巨大衝擊。

這意味著,大算力支持下的AIGC可能成為割裂跨國公司全球產業鏈的利刃,也可能成為劃破「地球村」幻象的匕首。

因此,在AIGC快速發展的當下,如將其背後的生成式AI技術關進監管的籠子裡,釐清產業鏈各方的責任,已成為世界各國亟需處理的命題。

監理政策整理:劃清產業研發底線

目前,我國已走在了生成式AI技術規制的道路上。今年4月,國家網信辦發布的《生成式人工智慧服務管理辦法(徵求意見稿)》(以下簡稱「《辦法》」),是我國第一部針對生成式AI技術的監管文件。

整體而言,《辦法》是在現有的深度合成監管框架之下,對《互聯網資訊服務深度合成管理規定》《互聯網資訊服務演算法推薦管理規定》《網絡音視頻服務管理規定》《網路資訊內容生態治理規定》的細化,除了個人資訊保護的一般性義務,也要求人工智慧服務提供者進一步履行安全評估、演算法備案、內容識別等義務。

對於以上相關政策文件的頒布,北京大成律師事務所高級合夥人肖颯在接受21世紀經濟報道記者採訪時指出,相關企業應當重視銜接現有演算法推薦服務、深度合成服務等其他人工智慧監管法規的要求,盡力做到內部合規,結合科技與法律力量提出創造性的合規解決方案,為產業發展贏得更多的製度空間。

業界大多持支持態度,支持陸續推出的《辦法》等規範人工智慧技術發展的法案。在接受21記者採訪時,亮風台的高級產品總監魏超群分享了他的觀點。他認為,當生成式AI技術剛開始時,實施相關管理辦法對整個產業的健康發展至關重要,這些辦法將發揮顯著的促進作用。

「一方面,《辦法》的推出意味著整個產業有了明確的操作規範,可以指導企業的一整套研發流程。另一方面,也為整個產業設定了研發底線,列舉了哪些事情能做,哪些事情不能做。」魏超群指出。

如《辦法》第十七條中便要求人工智慧服務提供者「提供可以影響使用者信任、選擇的必要信息,包括預訓練和優化訓練資料的來源、規模、類型、品質等描述,人工標註規則,人工標註資料的規模和類型,基礎演算法和技術體係等”,實現對資料量龐大、規則易變的人工智慧技術的治理。

不過,也有觀點認為,目前國內的人工智慧相關法規政策文件仍需要進一步完善。

蕭颯便在訪談中提到,《辦法》雖然對於生成式人工智慧帶來的風險與衝擊作出了回應,但梳理其內容會發現,其在責任主體、適用範圍、合規義務等方面的規定都較為廣泛。

如《辦法》第五條中,明確了利用生成式人工智慧產品的服務提供者(即主體),應承擔內容生產者的責任。

原文提到,利用生成式人工智慧產品提供聊天和文字、圖像、聲音生成等服務的組織和個人,包括透過提供可程式介面等方式支援他人自行生成文字、圖像、聲音等,承擔該產品生成內容生產者的責任。 但對於服務提供者俱體應該承擔何種法律責任,《辦法》中尚未展開。

發展難題:如何平衡監理與技術

如何在技術創新發展的前提下完善人工智慧監管體系,加強其與資料合規、演算法治理的銜接與協調,是目前亟待解決的問題。

其中,明確AIGC各產業鏈環節的責任主體,打造「負責任」的AI技術,便是監管需要密切關注的要點之一。

除了《辦法》第五條中提到的主體責任分配問題,近日,歐盟也在修改後的《人工智慧法案》中提到,在人工智慧價值鏈責任分配上,任何分發者、進口者、部署者或其他第三方,均應視為高風險人工智慧系統的提供者,需要履行相應的義務。 如在高風險人工智慧系統上標明名稱、聯絡方式,提供資料規格或資料集相關信息,保存日誌等。

北京理工大學法學院助理教授裴軼事也向21記者指出,企業作為提供AI服務的關鍵主體,一方面需要保證透明的資料收集和處理-明確告知資料主體資料收集和處理的目的,並獲取必要的同意或授權。實施適當的資料安全和隱私保護措施,確保資料的機密性和完整性。另一方面,也需要進行合規的資料共享。在進行多方資料共享或資料交易時,確保合規的資料使用權益和授權機制,遵守適用的資料保護法律和規定。

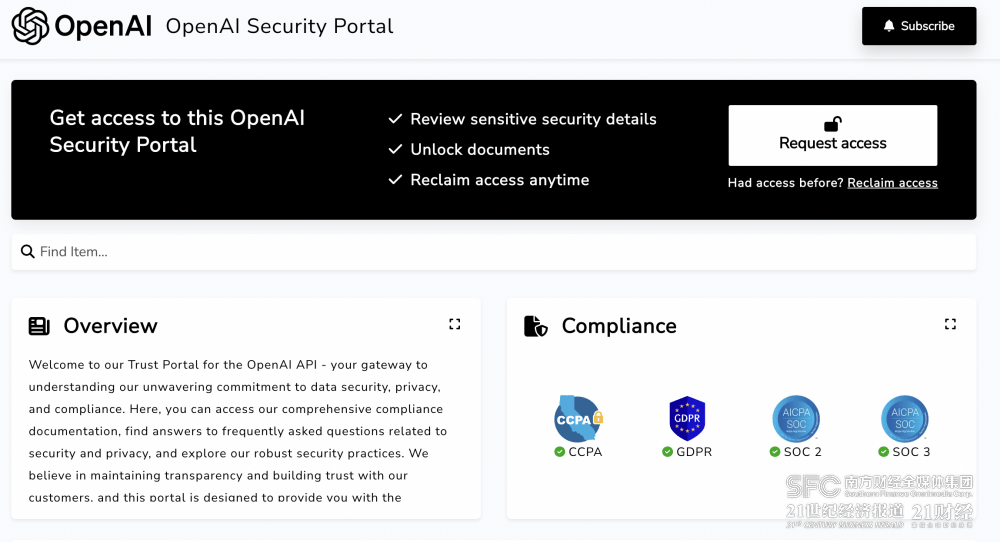

21記者觀察發現,目前已有人工智慧公司正在明確自己作為責任主體的義務。

如OpenAI便為用戶專門開設了「安全門戶」(Security Portal),在此頁面中,用戶可以瀏覽公司的合規性文檔,包括「資料安全」中的備份、刪除、靜態加密資訊以及「應用程式安全」中的程式碼分析、憑證管理等等。

(OpenAI的「安全入口」頁面。來源/OpenAI官方網站)

AI繪畫工具Midjourney官網發布的隱私權政策中,也對用戶資料的共享、保留、傳輸場景和用途做了具體說明,同時,也詳細列舉了應用在為用戶提供服務的過程中,需要蒐集身分識別識別、商業資訊、生物辨識資訊等11種個人資訊。

值得一提的是,上海某新興科技公司法務負責人在和21記者的交談中表示,目前公司內部人工智慧相關業務的服務條款正在製定中,在責任分配的規則上部分參考了OpenAI的做法。

另一方面,身為生成式AI服務的提供者,各企業也需要提起對內部合規的重視。 肖颯指出,AIGC相關企業的業務需要依賴於海量的數據及複雜的演算法,應用場景複雜多樣化,企業容易陷入各種風險之中,並且完全依靠外部監管難度非常大,因此相關企業務必加強AIGC內部合規管理。

一方面,監管機構要以全面推行企業合規改革為契機,積極探索在網路數位領域推進涉案企業合規改革和落實第三方監督評估機制,建立健全合規管理的製度機制,有效預防網路違法犯罪。另一方面,也要積極探索以事後合規整改促進事前合規建設的監管路徑,推動網路監理部門、網路企業共同研究制定資料合規規範指引,保障數位經濟健康發展。

「監管層最重要的任務在於劃定底線,其中『科技倫理』以及『國家安全』就是兩個不容讓渡的底線,在底線範圍內,可以盡量給予產業寬容的發展空間,這樣避免技術為了合規畏首畏尾、被限制發展。」裴軼事向21記者表示。

統籌:王俊

# 記者:郭美婷 蔡姝越 譚硯文 麥子浩

#製圖:蔡姝越

更多內容請下載21財經APP

以上是AI契約論⑤:生成式AI千帆競發,如何運用規則「掌舵」的詳細內容。更多資訊請關注PHP中文網其他相關文章!