目前,非英文文圖產生模型選擇有限,使用者往往要將 prompt 翻譯成英文再輸入模型。這樣不僅會造成額外的操作負擔,翻譯過程中的語言文化誤差,會影響生成圖片的準確性。

智源研究院FlagAI 團隊首創高效訓練方式,使用多語言預訓練模型和Stable Diffusion 結合,訓練多語言文圖生成模型- AltDiffusion-m18,支援18種語言的文圖生成。

包括中文、英文、日語、泰語、韓語、印地語、烏克蘭語、阿拉伯語、土耳其語、越南語、波蘭語、荷蘭語、葡萄牙語、義大利語、西班牙語、德語、法語、俄語。

Huggingface:https://huggingface.co/BAAI/AltDiffusion-m18

GitHub:https://github.com/FlagAI-Open/FlagAI/blob/master/examples/AltDiffusion -m18

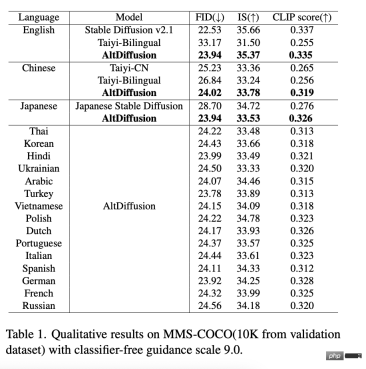

AltDiffusion-m18 在英文的FID、IS、CLIP score 客觀評測上達到了Stable Diffusion 95~99% 效果,在中文、日文上達到了最優水平,同時填補了其餘15 種語言文圖生成模型的空白,極大滿足了產業界對於多語文圖生成的強烈需求。在此,特別鳴謝 Stable Diffusion Research Team 為這項工作提供建議。

此外,AltDiffusion-m18 相關創新技術報告《AltCLIP: Altering the Language Encoder in CLIP for Extended Language Capabilities》已被 Findings of ACL 2023 接收。

技術亮點

1 全新AltCLIP,高效能、低成本建構多語言T2I 模型

去年發表的AltDiffusion -m9 中,智源團隊基於Stable Diffusion v1.4,創新地更換語言塔為多語言塔AltCLIP,並使用九種語言的多語言資料進行微調,將原始僅支援英文的 Stable Diffusion 擴展到支援9種不同的語言。

AltCLIP:https://github.com/FlagAI-Open/FlagAI/tree/master/examples/AltCLIP-m18

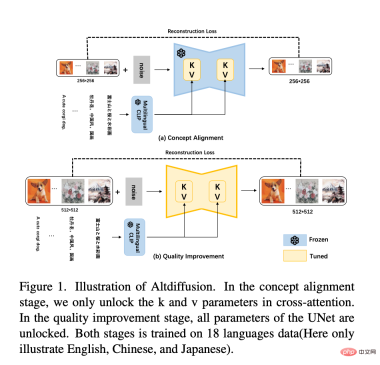

#而AltDiffusion-m18 基於Stable Diffusion v2.1 訓練。 Stable Diffusion v2.1 新的語言塔為OpenCLIP 的倒二層,因此,全新的AltCLIP 以OpenCLIP 的倒二層作為蒸餾目標重新訓練,並且在m9 的基礎上將僅對Unet 中CrossAttention 層K,V 矩陣微調,擴展成兩階段的訓練方式,如下圖:

- 第一階段:早前在m9 的實驗過程中發現,微調K,V 矩陣主要學習的是文圖的概念對齊,所以m18 訓練的第一階段繼續使用18 語言的資料進行K,V矩陣的微調。此外,透過實驗證明,將圖片從 512*512 的解析度降低到 256*256 並不會損失圖片的語意資訊。因此,在第一階段學習文圖概念對齊的過程中使用 256*256 的解析度進行訓練,加快了訓練速度。

- 第二階段:為了進一步提高生成影像的質量,使用 512*512 的分辨率在 18 語言的資料中進行 Unet 全量參數的訓練。此外,丟掉 10% 的文字來進行 uncondition 的訓練,來服務 classifier-free guidance 的推理。

- 此外,採用了一種無分類器引導訓練技術,進一步提高生成品質。

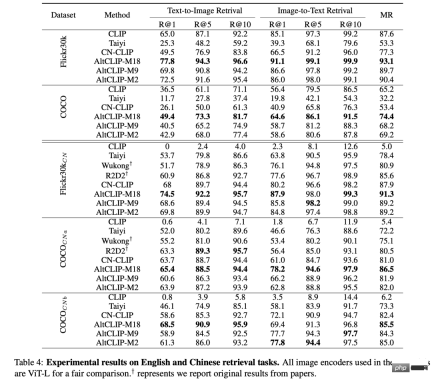

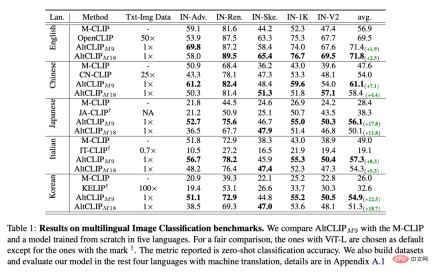

最新評測結果顯示,AltCLIP-m18 在中英文zero-shot(零樣本)檢索任務上超過CLIP 達到了最優水平⬇️

#在多語言圖片分類benchmarks 上,AltCLIP-m9(早期版本,支援9種語言) 與AltCLIP-m18 達到最優水平⬇️

同樣,得益於AltCLIP創新的換塔思路,AltDiffusion-m18 也可以無縫連接Stable Diffusion 所有建立在原CLIP 上的模型和生態工具,所有支援Stable Diffusion 的工具如Stable Diffusion WebUI,DreamBooth 等都可應用AltDiffusion-m18 上。無痛上手,可玩性極佳!

2 多國語言產生效果對齊,效能優越、細節準確

在全新AltCLIP 的加持下,AltDiffusion-m18 在英文的FID、IS、CLIP score 評測中達到了原始Stable Diffusion 95~99% 的效果,並在中文、日文等17 種語言中實現了最先進的效能,詳細資料如下表所示:

在英文、中文、日文上,AltDiffusion-m18 與其他模型產生結果相比,效果更優越、細節更準確:

上圖(a)中AltDiffusion-m18 可以產生跟原始 Stable Diffusion 高度一致的結果,並且在prompt 理解上優於國內其他中英雙語模型,例如:"A stuffed bear", "A black and white photo", "cat"等在國內其他中英雙語模型中生成失敗的概念可以在AltDiffusion 中成功生成。同樣的現像在中文和日文中也有出現。

上圖(b)中的"黑色沙發,木地板"僅有 AltDiffusion-m18 正確生成。

上圖(c)中的"bears",Japanese Stable Diffusion 錯誤生成為“人類”,AltDiffusion-m18 可以正確生成為“熊”。

此外,智源 FlagEval 團隊開發了文圖生成模型評測工具 ImageEval。經評測,AltDiffusion-m18 在實體物件、實體數量維度上的準確度分別超過國內同儕模式 11%、 10%(註:ImageEval 評測方法和結果將於近期公開發布,敬請期待)。

3 小語種文生圖救星,提供多語言文圖生成模型參考系

AltDiffusion-m18 從多語言的資料中學到了不同語言的偏置,幫助使用者跨越語言翻譯門檻、繞過文化轉譯,減少了語言背後文化訊息的流失。如下圖所示,中文、日文 Prompt 生成的小男孩的臉部輪廓更加“亞洲風”,而英語及其他歐洲地區語言 prompt 生成小男孩則更加“歐美風”。

更有趣的是,在不同語言下動物的 prompt 產生的圖片細節也有差異。如下圖所示,雖然不同語言產生的圖片整體上具有高度一致性,但畫面背景和柯基的五官細節都有細微差異。

總的來說,AltDiffusion-m18 為多語言文圖產生模型提供了一個基礎參考系。以西班牙語、德語、法語等15 種語言為母語的用戶,不必再將腦海中的 prompt 翻譯成英文,就可以感受到 AIGC 的樂趣。 AI 調教高手們還可以在 AltDiffusion-m18 基礎上結合 DreamBooth 、ControlNet 和 LoRA 等進一步優化,或者使用其他語言的語料微調得到更好的文圖生成效果。

同時,大模型演算法、模型及工具一站式開源專案- FlagAI (github.com/FlagAI-Open/FlagAI)也提供了訓練推理的工具和API ,方便大家快速下載和使用AltDiffusion-m18 。

以上是產生多語種文字與圖片的全能工具AltDiffusion-m18的詳細內容。更多資訊請關注PHP中文網其他相關文章!

個人黑客將是一隻非常兇猛的熊May 11, 2025 am 11:09 AM

個人黑客將是一隻非常兇猛的熊May 11, 2025 am 11:09 AM網絡攻擊正在發展。 通用網絡釣魚電子郵件的日子已經一去不復返了。 網絡犯罪的未來是超個性化的,利用了容易獲得的在線數據和AI來製作高度針對性的攻擊。 想像一個知道您的工作的騙子

教皇獅子座XIV揭示了AI如何影響他的名字選擇May 11, 2025 am 11:07 AM

教皇獅子座XIV揭示了AI如何影響他的名字選擇May 11, 2025 am 11:07 AM新當選的教皇獅子座(Leo Xiv)在對紅衣主教學院的就職演講中,討論了他的同名人物教皇里奧XIII的影響,他的教皇(1878-1903)與汽車和汽車和汽車公司的黎明相吻合

Fastapi -MCP初學者和專家教程-Analytics VidhyaMay 11, 2025 am 10:56 AM

Fastapi -MCP初學者和專家教程-Analytics VidhyaMay 11, 2025 am 10:56 AM本教程演示瞭如何使用模型上下文協議(MCP)和FastAPI將大型語言模型(LLM)與外部工具集成在一起。 我們將使用FastAPI構建一個簡單的Web應用程序,並將其轉換為MCP服務器,使您的L

AI可以使指導比以往任何時候都更有意義May 10, 2025 am 11:17 AM

AI可以使指導比以往任何時候都更有意義May 10, 2025 am 11:17 AM我完全同意。 我的成功與導師的指導密不可分。 他們的見解,尤其是關於業務管理,構成了我的信念和實踐的基石。 這種經驗強調了我對導師的承諾

AI發掘了採礦業的新潛力May 10, 2025 am 11:16 AM

AI發掘了採礦業的新潛力May 10, 2025 am 11:16 AMAI 增强型矿业设备 矿业作业环境恶劣且危险重重。人工智能系统通过将人类从最危险的环境中移除并增强人类能力,帮助提高整体效率和安全性。人工智能越来越多地用于为矿业作业中使用的自动驾驶卡车、钻机和装载机提供动力。 这些 AI 驱动的车辆能够在危险环境中精确作业,从而提高安全性和生产力。一些公司已经开发出用于大型矿业作业的自动驾驶采矿车辆。 在挑战性环境中运行的设备需要持续维护。然而,维护会使关键设备离线并消耗资源。更精确的维护意味着昂贵且必要的设备的正常运行时间增加以及显著的成本节约。 AI 驱动

為什麼AI代理會觸發25年來最大的工作場所革命May 10, 2025 am 11:15 AM

為什麼AI代理會觸發25年來最大的工作場所革命May 10, 2025 am 11:15 AMSalesforce首席執行官Marc Benioff預測了由AI代理商驅動的巨大的工作場所革命,這是Salesforce及其客戶群中已經進行的轉型。 他設想從傳統市場轉變為一個較大的市場,重點是

隨著AI採用的飆升,人力資源將搖滾我們的世界May 10, 2025 am 11:14 AM

隨著AI採用的飆升,人力資源將搖滾我們的世界May 10, 2025 am 11:14 AM人力資源中AI的崛起:與機器人同事一起導航勞動力 將人工智能集成到人力資源(HR)不再是未來派的概念。它正在迅速成為新現實。 這種轉變影響了人力資源專業人員和員工,DEM

5 Chatgpt提示突破收入高原May 10, 2025 am 11:13 AM

5 Chatgpt提示突破收入高原May 10, 2025 am 11:13 AM您的營收突破就在眼前。打破天花板,將您的業務提升到一個全新的高度。這是可能的。複製、粘貼並修改 ChatGPT 中的方括號內容,並保持相同的聊天窗口打開,以便上下文得以延續。 利用 ChatGPT 打破營收障礙:釋放您的增長潛力 10 倍增長思維 您的目標讓您感到厭倦。曾經讓您興奮的商業願景現在感覺令人痛苦地安全。您達到了目標,卻感覺空虛。成功者並非憑運氣。他們設定大膽的目標,既令人恐懼又令人振奮。他們將商業視為一場遊戲,您也可以如此。追求更高的賭注。夢想更大。計劃更大。執行更大。看著您的成果超

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

記事本++7.3.1

好用且免費的程式碼編輯器

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

MinGW - Minimalist GNU for Windows

這個專案正在遷移到osdn.net/projects/mingw的過程中,你可以繼續在那裡關注我們。 MinGW:GNU編譯器集合(GCC)的本機Windows移植版本,可自由分發的導入函式庫和用於建置本機Windows應用程式的頭檔;包括對MSVC執行時間的擴展,以支援C99功能。 MinGW的所有軟體都可以在64位元Windows平台上運作。

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境