無需寫程式碼能力,手搓最簡單BabyGPT模型:前特斯拉AI總監新作

- 王林轉載

- 2023-04-27 20:25:05971瀏覽

我們知道,OpenAI 的GPT 系列透過大規模和預訓練的方式打開了人工智慧的新時代,然而對於大多數研究者來說,語言大模型(LLM)因為體積和算力需求而顯得高不可攀。在科技向上發展的同時,人們也一直在探索「最簡」的 GPT 模式。

近日,特斯拉前AI 總監,剛剛回歸OpenAI 的Andrej Karpathy 介紹了一種最簡GPT 的玩法,或許能為更多人了解這種流行AI 模型背後的技術帶來幫助。

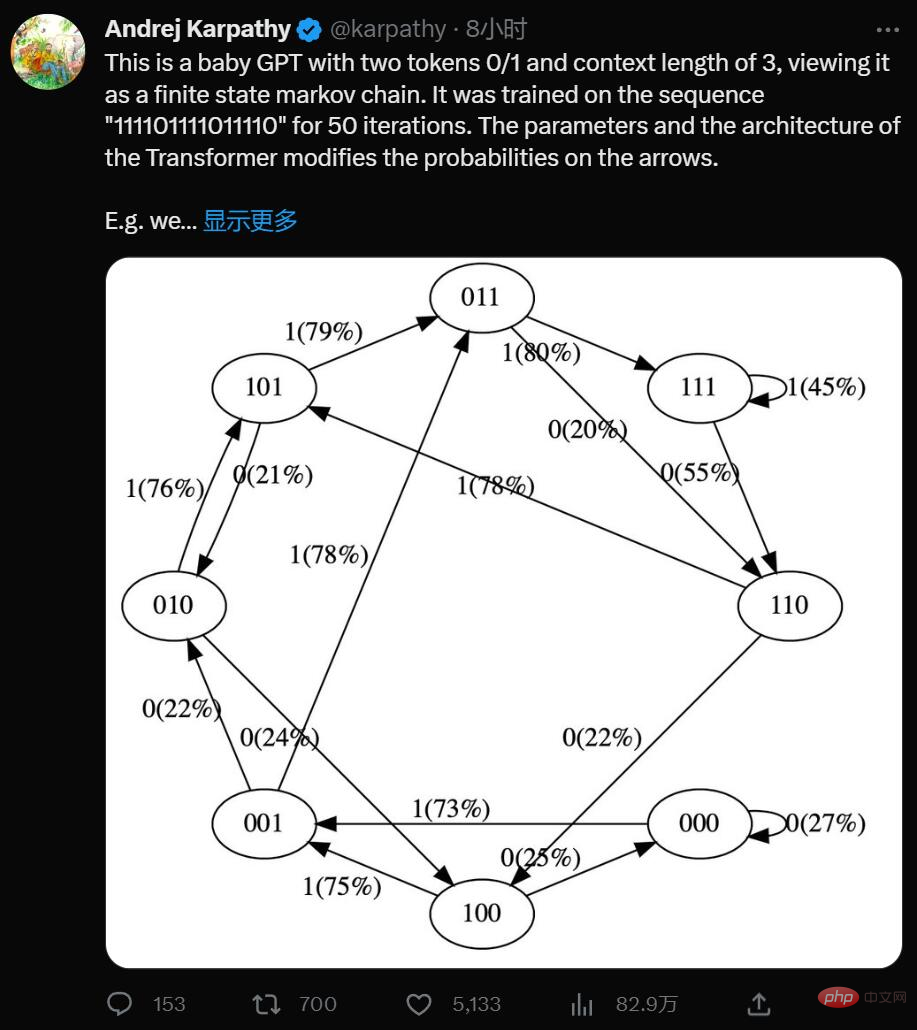

是的,這是兩個token 0/1 和上下文長度為3 的極簡GPT,將其視為有限狀態馬可夫鏈。它在序列“111101111011110”上訓練了 50 次迭代,Transformer 的參數和架構修改了箭頭上的機率。

例如我們可以看到:

- #在訓練資料中,狀態101 確定性地轉換為011,因此該轉換的機率變得更高(79%)。但不接近 100%,因為這裡只做了 50 步驟優化。

- 狀態 111 以 50% 的機率分別進入 111 和 110,模型幾乎已經學會了(45%、55%)。

- 在訓練期間從未遇到像 000 這樣的狀態,但具有相對尖銳的轉換機率,例如 73% 轉到 001。這是 Transformer 歸納偏差的結果。你可能會想這是 50%,除了在實際部署中幾乎每個輸入序列都是唯一的,而不是逐字出現在訓練資料中。

透過簡化,Karpathy 已讓 GPT 模型變得易於視覺化,讓你可以直觀地了解整個系統。

你可以在這裡試試它:https://colab.research.google.com/drive/1SiF0KZJp75rUeetKOWqpsA8clmHP6jMg?usp=sharing

####################################### ######實際上,即使是GPT 的最初版本,模型的體積很相當可觀:在2018 年,OpenAI 發布了第一代GPT 模型,從論文《Improving Language Understanding by Generative Pre-Training》可以了解到,其採用了12 層的Transformer Decoder 結構,使用約5GB 無監督文字資料進行訓練。 ############但如果將其概念簡化,GPT 是一種神經網絡,它採用一些離散 token 序列並預測序列中下一個 token 的機率。例如,如果只有兩個標記0 和1,那麼一個很小的二進位GPT 可以例如告訴我們:######

[0,1,0] ---> GPT ---> [P (0) = 20%, P (1) = 80%]#######在這裡,GPT 採用位元序列[0,1,0] ,並根據目前的參數設置,預測下一個為1 的可能性為80%。重要的是,預設情況下 GPT 的上下文長度是有限的。如果上下文長度為 3,那麼它們在輸入時最多只能使用 3 個 token。在上面的例子中,如果我們拋出一枚有偏差的硬幣並採樣 1 確實應該是下一個,那麼我們將從原始狀態 [0,1,0] 轉換到新狀態 [1,0,1]。我們在右側添加了新位元 (1),並透過丟棄最左邊的位元 (0) 將序列截斷為上下文長度 3,然後可以一遍又一遍地重複這個過程以在狀態之間轉換。 ############很明顯,GPT 是一個有限狀態馬可夫鏈:有一組有限的狀態和它們之間的機率轉移箭頭。每個狀態都由 GPT 輸入處 token 的特定設定定義(例如 [0,1,0])。我們可以以一定的機率將其轉換到新狀態,如 [1,0,1]。讓我們詳細看看它是如何運作的:######

# hyperparameters for our GPT # vocab size is 2, so we only have two possible tokens: 0,1 vocab_size = 2 # context length is 3, so we take 3 bits to predict the next bit probability context_length = 3######GPT 神經網路的輸入是長度為 context_length 的 token 序列。這些 token 是離散的,因此狀態空間很簡單:######

print ('state space (for this exercise) = ', vocab_size ** context_length)

# state space (for this exercise) = 8######細節:準確來說,GPT 可以採用從 1 到 context_length 的任意數量的 token。因此如果上下文長度為 3,原則上我們可以在嘗試預測下一個 token 時輸入 1 個、2 個或 3 個 token。這裡我們忽略這一點並假設上下文長度已“最大化”,只是為了簡化下面的一些程式碼,但這一點值得牢記。 ######print ('actual state space (in reality) = ', sum (vocab_size ** i for i in range (1, context_length+1)))

# actual state space (in reality) = 14我们现在要在 PyTorch 中定义一个 GPT。出于本笔记本的目的,你无需理解任何此代码。

现在让我们构建 GPT 吧:

config = GPTConfig ( block_size = context_length, vocab_size = vocab_size, n_layer = 4, n_head = 4, n_embd = 16, bias = False, ) gpt = GPT (config)

对于这个笔记本你不必担心 n_layer、n_head、n_embd、bias,这些只是实现 GPT 的 Transformer 神经网络的一些超参数。

GPT 的参数(12656 个)是随机初始化的,它们参数化了状态之间的转移概率。如果你平滑地更改这些参数,就会平滑地影响状态之间的转换概率。

现在让我们试一试随机初始化的 GPT。让我们获取上下文长度为 3 的小型二进制 GPT 的所有可能输入:

def all_possible (n, k): # return all possible lists of k elements, each in range of [0,n) if k == 0: yield [] else: for i in range (n): for c in all_possible (n, k - 1): yield [i] + c list (all_possible (vocab_size, context_length))

[[0, 0, 0], [0, 0, 1], [0, 1, 0], [0, 1, 1], [1, 0, 0], [1, 0, 1], [1, 1, 0], [1, 1, 1]]

这是 GPT 可能处于的 8 种可能状态。让我们对这些可能的标记序列中的每一个运行 GPT,并获取序列中下一个标记的概率,并绘制为可视化程度比较高的图形:

# we'll use graphviz for pretty plotting the current state of the GPT

from graphviz import Digraph

def plot_model ():

dot = Digraph (comment='Baby GPT', engine='circo')

for xi in all_possible (gpt.config.vocab_size, gpt.config.block_size):

# forward the GPT and get probabilities for next token

x = torch.tensor (xi, dtype=torch.long)[None, ...] # turn the list into a torch tensor and add a batch dimension

logits = gpt (x) # forward the gpt neural net

probs = nn.functional.softmax (logits, dim=-1) # get the probabilities

y = probs [0].tolist () # remove the batch dimension and unpack the tensor into simple list

print (f"input {xi} ---> {y}")

# also build up the transition graph for plotting later

current_node_signature = "".join (str (d) for d in xi)

dot.node (current_node_signature)

for t in range (gpt.config.vocab_size):

next_node = xi [1:] + [t] # crop the context and append the next character

next_node_signature = "".join (str (d) for d in next_node)

p = y [t]

label=f"{t}({p*100:.0f}%)"

dot.edge (current_node_signature, next_node_signature, label=label)

return dot

plot_model ()input [0, 0, 0] ---> [0.4963349997997284, 0.5036649107933044] input [0, 0, 1] ---> [0.4515703618526459, 0.5484296679496765] input [0, 1, 0] ---> [0.49648362398147583, 0.5035163760185242] input [0, 1, 1] ---> [0.45181113481521606, 0.5481888651847839] input [1, 0, 0] ---> [0.4961162209510803, 0.5038837194442749] input [1, 0, 1] ---> [0.4517717957496643, 0.5482282042503357] input [1, 1, 0] ---> [0.4962802827358246, 0.5037197470664978] input [1, 1, 1] ---> [0.4520467519760132, 0.5479532480239868]

我们看到了 8 个状态,以及连接它们的概率箭头。因为有 2 个可能的标记,所以每个节点有 2 个可能的箭头。请注意,在初始化时,这些概率中的大多数都是统一的(在本例中为 50%),这很好而且很理想,因为我们甚至根本没有训练模型。

下面开始训练:

# let's train our baby GPT on this sequence seq = list (map (int, "111101111011110")) seq

[1, 1, 1, 1, 0, 1, 1, 1, 1, 0, 1, 1, 1, 1, 0]

# convert the sequence to a tensor holding all the individual examples in that sequence

X, Y = [], []

# iterate over the sequence and grab every consecutive 3 bits

# the correct label for what's next is the next bit at each position

for i in range (len (seq) - context_length):

X.append (seq [i:i+context_length])

Y.append (seq [i+context_length])

print (f"example {i+1:2d}: {X [-1]} --> {Y [-1]}")

X = torch.tensor (X, dtype=torch.long)

Y = torch.tensor (Y, dtype=torch.long)

print (X.shape, Y.shape)我们可以看到在那个序列中有 12 个示例。现在让我们训练它:

# init a GPT and the optimizer torch.manual_seed (1337) gpt = GPT (config) optimizer = torch.optim.AdamW (gpt.parameters (), lr=1e-3, weight_decay=1e-1)

# train the GPT for some number of iterations for i in range (50): logits = gpt (X) loss = F.cross_entropy (logits, Y) loss.backward () optimizer.step () optimizer.zero_grad () print (i, loss.item ())

print ("Training data sequence, as a reminder:", seq)

plot_model ()我们没有得到这些箭头的准确 100% 或 50% 的概率,因为网络没有经过充分训练,但如果继续训练,你会期望接近。

请注意一些其他有趣的事情:一些从未出现在训练数据中的状态(例如 000 或 100)对于接下来应该出现的 token 有很大的概率。如果在训练期间从未遇到过这些状态,它们的出站箭头不应该是 50% 左右吗?这看起来是个错误,但实际上是可取的,因为在部署期间的真实应用场景中,几乎每个 GPT 的测试输入都是训练期间从未见过的输入。我们依靠 GPT 的内部结构(及其「归纳偏差」)来适当地执行泛化。

大小比较:

- GPT-2 有 50257 个 token 和 2048 个 token 的上下文长度。所以 `log2 (50,257) * 2048 = 每个状态 31,984 位 = 3,998 kB。这足以实现量变。

- GPT-3 的上下文长度为 4096,因此需要 8kB 的内存;大约相当于 Atari 800。

- GPT-4 最多 32K 个 token,所以大约 64kB,即 Commodore64。

- I/O 设备:一旦开始包含连接到外部世界的输入设备,所有有限状态机分析就会崩溃。在 GPT 领域,这将是任何一种外部工具的使用,例如必应搜索能够运行检索查询以获取外部信息并将其合并为输入。

Andrej Karpathy 是 OpenAI 的创始成员和研究科学家。但在 OpenAI 成立一年多后,Karpathy 便接受了马斯克的邀请,加入了特斯拉。在特斯拉工作的五年里,他一手促成了 Autopilot 的开发。这项技术对于特斯拉的完全自动驾驶系统 FSD 至关重要,也是马斯克针对 Model S、Cybertruck 等车型的卖点之一。

今年 2 月,在 ChatGPT 火热的背景下,Karpathy 回归 OpenAI,立志构建现实世界的 JARVIS 系统。

最近一段时间,Karpathy 给大家贡献了很多学习材料,包括详解反向传播的课程 、重写的 minGPT 库、从零开始构建 GPT 模型的完整教程等。

以上是無需寫程式碼能力,手搓最簡單BabyGPT模型:前特斯拉AI總監新作的詳細內容。更多資訊請關注PHP中文網其他相關文章!